Toward Theoretical Insights into Diffusion Trajectory Distillation via Operator Merging

作者: Weiguo Gao, Ming Li

分类: cs.LG, cs.AI

发布日期: 2025-05-21

备注: 31 pages, 19 figures

💡 一句话要点

通过算子合并理论分析扩散轨迹蒸馏,优化单步生成质量。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 扩散模型 轨迹蒸馏 算子合并 动态规划 信号保真度 相变 线性算子

📋 核心要点

- 扩散模型采样速度慢,轨迹蒸馏旨在加速采样,但缺乏对蒸馏策略与生成质量间权衡的理论理解。

- 论文将轨迹蒸馏视为线性状态下的算子合并问题,通过优化算子合并策略来最大化信号保真度。

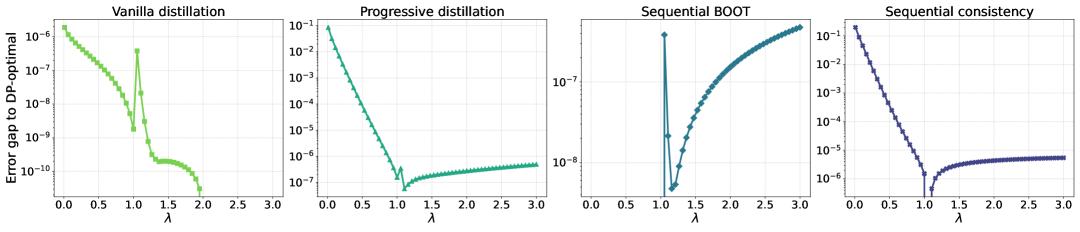

- 论文提出动态规划算法计算最佳合并策略,并揭示了由数据协方差结构控制的相变现象。

📝 摘要(中文)

扩散轨迹蒸馏方法旨在加速扩散模型的采样过程,该模型虽然能产生高质量的输出,但采样速度较慢。这些方法训练一个学生模型,以单步方式逼近预训练教师模型的多步去噪过程,从而实现一次性生成。然而,关于不同蒸馏策略和生成质量之间权衡的理论见解仍然有限,这使得它们的优化和选择变得复杂。本文朝着解决这一差距迈出了第一步。具体来说,我们将轨迹蒸馏重新解释为线性状态下的算子合并问题,其中教师模型的每个步骤都表示为作用于噪声数据的线性算子。这些算子可以清晰地几何解释为对应于噪声计划的投影和重缩放。在合并过程中,由于离散化和学生模型的有限优化时间,信号收缩作为算子的凸组合而发生。我们提出了一种动态规划算法来计算最大程度保持信号保真度的最佳合并策略。此外,我们证明了最佳策略中存在由数据协方差结构控制的急剧相变。我们的发现增强了对扩散轨迹蒸馏的理论理解,并为改进蒸馏策略提供了实践见解。

🔬 方法详解

问题定义:扩散模型生成高质量图像,但迭代采样过程耗时。轨迹蒸馏旨在训练一个学生模型,一步到位地模仿教师模型的去噪过程,加速生成。然而,现有方法缺乏对不同蒸馏策略效果的理论分析,难以指导策略选择和优化。

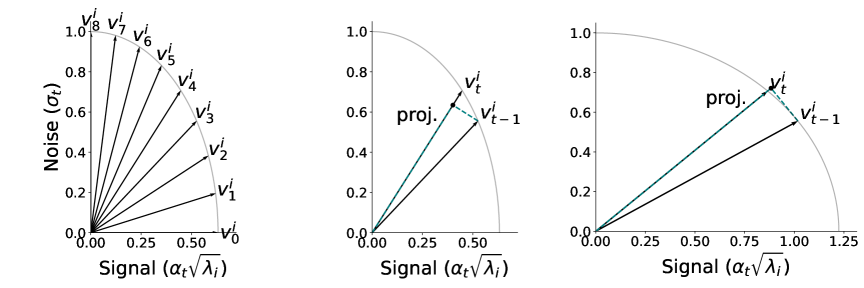

核心思路:论文将扩散轨迹蒸馏过程视为算子合并问题。教师模型的每一步去噪操作都被视为一个线性算子,作用于带噪数据。通过合并这些算子,学生模型可以一步完成教师模型的多步操作。核心在于找到最佳的算子合并策略,最大程度地保留原始信号的保真度。

技术框架:论文的核心技术框架包括:1) 将扩散过程的每一步建模为线性算子;2) 将轨迹蒸馏问题转化为算子合并问题;3) 提出动态规划算法,寻找最佳的算子合并策略,以最大化信号保真度。该框架在线性假设下简化了问题,便于理论分析。

关键创新:论文的关键创新在于:1) 将扩散轨迹蒸馏问题重新定义为算子合并问题,为理论分析提供了新视角;2) 提出了基于动态规划的算子合并算法,能够找到最大化信号保真度的最佳策略;3) 揭示了最佳策略中存在的相变现象,并分析了其与数据协方差结构的关系。

关键设计:论文的关键设计包括:1) 将噪声计划与线性算子关联,便于几何解释;2) 使用动态规划算法寻找最佳合并策略,目标是最大化信号保真度;3) 分析了信号收缩现象,并将其归因于离散化和优化限制。论文在线性假设下进行分析,可能与实际非线性模型存在差异。

🖼️ 关键图片

📊 实验亮点

论文提出了基于动态规划的算子合并算法,能够找到最大化信号保真度的最佳蒸馏策略。此外,论文还揭示了最佳策略中存在的相变现象,并分析了其与数据协方差结构的关系,为理解和改进扩散轨迹蒸馏提供了新的理论视角。

🎯 应用场景

该研究成果可应用于加速图像生成、视频生成等领域,尤其是在资源受限的设备上部署扩散模型。通过优化蒸馏策略,可以提高生成速度,同时保持图像质量,具有广泛的应用前景。未来的研究可以探索将该理论框架扩展到非线性扩散模型。

📄 摘要(原文)

Diffusion trajectory distillation methods aim to accelerate sampling in diffusion models, which produce high-quality outputs but suffer from slow sampling speeds. These methods train a student model to approximate the multi-step denoising process of a pretrained teacher model in a single step, enabling one-shot generation. However, theoretical insights into the trade-off between different distillation strategies and generative quality remain limited, complicating their optimization and selection. In this work, we take a first step toward addressing this gap. Specifically, we reinterpret trajectory distillation as an operator merging problem in the linear regime, where each step of the teacher model is represented as a linear operator acting on noisy data. These operators admit a clear geometric interpretation as projections and rescalings corresponding to the noise schedule. During merging, signal shrinkage occurs as a convex combination of operators, arising from both discretization and limited optimization time of the student model. We propose a dynamic programming algorithm to compute the optimal merging strategy that maximally preserves signal fidelity. Additionally, we demonstrate the existence of a sharp phase transition in the optimal strategy, governed by data covariance structures. Our findings enhance the theoretical understanding of diffusion trajectory distillation and offer practical insights for improving distillation strategies.