Time Tracker: Mixture-of-Experts-Enhanced Foundation Time Series Forecasting Model with Decoupled Training Pipelines

作者: Xiaohou Shi, Ke Li, Aobo Liang, Yan Sun

分类: cs.LG

发布日期: 2025-05-21

💡 一句话要点

Time Tracker:一种混合专家增强的、解耦训练流程的时序预测基础模型,用于提升多元时间序列预测精度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间序列预测 基础模型 混合专家模型 图学习 多元时间序列 Transformer 序列依赖关系

📋 核心要点

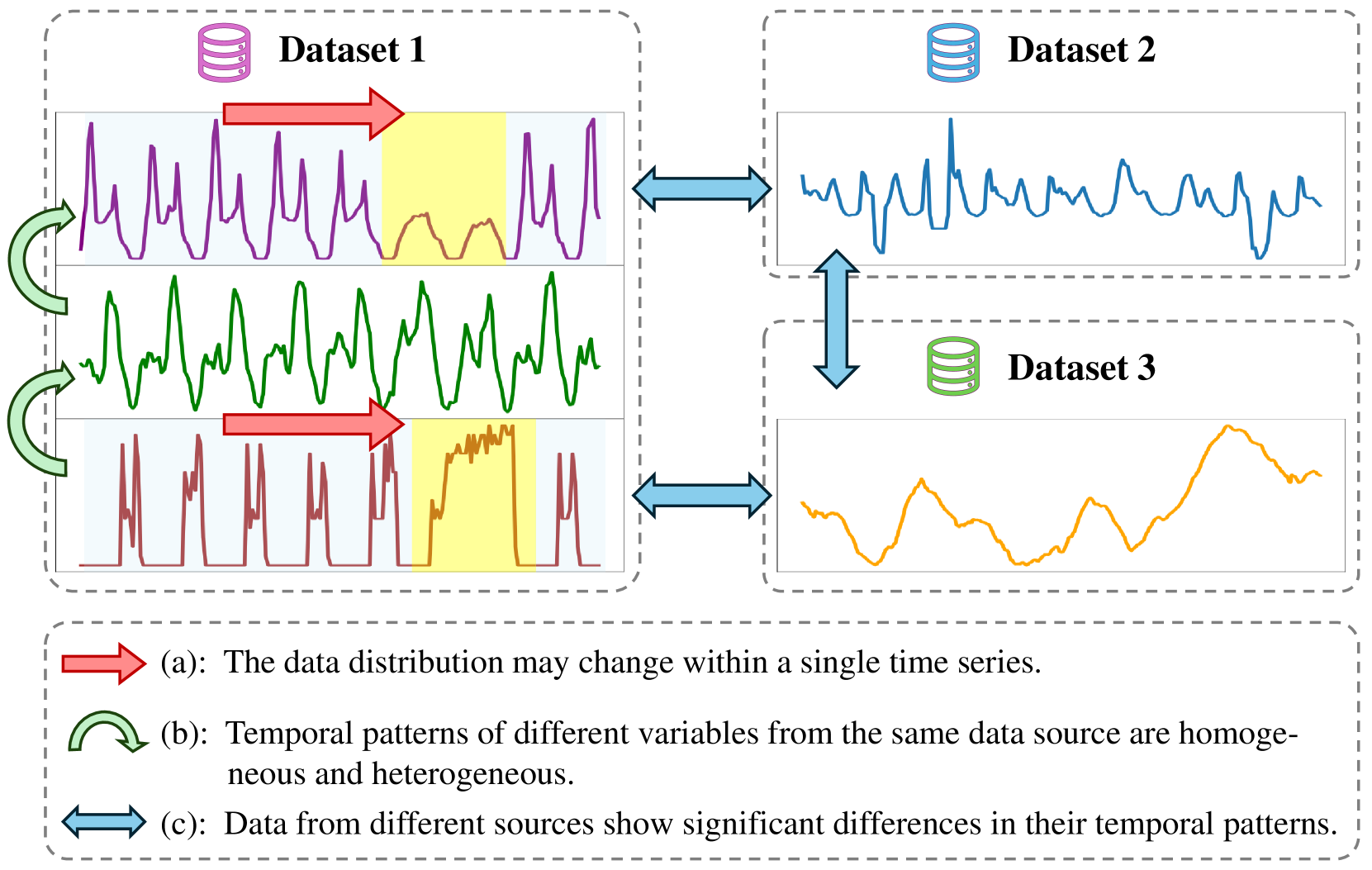

- 现有时间序列模型难以有效处理真实世界时间序列在不同时间和领域内的多样性,且忽略了多元时间序列中重要的序列间依赖关系。

- Time Tracker通过引入稀疏混合专家(MoE)Transformer来建模多样的时间序列模式,并提出Any-variate Attention来统一处理单变量和多变量时间序列。

- Time Tracker设计了一个图学习模块,利用频域特征构建序列间关系,从而更精确地捕获通道混合建模中的序列间依赖关系,实现了SOTA性能。

📝 摘要(中文)

近年来,时间序列基础模型在预测精度方面表现出色。然而,真实世界的时间序列在不同时间和领域内表现出显著的多样性,使得单一模型架构难以适应所有复杂场景。此外,时间序列数据可能具有多个变量,这些变量之间存在复杂的相互关系。目前主流工作主要集中在预训练和微调阶段以通道独立的方式对时间序列进行建模,忽略了有价值的序列间依赖关系。为此,我们提出了Time Tracker,旨在更好地预测多元时间序列数据。首先,我们利用Transformer中的稀疏混合专家(MoE)来处理多样化时间序列模式的建模,从而减轻了单一模型的学习难度,同时提高了其泛化能力。此外,我们提出了Any-variate Attention,使统一的模型结构能够无缝地处理单变量和多变量时间序列,从而支持预训练期间的通道独立建模和微调期间的通道混合建模。此外,我们设计了一个图学习模块,该模块构建来自频域特征的序列之间的关系,为在通道混合建模中捕获序列间依赖关系提供更精确的指导。基于这些进步,Time Tracker在预测精度、模型泛化和适应性方面实现了最先进的性能。

🔬 方法详解

问题定义:论文旨在解决多元时间序列预测问题,现有方法主要采用通道独立的方式建模,忽略了序列间的依赖关系,并且难以适应不同时间跨度和领域的时间序列多样性。这导致模型泛化能力不足,预测精度受限。

核心思路:论文的核心思路是利用混合专家模型(MoE)来处理时间序列的多样性,并引入Any-variate Attention机制来统一处理单变量和多变量时间序列。此外,通过图学习模块建模序列间的依赖关系,从而提升预测精度和泛化能力。

技术框架:Time Tracker的整体框架包含以下几个主要模块:1) 混合专家Transformer:利用MoE处理时间序列的多样性;2) Any-variate Attention:统一处理单变量和多变量时间序列,支持通道独立预训练和通道混合微调;3) 图学习模块:从频域特征构建序列间关系,指导序列间依赖关系的捕获。整体流程是先进行预训练,然后进行微调。

关键创新:论文的关键创新在于:1) 引入稀疏混合专家(MoE)Transformer来建模多样的时间序列模式;2) 提出Any-variate Attention,统一处理单变量和多变量时间序列;3) 设计图学习模块,利用频域特征构建序列间关系,从而更精确地捕获序列间依赖关系。与现有方法相比,Time Tracker能够更好地处理时间序列的多样性,并有效利用序列间的依赖关系。

关键设计:在混合专家Transformer中,专家数量和路由策略是关键参数。Any-variate Attention的设计允许模型在预训练阶段进行通道独立建模,在微调阶段进行通道混合建模。图学习模块中,频域特征的选择和图结构的构建方式是关键设计。损失函数方面,可能采用了预测误差和图学习相关的正则化项。

🖼️ 关键图片

📊 实验亮点

论文提出的Time Tracker模型在多个时间序列预测数据集上取得了state-of-the-art的性能。具体性能数据未知,但摘要中强调了在预测精度、模型泛化和适应性方面均有显著提升。通过引入MoE、Any-variate Attention和图学习模块,Time Tracker能够更好地处理时间序列的多样性,并有效利用序列间的依赖关系,从而超越了现有的基线模型。

🎯 应用场景

Time Tracker可应用于各种需要高精度时间序列预测的领域,例如金融市场的股票价格预测、能源消耗预测、交通流量预测、供应链管理、以及工业生产过程中的设备状态监测和故障预测等。该模型能够提升预测精度,帮助企业做出更明智的决策,降低运营成本,提高效率。

📄 摘要(原文)

In the past few years, time series foundation models have achieved superior predicting accuracy. However, real-world time series often exhibit significant diversity in their temporal patterns across different time spans and domains, making it challenging for a single model architecture to fit all complex scenarios. In addition, time series data may have multiple variables exhibiting complex correlations between each other. Recent mainstream works have focused on modeling times series in a channel-independent manner in both pretraining and finetuning stages, overlooking the valuable inter-series dependencies. To this end, we propose \textbf{Time Tracker} for better predictions on multivariate time series data. Firstly, we leverage sparse mixture of experts (MoE) within Transformers to handle the modeling of diverse time series patterns, thereby alleviating the learning difficulties of a single model while improving its generalization. Besides, we propose Any-variate Attention, enabling a unified model structure to seamlessly handle both univariate and multivariate time series, thereby supporting channel-independent modeling during pretraining and channel-mixed modeling for finetuning. Furthermore, we design a graph learning module that constructs relations among sequences from frequency-domain features, providing more precise guidance to capture inter-series dependencies in channel-mixed modeling. Based on these advancements, Time Tracker achieves state-of-the-art performance in predicting accuracy, model generalization and adaptability.