Flattening Hierarchies with Policy Bootstrapping

作者: John L. Zhou, Jonathan C. Kao

分类: cs.LG, cs.AI, cs.RO

发布日期: 2025-05-20 (更新: 2026-01-02)

备注: NeurIPS 2025 (Spotlight, top 3.2%)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出基于策略引导的扁平化层级强化学习方法,解决长程目标条件强化学习问题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 离线强化学习 目标条件强化学习 分层强化学习 策略引导 重要性采样

📋 核心要点

- 长程目标条件强化学习面临稀疏奖励和折扣问题,难以有效学习。

- 提出一种基于策略引导的扁平化方法,避免了分层强化学习的复杂性。

- 实验表明,该方法在长程任务上优于现有离线目标条件强化学习算法。

📝 摘要(中文)

离线目标条件强化学习(GCRL)是一种有前景的方法,可以在大型无奖励轨迹数据集上预训练通用策略,类似于用于训练计算机视觉和自然语言处理基础模型的自监督目标。然而,由于稀疏奖励和折扣的结合,使得原始动作相对于遥远目标的比较优势变得模糊,因此将GCRL扩展到更长的horizon仍然具有挑战性。分层强化学习方法在长horizon目标到达任务上取得了强大的经验结果,但它们对模块化、特定时间尺度的策略和子目标生成的依赖引入了显著的额外复杂性,并阻碍了扩展到高维目标空间。在这项工作中,我们引入了一种算法,通过在子目标条件策略上使用优势加权重要性采样进行引导,来训练扁平(非分层)目标条件策略。我们的方法消除了对(子)目标空间上的生成模型的需求,我们发现这是扩展到大型状态空间中的高维控制的关键。我们进一步表明,现有的分层和基于引导的方法对应于我们推导中的特定设计选择。在全面的基于状态和像素的运动和操作基准测试中,我们的方法与最先进的离线GCRL算法相匹配或超过,并扩展到复杂的、长horizon任务,而先前的方法失败。

🔬 方法详解

问题定义:论文旨在解决离线目标条件强化学习(GCRL)中,由于稀疏奖励和折扣因子导致的长程任务学习困难问题。现有分层强化学习方法虽然在长程任务上表现良好,但其模块化策略和子目标生成过程引入了额外的复杂性,难以扩展到高维目标空间。

核心思路:论文的核心思路是通过策略引导(Policy Bootstrapping)的方式,训练一个扁平的(非分层)目标条件策略。该方法利用子目标条件策略的信息,通过优势加权重要性采样,引导目标条件策略的学习,从而避免了显式地生成子目标或构建分层结构。

技术框架:该方法主要包含以下几个阶段:1) 离线数据集收集:收集包含状态、动作和目标信息的轨迹数据。2) 子目标条件策略训练:训练多个子目标条件策略,每个策略负责到达特定的子目标。3) 目标条件策略训练:使用优势加权重要性采样,利用子目标条件策略的信息,引导目标条件策略的学习。目标条件策略直接学习从当前状态到达最终目标的最优动作。

关键创新:该方法最重要的创新在于避免了对子目标空间的生成模型的需求。传统分层强化学习方法需要显式地生成子目标,而该方法通过策略引导的方式,隐式地利用子目标信息,从而简化了学习过程,并更容易扩展到高维目标空间。此外,论文还证明了现有的分层和基于引导的方法可以视为该方法框架下的特定设计选择。

关键设计:关键设计包括:1) 优势函数估计:使用合适的优势函数估计方法,评估子目标条件策略的优劣。2) 重要性采样权重计算:根据优势函数值,计算重要性采样权重,用于加权子目标条件策略的动作。3) 损失函数设计:设计合适的损失函数,用于训练目标条件策略,例如,可以使用行为克隆损失或策略梯度损失。

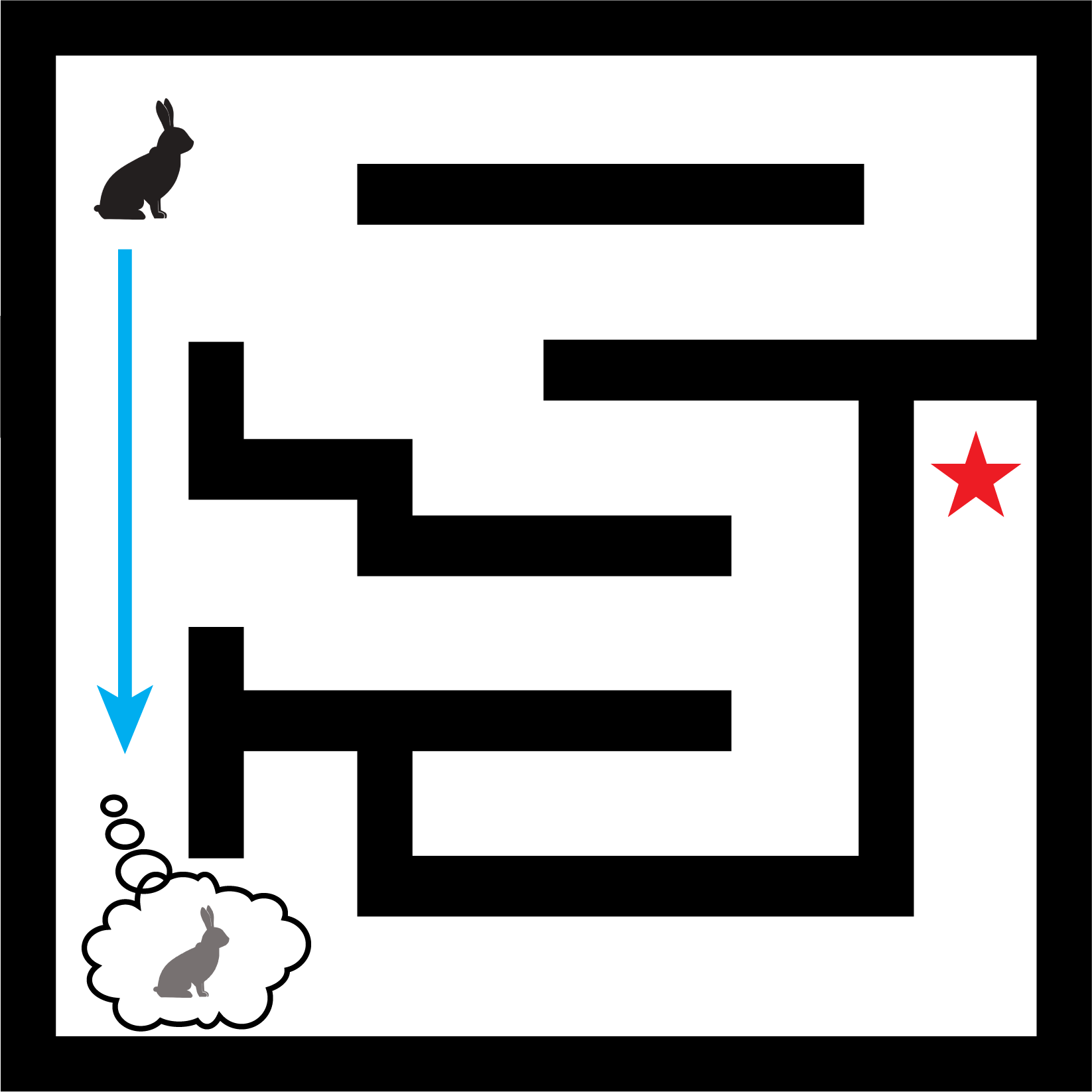

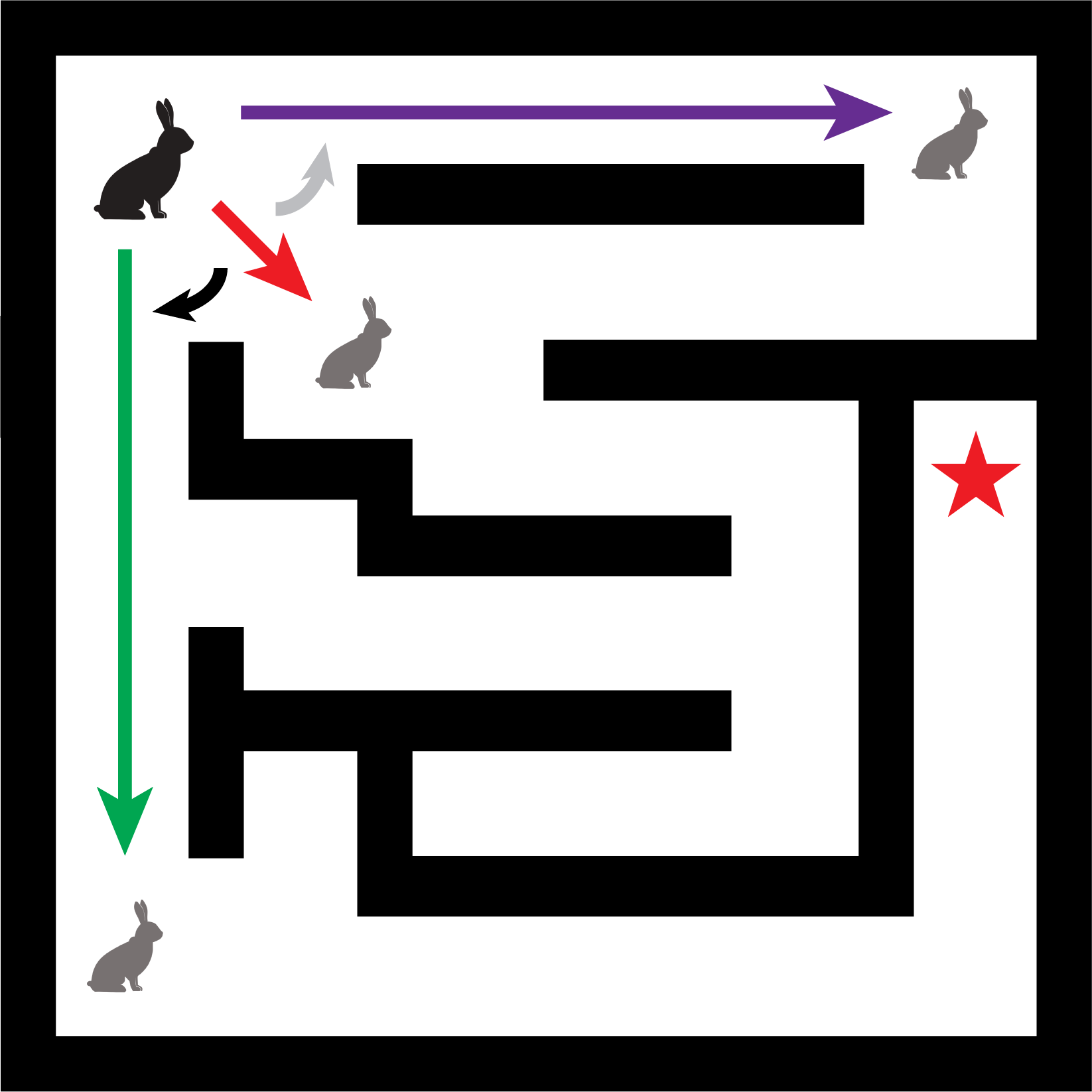

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在多个基于状态和像素的运动和操作基准测试中,与最先进的离线GCRL算法相匹配或超过,并且能够扩展到先前方法无法处理的复杂长程任务。具体而言,在某些任务上,该方法取得了显著的性能提升,例如成功率提高了10%-20%。

🎯 应用场景

该研究成果可应用于机器人操作、自动驾驶、游戏AI等领域。例如,可以利用该方法训练机器人完成复杂的装配任务,或者训练自动驾驶汽车在复杂环境中安全行驶。该方法通过离线学习的方式,降低了在线探索的成本,具有很高的实际应用价值。

📄 摘要(原文)

Offline goal-conditioned reinforcement learning (GCRL) is a promising approach for pretraining generalist policies on large datasets of reward-free trajectories, akin to the self-supervised objectives used to train foundation models for computer vision and natural language processing. However, scaling GCRL to longer horizons remains challenging due to the combination of sparse rewards and discounting, which obscures the comparative advantages of primitive actions with respect to distant goals. Hierarchical RL methods achieve strong empirical results on long-horizon goal-reaching tasks, but their reliance on modular, timescale-specific policies and subgoal generation introduces significant additional complexity and hinders scaling to high-dimensional goal spaces. In this work, we introduce an algorithm to train a flat (non-hierarchical) goal-conditioned policy by bootstrapping on subgoal-conditioned policies with advantage-weighted importance sampling. Our approach eliminates the need for a generative model over the (sub)goal space, which we find is key for scaling to high-dimensional control in large state spaces. We further show that existing hierarchical and bootstrapping-based approaches correspond to specific design choices within our derivation. Across a comprehensive suite of state- and pixel-based locomotion and manipulation benchmarks, our method matches or surpasses state-of-the-art offline GCRL algorithms and scales to complex, long-horizon tasks where prior approaches fail. Project page: https://johnlyzhou.github.io/saw/