LLINBO: Trustworthy LLM-in-the-Loop Bayesian Optimization

作者: Chih-Yu Chang, Milad Azvar, Chinedum Okwudire, Raed Al Kontar

分类: cs.LG, cs.AI

发布日期: 2025-05-20 (更新: 2025-10-09)

🔗 代码/项目: GITHUB

💡 一句话要点

提出LLINBO,结合LLM与统计模型,提升黑盒优化中的探索与利用平衡。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 贝叶斯优化 大型语言模型 黑盒优化 探索与利用 3D打印

📋 核心要点

- 现有黑盒优化方法在低数据场景下表现不佳,而直接使用LLM进行优化缺乏理论保证和可控性。

- LLINBO框架结合LLM的上下文推理能力和统计模型的精确性,实现探索与利用的有效平衡。

- 论文提出了三种机制来实现LLM与统计模型的协作,并提供了理论保证,并在3D打印领域进行了概念验证。

📝 摘要(中文)

贝叶斯优化(BO)是一种序列决策工具,广泛用于优化代价高昂的黑盒函数。最近,大型语言模型(LLM)在低数据状态下表现出卓越的适应性,通过利用上下文知识来提出高质量的查询点,使其成为黑盒优化的有前途的工具。然而,仅仅依靠LLM作为优化代理会带来风险,因为它们缺乏显式的代理建模和校准的不确定性,以及其固有的不透明的内部机制。这种结构上的不透明性使得难以描述或控制探索-利用的权衡,最终破坏了理论的可追踪性和可靠性。为了解决这个问题,我们提出了LLINBO:LLM-in-the-Loop BO,一种用于BO的混合框架,它将LLM与统计代理专家(例如,高斯过程(GP))结合起来。其核心理念是利用LLM的上下文推理优势进行早期探索,同时依靠有原则的统计模型来指导有效的利用。具体来说,我们引入了三种机制来实现这种协作,并建立了它们的理论保证。最后,我们在3D打印的背景下提供了一个真实的初步概念验证。代码可在https://github.com/UMDataScienceLab/LLM-in-the-Loop-BO找到。

🔬 方法详解

问题定义:论文旨在解决黑盒优化问题,尤其是在数据量有限的情况下。现有方法,如单纯的贝叶斯优化,在早期探索阶段效率较低。直接使用LLM进行优化虽然有潜力,但由于其不透明性和缺乏明确的概率建模,导致优化过程不可靠,难以控制探索-利用的平衡。

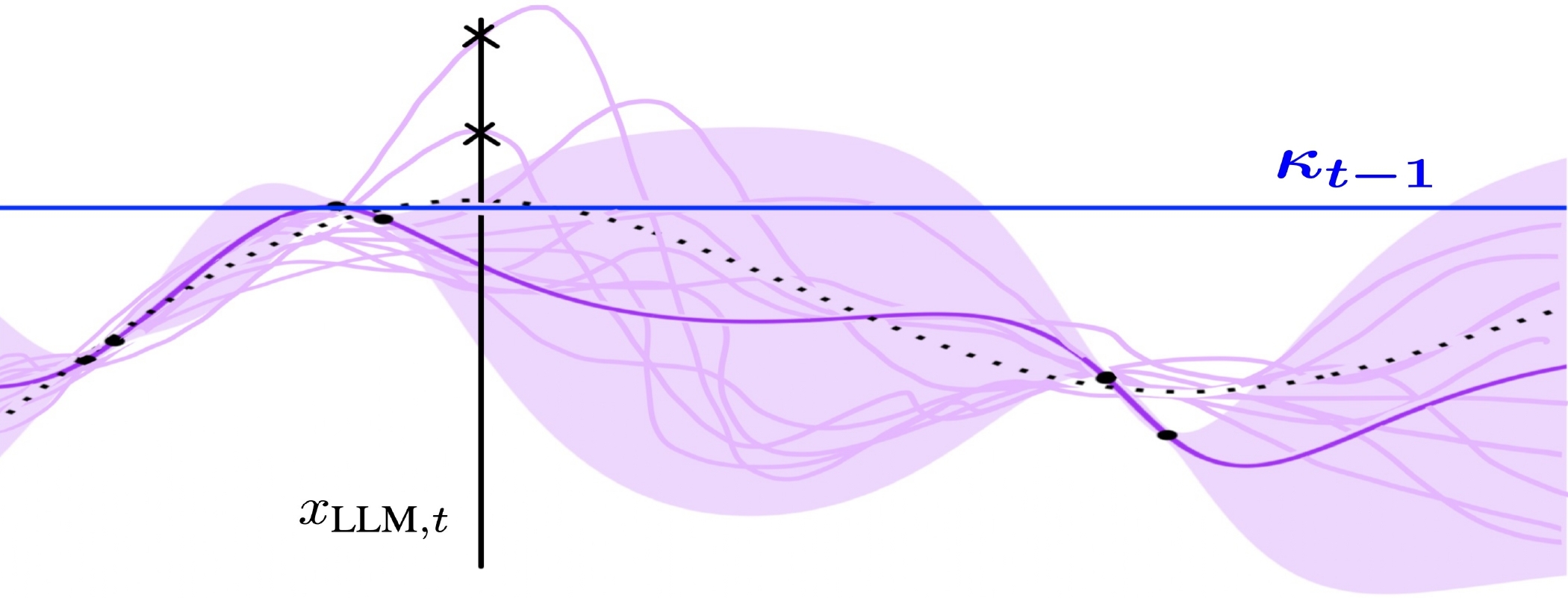

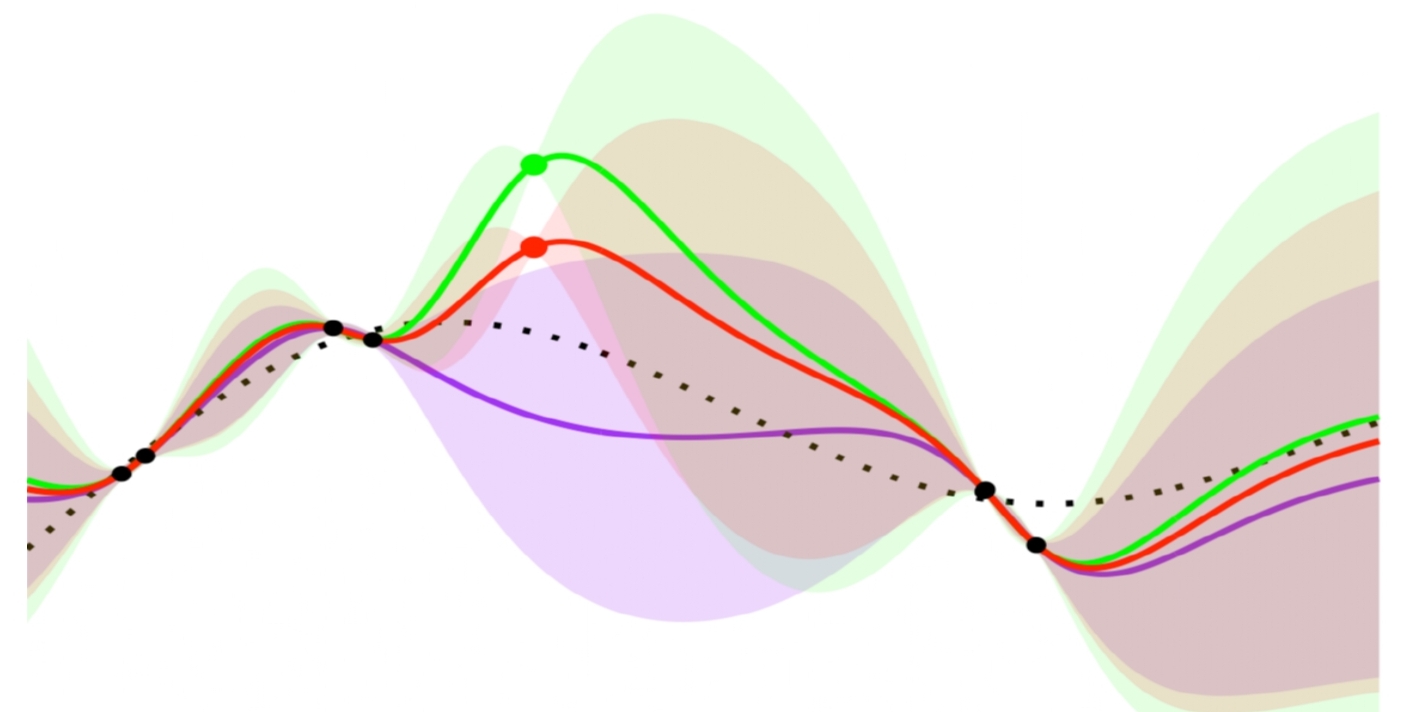

核心思路:LLINBO的核心思路是将LLM的上下文推理能力与传统统计代理模型的精确性相结合。LLM擅长利用上下文信息进行早期探索,快速找到有潜力的区域;而统计模型(如高斯过程)则擅长在已知区域进行精确的利用,提供可靠的不确定性估计。通过二者的协同工作,可以更有效地进行黑盒优化。

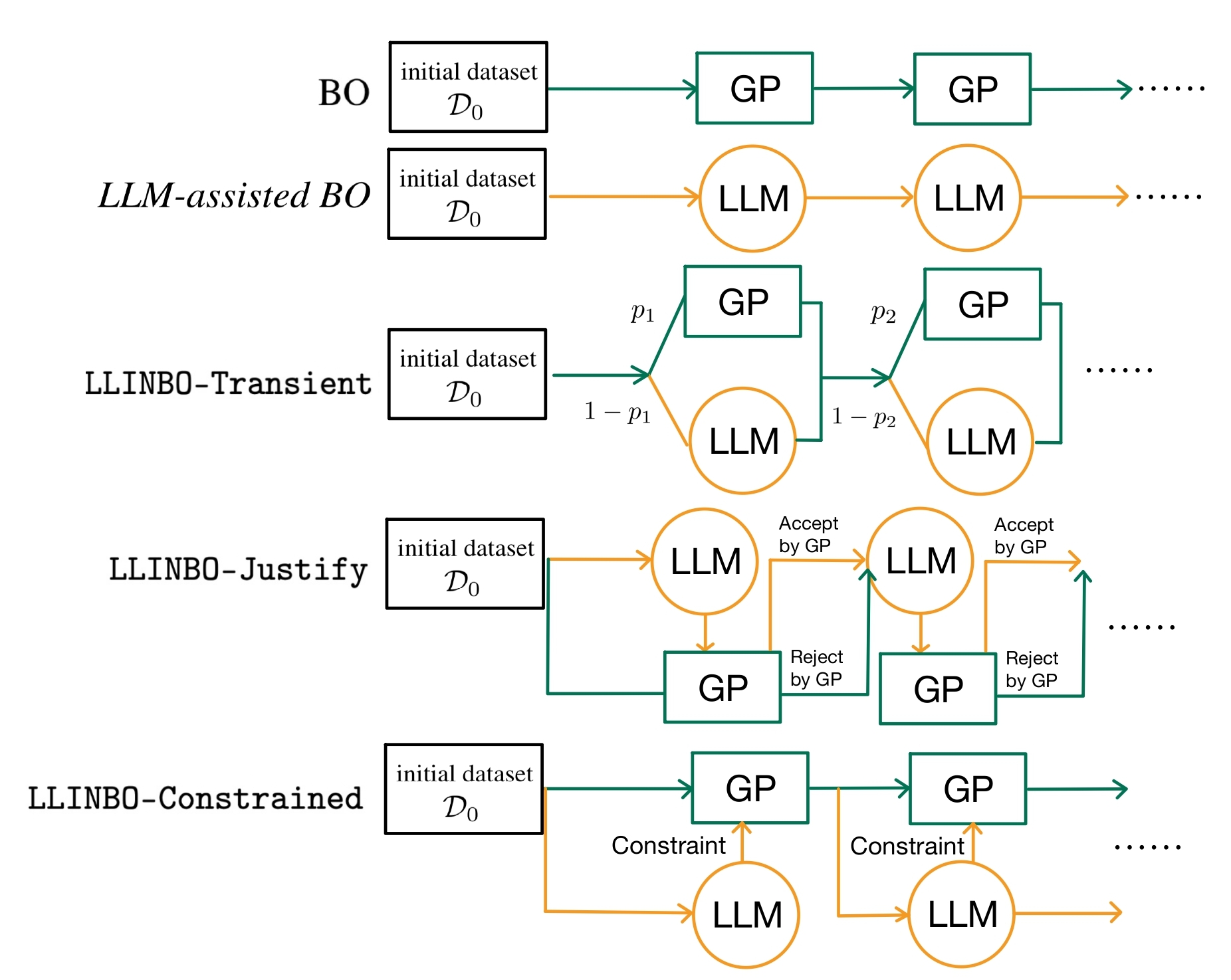

技术框架:LLINBO框架包含以下主要模块:1) LLM驱动的探索阶段:利用LLM生成候选查询点,利用上下文信息指导探索方向。2) 统计代理模型驱动的利用阶段:使用高斯过程等统计模型对目标函数进行建模,并利用采集函数(如UCB或EI)选择下一个查询点。3) 协作机制:论文提出了三种机制来实现LLM和统计模型的协作,具体细节未知。整体流程是先由LLM进行初步探索,然后由统计模型进行精确利用,两者交替进行,直至达到优化目标。

关键创新:LLINBO的关键创新在于将LLM的上下文推理能力融入到贝叶斯优化框架中,并设计了协作机制,使得LLM和统计模型能够优势互补,共同完成优化任务。与传统的贝叶斯优化方法相比,LLINBO能够更有效地利用上下文信息,加速早期探索。与直接使用LLM进行优化相比,LLINBO具有更好的可解释性和可靠性,因为统计模型提供了明确的概率建模和不确定性估计。

关键设计:论文中关于三种协作机制的具体设计细节未知。可能涉及的关键参数包括:LLM的prompt设计、统计模型的选择和参数设置、探索和利用阶段的切换策略、以及如何融合LLM的输出和统计模型的预测等。损失函数的设计可能涉及到最大化目标函数的同时,最小化LLM和统计模型之间的差异,以保证二者的一致性。

🖼️ 关键图片

📊 实验亮点

论文在3D打印领域进行了概念验证,但具体的性能数据和对比基线未知。实验结果表明,LLINBO能够有效地优化3D打印参数,验证了该框架的有效性和可行性。未来的研究可以进一步探索LLINBO在其他领域的应用,并与其他优化算法进行更全面的比较。

🎯 应用场景

LLINBO具有广泛的应用前景,例如材料设计、药物发现、超参数优化、机器人控制等。在这些领域,目标函数通常是黑盒的,且评估成本很高。LLINBO能够利用LLM的上下文推理能力,加速优化过程,降低实验成本,并提高优化结果的质量。尤其是在3D打印领域,LLINBO可以用于优化打印参数,提高打印质量和效率。

📄 摘要(原文)

Bayesian optimization (BO) is a sequential decision-making tool widely used for optimizing expensive black-box functions. Recently, Large Language Models (LLMs) have shown remarkable adaptability in low-data regimes, making them promising tools for black-box optimization by leveraging contextual knowledge to propose high-quality query points. However, relying solely on LLMs as optimization agents introduces risks due to their lack of explicit surrogate modeling and calibrated uncertainty, as well as their inherently opaque internal mechanisms. This structural opacity makes it difficult to characterize or control the exploration-exploitation trade-off, ultimately undermining theoretical tractability and reliability. To address this, we propose LLINBO: LLM-in-the-Loop BO, a hybrid framework for BO that combines LLMs with statistical surrogate experts (e.g., Gaussian Processes (GP)). The core philosophy is to leverage contextual reasoning strengths of LLMs for early exploration, while relying on principled statistical models to guide efficient exploitation. Specifically, we introduce three mechanisms that enable this collaboration and establish their theoretical guarantees. We end the paper with a real-life proof-of-concept in the context of 3D printing. The code to reproduce the results can be found at https://github.com/UMDataScienceLab/LLM-in-the-Loop-BO.