Breaking the Compression Ceiling: Data-Free Pipeline for Ultra-Efficient Delta Compression

作者: Xiaohui Wang, Peng Ye, Chenyu Huang, Shenghe Zheng, Bo Zhang, Lei Bai, Wanli Ouyang, Tao Chen

分类: cs.LG, cs.AI, cs.CV

发布日期: 2025-05-19 (更新: 2025-10-13)

备注: Accepted at NeurIPS 2025

🔗 代码/项目: GITHUB

💡 一句话要点

UltraDelta:首个数据无关的超高效Delta压缩方案,突破压缩上限。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Delta压缩 模型压缩 数据无关 稀疏度分配 量化 模型优化 超高压缩率

📋 核心要点

- 现有Delta压缩方法在保持高压缩率和高性能方面存在不足,且通常依赖于数据,限制了其应用。

- UltraDelta通过方差指导的稀疏度分配、分布感知压缩和迹范数引导的重缩放,实现了数据无关的超高效Delta压缩。

- 实验表明,UltraDelta在多种模型上实现了显著的压缩率提升,同时保持了良好的性能,优于现有方法。

📝 摘要(中文)

随着微调-预训练范式的兴起,存储大量用于多任务的微调模型产生了巨大的存储开销。Delta压缩通过仅存储预训练模型和高度压缩的delta权重(微调模型和预训练模型权重之间的差异)来缓解这个问题。然而,现有的方法无法同时保持高压缩率和高性能,并且通常依赖于数据。为了解决这些挑战,我们提出了UltraDelta,这是第一个数据无关的delta压缩流程,它实现了超高压缩率和强大的性能。UltraDelta旨在通过三个关键组件来最小化冗余,最大化信息,并稳定跨层、层内和全局维度的性能:(1)基于方差的混合稀疏度分配,根据方差分配稀疏度,为高方差层分配较低的稀疏度,以保留层间信息。(2)分布感知压缩,应用均匀量化,然后按值对参数进行分组,然后进行分组修剪,以更好地保留层内分布。(3)迹范数引导的重缩放,使用delta权重的迹范数来估计全局重缩放因子,从而提高模型在更高压缩率下的稳定性。在(a)大型语言模型(在LLaMA-2 7B和13B上进行微调)高达50倍压缩,(b)通用NLP模型(RoBERTa-base,T5-base)高达224倍压缩,(c)视觉模型(ViT-B/32,ViT-L/14)高达132倍压缩,以及(d)多模态模型(BEiT-3)高达18倍压缩的广泛实验表明,UltraDelta始终优于现有方法,尤其是在超高压缩率下。

🔬 方法详解

问题定义:论文旨在解决微调模型存储开销大的问题,现有Delta压缩方法在超高压缩率下性能下降明显,且依赖数据进行压缩,限制了其通用性。因此,需要一种数据无关且能实现超高压缩率的Delta压缩方案。

核心思路:UltraDelta的核心思路是通过最小化冗余、最大化信息和稳定模型性能来实现超高效的Delta压缩。它从层间、层内和全局三个维度出发,分别设计了相应的策略来优化压缩过程,并且避免使用任何训练数据。

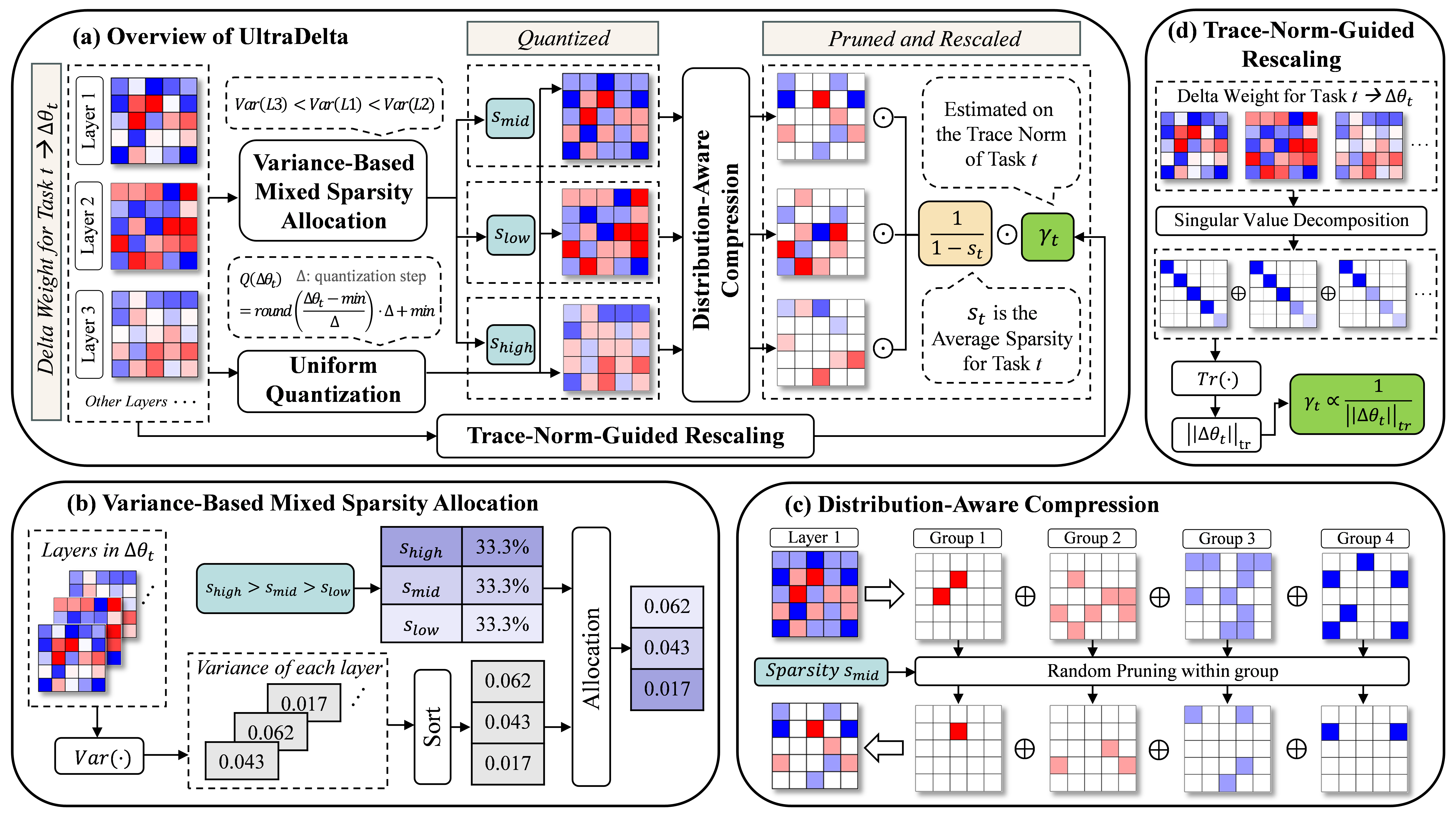

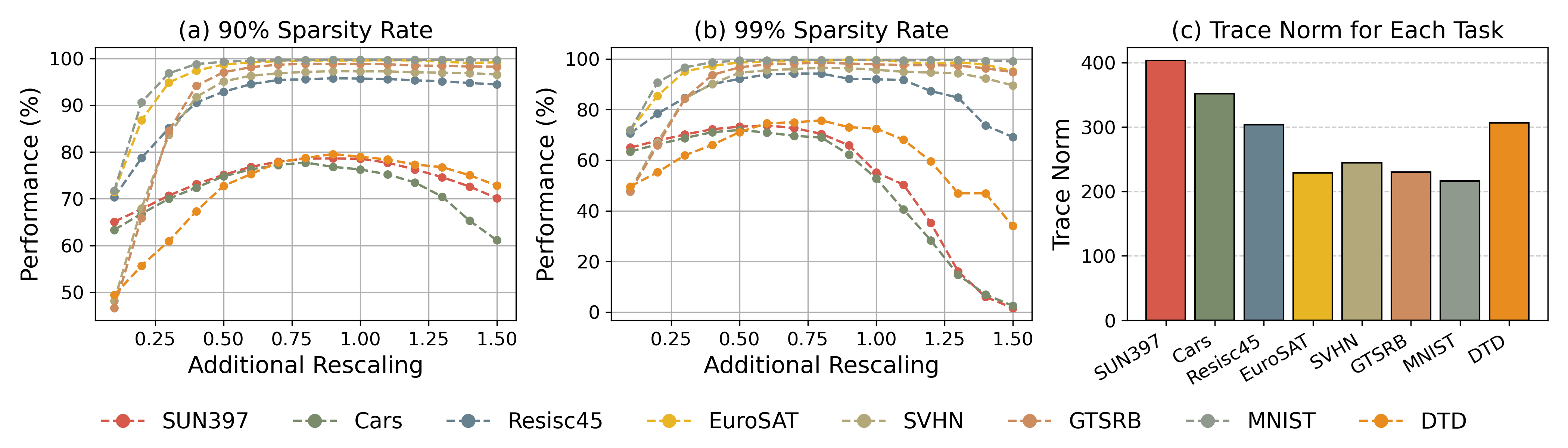

技术框架:UltraDelta包含三个主要模块:1) 基于方差的混合稀疏度分配:根据层权重的方差动态调整稀疏度,方差大的层分配较低的稀疏度,保留更多信息。2) 分布感知压缩:对权重进行均匀量化,然后按值分组,并对组进行剪枝,以保留层内权重分布。3) 迹范数引导的重缩放:利用Delta权重的迹范数估计全局重缩放因子,稳定高压缩率下的模型性能。

关键创新:UltraDelta的关键创新在于其数据无关性以及在层间、层内和全局三个维度上对压缩过程的优化。与现有方法相比,UltraDelta无需任何训练数据,并且通过精细化的稀疏度分配、分布感知压缩和全局重缩放,实现了更高的压缩率和更好的性能。

关键设计:1) 方差计算:使用层权重的方差作为稀疏度分配的依据。2) 均匀量化:对权重进行均匀量化,降低存储空间。3) 分组剪枝:根据量化后的权重值进行分组,并对组进行剪枝,保留重要信息。4) 迹范数估计:使用Delta权重的迹范数估计全局重缩放因子,稳定模型性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,UltraDelta在大型语言模型(LLaMA-2 7B/13B)上实现了高达50倍的压缩,在通用NLP模型(RoBERTa-base, T5-base)上实现了高达224倍的压缩,在视觉模型(ViT-B/32, ViT-L/14)上实现了高达132倍的压缩,在多模态模型(BEiT-3)上实现了18倍的压缩,并且在各种压缩率下均优于现有方法。

🎯 应用场景

UltraDelta可广泛应用于需要存储大量微调模型的场景,例如多任务学习、个性化模型部署等。它可以显著降低存储成本,提高模型部署效率,并促进边缘计算和移动设备上的模型应用。该技术还有潜力应用于模型压缩的其他领域,例如知识蒸馏和模型量化。

📄 摘要(原文)

With the rise of the fine-tuned-pretrained paradigm, storing numerous fine-tuned models for multi-tasking creates significant storage overhead. Delta compression alleviates this by storing only the pretrained model and the highly compressed delta weights (the differences between fine-tuned and pretrained model weights). However, existing methods fail to maintain both high compression and performance, and often rely on data. To address these challenges, we propose UltraDelta, the first data-free delta compression pipeline that achieves both ultra-high compression and strong performance. UltraDelta is designed to minimize redundancy, maximize information, and stabilize performance across inter-layer, intra-layer, and global dimensions, using three key components: (1) Variance-Based Mixed Sparsity Allocation assigns sparsity based on variance, giving lower sparsity to high-variance layers to preserve inter-layer information. (2) Distribution-Aware Compression applies uniform quantization and then groups parameters by value, followed by group-wise pruning, to better preserve intra-layer distribution. (3) Trace-Norm-Guided Rescaling uses the trace norm of delta weights to estimate a global rescaling factor, improving model stability under higher compression. Extensive experiments across (a) large language models (fine-tuned on LLaMA-2 7B and 13B) with up to 50x compression, (b) general NLP models (RoBERTa-base, T5-base) with up to 224x compression, (c) vision models (ViT-B/32, ViT-L/14) with up to 132x compression, and (d) multi-modal models (BEiT-3) with 18x compression, demonstrate that UltraDelta consistently outperforms existing methods, especially under ultra-high compression. Code is available at https://github.com/xiaohuiwang000/UltraDelta.