Injecting Knowledge Graphs into Large Language Models

作者: Erica Coppolillo

分类: cs.LG, cs.IR

发布日期: 2025-05-12

💡 一句话要点

提出一种将知识图谱注入大语言模型的方法,提升符号推理能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识图谱 大语言模型 知识图谱嵌入 符号推理 图神经网络 自然语言处理 模型融合

📋 核心要点

- 现有方法在将知识图谱融入大语言模型时,面临结构信息丢失和计算成本过高的挑战。

- 该论文提出一种新方法,利用知识图谱嵌入模型,将图结构信息以token形式注入大语言模型。

- 实验结果表明,该方法在推理性能上优于现有基线,并在准确性和效率之间取得了更好的平衡。

📝 摘要(中文)

将知识图谱(KG)中的结构化知识整合到大型语言模型(LLM)中,仍然是符号推理的一个关键挑战。现有方法主要依赖于提示工程或微调,这会损失结构保真度或产生高昂的计算成本。本文基于最近的编码技术,该技术将图嵌入作为token集成到LLM输入中,通过利用知识图谱嵌入(KGE)模型,将这种范式扩展到KG领域,从而实现图感知的推理。我们的方法是模型无关的、资源高效的,并且与任何LLM兼容。在合成和真实世界数据集上的大量实验表明,我们的方法改进了相对于已建立基线的推理性能,并在准确性和效率方面实现了优于最先进LLM的最佳权衡。

🔬 方法详解

问题定义:现有方法在将知识图谱融入大语言模型时,主要依赖于prompt工程或fine-tuning。Prompt工程可能无法充分利用知识图谱的结构信息,而fine-tuning则需要大量的计算资源和数据,并且可能导致过拟合。因此,如何高效且保真地将知识图谱的结构化知识注入到大语言模型中,是一个亟待解决的问题。

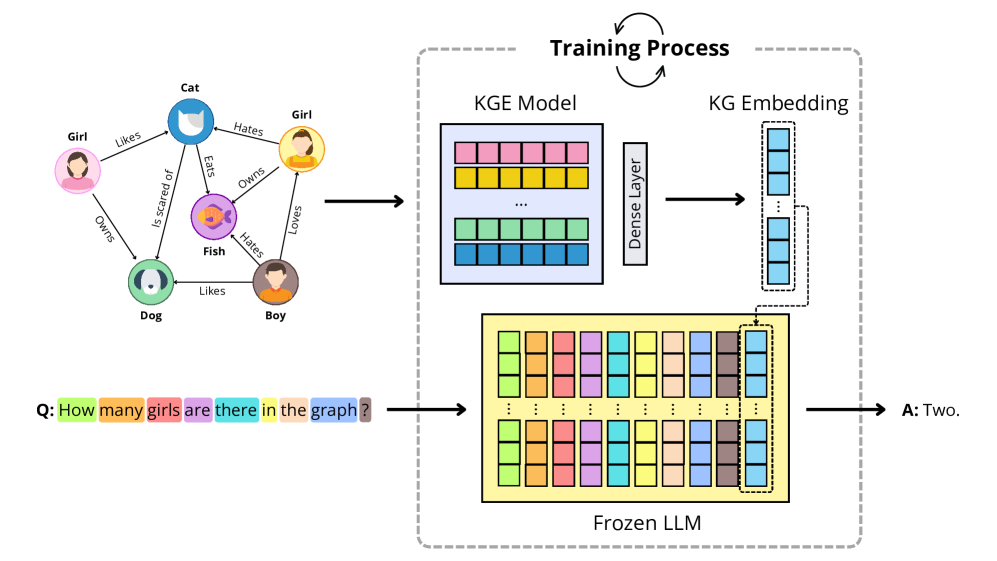

核心思路:该论文的核心思路是将知识图谱嵌入(KGE)模型与大语言模型相结合。具体来说,首先使用KGE模型学习知识图谱中实体和关系的嵌入表示,然后将这些嵌入表示作为token注入到大语言模型的输入中。这样,大语言模型就可以利用这些嵌入表示来感知知识图谱的结构信息,从而提升推理能力。

技术框架:该方法主要包含两个阶段:知识图谱嵌入阶段和语言模型推理阶段。在知识图谱嵌入阶段,使用KGE模型(如TransE、ComplEx等)学习知识图谱中实体和关系的嵌入表示。在语言模型推理阶段,将查询语句和相关的知识图谱嵌入表示作为输入,输入到大语言模型中进行推理。大语言模型可以利用这些嵌入表示来感知知识图谱的结构信息,从而生成更准确的答案。

关键创新:该方法最重要的创新点在于将知识图谱嵌入表示作为token注入到大语言模型的输入中。这种方法可以有效地将知识图谱的结构信息传递给大语言模型,而无需对大语言模型进行fine-tuning。此外,该方法是模型无关的,可以与任何大语言模型和KGE模型相结合。

关键设计:该方法的关键设计包括:选择合适的KGE模型,选择合适的嵌入维度,以及如何将嵌入表示与查询语句进行拼接。论文中没有明确说明具体的参数设置、损失函数或网络结构,这些细节可能取决于所使用的大语言模型和KGE模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在合成和真实世界数据集上均取得了显著的性能提升。与现有基线方法相比,该方法在推理准确性方面取得了明显的优势,并在准确性和效率之间实现了更好的权衡。具体性能数据和提升幅度在论文中进行了详细的展示和分析,证明了该方法的有效性。

🎯 应用场景

该研究成果可广泛应用于需要知识图谱支持的自然语言处理任务,例如问答系统、知识图谱补全、推荐系统等。通过将知识图谱注入大语言模型,可以提升这些任务的性能和准确性,并为构建更智能的AI系统奠定基础。未来,该方法有望应用于医疗、金融等领域,辅助决策和知识发现。

📄 摘要(原文)

Integrating structured knowledge from Knowledge Graphs (KGs) into Large Language Models (LLMs) remains a key challenge for symbolic reasoning. Existing methods mainly rely on prompt engineering or fine-tuning, which lose structural fidelity or incur high computational costs. Building on recent encoding techniques which integrate graph embeddings within the LLM input as tokens, we extend this paradigm to the KG domain by leveraging Knowledge Graph Embedding (KGE) models, thus enabling graph-aware reasoning. Our approach is model-agnostic, resource-efficient, and compatible with any LLMs. Extensive experimentation on synthetic and real-world datasets shows that our method improves reasoning performance over established baselines, further achieving the best trade-off in terms of accuracy and efficiency against state-of-the-art LLMs.