Ergodic Generative Flows

作者: Leo Maxime Brunswic, Mateo Clemente, Rui Heng Yang, Adam Sigal, Amir Rasouli, Yinchuan Li

分类: cs.LG, cs.AI, math.DG, math.DS

发布日期: 2025-05-06

备注: 20 pages, 5 figures, 1 table, accepted at ICML 2025

💡 一句话要点

提出遍历生成流(EGFs)以解决生成流网络在连续环境和模仿学习中的训练难题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 生成流网络 遍历性 模仿学习 强化学习 流匹配损失 KL-weakFM损失 连续状态空间 微分同胚

📋 核心要点

- 现有生成流网络在连续环境和模仿学习中训练困难,存在流匹配损失难处理、非循环训练测试不足等问题。

- 论文提出遍历生成流(EGFs),利用遍历性构建具有全局定义变换的简单生成流,保证通用性并简化流匹配损失。

- 通过KL-weakFM损失,EGFs在模仿学习中无需单独的奖励模型即可训练,并在2D任务和NASA数据集上验证有效性。

📝 摘要(中文)

生成流网络(GFNs)最初在有向无环图上引入,用于从非归一化分布密度中采样。最近的研究扩展了生成方法的理论框架,提高了灵活性并扩大了应用范围。然而,在连续环境中以及模仿学习(IL)中训练GFNs仍然面临许多挑战,包括流匹配损失的难处理性、非循环训练的有限测试以及模仿学习中对单独奖励模型的需要。本研究提出了一系列称为遍历生成流(EGFs)的生成流,用于解决上述问题。首先,我们利用遍历性构建简单的生成流,该生成流具有有限多个全局定义的变换(微分同胚),具有通用性保证和易于处理的流匹配损失(FM损失)。其次,我们引入了一种新的损失,涉及交叉熵和弱流匹配控制,称为KL-weakFM损失。它专为无需单独奖励模型的IL训练而设计。我们使用KL-weakFM损失在球体上对来自NASA的玩具2D任务和真实世界数据集评估了IL-EGFs。此外,我们使用FM损失进行了具有目标奖励的玩具2D强化学习实验。

🔬 方法详解

问题定义:现有的生成流网络(GFNs)在连续状态空间和模仿学习(IL)任务中面临训练难题。具体来说,流匹配损失(Flow-Matching Loss)的计算复杂度高,难以处理;对非循环图的训练研究不足;在模仿学习中,通常需要一个额外的奖励模型来指导训练,增加了复杂性。这些问题限制了GFNs在更广泛场景下的应用。

核心思路:论文的核心思路是利用遍历性(Ergodicity)来简化生成流的设计和训练。遍历性保证了系统在长时间内会访问所有可能的状态,因此可以使用有限数量的全局变换(微分同胚)来构建生成流。这种设计简化了流匹配损失的计算,并允许在没有显式奖励模型的情况下进行模仿学习。

技术框架:EGFs的整体框架包含以下几个关键部分:1) 使用有限数量的全局定义的微分同胚来构建生成流。2) 利用遍历性保证生成流的完备性。3) 引入两种损失函数:标准的流匹配损失(FM loss)用于强化学习,以及一种新的KL-weakFM损失,用于模仿学习。KL-weakFM损失结合了交叉熵损失和弱流匹配控制,允许在没有显式奖励模型的情况下进行模仿学习。训练过程涉及优化这些损失函数,以学习生成流的参数。

关键创新:EGFs的关键创新在于利用遍历性简化了生成流的设计,并提出了KL-weakFM损失,从而实现了在没有显式奖励模型的情况下进行模仿学习。与传统的GFNs相比,EGFs具有更简单的结构和更易于处理的损失函数,同时保持了良好的生成性能。

关键设计:EGFs的关键设计包括:1) 使用有限数量的全局微分同胚,例如仿射变换或神经网络定义的变换。2) KL-weakFM损失的设计,它包含两部分:交叉熵损失,用于模仿目标策略;弱流匹配控制,用于约束生成流的行为。KL-weakFM损失的具体形式为:L = CE(π(x), π_target(x)) + λ * FM_weak(π(x)),其中CE是交叉熵损失,π(x)是生成流的策略,π_target(x)是目标策略,FM_weak是弱流匹配损失,λ是平衡系数。

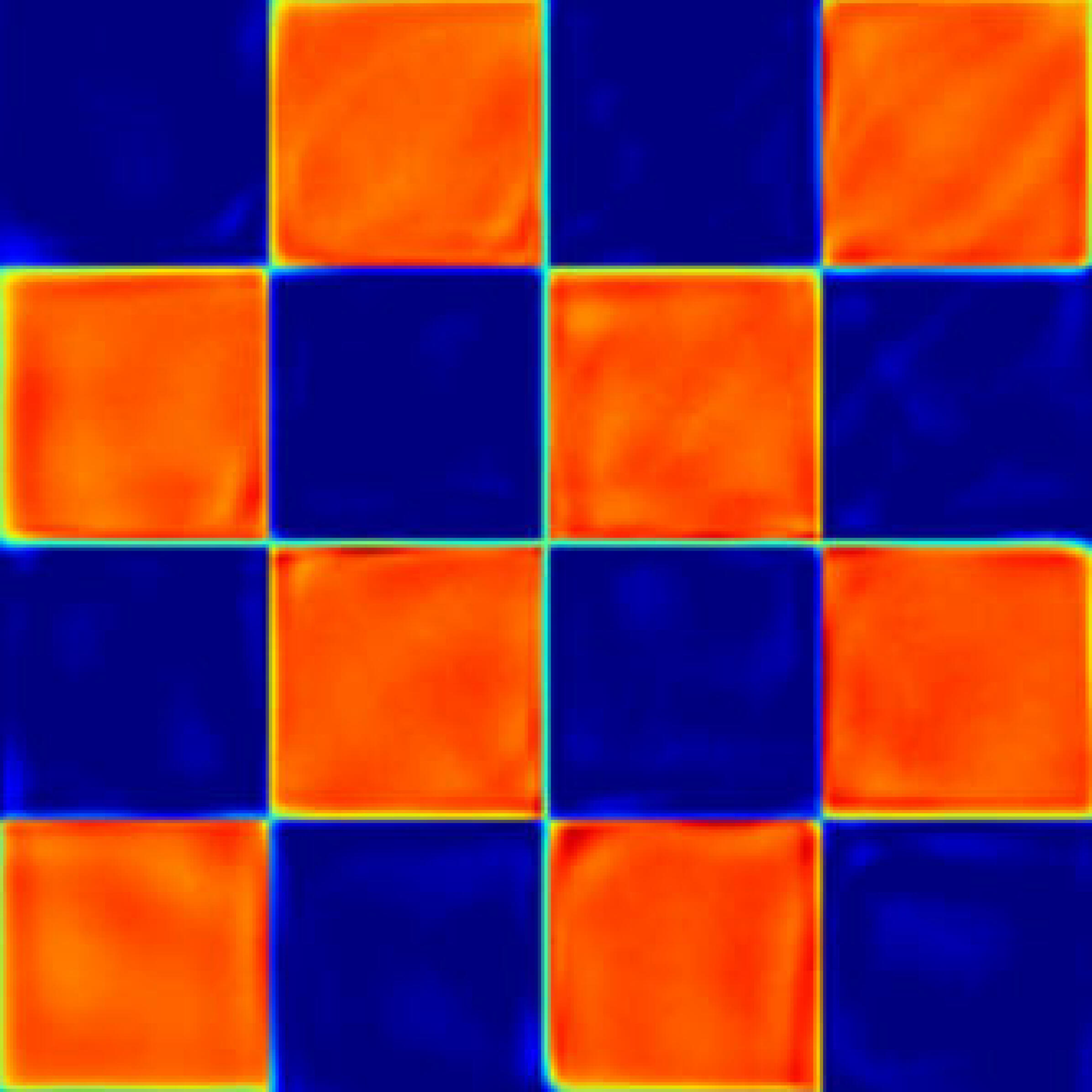

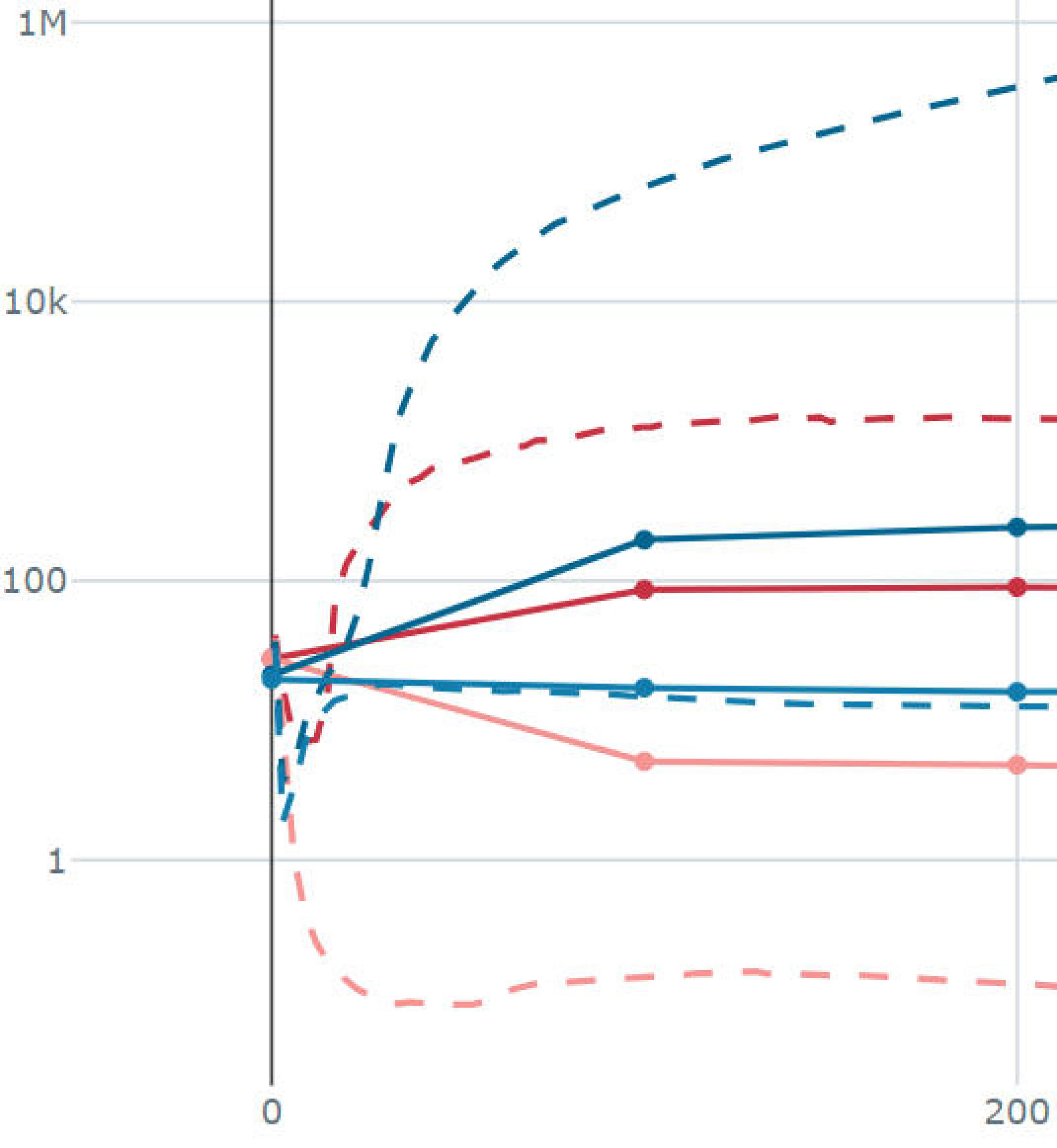

🖼️ 关键图片

📊 实验亮点

实验结果表明,EGFs在2D玩具任务和NASA数据集上均取得了良好的性能。在模仿学习任务中,使用KL-weakFM损失的EGFs能够有效地学习目标策略,而无需额外的奖励模型。在强化学习任务中,使用FM损失的EGFs能够有效地学习目标奖励函数。这些结果验证了EGFs的有效性和通用性。

🎯 应用场景

EGFs具有广泛的应用前景,包括但不限于:机器人运动规划、药物发现、分子生成、图像生成等。通过模仿学习,EGFs可以学习专家策略,从而在复杂环境中实现自主导航和控制。此外,EGFs还可以用于生成具有特定属性的分子结构,加速药物研发过程。该研究为生成模型的理论和应用提供了新的思路。

📄 摘要(原文)

Generative Flow Networks (GFNs) were initially introduced on directed acyclic graphs to sample from an unnormalized distribution density. Recent works have extended the theoretical framework for generative methods allowing more flexibility and enhancing application range. However, many challenges remain in training GFNs in continuous settings and for imitation learning (IL), including intractability of flow-matching loss, limited tests of non-acyclic training, and the need for a separate reward model in imitation learning. The present work proposes a family of generative flows called Ergodic Generative Flows (EGFs) which are used to address the aforementioned issues. First, we leverage ergodicity to build simple generative flows with finitely many globally defined transformations (diffeomorphisms) with universality guarantees and tractable flow-matching loss (FM loss). Second, we introduce a new loss involving cross-entropy coupled to weak flow-matching control, coined KL-weakFM loss. It is designed for IL training without a separate reward model. We evaluate IL-EGFs on toy 2D tasks and real-world datasets from NASA on the sphere, using the KL-weakFM loss. Additionally, we conduct toy 2D reinforcement learning experiments with a target reward, using the FM loss.