Learning Local Causal World Models with State Space Models and Attention

作者: Francesco Petri, Luigi Asprino, Aldo Gangemi

分类: cs.LG, stat.ML

发布日期: 2025-05-04

💡 一句话要点

利用状态空间模型和注意力机制学习局部因果世界模型

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 世界建模 因果发现 状态空间模型 注意力机制 序列建模

📋 核心要点

- 现有世界建模方法难以学习环境的因果表示,限制了智能体对世界的深入理解和复杂任务执行能力。

- 该论文探索使用状态空间模型(SSM)来学习局部因果世界模型,旨在同时建模环境动态和发现因果关系。

- 实验结果表明,与Transformer相比,SSM在建模简单环境动态和学习因果模型方面具有相当或更好的性能。

📝 摘要(中文)

世界建模,即构建一个表示世界运行规则并预测其演化的模型,是智能体与物理世界交互的关键能力。尽管现有方法表现出色,但许多方案未能学习到环境的因果表示,而这对于深入理解世界并执行复杂任务至关重要。本文旨在扩展因果理论和神经世界建模交叉领域的研究,评估状态空间模型(SSM)架构在因果发现方面的潜力,该架构已被证明比广泛使用的Transformer具有若干优势。实验表明,与等效的Transformer相比,SSM能够以相当或更好的性能对简单环境的动态进行建模,并同时学习因果模型,从而为进一步利用SSM的优势并进一步增强其因果意识的实验铺平了道路。

🔬 方法详解

问题定义:现有世界模型通常缺乏对环境因果关系的明确建模,导致智能体难以进行有效的推理和规划。Transformer虽然在序列建模上表现出色,但在因果发现方面存在局限性,难以准确捕捉环境中的因果依赖关系。因此,如何构建能够同时建模环境动态和学习因果关系的智能体是一个关键问题。

核心思路:该论文的核心思路是利用状态空间模型(SSM)的优势,结合注意力机制,构建一个能够学习局部因果世界模型的框架。SSM具有更强的序列建模能力和更清晰的状态表示,有助于捕捉环境中的因果关系。通过引入注意力机制,模型可以关注与当前状态相关的局部信息,从而更好地学习局部因果结构。

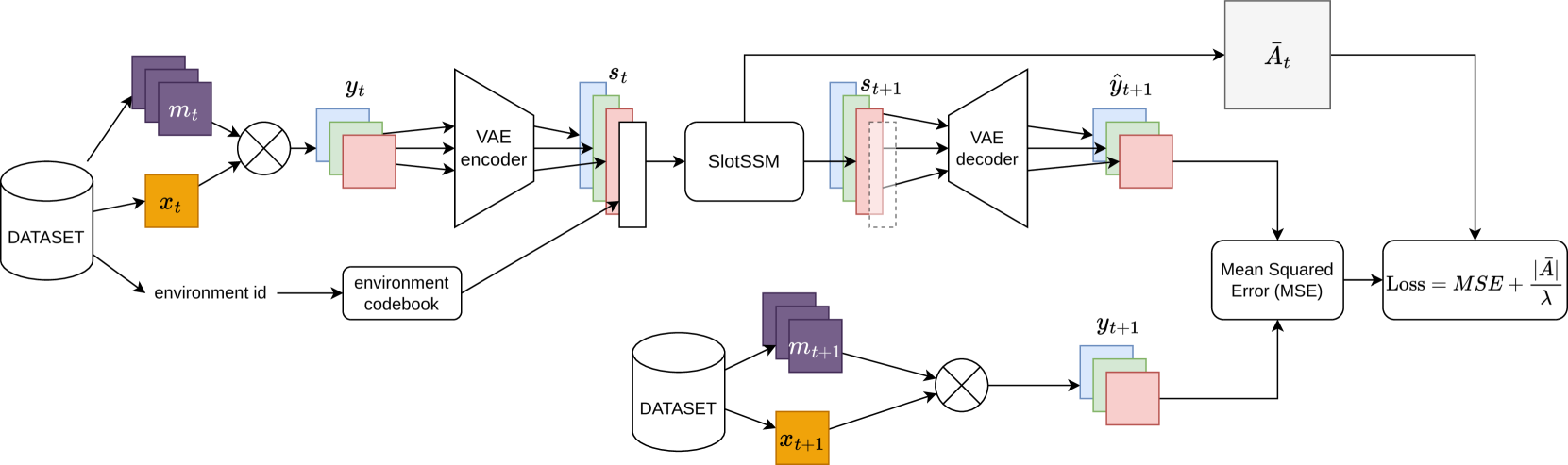

技术框架:该论文提出的技术框架主要包括以下几个模块:1) 观察编码器:将原始观察数据编码为潜在状态表示。2) 状态转移模型:使用SSM对潜在状态的动态进行建模,预测下一个状态。3) 注意力机制:用于关注与当前状态相关的局部信息,增强因果关系的学习。4) 解码器:将潜在状态解码为预测的观察数据。整个流程通过最小化预测误差来训练模型,同时鼓励模型学习具有因果意义的潜在状态表示。

关键创新:该论文的关键创新在于将状态空间模型(SSM)应用于因果世界建模,并结合注意力机制来增强局部因果关系的发现。与传统的Transformer相比,SSM具有更强的序列建模能力和更清晰的状态表示,更适合于学习环境中的因果依赖关系。此外,注意力机制的引入使得模型能够关注与当前状态相关的局部信息,从而更好地学习局部因果结构。

关键设计:论文中可能包含以下关键设计细节:状态转移模型采用的具体SSM结构(例如,线性或非线性SSM),注意力机制的具体实现方式(例如,自注意力或交叉注意力),损失函数的设计(例如,预测误差和因果一致性约束),以及超参数的设置等。这些细节将直接影响模型的性能和因果发现能力。具体参数设置未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,与等效的Transformer相比,SSM能够以相当或更好的性能对简单环境的动态进行建模,并同时学习因果模型。这表明SSM在因果世界建模方面具有潜力,为进一步研究和应用奠定了基础。具体的性能提升幅度未知。

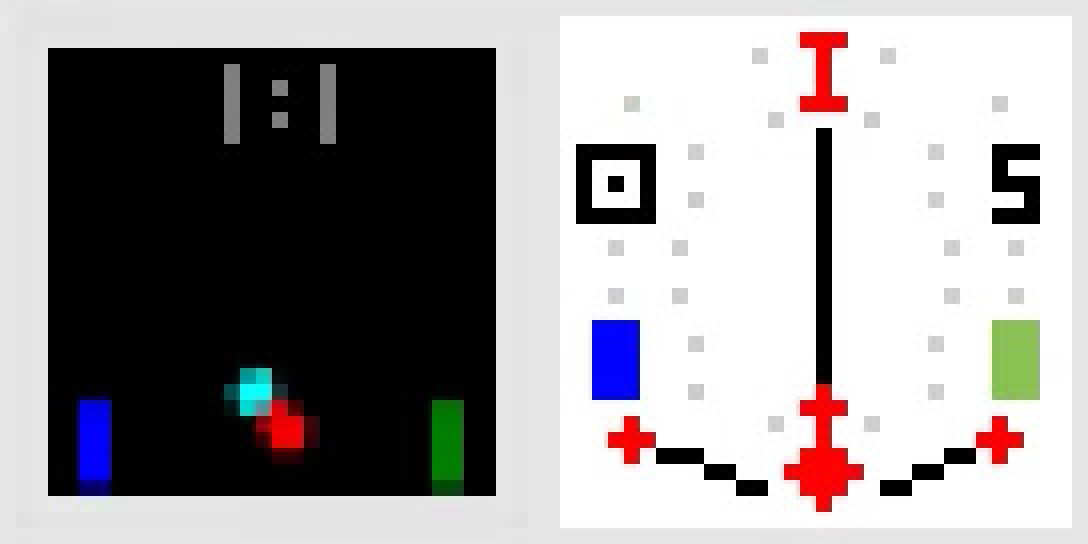

🎯 应用场景

该研究成果可应用于机器人导航、游戏AI、自动驾驶等领域。通过学习环境的因果模型,智能体可以更好地理解环境,进行有效的推理和规划,从而提高其在复杂环境中的适应性和决策能力。未来,该研究有望推动通用人工智能的发展,使智能体能够像人类一样理解和操纵世界。

📄 摘要(原文)

World modelling, i.e. building a representation of the rules that govern the world so as to predict its evolution, is an essential ability for any agent interacting with the physical world. Despite their impressive performance, many solutions fail to learn a causal representation of the environment they are trying to model, which would be necessary to gain a deep enough understanding of the world to perform complex tasks. With this work, we aim to broaden the research in the intersection of causality theory and neural world modelling by assessing the potential for causal discovery of the State Space Model (SSM) architecture, which has been shown to have several advantages over the widespread Transformer. We show empirically that, compared to an equivalent Transformer, a SSM can model the dynamics of a simple environment and learn a causal model at the same time with equivalent or better performance, thus paving the way for further experiments that lean into the strength of SSMs and further enhance them with causal awareness.