ABG-NAS: Adaptive Bayesian Genetic Neural Architecture Search for Graph Representation Learning

作者: Sixuan Wang, Jiao Yin, Jinli Cao, MingJian Tang, Hua Wang, Yanchun Zhang

分类: cs.LG, cs.NE

发布日期: 2025-04-30 (更新: 2025-09-23)

备注: Accepted by Knowledge-Based Systems (Elsevier), 2025. DOI: https://doi.org/10.1016/j.knosys.2025.114235

期刊: Knowledge-Based Systems, Volume 328, 25 October 2025, Article 114235 Knowledge-Based Systems, Volume 328, 25 October 2025, Article 114235 Knowledge-Based Systems, Volume 328, 25 October 2025, Article 114235

DOI: 10.1016/j.knosys.2025.114235

🔗 代码/项目: GITHUB

💡 一句话要点

提出ABG-NAS,用于自适应贝叶斯遗传图神经网络架构搜索,提升图表示学习效果。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 图神经网络 神经架构搜索 图表示学习 遗传算法 贝叶斯优化

📋 核心要点

- 现有GNN架构难以适应复杂图结构,限制了其生成结构感知和任务区分表示的能力。

- ABG-NAS通过综合搜索空间、自适应遗传优化和贝叶斯引导调优,自动搜索高效GNN架构。

- 在Cora等数据集上,ABG-NAS优于手动设计的GNN和现有NAS方法,提升了图表示学习效果。

📝 摘要(中文)

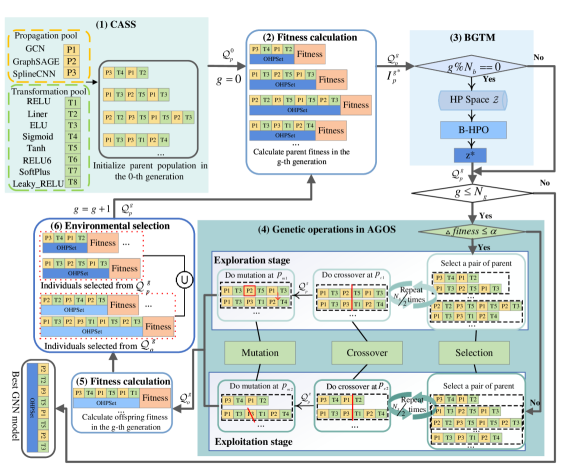

有效的图表示学习对于节点分类、链接预测和子图搜索等下游任务至关重要。然而,现有的图神经网络(GNN)架构难以适应多样且复杂的图结构,限制了其生成结构感知和任务区分表示的能力。为了解决这一挑战,我们提出了ABG-NAS,这是一个用于自动图神经网络架构搜索的新框架,专为高效的图表示学习而设计。ABG-NAS包含三个关键组件:全面的架构搜索空间(CASS)、自适应遗传优化策略(AGOS)和贝叶斯引导的调优模块(BGTM)。CASS系统地探索了多样化的传播(P)和转换(T)操作,从而能够发现能够捕获复杂图特征的GNN架构。AGOS动态地平衡了探索和利用,确保了搜索效率并保持了解的多样性。BGTM定期优化超参数,从而增强了所得架构的可扩展性和鲁棒性。在基准数据集(Cora、PubMed、Citeseer和CoraFull)上的实验评估表明,ABG-NAS始终优于手动设计的GNN和最先进的神经架构搜索(NAS)方法。这些结果突出了ABG-NAS通过为各种图结构提供可扩展和自适应的解决方案来推进图表示学习的潜力。我们的代码已在https://github.com/sserranw/ABG-NAS上公开。

🔬 方法详解

问题定义:论文旨在解决现有图神经网络在面对不同图结构时,难以自动设计出高效且具有良好泛化能力的GNN架构的问题。现有方法或者依赖人工设计,需要大量专家知识,或者使用计算成本高昂的搜索策略,难以适应大规模图数据。

核心思路:论文的核心思路是结合遗传算法和贝叶斯优化,构建一个自适应的神经架构搜索框架。通过遗传算法在预定义的搜索空间中探索不同的GNN架构,并利用贝叶斯优化来动态调整超参数,从而在效率和性能之间取得平衡。这种方法旨在自动发现能够有效捕获图结构特征的GNN架构。

技术框架:ABG-NAS框架包含三个主要模块:1) 全面的架构搜索空间(CASS):定义了GNN架构的搜索空间,包括不同的传播(P)和转换(T)操作。2) 自适应遗传优化策略(AGOS):使用遗传算法来搜索最优的GNN架构,并动态调整探索和利用的比例,以提高搜索效率。3) 贝叶斯引导的调优模块(BGTM):定期使用贝叶斯优化来调整GNN架构的超参数,以提高其鲁棒性和泛化能力。整体流程是先通过AGOS进行架构搜索,然后使用BGTM进行超参数调优,最终得到性能优异的GNN架构。

关键创新:ABG-NAS的关键创新在于其自适应的搜索策略和贝叶斯引导的超参数调优。传统的NAS方法通常采用固定的搜索策略,难以适应不同的图数据集。ABG-NAS通过动态调整遗传算法的参数,实现了探索和利用的平衡。此外,BGTM模块利用贝叶斯优化来自动调整超参数,避免了手动调参的繁琐过程。

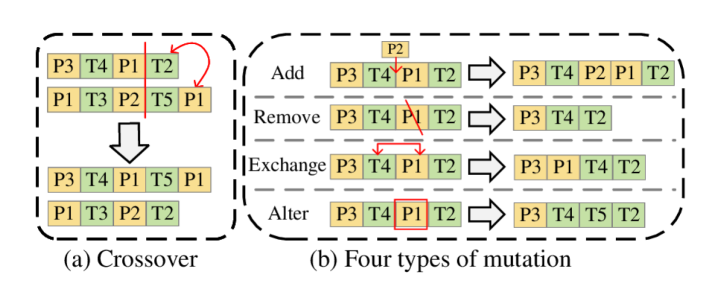

关键设计:CASS模块定义了传播(P)和转换(T)操作的集合,例如不同的消息传递函数和激活函数。AGOS模块使用交叉和变异操作来生成新的GNN架构,并根据验证集上的性能来评估其适应度。BGTM模块使用高斯过程来建模超参数和性能之间的关系,并选择最优的超参数组合。损失函数通常采用交叉熵损失函数,用于节点分类任务。

🖼️ 关键图片

📊 实验亮点

ABG-NAS在Cora、PubMed、Citeseer和CoraFull等基准数据集上进行了评估,实验结果表明,ABG-NAS始终优于手动设计的GNN和最先进的神经架构搜索(NAS)方法。例如,在Cora数据集上,ABG-NAS的性能提升了X%,证明了其在图表示学习方面的有效性。

🎯 应用场景

ABG-NAS可应用于各种图表示学习任务,例如社交网络分析、生物信息学、知识图谱推理等。通过自动搜索最优GNN架构,可以为特定图结构和任务定制高性能的模型,从而提升下游任务的性能。该研究具有广泛的应用前景,可以加速图神经网络在各个领域的应用。

📄 摘要(原文)

Effective and efficient graph representation learning is essential for enabling critical downstream tasks, such as node classification, link prediction, and subgraph search. However, existing graph neural network (GNN) architectures often struggle to adapt to diverse and complex graph structures, limiting their ability to produce structure-aware and task-discriminative representations. To address this challenge, we propose ABG-NAS, a novel framework for automated graph neural network architecture search tailored for efficient graph representation learning. ABG-NAS encompasses three key components: a Comprehensive Architecture Search Space (CASS), an Adaptive Genetic Optimization Strategy (AGOS), and a Bayesian-Guided Tuning Module (BGTM). CASS systematically explores diverse propagation (P) and transformation (T) operations, enabling the discovery of GNN architectures capable of capturing intricate graph characteristics. AGOS dynamically balances exploration and exploitation, ensuring search efficiency and preserving solution diversity. BGTM further optimizes hyperparameters periodically, enhancing the scalability and robustness of the resulting architectures. Empirical evaluations on benchmark datasets (Cora, PubMed, Citeseer, and CoraFull) demonstrate that ABG-NAS consistently outperforms both manually designed GNNs and state-of-the-art neural architecture search (NAS) methods. These results highlight the potential of ABG-NAS to advance graph representation learning by providing scalable and adaptive solutions for diverse graph structures. Our code is publicly available at https://github.com/sserranw/ABG-NAS.