Reinforcement Learning for Reasoning in Large Language Models with One Training Example

作者: Yiping Wang, Qing Yang, Zhiyuan Zeng, Liliang Ren, Liyuan Liu, Baolin Peng, Hao Cheng, Xuehai He, Kuan Wang, Jianfeng Gao, Weizhu Chen, Shuohang Wang, Simon Shaolei Du, Yelong Shen

分类: cs.LG, cs.AI, cs.CL

发布日期: 2025-04-29 (更新: 2025-10-24)

备注: link: https://github.com/ypwang61/One-Shot-RLVR

🔗 代码/项目: GITHUB

💡 一句话要点

提出单样本强化学习与可验证奖励(1-shot RLVR),提升大语言模型数学推理能力。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 强化学习 大语言模型 数学推理 单样本学习 可验证奖励

📋 核心要点

- 现有大语言模型在复杂数学推理任务中表现不足,需要大量训练数据进行微调。

- 论文提出单样本强化学习方法,通过可验证奖励引导模型学习,提升推理能力。

- 实验表明,该方法仅用少量样本即可显著提升模型在多个数学推理基准上的性能。

📝 摘要(中文)

本文提出了一种利用单个训练样本进行强化学习并结合可验证奖励(1-shot RLVR)的方法,有效地提升了大型语言模型(LLMs)的数学推理能力。将RLVR应用于Qwen2.5-Math-1.5B模型,仅使用一个样本就将MATH500数据集上的性能从36.0%提升到73.6%(超出格式校正8.6%),并将六个常见数学推理基准测试的平均性能从17.6%提高到35.7%(非格式增益7.0%)。这一结果与使用包含该样本的1.2k DeepScaleR子集所获得的结果相匹配(MATH500:73.6%,平均值:35.9%)。此外,仅使用两个样本的RLVR甚至略微超过了这些结果(MATH500:74.8%,平均值:36.6%)。在各种模型(Qwen2.5-Math-7B、Llama3.2-3B-Instruct、DeepSeek-R1-Distill-Qwen-1.5B)、RL算法(GRPO和PPO)和不同的数学示例中也观察到了类似的显著改进。此外,我们还发现了1-shot RLVR期间的一些有趣现象,包括跨类别泛化、自反思频率增加以及即使在训练准确率饱和后测试性能仍持续提高(我们称之为饱和后泛化)。此外,我们验证了1-shot RLVR的有效性主要来自策略梯度损失,这使其与“grokking”现象区分开来。我们还展示了促进探索(例如,通过结合具有适当系数的熵损失)在1-shot RLVR训练中的关键作用。我们还进一步讨论了有关格式校正、标签鲁棒性和提示修改的相关观察结果。这些发现可以激发未来关于RLVR效率的工作,并鼓励重新审视RLVR的最新进展和潜在机制。所有资源均在https://github.com/ypwang61/One-Shot-RLVR上开源。

🔬 方法详解

问题定义:现有的大语言模型在数学推理任务中,尤其是需要多步推理的复杂问题上,表现往往不尽如人意。传统的微调方法需要大量的标注数据,成本高昂且效率低下。此外,模型容易受到训练数据分布的影响,泛化能力有限。

核心思路:论文的核心思路是利用强化学习,通过可验证的奖励信号来引导模型学习正确的推理过程。不同于传统的监督学习,强化学习允许模型探索不同的解题路径,并根据最终结果的好坏来调整策略。通过精心设计的奖励函数,可以激励模型学习更有效的推理策略,即使只使用一个训练样本也能取得显著的效果。

技术框架:整体框架包括以下几个主要步骤:1) 使用一个或少量数学问题样本作为训练数据。2) 使用大语言模型生成解题过程。3) 使用可验证的奖励函数评估解题过程的正确性。4) 使用强化学习算法(如GRPO或PPO)根据奖励信号更新模型参数。5) 重复步骤2-4,直到模型收敛。

关键创新:该方法最重要的创新点在于使用单样本强化学习来提升大语言模型的推理能力。与传统的需要大量数据的微调方法相比,该方法极大地降低了训练成本。此外,通过可验证的奖励函数,可以更有效地引导模型学习正确的推理过程,避免了模型陷入局部最优解。另一个创新点是发现了“饱和后泛化”现象,即在训练准确率饱和后,测试性能仍然可以持续提高。

关键设计:关键的设计包括:1) 可验证的奖励函数:奖励函数的设计至关重要,需要能够准确评估解题过程的正确性。论文中使用了基于规则的验证方法来判断答案是否正确。2) 探索策略:为了避免模型陷入局部最优解,需要鼓励模型进行探索。论文中通过引入熵损失来增加模型的探索性。3) 强化学习算法:论文中使用了GRPO和PPO两种强化学习算法,并对它们的性能进行了比较。4) 提示工程:合适的提示可以帮助模型更好地理解问题,并生成更有效的解题过程。

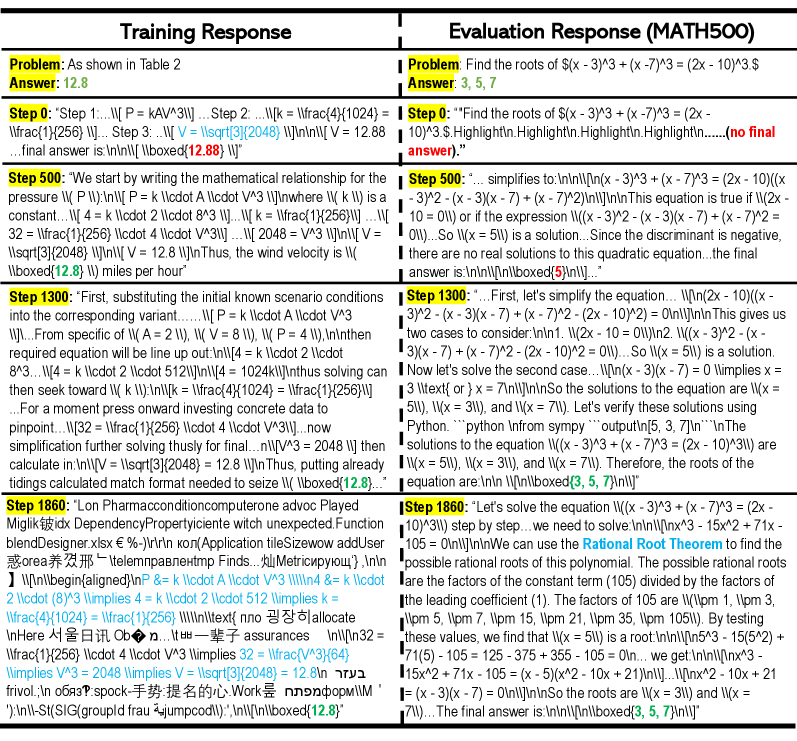

🖼️ 关键图片

📊 实验亮点

实验结果表明,仅使用一个训练样本,该方法就将Qwen2.5-Math-1.5B模型在MATH500数据集上的性能从36.0%提升到73.6%,并将六个常见数学推理基准测试的平均性能从17.6%提高到35.7%。使用两个样本甚至略微超过了这些结果。此外,该方法在不同的模型和强化学习算法上都取得了类似的显著改进。

🎯 应用场景

该研究成果可应用于各种需要复杂推理能力的场景,例如自动数学解题、科学研究、金融分析等。通过降低对大量标注数据的依赖,可以更高效地训练出具有强大推理能力的大语言模型,从而推动人工智能在各个领域的应用。

📄 摘要(原文)

We show that reinforcement learning with verifiable reward using one training example (1-shot RLVR) is effective in incentivizing the math reasoning capabilities of large language models (LLMs). Applying RLVR to the base model Qwen2.5-Math-1.5B, we identify a single example that elevates model performance on MATH500 from 36.0% to 73.6% (8.6% improvement beyond format correction), and improves the average performance across six common mathematical reasoning benchmarks from 17.6% to 35.7% (7.0% non-format gain). This result matches the performance obtained using the 1.2k DeepScaleR subset (MATH500: 73.6%, average: 35.9%), which contains the aforementioned example. Furthermore, RLVR with only two examples even slightly exceeds these results (MATH500: 74.8%, average: 36.6%). Similar substantial improvements are observed across various models (Qwen2.5-Math-7B, Llama3.2-3B-Instruct, DeepSeek-R1-Distill-Qwen-1.5B), RL algorithms (GRPO and PPO), and different math examples. In addition, we identify some interesting phenomena during 1-shot RLVR, including cross-category generalization, increased frequency of self-reflection, and sustained test performance improvement even after the training accuracy has saturated, a phenomenon we term post-saturation generalization. Moreover, we verify that the effectiveness of 1-shot RLVR primarily arises from the policy gradient loss, distinguishing it from the "grokking" phenomenon. We also show the critical role of promoting exploration (e.g., by incorporating entropy loss with an appropriate coefficient) in 1-shot RLVR training. We also further discuss related observations about format correction, label robustness and prompt modification. These findings can inspire future work on RLVR efficiency and encourage a re-examination of recent progress and the underlying mechanisms in RLVR. All resources are open source at https://github.com/ypwang61/One-Shot-RLVR.