Intelligent4DSE: Optimizing High-Level Synthesis Design Space Exploration with Graph Neural Networks and Large Language Models

作者: Lei Xu, Shanshan Wang, Emmanuel Casseau, Chenglong Xiao

分类: cs.LG, cs.AR

发布日期: 2025-04-28 (更新: 2025-10-15)

💡 一句话要点

Intelligent4DSE:利用图神经网络和大型语言模型优化高层次综合设计空间探索

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 高层次综合 设计空间探索 图神经网络 大型语言模型 硬件加速器 元启发式算法 性能预测

📋 核心要点

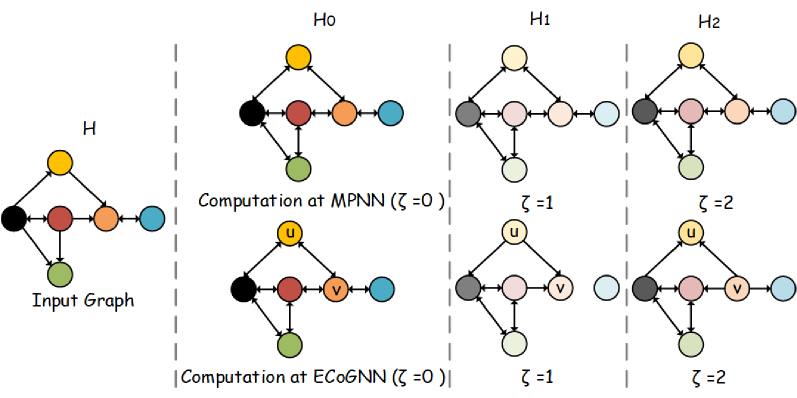

- 现有基于MPNN的HLS设计空间探索方法存在过平滑和表达能力有限的问题,难以准确预测结果质量。

- 论文提出ECoGNNs-LLMMHs框架,结合图神经网络的任务自适应消息传递和大型语言模型增强的元启发式算法,提升预测精度和搜索效率。

- 实验结果表明,ECoGNN在预测精度上优于现有方法,LLMMH在Pareto前沿生成方面优于传统元启发式算法和现有DSE方法。

📝 摘要(中文)

高层次综合(HLS)设计空间探索(DSE)对于生成平衡性能、功耗和面积(PPA)的硬件设计至关重要。为了优化这一过程,现有工作通常采用消息传递神经网络(MPNNs)来预测结果质量(QoR)。这些预测器作为DSE过程中的评估器,有效地绕过了HLS工具传统上所需耗时的估计。然而,现有的基于MPNN的模型在过度平滑和有限的表达能力方面存在问题。此外,虽然元启发式算法被广泛应用于DSE中,但它们通常需要大量的领域特定知识来设计算子和耗时的调优。为了解决这些限制,我们提出了ECoGNNs-LLMMHs,一个集成了图神经网络与任务自适应消息传递和大型语言模型增强的元启发式算法的框架。与最先进的工作相比,ECoGNN在后HLS预测任务中表现出较低的预测误差,误差降低了57.27%。对于后实现预测任务,ECoGNN表现出最低的预测误差,触发器(FF)使用率平均降低17.6%,关键路径(CP)延迟平均降低33.7%,功耗平均降低26.3%,数字信号处理器(DSP)利用率平均降低38.3%,BRAM使用率平均降低40.8%。LLMMH变体可以生成优于元启发式算法的Pareto前沿,在与参考集的平均距离(ADRS)方面平均提高了87.47%。与SOTA DSE方法GNN-DSE和IRONMAN-PRO相比,LLMMH可以将ADRS分别降低68.17%和63.07%。

🔬 方法详解

问题定义:论文旨在解决高层次综合(HLS)设计空间探索(DSE)中,现有基于消息传递神经网络(MPNNs)的方法存在的预测精度不足的问题。现有方法容易出现过平滑现象,表达能力有限,难以准确预测硬件设计的性能、功耗和面积(PPA)。此外,传统元启发式算法在DSE中应用时,需要大量领域知识和耗时的参数调优。

核心思路:论文的核心思路是结合图神经网络(GNN)和大型语言模型(LLM),利用GNN强大的图结构数据建模能力和LLM的知识迁移和泛化能力,构建一个更准确、更高效的DSE框架。通过任务自适应的消息传递机制,增强GNN的表达能力,缓解过平滑问题。利用LLM增强的元启发式算法,减少对领域知识的依赖,提高搜索效率。

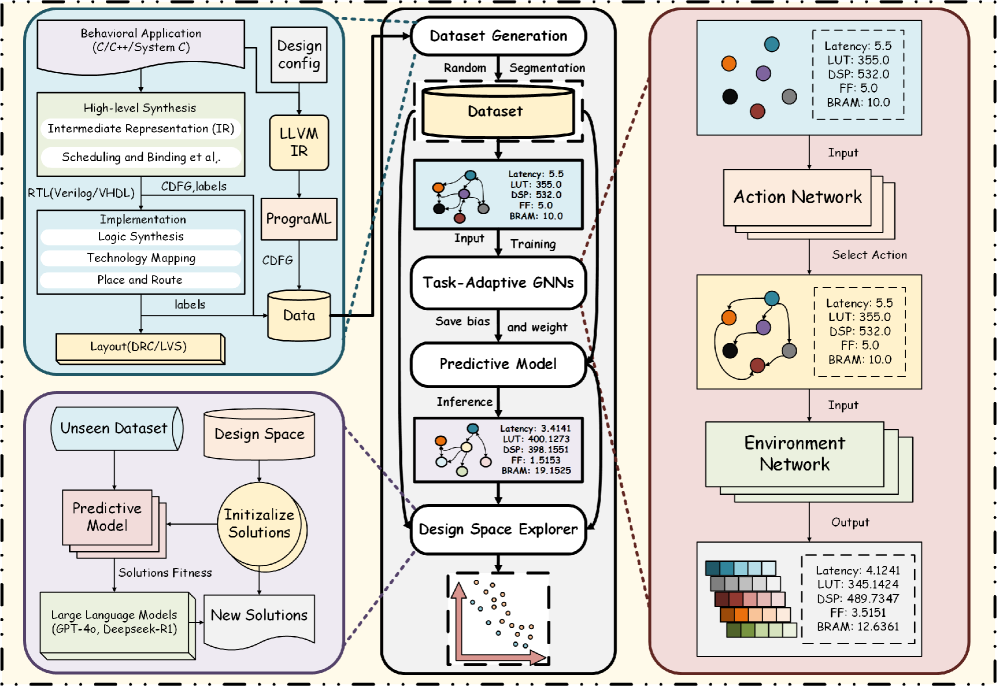

技术框架:ECoGNNs-LLMMHs框架主要包含两个核心模块:ECoGNN和LLMMH。ECoGNN是一个基于GNN的预测模型,用于预测HLS结果的质量(QoR)。LLMMH是一个基于LLM增强的元启发式算法,用于在设计空间中搜索最优的硬件设计配置。整个流程是,首先使用ECoGNN预测不同设计配置的QoR,然后利用LLMMH在设计空间中搜索,找到满足性能、功耗和面积要求的Pareto最优解。

关键创新:论文的关键创新在于:1) 提出了任务自适应的消息传递机制,增强了GNN的表达能力,缓解了过平滑问题。2) 利用大型语言模型(LLM)增强了元启发式算法,减少了对领域知识的依赖,提高了搜索效率。3) 将GNN和LLM有效地结合起来,构建了一个更准确、更高效的DSE框架。

关键设计:ECoGNN采用了Edge-conditioned Graph Neural Networks (ECoGNNs) 结构,通过边条件卷积操作,使消息传递过程能够根据边的特征进行调整,从而实现任务自适应的消息传递。LLMMH利用LLM生成新的设计配置,并根据ECoGNN的预测结果进行选择和优化。具体的损失函数包括预测误差损失和Pareto前沿优化损失。网络结构和参数设置根据具体的HLS任务进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ECoGNN在后HLS预测任务中,预测误差降低了57.27%。在后实现预测任务中,ECoGNN在触发器(FF)使用率、关键路径(CP)延迟、功耗、数字信号处理器(DSP)利用率和BRAM使用率方面,分别平均降低了17.6%、33.7%、26.3%、38.3%和40.8%。LLMMH在Pareto前沿生成方面,与参考集的平均距离(ADRS)平均提高了87.47%。与SOTA DSE方法GNN-DSE和IRONMAN-PRO相比,LLMMH可以将ADRS分别降低68.17%和63.07%。

🎯 应用场景

该研究成果可应用于各种硬件加速器的设计和优化,例如深度学习加速器、图像处理加速器、网络处理器等。通过自动化的设计空间探索,可以快速找到满足特定性能、功耗和面积要求的硬件设计方案,缩短设计周期,降低设计成本。该方法还可以应用于嵌入式系统和物联网设备的硬件设计,优化资源利用率,提高系统性能。

📄 摘要(原文)

High-Level Synthesis (HLS) Design Space Exploration (DSE) is essential for generating hardware designs that balance performance, power, and area (PPA). To optimize this process, existing works often employs message-passing neural networks (MPNNs) to predict quality of results (QoR). These predictors serve as evaluators in the DSE process, effectively bypassing the time-consuming estimations traditionally required by HLS tools. However, existing models based on MPNNs struggle with over-smoothing and limited expressiveness. Additionally, while meta-heuristic algorithms are widely used in DSE, they typically require extensive domain-specific knowledge to design operators and time-consuming tuning. To address these limitations, we propose ECoGNNs-LLMMHs, a framework that integrates graph neural networks with task-adaptive message passing and large language model-enhanced meta-heuristic algorithms. Compared with state-of-the-art works, ECoGNN exhibits lower prediction error in the post-HLS prediction task, with the error reduced by 57.27\%. For post-implementation prediction tasks, ECoGNN demonstrates the lowest prediction errors, with average reductions of 17.6\% for flip-flop (FF) usage, 33.7\% for critical path (CP) delay, 26.3\% for power consumption, 38.3\% for digital signal processor (DSP) utilization, and 40.8\% for BRAM usage. LLMMH variants can generate superior Pareto fronts compared to meta-heuristic algorithms in terms of average distance from the reference set (ADRS) with average improvements of 87.47\%, respectively. Compared with the SOTA DSE approaches GNN-DSE and IRONMAN-PRO, LLMMH can reduce the ADRS by 68.17\% and 63.07\% respectively.