Towards Robust Multimodal Physiological Foundation Models: Handling Arbitrary Missing Modalities

作者: Wei-Bang Jiang, Xi Fu, Yi Ding, Cuntai Guan

分类: eess.SP, cs.LG

发布日期: 2025-04-28 (更新: 2025-06-06)

备注: 19 pages, 5 figures

💡 一句话要点

提出PhysioOmni,解决多模态生理信号分析中模态缺失及泛化性问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态生理信号 基础模型 模态缺失 表征学习 预训练 微调 原型对齐

📋 核心要点

- 现有方法在多模态生理信号分析中依赖特定架构和数据集,泛化能力弱,且难以处理推理时模态缺失问题。

- PhysioOmni通过解耦多模态信号并提取通用表征,同时保持对任意模态缺失的兼容性,从而解决上述问题。

- 在四个下游任务上的实验表明,PhysioOmni在保持对模态缺失的强大鲁棒性的同时,实现了最先进的性能。

📝 摘要(中文)

本文提出PhysioOmni,一个用于多模态生理信号分析的基础模型,旨在解决现有方法依赖特定架构和数据集融合策略,难以学习通用表征以及处理推理时模态缺失的问题。PhysioOmni通过建模同构和异构特征来解耦多模态信号,提取通用表征,同时保持对任意模态缺失的兼容性。该模型训练了一个解耦的多模态tokenizer,通过模态不变和模态特定的目标函数进行掩码信号预训练。为了确保对不同和不完整模态组合的适应性,预训练的编码器通过原型对齐在下游数据集上进行弹性微调。在情感识别、睡眠阶段分类、运动预测和精神负荷检测四个下游任务上的大量实验表明,PhysioOmni在保持对模态缺失的强大鲁棒性的同时,实现了最先进的性能。代码和模型权重将会开源。

🔬 方法详解

问题定义:现有方法在处理多模态生理信号时,通常针对特定数据集和模态组合设计,缺乏通用性和鲁棒性。当推理时出现模态缺失,这些方法的性能会显著下降。因此,需要一种能够处理任意模态缺失,并能跨数据集泛化的多模态生理信号分析方法。

核心思路:PhysioOmni的核心思路是学习一个解耦的多模态表征,将模态特定的信息和模态不变的信息分离开来。通过这种方式,即使在某些模态缺失的情况下,模型仍然可以利用剩余模态的信息进行有效的推理。同时,通过预训练和微调相结合的方式,提高模型的泛化能力。

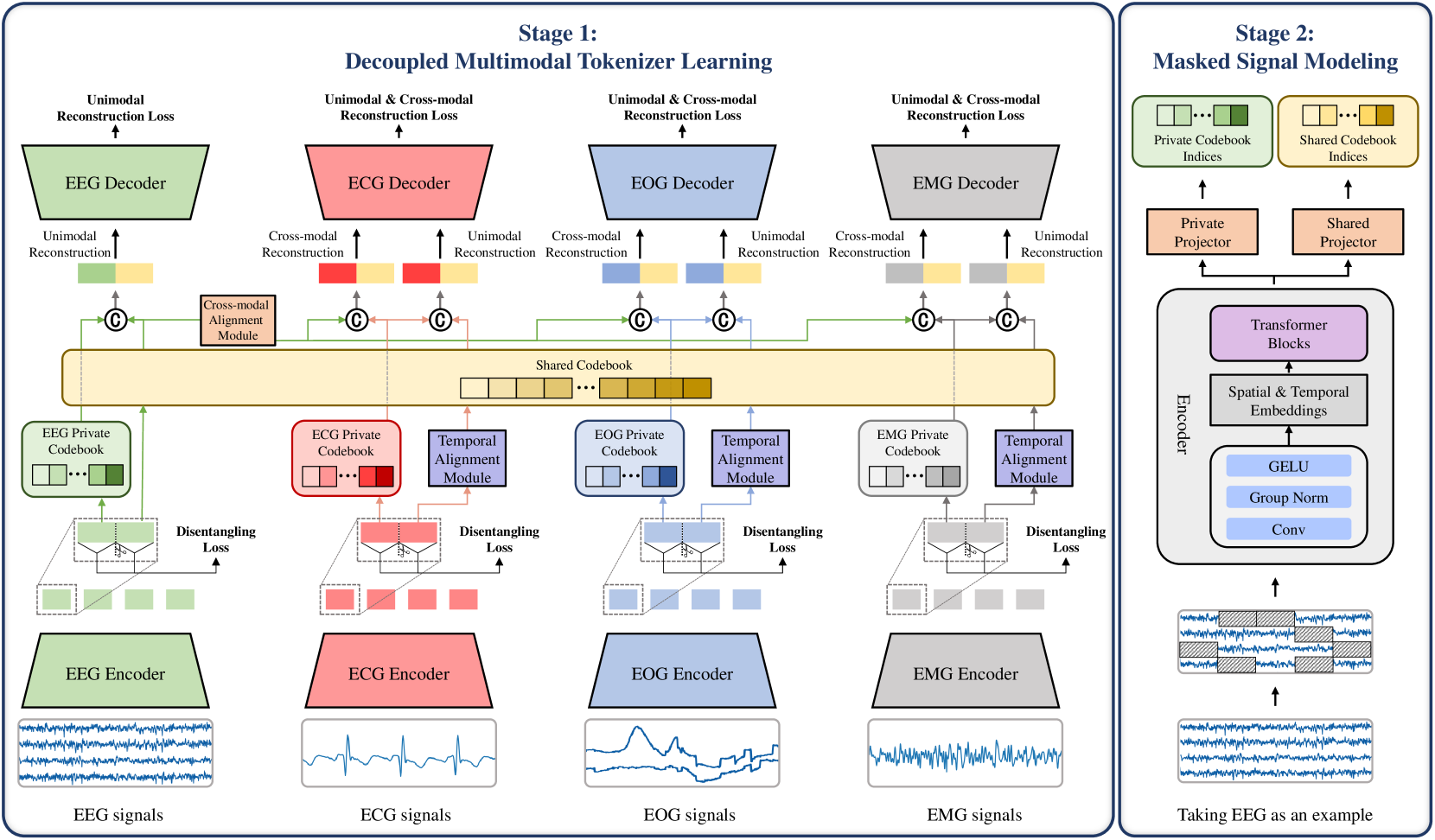

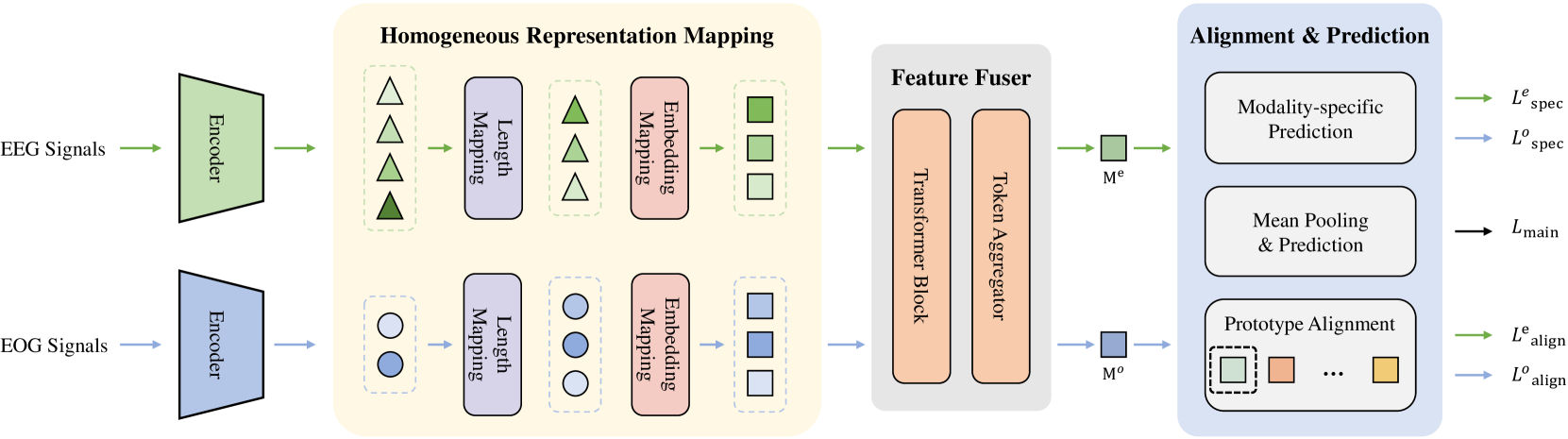

技术框架:PhysioOmni的整体框架包括三个主要阶段:1) 解耦多模态Tokenizer:用于将原始生理信号转换为离散的token表示,同时区分模态特定和模态不变的特征。2) 掩码信号预训练:利用模态不变和模态特定的目标函数,对tokenizer进行预训练,使其能够学习到通用的生理信号表征。3) 弹性微调:在下游任务上,利用原型对齐策略对预训练的编码器进行微调,使其能够适应不同的模态组合和数据集。

关键创新:PhysioOmni的关键创新在于其解耦的多模态Tokenizer和弹性微调策略。解耦Tokenizer能够有效地分离模态特定和模态不变的信息,从而提高模型对模态缺失的鲁棒性。弹性微调策略则通过原型对齐,使得模型能够更好地适应不同的下游任务和数据集。

关键设计:PhysioOmni使用Transformer作为其核心架构。在预训练阶段,采用了掩码信号建模(Masked Signal Modeling)的方式,随机mask掉一部分信号,然后让模型预测被mask掉的信号。损失函数包括模态不变损失和模态特定损失,用于约束模型学习到解耦的表征。在微调阶段,采用了原型对齐损失,用于拉近同一类别的样本在特征空间中的距离。

🖼️ 关键图片

📊 实验亮点

PhysioOmni在四个下游任务(情感识别、睡眠阶段分类、运动预测和精神负荷检测)上均取得了state-of-the-art的性能。尤其是在存在模态缺失的情况下,PhysioOmni的性能明显优于其他方法,证明了其对模态缺失的强大鲁棒性。具体性能数据将在论文中详细展示。

🎯 应用场景

PhysioOmni在医疗健康和人机交互领域具有广泛的应用前景。例如,可以用于开发更可靠的情感识别系统,辅助医生进行睡眠障碍诊断,实现更精准的运动意图预测,以及评估用户的精神负荷状态。该研究有望推动基于生理信号的智能医疗设备和人机交互系统的发展。

📄 摘要(原文)

Multimodal physiological signals, such as EEG, ECG, EOG, and EMG, are crucial for healthcare and brain-computer interfaces. While existing methods rely on specialized architectures and dataset-specific fusion strategies, they struggle to learn universal representations that generalize across datasets and handle missing modalities at inference time. To address these issues, we propose PhysioOmni, a foundation model for multimodal physiological signal analysis that models both homogeneous and heterogeneous features to decouple multimodal signals and extract generic representations while maintaining compatibility with arbitrary missing modalities. PhysioOmni trains a decoupled multimodal tokenizer, enabling masked signal pre-training via modality-invariant and modality-specific objectives. To ensure adaptability to diverse and incomplete modality combinations, the pre-trained encoders undergo resilient fine-tuning with prototype alignment on downstream datasets. Extensive experiments on four downstream tasks, emotion recognition, sleep stage classification, motor prediction, and mental workload detection, demonstrate that PhysioOmni achieves state-of-the-art performance while maintaining strong robustness to missing modalities. Our code and model weights will be released.