TLoRA: Tri-Matrix Low-Rank Adaptation of Large Language Models

作者: Tanvir Islam

分类: cs.LG, cs.AI

发布日期: 2025-04-25 (更新: 2025-11-29)

💡 一句话要点

TLoRA:一种用于大型语言模型的三矩阵低秩自适应方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 低秩自适应 大型语言模型 参数高效微调 三矩阵分解 GLUE基准

📋 核心要点

- 现有低秩自适应方法在参数效率和计算开销之间存在权衡,难以兼顾。

- TLoRA通过三矩阵分解权重更新,结合随机矩阵和可学习缩放因子,实现高效参数自适应。

- 实验表明,TLoRA在GLUE基准上与LoRA等方法性能相当,但所需可训练参数显著减少。

📝 摘要(中文)

本文提出了一种新颖的三矩阵低秩自适应方法TLoRA,该方法将权重更新分解为三个矩阵:两个固定的随机矩阵和一个可训练矩阵,并结合一个可学习的、逐层的缩放因子。这种三矩阵设计使TLoRA能够实现高效的参数自适应,同时引入最小的额外计算开销。通过在GLUE基准上的大量实验,我们证明了TLoRA在需要显著更少的可训练参数的情况下,实现了与现有低秩方法(如LoRA和基于Adapter的技术)相当的性能。通过分析自适应动态,我们观察到TLoRA表现出类似高斯的权重分布、稳定的参数范数以及跨层的缩放因子可变性,进一步突出了其表达能力和适应性。此外,我们表明TLoRA在特征值分布、参数范数和更新的余弦相似性方面与LoRA非常相似,突显了其有效近似LoRA自适应行为的能力。我们的结果表明,TLoRA是一种高效且有效的大型语言模型微调方法,为资源高效的模型自适应提供了一个重要的进步。

🔬 方法详解

问题定义:大型语言模型(LLM)的微调需要大量的计算资源和存储空间。现有的低秩自适应方法,如LoRA和Adapter,虽然减少了可训练参数的数量,但在参数效率和计算开销之间仍然存在权衡。如何进一步降低微调LLM的资源需求,同时保持甚至提升模型性能,是一个重要的研究问题。

核心思路:TLoRA的核心思路是将权重更新分解为三个矩阵的乘积,其中两个矩阵是固定的随机矩阵,只有一个矩阵是可训练的。这种分解方式可以显著减少可训练参数的数量,同时利用随机矩阵的性质来保持模型的表达能力。此外,TLoRA还引入了可学习的逐层缩放因子,以进一步提高模型的适应性。

技术框架:TLoRA的整体框架是在预训练的LLM中插入TLoRA模块。对于每个需要微调的权重矩阵,TLoRA将其更新表示为三个矩阵的乘积:ΔW = P * A * Q,其中P和Q是固定的随机矩阵,A是可训练的低秩矩阵。此外,每个TLoRA模块还包含一个可学习的缩放因子,用于调整权重更新的幅度。在训练过程中,只有A矩阵和缩放因子被更新,而预训练的LLM的权重和P、Q矩阵保持不变。

关键创新:TLoRA最重要的技术创新点在于其三矩阵分解方式。与传统的低秩自适应方法(如LoRA)相比,TLoRA使用两个固定的随机矩阵来代替LoRA中的一个随机矩阵,从而进一步减少了可训练参数的数量。此外,TLoRA的可学习缩放因子也提高了模型的适应性。

关键设计:TLoRA的关键设计包括:1) 随机矩阵P和Q的初始化方式,通常使用高斯分布或均匀分布进行初始化;2) 可训练矩阵A的秩的选择,秩越小,可训练参数越少,但模型的表达能力也可能受到限制;3) 缩放因子的初始化方式,通常初始化为较小的值,以避免在训练初期对预训练模型产生过大的扰动;4) 损失函数的设计,通常使用交叉熵损失函数或类似的损失函数来训练TLoRA模块。

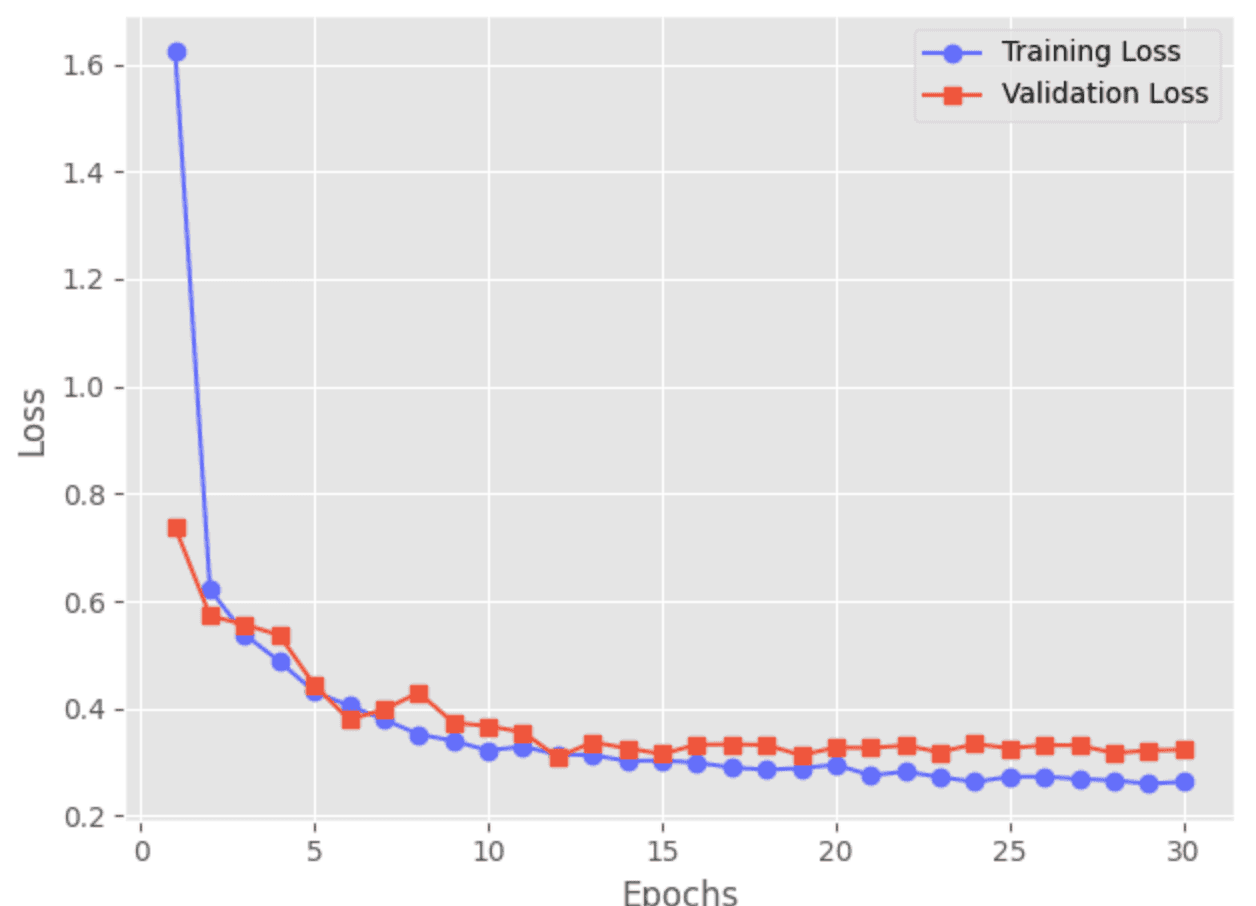

🖼️ 关键图片

📊 实验亮点

TLoRA在GLUE基准测试中取得了与LoRA和Adapter相当的性能,同时显著减少了可训练参数的数量。例如,在某些任务上,TLoRA仅使用LoRA所需参数的50%即可达到相同的性能水平。此外,TLoRA还表现出稳定的参数范数和类似高斯的权重分布,表明其具有良好的训练稳定性和泛化能力。

🎯 应用场景

TLoRA适用于各种需要高效微调大型语言模型的场景,例如自然语言处理、文本生成、机器翻译等。它尤其适用于资源受限的环境,如移动设备或边缘计算平台。TLoRA的低资源消耗特性使其能够更容易地部署到实际应用中,并加速LLM在各个领域的普及。

📄 摘要(原文)

We propose TLoRA, a novel tri-matrix low-rank adaptation method that decomposes weight updates into three matrices: two fixed random matrices and one trainable matrix, combined with a learnable, layer-wise scaling factor. This tri-matrix design enables TLoRA to achieve highly efficient parameter adaptation while introducing minimal additional computational overhead. Through extensive experiments on the GLUE benchmark, we demonstrate that TLoRA achieves comparable performance to existing low-rank methods such as LoRA and Adapter-based techniques, while requiring significantly fewer trainable parameters. Analyzing the adaptation dynamics, we observe that TLoRA exhibits Gaussian-like weight distributions, stable parameter norms, and scaling factor variability across layers, further highlighting its expressive power and adaptability. Additionally, we show that TLoRA closely resembles LoRA in its eigenvalue distributions, parameter norms, and cosine similarity of updates, underscoring its ability to effectively approximate LoRA's adaptation behavior. Our results establish TLoRA as a highly efficient and effective fine-tuning method for LLMs, offering a significant step forward in resource-efficient model adaptation.