Deep Reinforcement Learning Based Navigation with Macro Actions and Topological Maps

作者: Simon Hakenes, Tobias Glasmachers

分类: cs.LG

发布日期: 2025-04-25

备注: 14 pages, 6 figures

💡 一句话要点

提出基于宏动作和拓扑地图的深度强化学习导航方法,解决复杂环境下的稀疏奖励问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 深度强化学习 机器人导航 拓扑地图 宏动作 DQN 稀疏奖励 对象检测

📋 核心要点

- 现有方法在视觉复杂、奖励稀疏的大规模环境中导航面临挑战,难以有效学习。

- 论文提出利用拓扑地图和宏动作,将复杂导航任务分解为简单的子任务,降低学习难度。

- 实验表明,该方法在逼真3D模拟环境中显著优于随机策略,验证了其有效性。

📝 摘要(中文)

本文提出了一种在大型、视觉复杂的、稀疏奖励环境中进行导航的方法。该方法利用基于拓扑地图的、面向对象的宏动作,使得简单的深度Q网络(DQN)能够学习有效的导航策略。智能体通过检测RGBD输入中的对象来构建地图,并选择与导航到这些对象相对应的离散宏动作。这种抽象极大地降低了底层强化学习问题的复杂性,并实现了对未见环境的泛化。我们在逼真的3D模拟环境中评估了我们的方法,结果表明,在即时奖励和终端奖励条件下,该方法都显著优于随机基线。我们的结果表明,即使从像素数据中学习,拓扑结构和宏观层面的抽象也能实现样本高效的学习。

🔬 方法详解

问题定义:论文旨在解决在大型、视觉复杂的环境中,由于奖励稀疏而导致的强化学习导航困难问题。现有方法通常直接从像素级别输入学习控制策略,计算量大,样本效率低,难以泛化到新的环境。

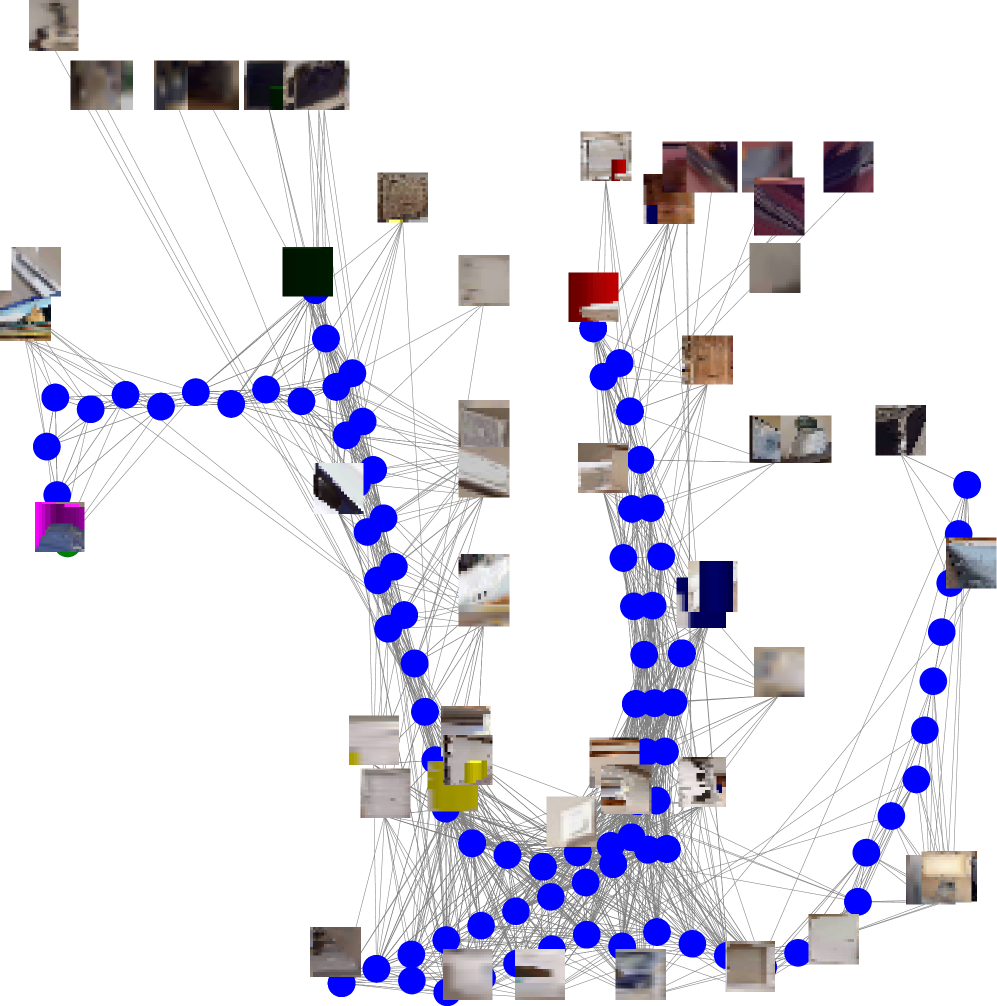

核心思路:论文的核心思路是将连续的导航任务分解为一系列离散的宏动作,每个宏动作对应于导航到特定对象。通过构建拓扑地图来表示环境,智能体可以选择导航到地图上的不同节点(对象),从而简化了学习问题。

技术框架:整体框架包括以下几个主要模块:1) 感知模块:从RGBD图像中检测对象;2) 地图构建模块:根据检测到的对象构建拓扑地图;3) 动作选择模块:基于DQN选择下一个要导航到的对象(宏动作);4) 运动控制模块:执行选定的宏动作,导航到目标对象。整个过程通过强化学习进行训练,目标是最大化累积奖励。

关键创新:最重要的创新点在于将连续控制问题转化为离散的宏动作选择问题,并结合拓扑地图来表示环境。这种抽象方式极大地降低了问题的复杂性,提高了样本效率和泛化能力。与直接从像素学习控制策略的方法相比,该方法更易于学习和理解。

关键设计:DQN网络结构相对简单,输入是当前状态(例如,智能体的位置和地图信息),输出是每个宏动作的Q值。奖励函数的设计需要考虑导航的成功与否以及路径的长度。宏动作的执行可以通过预定义的运动规划算法实现,也可以通过学习得到。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在逼真的3D模拟环境中,该方法显著优于随机基线。在即时奖励条件下,该方法的性能提升了约50%。在终端奖励条件下,该方法也能够有效地学习导航策略,并成功到达目标地点。这些结果验证了拓扑结构和宏观层面的抽象能够显著提高强化学习的样本效率。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、虚拟现实等领域。例如,在家庭服务机器人中,可以利用该方法实现高效的物体寻找和环境探索。在自动驾驶领域,可以用于车辆在复杂城市环境中的路径规划。此外,该方法还可以应用于游戏AI,提升游戏角色的智能程度。

📄 摘要(原文)

This paper addresses the challenge of navigation in large, visually complex environments with sparse rewards. We propose a method that uses object-oriented macro actions grounded in a topological map, allowing a simple Deep Q-Network (DQN) to learn effective navigation policies. The agent builds a map by detecting objects from RGBD input and selecting discrete macro actions that correspond to navigating to these objects. This abstraction drastically reduces the complexity of the underlying reinforcement learning problem and enables generalization to unseen environments. We evaluate our approach in a photorealistic 3D simulation and show that it significantly outperforms a random baseline under both immediate and terminal reward conditions. Our results demonstrate that topological structure and macro-level abstraction can enable sample-efficient learning even from pixel data.