Effortless, Simulation-Efficient Bayesian Inference using Tabular Foundation Models

作者: Julius Vetter, Manuel Gloeckler, Daniel Gedon, Jakob H. Macke

分类: cs.LG

发布日期: 2025-04-24 (更新: 2025-10-27)

💡 一句话要点

提出NPE-PFN,利用表格型预训练模型高效解决模拟推理中的样本效率问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 贝叶斯推断 模拟推理 表格型基础模型 预训练模型 样本效率

📋 核心要点

- 传统SBI方法在复杂模拟器上进行贝叶斯推断时,需要大量的模拟数据,计算成本高昂。

- NPE-PFN利用预训练的表格型基础模型TabPFN,直接估计后验分布,无需针对特定问题进行训练。

- 实验表明,NPE-PFN在保证推理精度的前提下,显著降低了模拟次数,提高了样本效率,并具有良好的鲁棒性。

📝 摘要(中文)

本文提出了一种名为NPE-PFN(Neural Posterior Estimation with Prior-data Fitted Networks)的新方法,旨在提高基于模拟的推理(SBI)的效率。SBI通过在模型生成的合成数据上训练神经网络,从而快速推断观测数据的后验分布。NPE-PFN利用表格型预训练模型TabPFN作为自回归条件密度估计器,无需额外的网络选择、训练和超参数调优。实验结果表明,NPE-PFN在基准测试和两个复杂的科学逆问题中,其准确性与现有SBI方法相当,但在模拟效率方面通常显著优于它们,有时甚至减少了几个数量级的模拟次数。此外,NPE-PFN对模型误设表现出更强的鲁棒性,并且可以扩展到超过TabPFN上下文大小限制的模拟预算。NPE-PFN为SBI提供了一个新的方向,即利用无需训练的通用推理模型,为各种随机逆问题提供高效、易用和灵活的解决方案。

🔬 方法详解

问题定义:论文旨在解决基于模拟的推理(SBI)中,当模拟器计算成本高昂时,需要大量模拟数据才能获得准确后验分布的问题。现有SBI方法通常需要针对特定问题训练神经网络,计算资源消耗大,且对超参数敏感。

核心思路:论文的核心思路是利用预训练的表格型基础模型(TabPFN)作为条件密度估计器,直接从先验数据中学习后验分布,避免了针对特定问题的训练过程。TabPFN具有强大的泛化能力,可以有效地利用少量模拟数据进行推理。

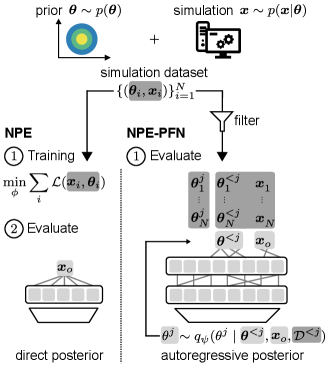

技术框架:NPE-PFN的整体框架包括以下步骤:1) 从先验分布中采样参数,并使用模拟器生成相应的观测数据;2) 将参数和观测数据输入预训练的TabPFN模型;3) TabPFN模型输出后验分布的估计;4) 使用估计的后验分布进行推理。该框架无需额外的训练步骤,可以直接使用预训练的TabPFN模型。

关键创新:NPE-PFN的关键创新在于将表格型基础模型TabPFN应用于SBI,实现了无需训练的贝叶斯推理。与传统的SBI方法相比,NPE-PFN不需要针对特定问题进行网络结构选择、训练和超参数调优,大大简化了推理流程,提高了效率。

关键设计:NPE-PFN的关键设计在于利用TabPFN的自回归特性,将其作为条件密度估计器。具体来说,TabPFN被用来估计给定观测数据条件下,参数的条件概率分布。此外,论文还提出了将NPE-PFN扩展到超过TabPFN上下文大小限制的模拟预算的方法,例如通过分块处理数据。

🖼️ 关键图片

📊 实验亮点

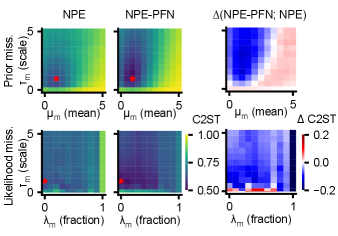

实验结果表明,NPE-PFN在多个基准测试和两个复杂的科学逆问题中,其准确性与现有SBI方法相当,但在模拟效率方面通常显著优于它们,有时甚至减少了几个数量级的模拟次数。例如,在某些问题上,NPE-PFN仅需少量模拟即可达到与传统SBI方法相当的精度。

🎯 应用场景

NPE-PFN可广泛应用于科学和工程领域的各种逆问题,例如参数估计、模型选择和不确定性量化。特别是在模拟器计算成本高昂的领域,如气候建模、生物物理建模和材料科学等,NPE-PFN可以显著提高推理效率,加速科学发现。

📄 摘要(原文)

Simulation-based inference (SBI) offers a flexible and general approach to performing Bayesian inference: In SBI, a neural network is trained on synthetic data simulated from a model and used to rapidly infer posterior distributions for observed data. A key goal for SBI is to achieve accurate inference with as few simulations as possible, especially for expensive simulators. In this work, we address this challenge by repurposing recent probabilistic foundation models for tabular data: We show how tabular foundation models -- specifically TabPFN -- can be used as pre-trained autoregressive conditional density estimators for SBI. We propose Neural Posterior Estimation with Prior-data Fitted Networks (NPE-PFN) and show that it is competitive with current SBI approaches in terms of accuracy for both benchmark tasks and two complex scientific inverse problems. Crucially, it often substantially outperforms them in terms of simulation efficiency, sometimes requiring orders of magnitude fewer simulations. NPE-PFN eliminates the need for inference network selection, training, and hyperparameter tuning. We also show that it exhibits superior robustness to model misspecification and can be scaled to simulation budgets that exceed the context size limit of TabPFN. NPE-PFN provides a new direction for SBI, where training-free, general-purpose inference models offer efficient, easy-to-use, and flexible solutions for a wide range of stochastic inverse problems.