Cooperative Task Offloading through Asynchronous Deep Reinforcement Learning in Mobile Edge Computing for Future Networks

作者: Yuelin Liu, Haiyuan Li, Xenofon Vasilakos, Rasheed Hussain, Dimitra Simeonidou

分类: cs.LG

发布日期: 2025-04-24

💡 一句话要点

提出基于异步深度强化学习的协同任务卸载框架CTO-TP,优化未来网络MEC中的延迟和能耗。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 移动边缘计算 任务卸载 深度强化学习 异步训练 Transformer 边缘计算 资源分配 协同计算

📋 核心要点

- 现有MEC任务卸载方案依赖单一服务器,导致资源利用不均和集中式决策带来的高延迟。

- 论文提出CTO-TP框架,利用异步多智能体深度强化学习实现边缘协同,优化任务卸载和资源分配。

- 实验结果表明,CTO-TP算法相比基线方案,可显著降低系统延迟和能耗,最高分别降低80%和87%。

📝 摘要(中文)

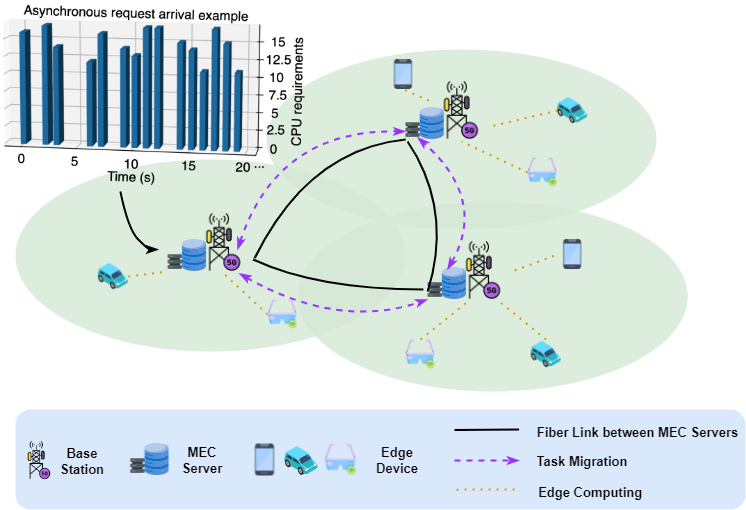

未来网络(包括6G)将加速万物互联的实现。然而,这也将导致对计算资源的高需求,以支持新的服务。移动边缘计算(MEC)是一种有前景的解决方案,它能够将计算密集型任务从终端用户设备卸载到附近的边缘服务器,从而减少延迟和能耗。然而,仅仅依靠单个MEC服务器进行任务卸载会导致资源利用不均和次优性能。此外,传统的任务卸载策略专注于集中式策略决策,这不可避免地导致极高的传输延迟和计算瓶颈。为了填补这些空白,我们提出了一种延迟和能耗高效的协同任务卸载框架,该框架采用Transformer驱动的预测(CTO-TP),利用异步多智能体深度强化学习来应对这些挑战。这种方法促进了边缘-边缘合作,并通过执行异步训练来减少同步等待时间,从而优化了分布式网络中的任务卸载和资源分配。性能评估表明,与基线方案相比,所提出的CTO-TP算法可降低高达80%的总体系统延迟和87%的能耗。

🔬 方法详解

问题定义:论文旨在解决未来网络中,由于计算密集型任务增多,单一MEC服务器无法有效处理任务卸载,导致高延迟和高能耗的问题。现有集中式任务卸载策略存在传输延迟高和计算瓶颈的痛点。

核心思路:论文的核心思路是利用异步多智能体深度强化学习,实现边缘服务器之间的协同任务卸载。通过让边缘服务器相互协作,可以更有效地利用资源,减少对单一服务器的依赖,从而降低延迟和能耗。异步训练则可以减少同步等待时间,提高训练效率。

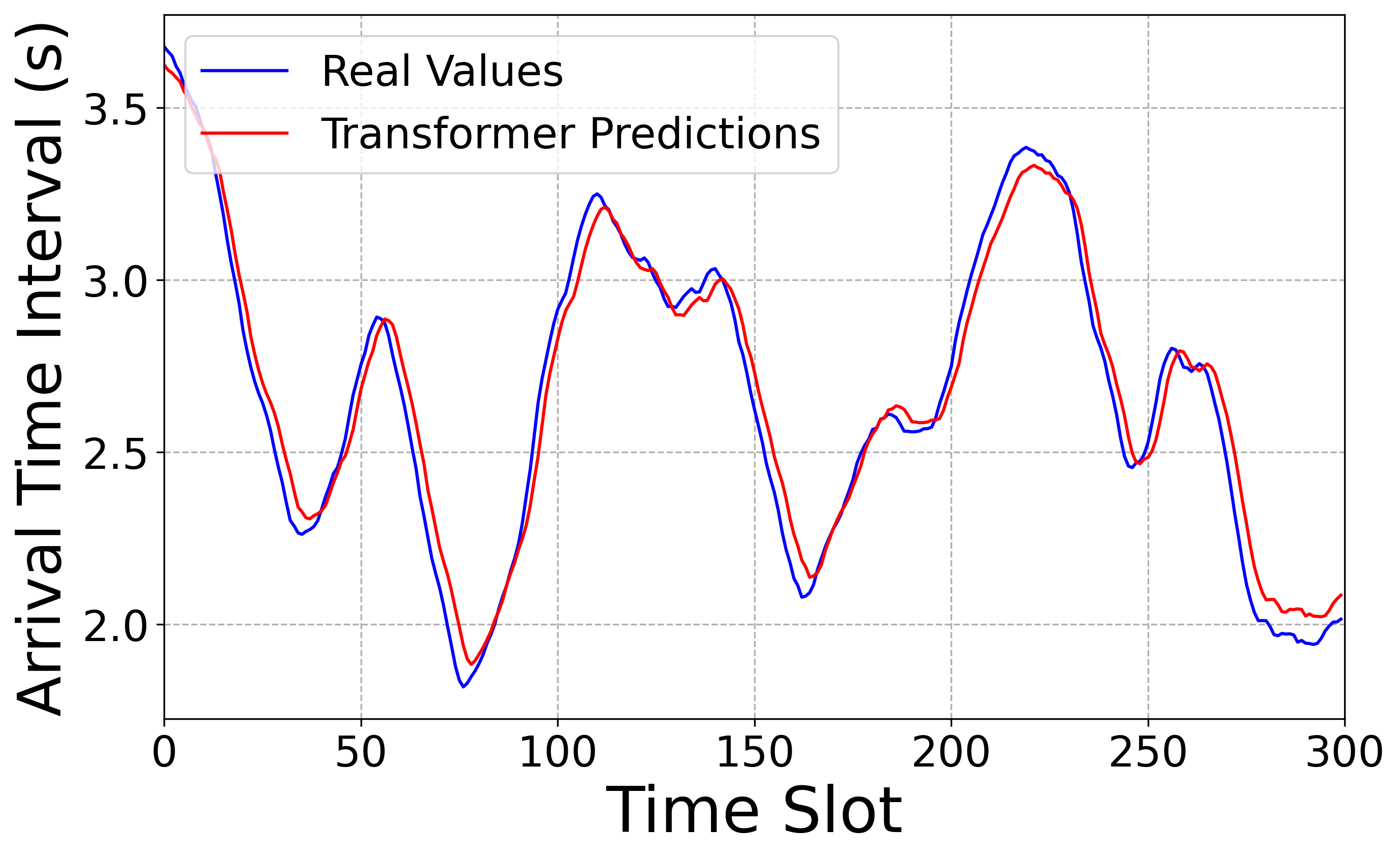

技术框架:CTO-TP框架包含以下主要模块:1) 任务到达模型,模拟用户设备的任务请求;2) Transformer驱动的预测模块,用于预测任务的计算需求和延迟;3) 异步多智能体深度强化学习模块,每个边缘服务器作为一个智能体,通过异步训练学习最优的任务卸载策略;4) 资源分配模块,根据任务卸载策略,将计算资源分配给不同的任务。整体流程是,用户设备发起任务请求,边缘服务器利用Transformer预测任务需求,然后通过异步深度强化学习进行任务卸载决策和资源分配。

关键创新:论文的关键创新在于:1) 提出了基于Transformer的任务需求预测模块,提高了预测精度;2) 采用了异步多智能体深度强化学习,实现了边缘服务器之间的协同和高效训练;3) 提出了CTO-TP框架,将任务预测、任务卸载和资源分配整合在一起,形成一个完整的解决方案。与现有方法的本质区别在于,CTO-TP框架实现了边缘服务器之间的协同,并采用了异步训练,从而提高了系统的性能和效率。

关键设计:Transformer驱动的预测模块使用了标准的Transformer结构,用于预测任务的计算需求和延迟。异步多智能体深度强化学习模块采用了Actor-Critic框架,每个智能体都有一个Actor网络和一个Critic网络。Actor网络用于学习任务卸载策略,Critic网络用于评估Actor网络的性能。损失函数包括延迟损失、能耗损失和资源利用率损失。网络结构和参数设置根据具体的实验场景进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,与传统的集中式任务卸载方案相比,CTO-TP算法能够显著降低系统延迟和能耗。具体来说,CTO-TP算法可以将总体系统延迟降低高达80%,能耗降低高达87%。这些结果表明,CTO-TP算法在未来网络中具有重要的应用价值。

🎯 应用场景

该研究成果可应用于未来的6G网络、物联网、智能交通等领域,通过优化任务卸载和资源分配,降低延迟和能耗,提升用户体验。该框架能够有效支持需要低延迟和高可靠性的新型应用,例如增强现实、虚拟现实和自动驾驶。

📄 摘要(原文)

Future networks (including 6G) are poised to accelerate the realisation of Internet of Everything. However, it will result in a high demand for computing resources to support new services. Mobile Edge Computing (MEC) is a promising solution, enabling to offload computation-intensive tasks to nearby edge servers from the end-user devices, thereby reducing latency and energy consumption. However, relying solely on a single MEC server for task offloading can lead to uneven resource utilisation and suboptimal performance in complex scenarios. Additionally, traditional task offloading strategies specialise in centralised policy decisions, which unavoidably entail extreme transmission latency and reach computational bottleneck. To fill the gaps, we propose a latency and energy efficient Cooperative Task Offloading framework with Transformer-driven Prediction (CTO-TP), leveraging asynchronous multi-agent deep reinforcement learning to address these challenges. This approach fosters edge-edge cooperation and decreases the synchronous waiting time by performing asynchronous training, optimising task offloading, and resource allocation across distributed networks. The performance evaluation demonstrates that the proposed CTO-TP algorithm reduces up to 80% overall system latency and 87% energy consumption compared to the baseline schemes.