Plasticine: Accelerating Research in Plasticity-Motivated Deep Reinforcement Learning

作者: Mingqi Yuan, Qi Wang, Guozheng Ma, Bo Li, Xin Jin, Yunbo Wang, Xiaokang Yang, Wenjun Zeng, Dacheng Tao

分类: cs.LG, cs.AI

发布日期: 2025-04-24

备注: 23 pages

🔗 代码/项目: GITHUB

💡 一句话要点

Plasticine:加速塑性驱动的深度强化学习研究的开源框架

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 深度强化学习 终身学习 塑性损失 基准测试 开源框架 持续学习 非平稳环境 迁移学习

📋 核心要点

- 深度强化学习在终身学习中面临塑性损失问题,神经网络逐渐失去适应性,阻碍了通用人工智能的发展。

- Plasticine框架旨在通过提供统一的基准、评估协议和多种缓解方法,系统地研究和优化深度强化学习中的塑性问题。

- 该框架包含多种学习场景、评估指标和缓解策略的实现,方便研究人员量化塑性损失并分析不同策略的效果。

📝 摘要(中文)

开发终身学习智能体对于通用人工智能至关重要。然而,深度强化学习(RL)系统常常遭受塑性损失,即神经网络在训练过程中逐渐丧失适应能力。尽管其重要性,该领域缺乏统一的基准和评估协议。我们推出了Plasticine,这是第一个用于深度强化学习中塑性优化基准测试的开源框架。Plasticine提供了超过13种缓解方法、10种评估指标以及从标准到开放环境的、非平稳性程度递增的学习场景的单文件实现。该框架使研究人员能够系统地量化塑性损失,评估缓解策略,并分析不同背景下的塑性动态。我们的文档、示例和源代码可在https://github.com/RLE-Foundation/Plasticine获取。

🔬 方法详解

问题定义:深度强化学习在持续学习过程中会遇到“塑性损失”问题,即神经网络在不断学习新任务时,会逐渐遗忘之前学习到的知识,导致性能下降。现有方法缺乏统一的评估标准和基准,难以系统地比较和分析不同缓解策略的效果。

核心思路:Plasticine框架的核心思路是提供一个统一的平台,包含多种学习环境、评估指标和缓解塑性损失的方法,使得研究人员能够方便地进行实验和比较,从而更好地理解和解决塑性损失问题。通过提供标准化的接口和评估流程,促进该领域的研究进展。

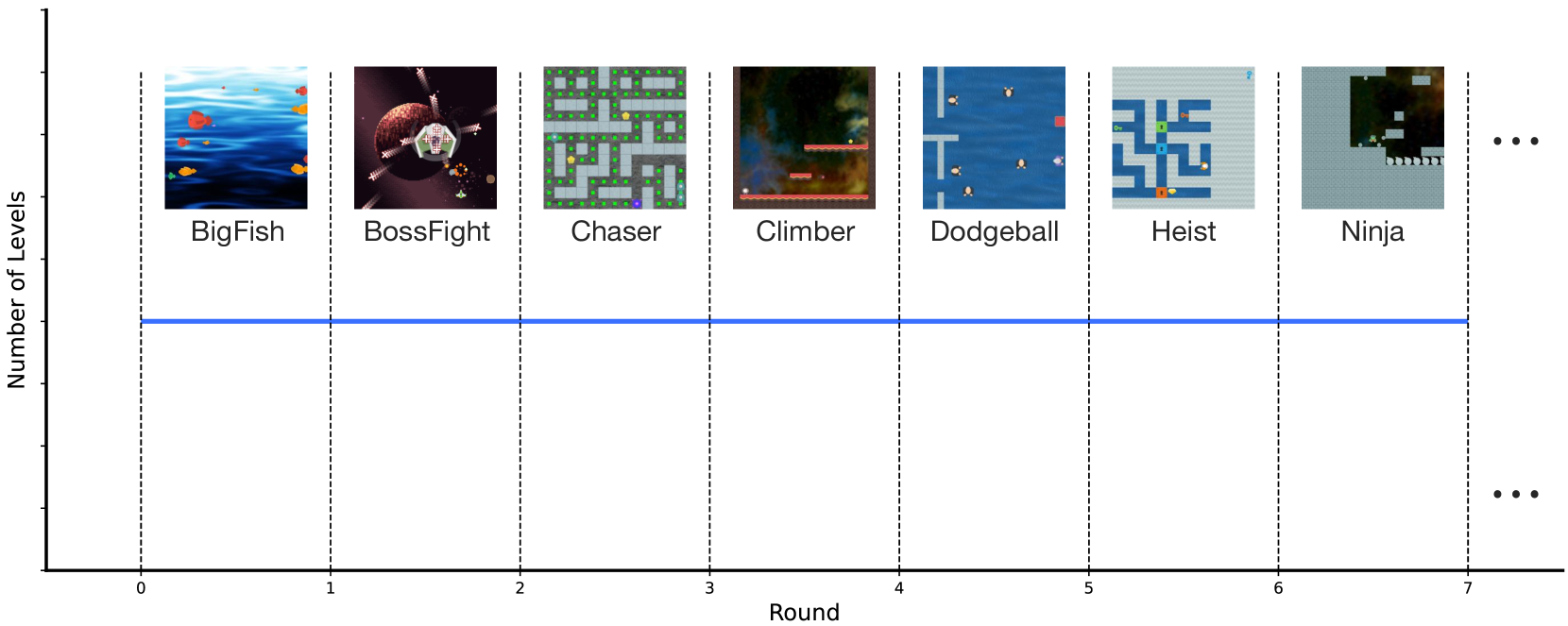

技术框架:Plasticine框架主要包含以下几个模块:1) 学习环境:提供从标准到开放式的多种强化学习环境,并控制环境的非平稳性程度;2) 缓解方法:包含超过13种缓解塑性损失的方法的单文件实现;3) 评估指标:提供10种评估指标,用于量化塑性损失和评估缓解策略的效果;4) 实验脚本:提供易于使用的实验脚本,方便研究人员进行实验和比较。

关键创新:Plasticine框架的关键创新在于其统一性和易用性。它首次将多种缓解塑性损失的方法、评估指标和学习环境整合到一个框架中,并提供标准化的接口和评估流程,使得研究人员能够方便地进行实验和比较。此外,Plasticine还提供了详细的文档和示例,降低了使用门槛。

关键设计:Plasticine框架的关键设计包括:1) 使用单文件实现各种缓解方法,方便研究人员阅读和修改代码;2) 提供多种评估指标,从不同角度量化塑性损失;3) 提供可配置的学习环境,允许研究人员控制环境的非平稳性程度;4) 使用模块化的设计,方便研究人员扩展和定制框架。

🖼️ 关键图片

📊 实验亮点

Plasticine框架提供了超过13种缓解塑性损失的方法和10种评估指标,并在多种学习环境中进行了测试。实验结果表明,不同的缓解方法在不同的环境中表现不同,Plasticine框架可以帮助研究人员选择合适的缓解方法,并优化其参数。该框架还提供了详细的实验报告和可视化工具,方便研究人员分析实验结果。

🎯 应用场景

Plasticine框架可应用于开发具有持续学习能力的智能体,例如机器人、游戏AI和自动驾驶系统。通过优化塑性,这些智能体可以更好地适应不断变化的环境,并在长时间内保持高性能。该框架还有助于研究人员理解大脑的学习机制,并开发更有效的机器学习算法。

📄 摘要(原文)

Developing lifelong learning agents is crucial for artificial general intelligence. However, deep reinforcement learning (RL) systems often suffer from plasticity loss, where neural networks gradually lose their ability to adapt during training. Despite its significance, this field lacks unified benchmarks and evaluation protocols. We introduce Plasticine, the first open-source framework for benchmarking plasticity optimization in deep RL. Plasticine provides single-file implementations of over 13 mitigation methods, 10 evaluation metrics, and learning scenarios with increasing non-stationarity levels from standard to open-ended environments. This framework enables researchers to systematically quantify plasticity loss, evaluate mitigation strategies, and analyze plasticity dynamics across different contexts. Our documentation, examples, and source code are available at https://github.com/RLE-Foundation/Plasticine.