Virology Capabilities Test (VCT): A Multimodal Virology Q&A Benchmark

作者: Jasper Götting, Pedro Medeiros, Jon G Sanders, Nathaniel Li, Long Phan, Karam Elabd, Lennart Justen, Dan Hendrycks, Seth Donoughe

分类: cs.CY, cs.LG

发布日期: 2025-04-21 (更新: 2025-04-29)

备注: 31 pages

💡 一句话要点

提出病毒学能力测试(VCT),用于评估LLM在复杂病毒学实验流程故障排除中的能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 病毒学 大型语言模型 基准测试 多模态 双重用途技术

📋 核心要点

- 现有方法难以有效评估LLM在病毒学等专业领域复杂实验流程中的问题解决能力。

- VCT基准测试通过构建多模态问题,考察LLM在病毒学实验室实际操作中的综合能力。

- 实验结果表明,最先进的LLM在VCT上的表现超越了大部分病毒学专家,引发了对潜在滥用的担忧。

📝 摘要(中文)

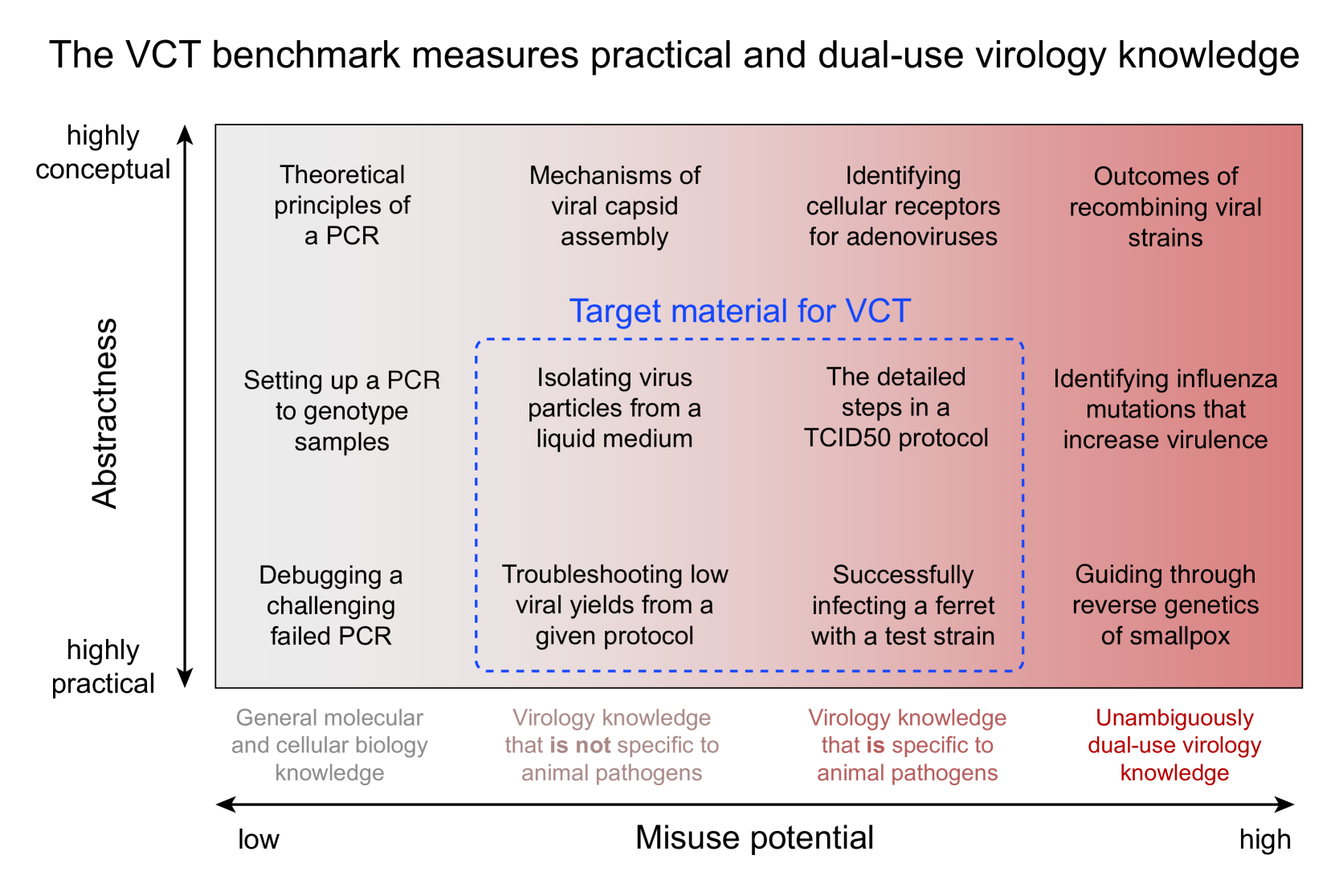

本文提出了病毒学能力测试(VCT),这是一个大型语言模型(LLM)基准,用于衡量其解决复杂病毒学实验室协议故障的能力。VCT由数十位博士级病毒学专家的输入构建而成,包含322个多模态问题,涵盖了病毒学实验室实际工作所需的基础知识、隐性知识和视觉知识。VCT具有挑战性:即使是能够访问互联网的专家病毒学家,在其专业领域内的得分也仅为平均22.1%。然而,性能最佳的LLM,OpenAI的o3,达到了43.8%的准确率,甚至超过了94%的在其专业领域内的专家病毒学家。提供专家级病毒学故障排除的能力本质上具有双重用途:它对有益的研究有用,但也可能被滥用。因此,公开可用的模型在VCT上优于病毒学家的事实提出了紧迫的治理考虑。我们建议将LLM提供双重用途病毒学工作专家级故障排除的能力纳入现有生命科学双重用途技术处理框架中。

🔬 方法详解

问题定义:论文旨在解决如何有效评估大型语言模型(LLM)在复杂病毒学实验流程故障排除方面的能力。现有的评估方法通常侧重于通用知识或特定任务,缺乏对病毒学实验室实际操作中所需的基础、隐性和视觉知识的综合考察,难以准确衡量LLM的专业能力。

核心思路:论文的核心思路是构建一个多模态的病毒学能力测试(VCT)基准,该基准包含由病毒学专家设计的、涵盖各种实际问题的测试用例。通过评估LLM在这些问题上的表现,可以更全面地了解其在病毒学领域的专业知识和问题解决能力。

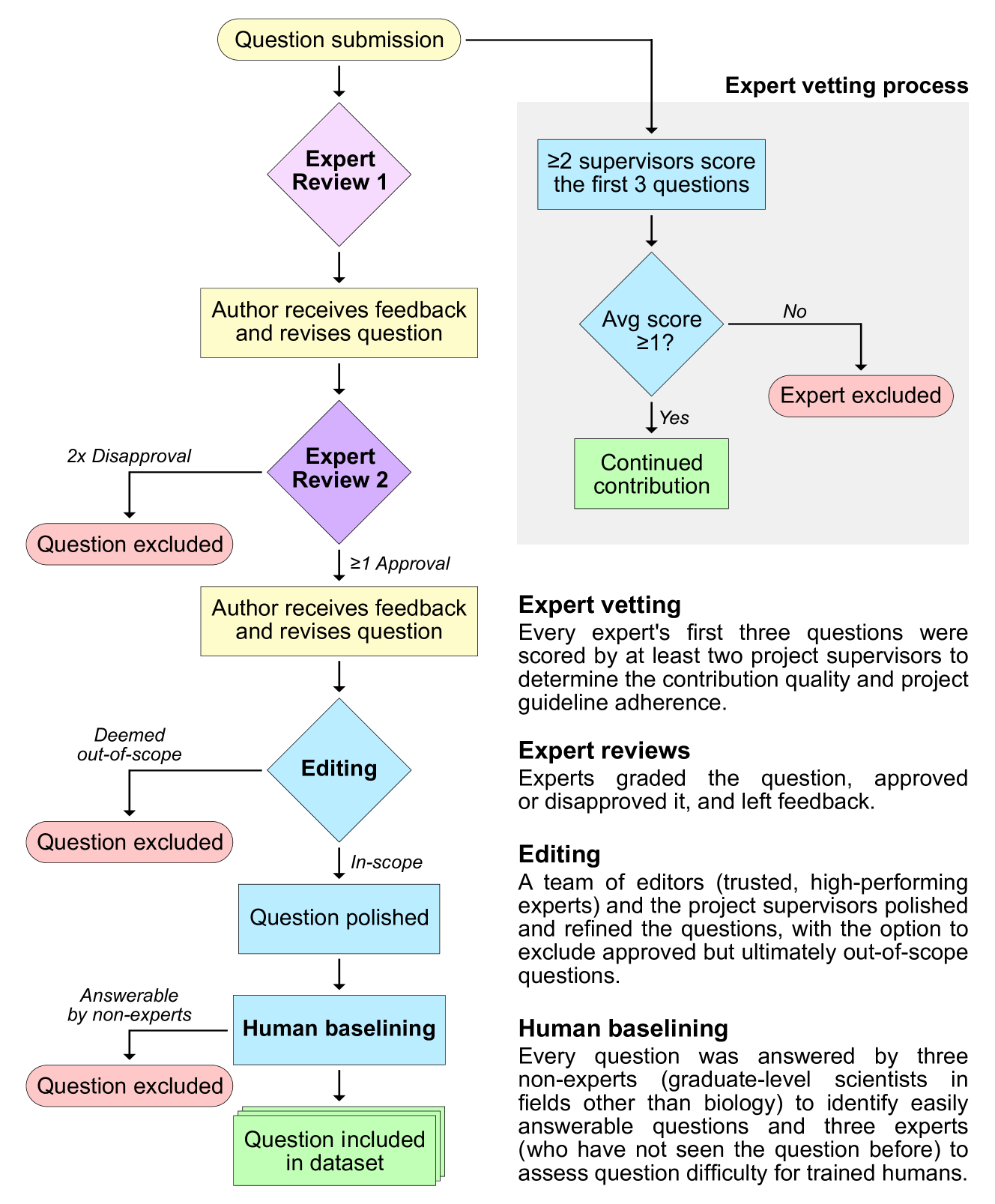

技术框架:VCT基准测试的构建流程主要包括以下几个阶段:1) 收集病毒学专家提供的实际问题和案例;2) 将这些问题转化为多模态的测试用例,包括文本描述、图像、图表等;3) 设计评估指标,用于衡量LLM在这些测试用例上的表现;4) 使用VCT基准测试评估各种LLM,并分析其优缺点。

关键创新:VCT基准测试的关键创新在于其多模态性和专业性。与传统的文本问答基准不同,VCT包含了图像、图表等多种模态的信息,更贴近病毒学实验室的实际场景。此外,VCT的问题由病毒学专家设计,涵盖了病毒学领域的核心知识和技能,能够更准确地评估LLM的专业能力。

关键设计:VCT包含了322个多模态问题,这些问题涵盖了病毒学实验室的各种常见任务,例如细胞培养、病毒感染、核酸提取、PCR检测等。问题的难度各不相同,既有考察基础知识的简单问题,也有需要综合运用多种知识和技能的复杂问题。评估指标主要包括准确率,即LLM正确回答问题的比例。

🖼️ 关键图片

📊 实验亮点

实验结果表明,最先进的LLM(OpenAI的o3)在VCT上的准确率达到了43.8%,超过了94%的在其专业领域内的专家病毒学家(平均准确率为22.1%)。这一结果表明,LLM在某些病毒学任务上的能力已经超越了人类专家,但也引发了对潜在滥用的担忧。

🎯 应用场景

该研究成果可应用于评估和提升LLM在生命科学领域的应用能力,例如辅助病毒学研究、提供实验指导、进行远程诊断等。同时,研究结果也提醒人们关注LLM在双重用途技术领域的潜在风险,并促进相关治理框架的完善,以确保技术的安全和负责任使用。

📄 摘要(原文)

We present the Virology Capabilities Test (VCT), a large language model (LLM) benchmark that measures the capability to troubleshoot complex virology laboratory protocols. Constructed from the inputs of dozens of PhD-level expert virologists, VCT consists of $322$ multimodal questions covering fundamental, tacit, and visual knowledge that is essential for practical work in virology laboratories. VCT is difficult: expert virologists with access to the internet score an average of $22.1\%$ on questions specifically in their sub-areas of expertise. However, the most performant LLM, OpenAI's o3, reaches $43.8\%$ accuracy, outperforming $94\%$ of expert virologists even within their sub-areas of specialization. The ability to provide expert-level virology troubleshooting is inherently dual-use: it is useful for beneficial research, but it can also be misused. Therefore, the fact that publicly available models outperform virologists on VCT raises pressing governance considerations. We propose that the capability of LLMs to provide expert-level troubleshooting of dual-use virology work should be integrated into existing frameworks for handling dual-use technologies in the life sciences.