Achieving Optimal Tissue Repair Through MARL with Reward Shaping and Curriculum Learning

作者: Muhammad Al-Zafar Khan, Jamal Al-Karaki

分类: cs.LG, cs.AI, cs.MA

发布日期: 2025-04-14

备注: 14 pages, 4 figures, submitted to the 10th International Conference on Information and Communication Technology for Intelligent Systems (ICTIS)

💡 一句话要点

提出基于MARL的组织修复框架,通过奖励塑造和课程学习优化修复过程

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多智能体强化学习 组织修复 奖励塑造 课程学习 生物制剂 反应扩散系统 神经同步 电化学通信

📋 核心要点

- 现有组织修复方法在动态控制和空间协调方面存在不足,难以应对复杂修复场景。

- 利用多智能体强化学习,结合生物学信息,设计奖励函数和课程学习,实现组织修复过程的优化。

- 通过计算机实验验证,该方法能够涌现出有效的修复策略,包括动态分泌控制和空间协调。

📝 摘要(中文)

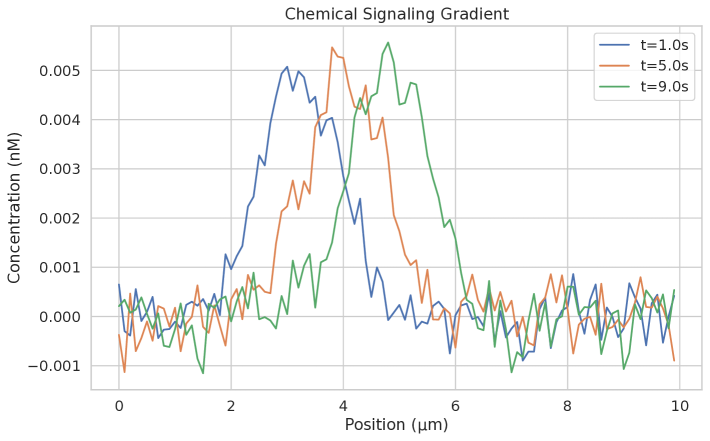

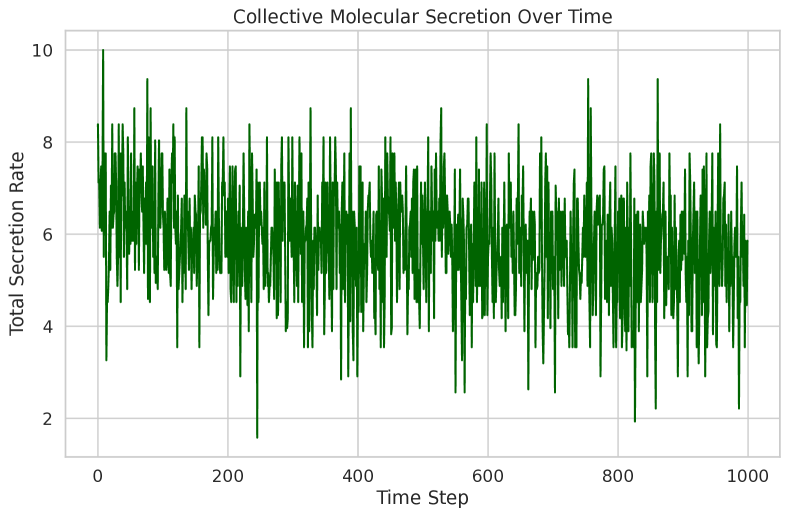

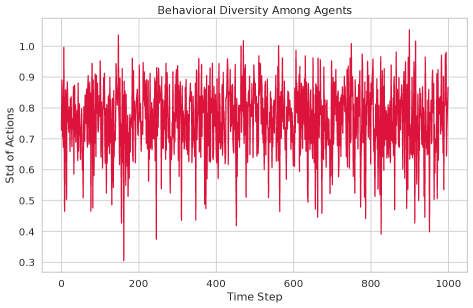

本文提出了一种多智能体强化学习(MARL)框架,用于优化使用工程生物制剂的组织修复过程。该方法集成了:(1)模拟分子信号传导的随机反应扩散系统;(2)具有赫布可塑性的类神经电化学通信;(3)结合化学梯度追踪、神经同步和鲁棒惩罚的生物信息奖励函数。课程学习方案引导智能体完成逐渐复杂的修复场景。计算机实验证明了涌现的修复策略,包括动态分泌控制和空间协调。

🔬 方法详解

问题定义:论文旨在解决如何利用工程生物制剂更有效地修复组织损伤的问题。现有方法在动态控制生物制剂的分泌和空间协调方面存在局限性,难以应对复杂的组织修复场景,例如需要精确控制不同类型细胞的分布和活性,以及应对复杂的化学信号环境。

核心思路:论文的核心思路是将组织修复过程建模为一个多智能体强化学习问题,其中每个智能体代表一个生物制剂。通过设计合适的奖励函数,鼓励智能体学习到有效的修复策略,包括动态控制分泌和空间协调。课程学习则用于引导智能体逐步学习更复杂的修复任务。

技术框架:该框架包含以下主要模块:1) 随机反应扩散系统:用于模拟分子信号传导,提供智能体所处的环境信息。2) 类神经电化学通信:模拟生物制剂之间的通信,采用具有赫布可塑性的机制,使智能体能够学习到协作策略。3) 奖励函数:结合化学梯度追踪、神经同步和鲁棒惩罚,引导智能体学习到期望的修复行为。4) 多智能体强化学习算法:用于训练智能体,使其能够根据环境信息和奖励信号,学习到最优的修复策略。5) 课程学习:通过逐步增加修复任务的难度,提高智能体的学习效率和泛化能力。

关键创新:该论文的关键创新在于将多智能体强化学习与生物学知识相结合,设计了一个生物信息驱动的组织修复框架。具体来说,通过模拟分子信号传导和生物制剂之间的通信,使智能体能够更好地理解和适应生物环境。此外,奖励函数的设计也充分考虑了生物学原理,例如化学梯度追踪和神经同步,从而引导智能体学习到更自然的修复行为。

关键设计:奖励函数是该方法中的一个关键设计。它由三部分组成:化学梯度追踪奖励,鼓励智能体向损伤区域移动;神经同步奖励,鼓励智能体之间进行协作;鲁棒惩罚,防止智能体采取有害的行为。此外,课程学习方案也至关重要,它通过逐步增加修复任务的难度,使智能体能够更好地学习到复杂的修复策略。具体的参数设置和网络结构等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

论文通过计算机实验验证了该方法的有效性。实验结果表明,该方法能够涌现出有效的修复策略,包括动态分泌控制和空间协调。具体性能数据和对比基线在摘要中未提及,属于未知信息。但整体而言,该研究为利用人工智能优化组织修复过程提供了一个有前景的解决方案。

🎯 应用场景

该研究具有广泛的应用前景,可用于开发更有效的组织修复疗法,例如伤口愈合、骨骼再生和器官修复。通过优化生物制剂的活性和分布,可以加速组织修复过程,提高修复质量,并减少并发症的发生。此外,该框架还可以用于研究组织修复的生物学机制,为开发新的治疗策略提供理论指导。

📄 摘要(原文)

In this paper, we present a multi-agent reinforcement learning (MARL) framework for optimizing tissue repair processes using engineered biological agents. Our approach integrates: (1) stochastic reaction-diffusion systems modeling molecular signaling, (2) neural-like electrochemical communication with Hebbian plasticity, and (3) a biologically informed reward function combining chemical gradient tracking, neural synchronization, and robust penalties. A curriculum learning scheme guides the agent through progressively complex repair scenarios. In silico experiments demonstrate emergent repair strategies, including dynamic secretion control and spatial coordination.