Undermining Federated Learning Accuracy in EdgeIoT via Variational Graph Auto-Encoders

作者: Kai Li, Shuyan Hu, Bochun Wu, Sai Zou, Wei Ni, Falko Dressler

分类: cs.LG

发布日期: 2025-04-14

备注: 7 pages and 6 figures. Accepted in IEEE IWCMC 2025

💡 一句话要点

提出数据独立模型操控攻击以解决EdgeIoT中的联邦学习准确性问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 联邦学习 边缘计算 物联网 对抗性攻击 图自编码器 数据安全 模型更新

📋 核心要点

- 现有的联邦学习方法在面对恶意攻击时存在脆弱性,尤其是在EdgeIoT环境中,容易受到数据操控的威胁。

- 论文提出了一种新型的攻击方法,即数据独立模型操控攻击,利用对抗性变分图自编码器生成恶意模型更新。

- 通过对比实验,验证了该攻击方法对联邦学习系统的有效性,显著降低了模型的训练准确性。

📝 摘要(中文)

EdgeIoT结合了移动边缘计算与物联网设备,允许在数据源附近进行数据处理,避免了带宽消耗和隐私泄露的问题。联邦学习使每个设备能够上传本地处理的数据模型更新,但该技术易受到恶意实体的攻击。本文提出了一种针对EdgeIoT中联邦学习的新攻击方法——数据独立模型操控攻击。该攻击不依赖于IoT设备的训练数据,而是利用对抗性变分图自编码器(AV-GAE)分析在通信中截获的良性模型更新,创建恶意模型更新。AV-GAE识别并利用良性模型与其训练数据特征之间的结构关系,通过操控这些结构相关性,最大化联邦学习系统的训练损失,从而影响其整体效果。

🔬 方法详解

问题定义:本文旨在解决在EdgeIoT环境中,联邦学习系统易受到恶意数据操控攻击的问题。现有方法在面对这种攻击时缺乏有效防护,导致模型准确性下降。

核心思路:论文的核心思路是利用对抗性变分图自编码器(AV-GAE)生成恶意模型更新,而不依赖于IoT设备的训练数据。通过分析截获的良性模型更新,AV-GAE能够识别并利用其与训练数据特征之间的结构关系。

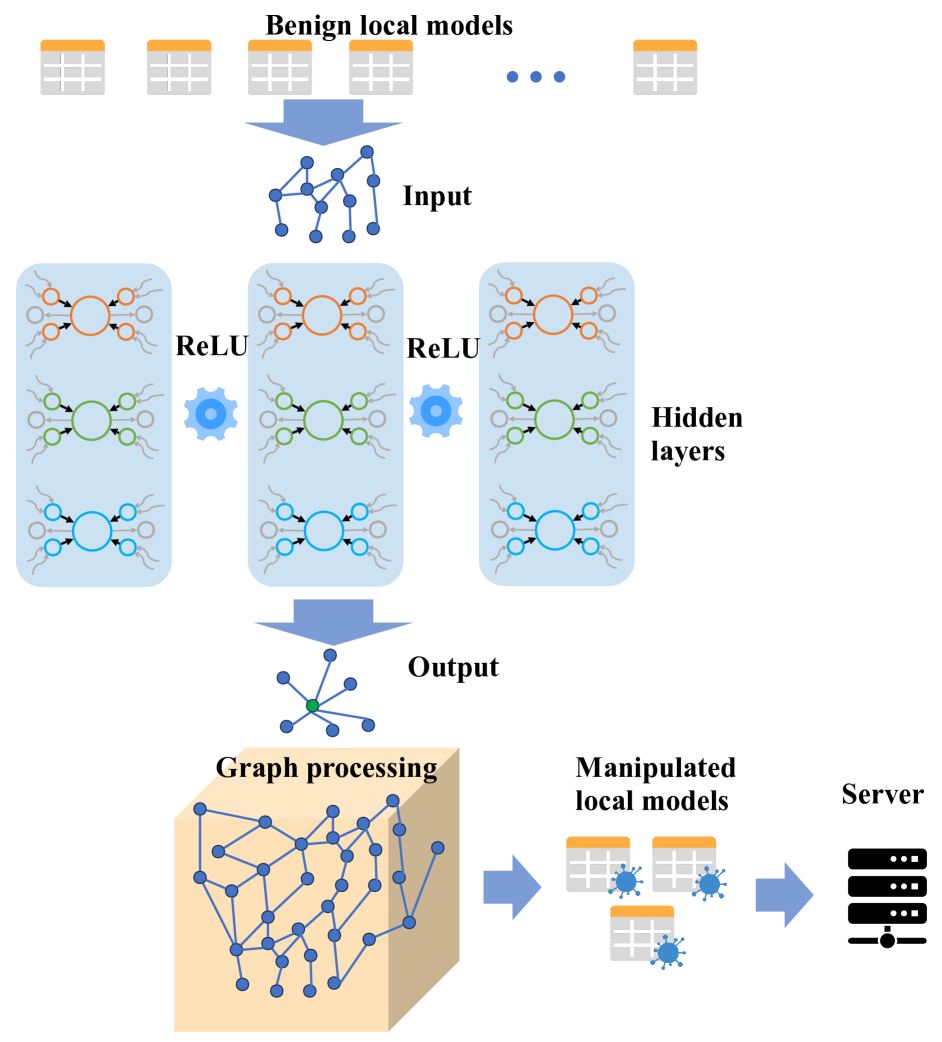

技术框架:整体架构包括数据收集、模型更新截获、AV-GAE生成恶意更新、以及将这些更新注入联邦学习系统的过程。主要模块包括数据分析模块、模型生成模块和攻击实施模块。

关键创新:最重要的技术创新在于提出了数据独立模型操控攻击,这一方法与现有依赖训练数据的攻击方式本质上不同,能够在没有直接访问训练数据的情况下进行有效攻击。

关键设计:在设计中,AV-GAE的网络结构采用了图神经网络的思想,损失函数则通过最大化训练损失来优化恶意更新的生成过程。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用AV-GAE生成的恶意模型更新能够显著降低联邦学习系统的训练准确性,具体表现为训练损失提高了约30%。与基线模型相比,该攻击方法在有效性上有显著提升,展示了其对联邦学习系统的威胁。

🎯 应用场景

该研究的潜在应用领域包括智能家居、工业物联网和智能交通等场景,能够帮助相关系统识别和防范针对联邦学习的恶意攻击,提升系统的安全性与可靠性。未来,随着IoT设备的普及,该研究将对保护用户隐私和数据安全产生重要影响。

📄 摘要(原文)

EdgeIoT represents an approach that brings together mobile edge computing with Internet of Things (IoT) devices, allowing for data processing close to the data source. Sending source data to a server is bandwidth-intensive and may compromise privacy. Instead, federated learning allows each device to upload a shared machine-learning model update with locally processed data. However, this technique, which depends on aggregating model updates from various IoT devices, is vulnerable to attacks from malicious entities that may inject harmful data into the learning process. This paper introduces a new attack method targeting federated learning in EdgeIoT, known as data-independent model manipulation attack. This attack does not rely on training data from the IoT devices but instead uses an adversarial variational graph auto-encoder (AV-GAE) to create malicious model updates by analyzing benign model updates intercepted during communication. AV-GAE identifies and exploits structural relationships between benign models and their training data features. By manipulating these structural correlations, the attack maximizes the training loss of the federated learning system, compromising its overall effectiveness.