Ordinary Least Squares as an Attention Mechanism

作者: Philippe Goulet Coulombe

分类: cs.LG, econ.EM, math.ST, stat.ML

发布日期: 2025-04-13 (更新: 2026-01-09)

💡 一句话要点

将普通最小二乘法(OLS)重构为一种受限的注意力机制,为理解注意力机制提供新视角。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 普通最小二乘法 注意力机制 时间序列分析 计量经济学 嵌入空间 相似性学习

📋 核心要点

- 现有注意力机制主要基于信息检索框架,对于统计学背景的研究者而言理解存在一定门槛。

- 论文将普通最小二乘法(OLS)重新表述为一种受限的注意力机制,通过优化嵌入空间来最小化预测误差。

- 该方法将OLS映射到注意力机制的查询-键-值结构,并与时间序列计量经济学的经典思想建立了联系。

📝 摘要(中文)

本文证明了普通最小二乘法(OLS)预测可以被重写为一个受限的注意力模块的输出,类似于大型语言模型中的注意力机制。这种联系为注意力机制提供了一个超越传统信息检索框架的替代视角,使得具有传统统计学背景的研究人员和分析师更容易理解。当OLS被视为转换后的回归空间中基于相似性的方法时,这种联系就成立了,这与基于偏相关的标准观点不同。实际上,OLS解可以被重新定义为一个替代问题的结果:通过优化训练和测试向量通过内积进行比较的嵌入空间,来最小化平方预测误差。我们不是直接估计系数,而是等价地学习预测器的最优编码和解码操作。从这个角度来看,OLS自然地映射到注意力机制的查询-键-值结构。在此基础上,我讨论了Transformer风格注意力的关键要素,并将它们与时间序列计量经济学的经典思想联系起来。

🔬 方法详解

问题定义:论文旨在为理解注意力机制提供一个新的视角,现有方法主要基于信息检索框架,对于具有传统统计学背景的研究者而言,理解和应用存在一定门槛。论文希望通过建立OLS与注意力机制的联系,使得统计学背景的研究者更容易理解和应用注意力机制。

核心思路:论文的核心思路是将OLS预测重新表述为一个受限的注意力模块的输出。通过将OLS视为在转换后的回归空间中基于相似性的方法,并优化嵌入空间以最小化预测误差,从而将OLS映射到注意力机制的查询-键-值结构。

技术框架:论文的技术框架主要包含以下几个步骤:1. 将OLS视为在转换后的回归空间中基于相似性的方法。2. 将OLS解重新定义为一个替代问题,即通过优化嵌入空间来最小化平方预测误差。3. 学习预测器的最优编码和解码操作。4. 将OLS映射到注意力机制的查询-键-值结构。5. 讨论Transformer风格注意力的关键要素,并将它们与时间序列计量经济学的经典思想联系起来。

关键创新:论文的关键创新在于将OLS与注意力机制联系起来,提供了一个超越传统信息检索框架的替代视角。通过优化嵌入空间,将OLS重新表述为一个受限的注意力模块,使得具有统计学背景的研究者更容易理解和应用注意力机制。

关键设计:论文的关键设计在于将OLS视为在转换后的回归空间中基于相似性的方法,并通过优化嵌入空间来最小化预测误差。具体而言,论文通过学习预测器的最优编码和解码操作,将OLS映射到注意力机制的查询-键-值结构。论文没有提供具体的参数设置或网络结构,而是侧重于理论上的联系和框架的构建。

🖼️ 关键图片

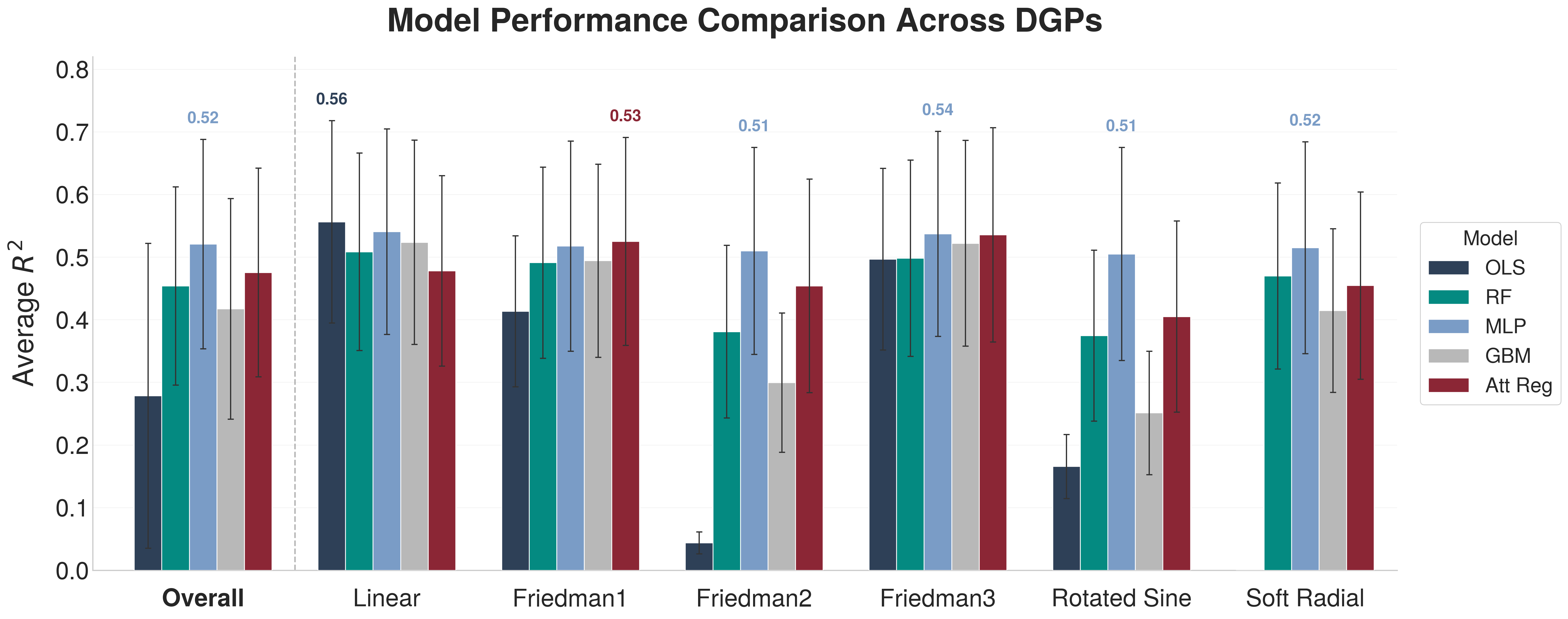

📊 实验亮点

论文的主要亮点在于建立了普通最小二乘法(OLS)与注意力机制之间的桥梁,为理解注意力机制提供了一个新的视角。虽然论文没有提供具体的实验数据,但其理论贡献在于将OLS重新表述为一个受限的注意力模块,使得统计学背景的研究者更容易理解和应用注意力机制。

🎯 应用场景

该研究成果可应用于时间序列分析、计量经济学等领域,为这些领域的模型设计提供新的思路。通过将传统统计方法与深度学习中的注意力机制相结合,可以开发出更具解释性和鲁棒性的预测模型。此外,该研究也有助于促进统计学和机器学习领域的交叉融合。

📄 摘要(原文)

I show that ordinary least squares (OLS) predictions can be rewritten as the output of a restricted attention module, akin to those forming the backbone of large language models. This connection offers an alternative perspective on attention beyond the conventional information retrieval framework, making it more accessible to researchers and analysts with a background in traditional statistics. It falls into place when OLS is framed as a similarity-based method in a transformed regressor space, distinct from the standard view based on partial correlations. In fact, the OLS solution can be recast as the outcome of an alternative problem: minimizing squared prediction errors by optimizing the embedding space in which training and test vectors are compared via inner products. Rather than estimating coefficients directly, we equivalently learn optimal encoding and decoding operations for predictors. From this vantage point, OLS maps naturally onto the query-key-value structure of attention mechanisms. Building on this foundation, I discuss key elements of Transformer-style attention and draw connections to classic ideas from time series econometrics.