GenEDA: Towards Generative Netlist Functional Reasoning via Cross-Modal Circuit Encoder-Decoder Alignment

作者: Wenji Fang, Jing Wang, Yao Lu, Shang Liu, Zhiyao Xie

分类: cs.LG, cs.AR

发布日期: 2025-04-13 (更新: 2025-08-06)

备注: Accepted by ICCAD'25

💡 一句话要点

GenEDA:通过跨模态电路编码器-解码器对齐实现生成式网表功能推理

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 电路基础模型 跨模态对齐 生成式模型 网表功能推理 大型语言模型 电路表示学习 集成电路设计

📋 核心要点

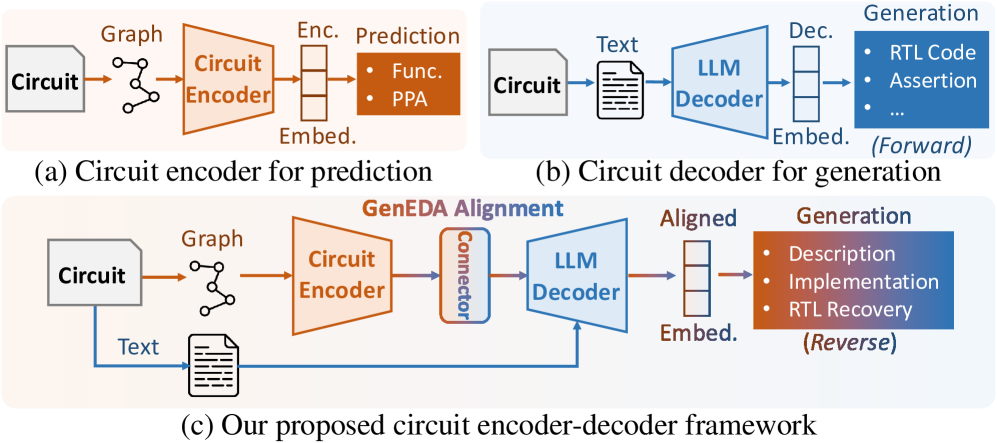

- 现有电路基础模型通常局限于用于预测任务的独立编码器或用于生成任务的解码器,两者独立开发,限制了它们相互补充以实现更高级功能的能力。

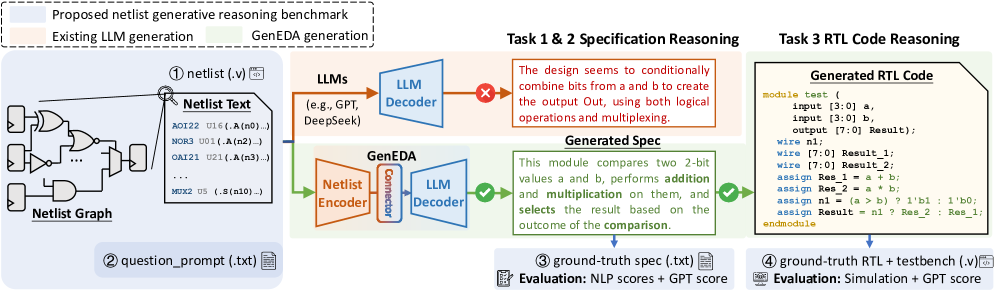

- GenEDA通过跨模态对齐电路编码器和解码器,弥合了图表示电路学习和文本LLM之间的鸿沟,使得LLM能够理解和生成电路网表。

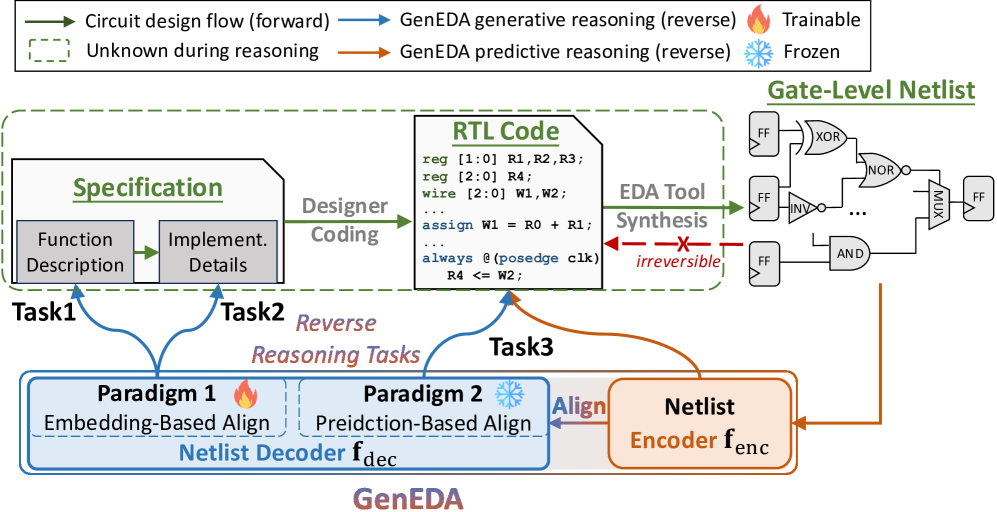

- GenEDA在三个生成式网表功能推理任务中显著提升了高级LLM的性能,能够从低级网表反向生成高级功能描述,超越了传统门级功能分类。

📝 摘要(中文)

本文提出GenEDA,首个在共享潜在空间中跨模态对齐电路编码器和解码器的框架。GenEDA弥合了基于图的电路表示学习和基于文本的大型语言模型(LLM)之间的差距,实现了它们各自潜在空间之间的通信。为了实现对齐,我们提出了两种范例,以支持开源可训练的LLM和商业冻结的LLM。我们利用这种对齐的架构来开发第一个用于网表的生成式基础模型,在低级和位爆炸的网表上释放LLM的生成推理能力。GenEDA实现了三个前所未有的生成式网表功能推理任务,它可以从低级网表反向生成高级功能,例如规范和RTL代码。这些任务超越了传统的门功能分类,直接生成完整的电路功能。实验表明,GenEDA显著提高了高级LLM(例如,GPT和DeepSeek系列)在所有任务中的性能。

🔬 方法详解

问题定义:现有电路基础模型主要分为两类:基于编码器的模型用于预测任务,基于解码器的模型用于生成任务。这两类模型独立发展,操作于不同的电路模态(例如图和文本),并存在于不同的潜在空间中。这阻碍了它们相互协作,无法实现更高级的电路功能推理,例如从低级网表推断高级功能。

核心思路:GenEDA的核心思路是跨模态对齐电路编码器和解码器,将它们映射到共享的潜在空间中。这样,基于图的电路编码器可以提取电路的结构信息,并将其传递给基于文本的LLM解码器,从而利用LLM的生成能力来推理电路的功能。通过这种方式,GenEDA能够将LLM的生成能力应用于低级网表,实现从网表到高级功能描述的生成。

技术框架:GenEDA框架包含一个电路编码器和一个LLM解码器。电路编码器负责将电路网表转换为潜在空间中的向量表示。LLM解码器则负责将潜在向量解码为高级功能描述,例如规范或RTL代码。为了实现编码器和解码器的对齐,GenEDA提出了两种范例:一种适用于开源可训练的LLM,另一种适用于商业冻结的LLM。具体实现细节未知。

关键创新:GenEDA最重要的创新点在于跨模态对齐电路编码器和LLM解码器,从而实现了生成式网表功能推理。与传统的电路模型不同,GenEDA不仅可以进行预测任务(例如门功能分类),还可以生成高级功能描述,从而更好地理解电路的功能。这是第一个将LLM的生成能力应用于电路网表的框架。

关键设计:论文中提到两种对齐范式,分别针对开源可训练LLM和商业冻结LLM,但具体实现细节未知。损失函数的设计目标是最小化编码器和解码器在共享潜在空间中的距离,从而实现对齐。具体的网络结构和参数设置未知。

🖼️ 关键图片

📊 实验亮点

GenEDA在三个生成式网表功能推理任务中显著提升了高级LLM(例如,GPT和DeepSeek系列)的性能。具体性能数据和提升幅度在摘要中未给出,需要在论文正文中查找。该结果表明,GenEDA能够有效地利用LLM的生成能力来理解和推理电路功能,为电路设计自动化开辟了新的方向。

🎯 应用场景

GenEDA在集成电路设计领域具有广泛的应用前景。它可以用于自动生成电路规范、RTL代码,辅助电路设计人员进行功能验证和调试,加速电路设计流程。此外,GenEDA还可以用于逆向工程,从已有的电路网表中推断其功能,从而帮助理解和分析未知电路。该研究的未来影响在于推动电路设计自动化和智能化,提高电路设计的效率和质量。

📄 摘要(原文)

The success of foundation AI has motivated the research of circuit foundation models, which are customized to assist the integrated circuit (IC) design process. However, existing pre-trained circuit foundation models are typically limited to standalone encoders for predictive tasks or decoders for generative tasks. These two model types are developed independently, operate on different circuit modalities, and reside in separate latent spaces. This restricts their ability to complement each other for more advanced capabilities. In this work, we present GenEDA, the first framework that cross-modally aligns circuit encoders with decoders within a shared latent space. GenEDA bridges the gap between graph-based circuit representation learning and text-based large language models (LLMs), enabling communication between their respective latent spaces. To achieve the alignment, we propose two paradigms to support both open-source trainable LLMs and commercial frozen LLMs. We leverage this aligned architecture to develop the first generative foundation model for netlists, unleashing LLMs' generative reasoning capability on the low-level and bit-blasted netlists. GenEDA enables three unprecedented generative netlist functional reasoning tasks, where it reversely generates high-level functionalities such as specifications and RTL code from low-level netlists. These tasks move beyond traditional gate function classification to direct generation of full-circuit functionality. Experiments demonstrate that GenEDA significantly boosts advanced LLMs' (e.g., GPT and DeepSeek series) performance in all tasks.