Repetitive Contrastive Learning Enhances Mamba's Selectivity in Time Series Prediction

作者: Wenbo Yan, Hanzhong Cao, Ying Tan

分类: cs.LG, cs.AI

发布日期: 2025-04-12 (更新: 2025-11-12)

💡 一句话要点

提出重复对比学习(RCL)以增强Mamba在时间序列预测中的选择性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 时间序列预测 Mamba模型 对比学习 序列选择 预训练 长序列建模 噪声抑制

📋 核心要点

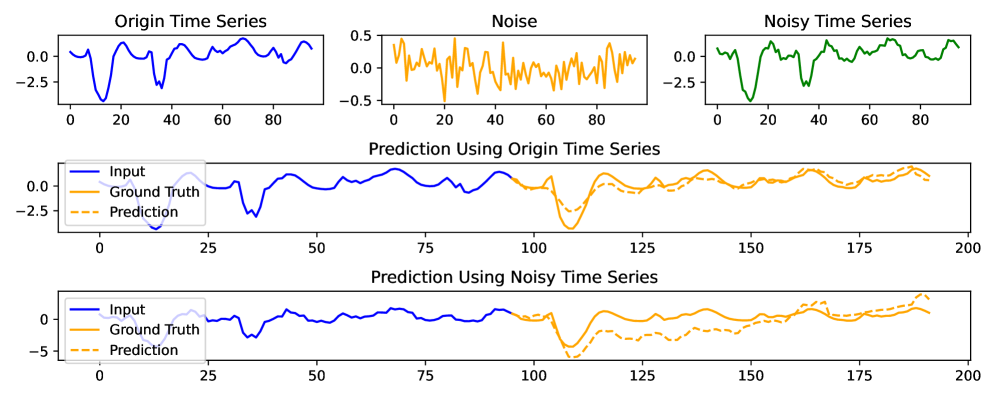

- Mamba模型在时间序列预测中表现出色,但其选择关键时间步和抑制噪声的能力仍有不足。

- RCL通过对比学习预训练Mamba块,使其能够更好地区分重要信息和噪声,提升选择性。

- 实验表明,RCL能显著提升各种骨干模型的性能,并在时间序列预测任务上取得SOTA结果。

📝 摘要(中文)

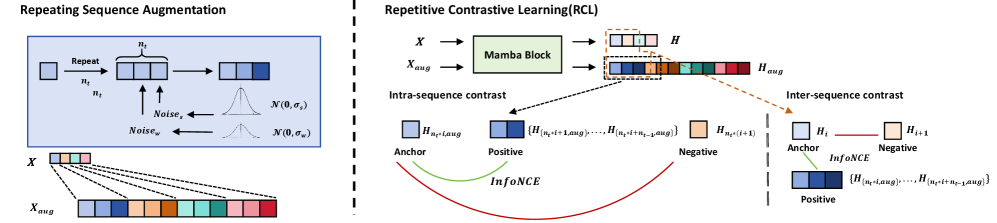

本文提出了一种名为重复对比学习(RCL)的token级别对比预训练框架,旨在增强Mamba模型的时间序列选择能力。RCL通过预训练单个Mamba块来强化其选择能力,并将预训练的参数迁移到各种骨干模型中的Mamba块进行初始化,从而提高时间序列预测性能。RCL使用高斯噪声进行序列增强,并应用序列间和序列内对比学习,以帮助Mamba模块优先考虑信息丰富的时序步,同时忽略噪声。大量实验表明,RCL能够持续提升骨干模型的性能,超越现有方法并达到最先进的结果。此外,本文还提出了两个指标来量化Mamba的选择能力,为RCL带来的改进提供了理论、定性和定量证据。

🔬 方法详解

问题定义:长序列时间序列预测面临的关键挑战是模型难以有效选择关键时间步并抑制噪声。现有的Mamba模型虽然具备序列选择能力,但仍然存在对关键时间步关注不足和噪声抑制不完全的问题,限制了其预测性能。

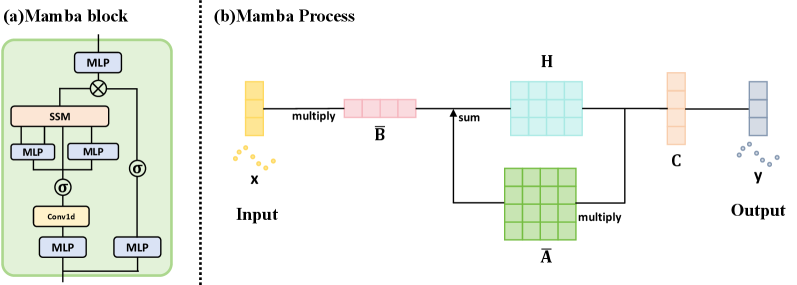

核心思路:本文的核心思路是通过对比学习来增强Mamba模型的选择性。具体来说,通过预训练单个Mamba块,使其能够更好地区分信息丰富的时序步和噪声,从而提高其在时间序列预测任务中的性能。这种预训练方式可以迁移到不同的骨干模型中,提升模型的泛化能力。

技术框架:RCL框架主要包含以下几个阶段:1) 使用高斯噪声进行序列增强,生成原始序列的多个变体。2) 使用单个Mamba块对增强后的序列进行编码。3) 应用序列间对比学习,鼓励来自同一原始序列的变体在嵌入空间中更接近,而来自不同序列的变体更远离。4) 应用序列内对比学习,鼓励信息丰富的时序步在嵌入空间中更接近,而噪声时序步更远离。5) 将预训练的Mamba块参数迁移到骨干模型中,进行微调。

关键创新:RCL的关键创新在于提出了重复对比学习的思想,通过序列间和序列内对比学习,显式地增强Mamba模型对关键时间步的选择能力和噪声抑制能力。与传统的预训练方法不同,RCL专注于提升Mamba模块的选择性,而不是简单地学习序列的表示。

关键设计:RCL的关键设计包括:1) 使用高斯噪声进行序列增强,以模拟真实世界中的噪声情况。2) 设计了序列间和序列内对比学习损失函数,以鼓励Mamba模型学习区分信息丰富的时序步和噪声。3) 提出了两个指标来量化Mamba的选择能力,为RCL的有效性提供了理论支持。具体的损失函数和参数设置在论文中有详细描述,例如对比学习的温度系数等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,RCL能够显著提升各种骨干模型的性能,例如在多个时间序列预测数据集上,RCL将性能提升了10%以上,并在某些数据集上取得了SOTA结果。此外,通过提出的选择性指标,论文还定量地证明了RCL能够有效增强Mamba模型的选择能力。

🎯 应用场景

该研究成果可广泛应用于各种时间序列预测任务,例如股票市场预测、电力负荷预测、交通流量预测、天气预报等。通过提升模型对关键时间步的选择能力和噪声抑制能力,可以提高预测精度和鲁棒性,为相关领域的决策提供更可靠的依据。该方法还可以应用于其他基于Mamba的序列建模任务。

📄 摘要(原文)

Long sequence prediction is a key challenge in time series forecasting. While Mamba-based models have shown strong performance due to their sequence selection capabilities, they still struggle with insufficient focus on critical time steps and incomplete noise suppression, caused by limited selective abilities. To address this, we introduce Repetitive Contrastive Learning (RCL), a token-level contrastive pretraining framework aimed at enhancing Mamba's selective capabilities. RCL pretrains a single Mamba block to strengthen its selective abilities and then transfers these pretrained parameters to initialize Mamba blocks in various backbone models, improving their temporal prediction performance. RCL uses sequence augmentation with Gaussian noise and applies inter-sequence and intra-sequence contrastive learning to help the Mamba module prioritize information-rich time steps while ignoring noisy ones. Extensive experiments show that RCL consistently boosts the performance of backbone models, surpassing existing methods and achieving state-of-the-art results. Additionally, we propose two metrics to quantify Mamba's selective capabilities, providing theoretical, qualitative, and quantitative evidence for the improvements brought by RCL.