Position: Beyond Euclidean -- Foundation Models Should Embrace Non-Euclidean Geometries

作者: Neil He, Jiahong Liu, Buze Zhang, Ngoc Bui, Ali Maatouk, Menglin Yang, Irwin King, Melanie Weber, Rex Ying

分类: cs.LG, cs.AI

发布日期: 2025-04-11 (更新: 2025-11-24)

备注: 27 pages, 6 figures, LoG Conference 2025

💡 一句话要点

提出非欧几何嵌入,提升下一代大模型处理复杂结构数据的能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 非欧几何 基础模型 几何深度学习 表示学习 图神经网络

📋 核心要点

- 现有基础模型主要依赖欧几里得空间,难以有效捕捉真实世界数据中普遍存在的非欧结构。

- 论文核心思想是采用非欧几何嵌入,使模型能更有效地处理多向关系、层次结构等复杂数据结构。

- 通过理论分析和实验验证,表明非欧几何嵌入能提升模型效率和表达能力,并提出了集成路线图。

📝 摘要(中文)

在大型语言模型(LLMs)和基础模型的时代,欧几里得空间已成为机器学习架构中默认的几何设置。然而,最近的研究表明,这种选择存在根本性的局限性。大规模的真实世界数据通常表现出固有的非欧几里得结构,例如多向关系、层次结构、对称性和非各向同性缩放,这些存在于语言、视觉和自然科学等各种领域。在欧几里得空间的约束下,有效地捕获这些结构是具有挑战性的。本文提出,超越欧几里得几何不仅仅是一种可选的增强,而是维持下一代基础模型扩展律的必要条件。通过采用这些几何结构,基础模型可以更有效地利用上述结构。任务感知的适应性可以动态地重新配置嵌入,以匹配下游应用的几何结构,从而进一步提高效率和表达能力。我们的观点得到了一系列对流行基础模型的理论和实证研究的支持。最后,我们概述了将非欧几里得几何集成到基础模型中的路线图,包括通过微调、从头开始训练和混合方法构建几何基础模型的策略。

🔬 方法详解

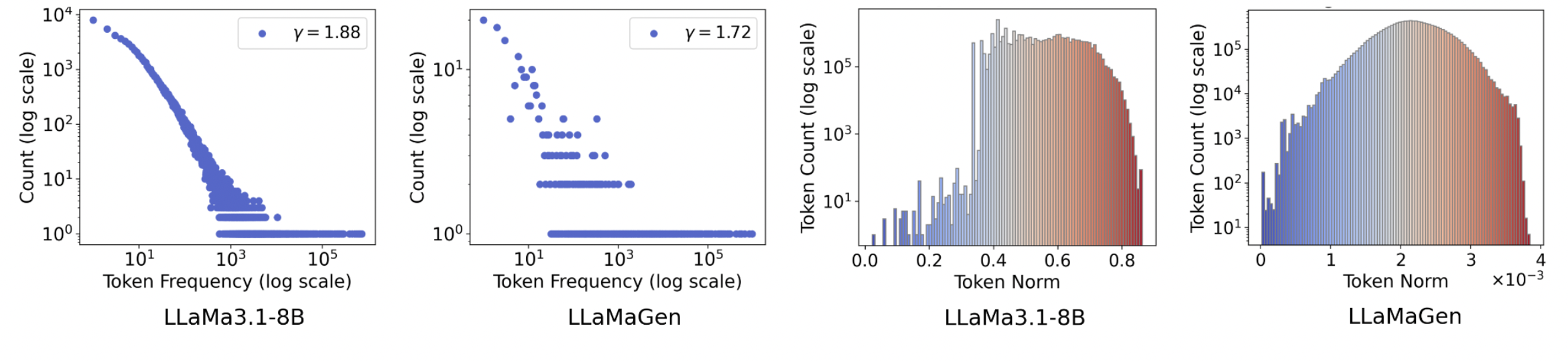

问题定义:现有的大型语言模型和基础模型主要依赖于欧几里得空间进行数据表示和学习。然而,现实世界的数据往往呈现出复杂的非欧几里得结构,例如社交网络中的多向关系、知识图谱中的层次结构、以及分子结构中的对称性等。欧几里得空间难以有效地捕捉和表达这些复杂的结构关系,限制了模型的性能和泛化能力。现有方法的痛点在于缺乏对数据内在几何结构的有效建模。

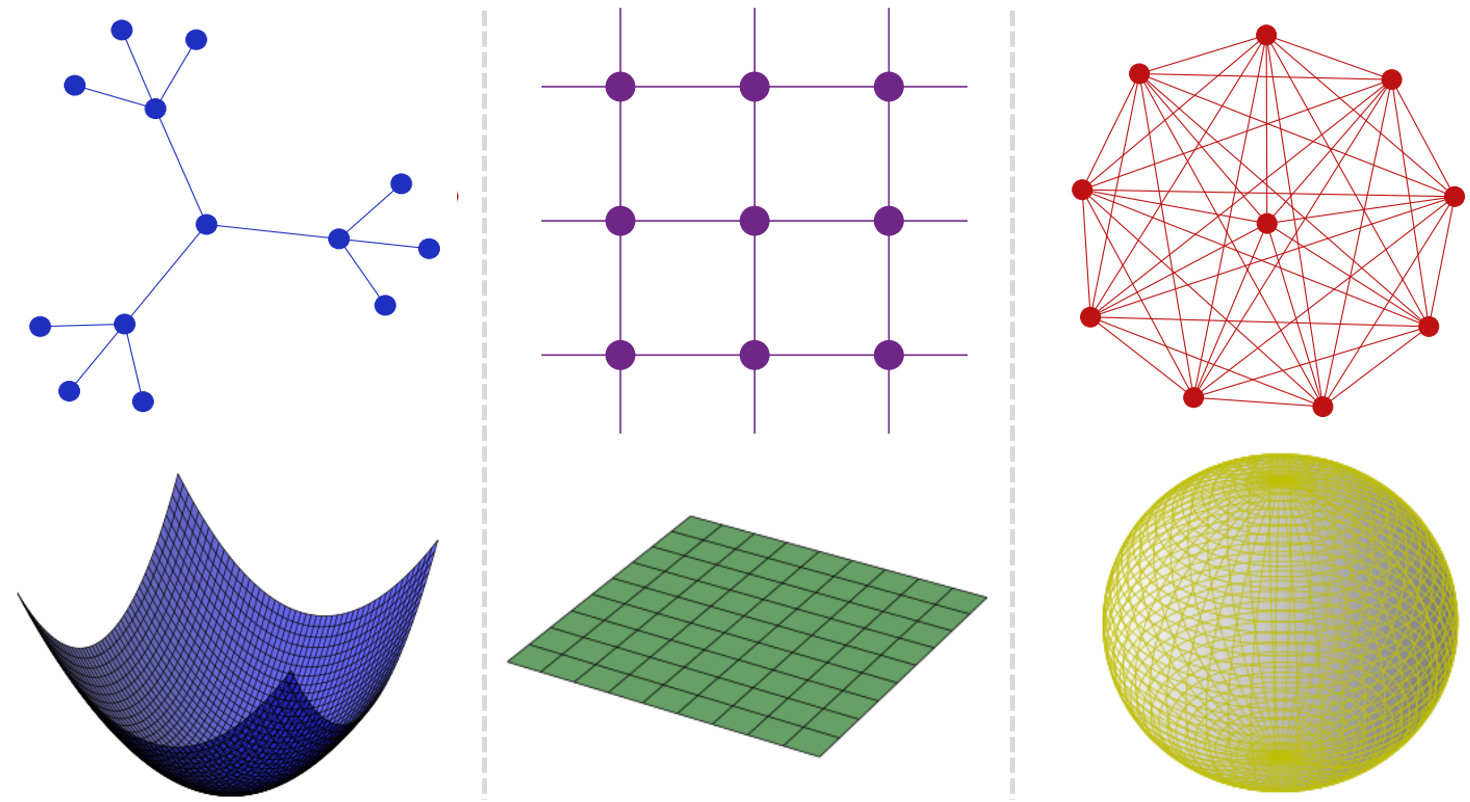

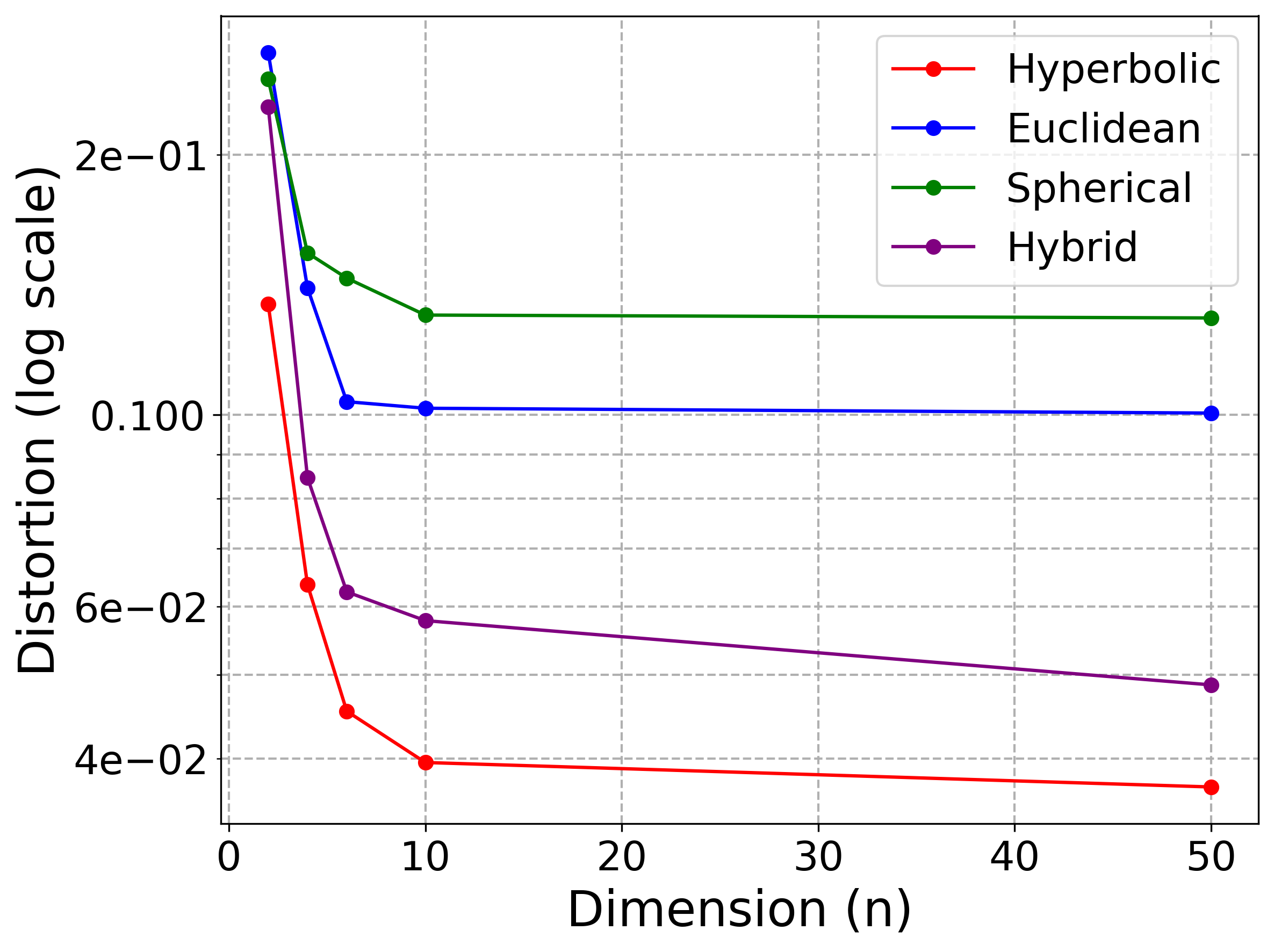

核心思路:论文的核心思路是利用非欧几里得几何(例如双曲几何、球面几何等)来嵌入和处理数据,从而更好地捕捉数据中固有的非欧结构。这种方法的核心在于,不同的几何空间具有不同的性质,能够更好地适应不同类型的数据结构。例如,双曲空间更适合表示层次结构,而球面空间更适合表示周期性数据。通过选择合适的非欧几何空间,可以更有效地表示和学习数据中的复杂关系。

技术框架:论文提出了一种将非欧几何集成到基础模型中的通用框架。该框架主要包含以下几个阶段:1) 数据分析:分析数据的内在几何结构,选择合适的非欧几何空间。2) 嵌入学习:将数据嵌入到选定的非欧几何空间中,学习数据的几何表示。3) 模型训练:在非欧几何空间中训练基础模型,利用几何信息提升模型性能。4) 任务适应:根据下游任务的特点,动态地调整嵌入和模型参数,以适应不同的几何结构。

关键创新:论文最重要的技术创新点在于提出了将非欧几何作为基础模型的核心组成部分,而不仅仅是作为一种可选的增强。这种方法能够使模型更有效地利用数据的内在几何结构,从而提升模型的性能和泛化能力。与现有方法的本质区别在于,现有方法通常将非欧几何作为一种预处理或后处理步骤,而论文提出的方法将非欧几何集成到模型的核心架构中。

关键设计:论文提出了几种关键的设计策略,包括:1) 几何空间的选择:根据数据的特点选择合适的非欧几何空间,例如双曲空间、球面空间等。2) 嵌入学习方法:设计有效的嵌入学习方法,将数据嵌入到选定的非欧几何空间中。3) 几何感知模型:设计能够感知几何信息的模型架构,例如几何卷积网络、几何注意力机制等。4) 任务适应策略:设计能够根据下游任务动态调整嵌入和模型参数的策略。

🖼️ 关键图片

📊 实验亮点

论文通过理论分析和实证研究,验证了非欧几何嵌入的有效性。虽然具体实验数据未给出,但论文强调了在各种基础模型中集成非欧几何的潜力,并提出了通过微调、从头训练和混合方法构建几何基础模型的策略。这些策略为未来的研究提供了明确的方向。

🎯 应用场景

该研究成果可广泛应用于处理具有复杂非欧结构的各种领域,例如自然语言处理(知识图谱、语义关系建模)、计算机视觉(三维形状分析、图像流形学习)、生物信息学(蛋白质结构预测、基因调控网络分析)以及社交网络分析等。通过更有效地捕捉数据中的复杂关系,可以提升相关任务的性能,并为未来的基础模型发展提供新的方向。

📄 摘要(原文)

In the era of foundation models and Large Language Models (LLMs), Euclidean space has been the de facto geometric setting for machine learning architectures. However, recent literature has demonstrated that this choice comes with fundamental limitations. At a large scale, real-world data often exhibits inherently non-Euclidean structures, such as multi-way relationships, hierarchies, symmetries, and non-isotropic scaling, in a variety of domains, such as languages, vision, and the natural sciences. It is challenging to effectively capture these structures within the constraints of Euclidean spaces. This position paper argues that moving beyond Euclidean geometry is not merely an optional enhancement but a necessity to maintain the scaling law for the next-generation of foundation models. By adopting these geometries, foundation models could more efficiently leverage the aforementioned structures. Task-aware adaptability that dynamically reconfigures embeddings to match the geometry of downstream applications could further enhance efficiency and expressivity. Our position is supported by a series of theoretical and empirical investigations of prevalent foundation models. Finally, we outline a roadmap for integrating non-Euclidean geometries into foundation models, including strategies for building geometric foundation models via fine-tuning, training from scratch, and hybrid approaches.