Knowledge Graph-extended Retrieval Augmented Generation for Question Answering

作者: Jasper Linders, Jakub M. Tomczak

分类: cs.LG

发布日期: 2025-04-11

💡 一句话要点

提出知识图谱增强的检索增强生成(KG-RAG)框架,提升问答系统在多跳问题上的准确性和可解释性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识图谱 检索增强生成 问答系统 多跳推理 大型语言模型 思维链 问题分解

📋 核心要点

- 现有问答系统面临知识图谱与大型语言模型结合的挑战,如何在利用结构化知识的同时,克服语言模型的知识盲区和幻觉问题是关键。

- KG-RAG通过问题分解、知识图谱检索和思维链推理,将非结构化语言理解与结构化知识检索相结合,提升答案的准确性和可解释性。

- 在MetaQA数据集上的实验表明,KG-RAG在多跳问题上表现出更高的准确性,验证了其在复杂推理场景下的有效性。

📝 摘要(中文)

大型语言模型(LLMs)和知识图谱(KGs)为构建鲁棒且可解释的问答(QA)系统提供了一种有前景的方法。LLMs擅长自然语言理解,但存在知识缺口和幻觉问题。KGs提供结构化知识,但缺乏自然语言交互能力。理想情况下,AI系统既应该对缺失事实具有鲁棒性,又应该易于交流。本文提出了一种集成LLMs和KGs的系统,无需训练,确保了在不同KGs上的适应性,并最大限度地减少了人工干预。该方法可以归类为一种特殊的带有KG的检索增强生成(RAG),因此被称为知识图谱增强的检索增强生成(KG-RAG)。它包括一个问题分解模块,以增强多跳信息检索和答案可解释性。通过使用上下文学习(ICL)和思维链(CoT)提示,它生成显式的推理链,并对其进行单独处理以提高真实性。在MetaQA基准上的实验表明,多跳问题的准确性有所提高,但与使用KG的LLM基线相比,单跳性能略有下降。这些发现证明了KG-RAG通过桥接非结构化语言理解和结构化知识检索来提高QA透明度的潜力。

🔬 方法详解

问题定义:论文旨在解决问答系统中大型语言模型(LLMs)的知识不足和幻觉问题,以及知识图谱(KGs)缺乏自然语言交互能力的问题。现有方法难以有效融合LLMs和KGs的优势,尤其是在处理需要多跳推理的复杂问题时,答案的准确性和可解释性都面临挑战。

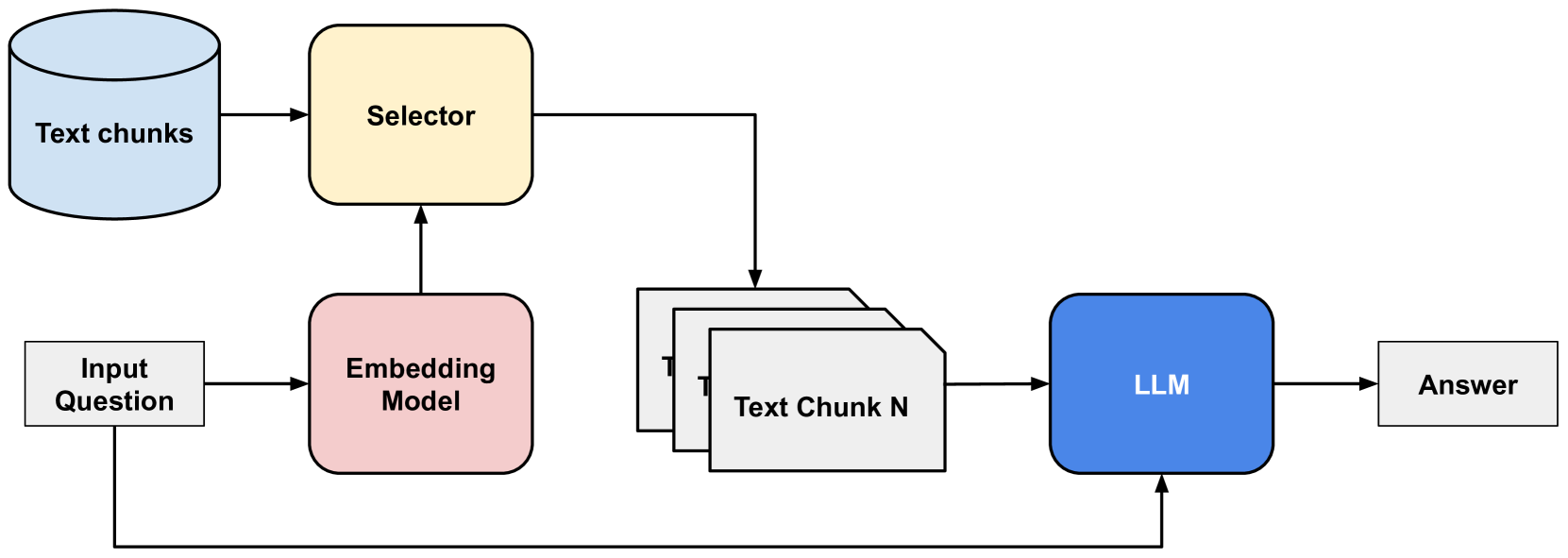

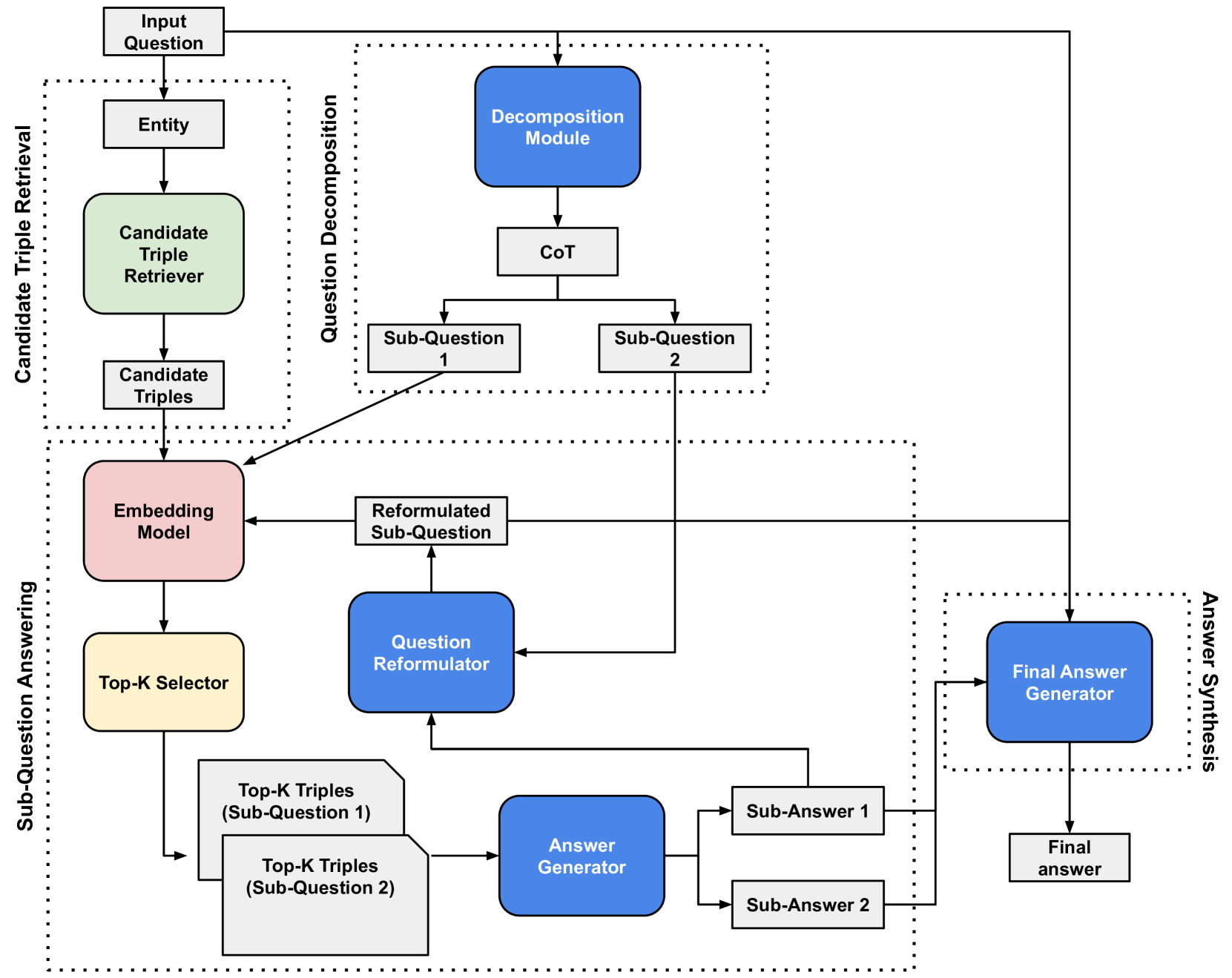

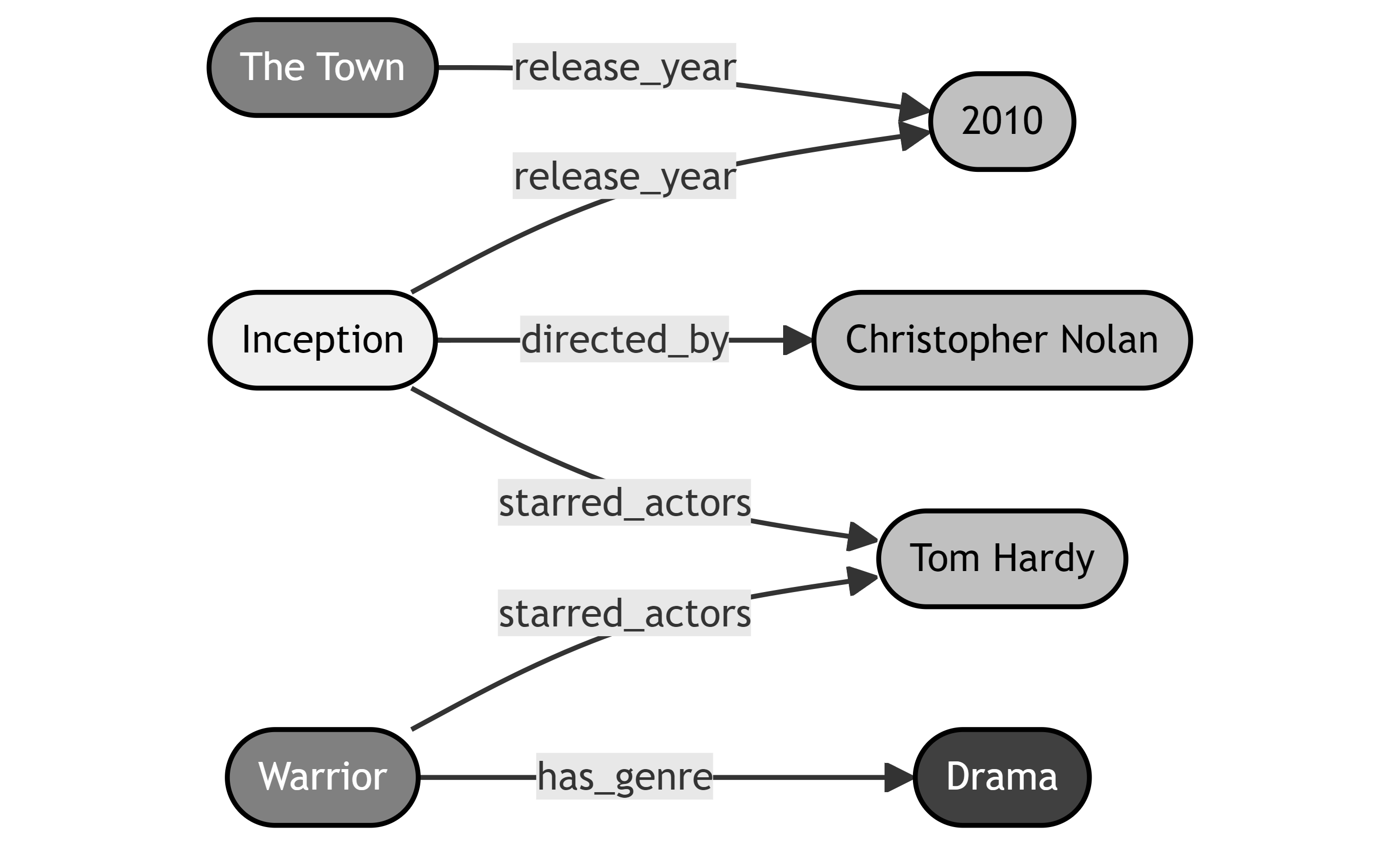

核心思路:论文的核心思路是利用知识图谱增强检索增强生成(KG-RAG)。通过问题分解模块将复杂问题拆解为简单子问题,然后利用知识图谱进行信息检索,最后利用LLM生成答案。这种方法旨在结合LLM的自然语言理解能力和KG的结构化知识,从而提高答案的准确性和可解释性。

技术框架:KG-RAG框架主要包含以下几个模块:1) 问题分解模块:将复杂问题分解为多个单跳子问题。2) 知识图谱检索模块:根据分解后的子问题,从知识图谱中检索相关实体和关系。3) 思维链生成模块:利用上下文学习(ICL)和思维链(CoT)提示,生成显式的推理链。4) 答案生成模块:根据检索到的知识和推理链,利用LLM生成最终答案。整个流程无需训练,可以灵活应用于不同的知识图谱。

关键创新:KG-RAG的关键创新在于将问题分解模块与知识图谱检索相结合,并利用思维链提示提高答案的真实性。与传统的RAG方法相比,KG-RAG更侧重于利用结构化知识进行推理,从而提高多跳问题的准确性。此外,无需训练的设计使得该方法具有更好的适应性和可扩展性。

关键设计:问题分解模块使用In-Context Learning (ICL) 和 Chain-of-Thought (CoT) prompting,通过示例引导LLM进行问题分解。知识图谱检索模块使用标准的图查询方法,例如SPARQL。思维链生成模块也依赖于ICL和CoT prompting,生成可解释的推理路径。答案生成模块则利用LLM将检索到的知识和推理链整合为自然语言答案。具体的参数设置和网络结构取决于所使用的LLM和知识图谱。

🖼️ 关键图片

📊 实验亮点

在MetaQA数据集上的实验结果表明,KG-RAG在多跳问题上取得了显著的性能提升。虽然单跳问题性能略有下降,但整体性能优于传统的LLM with KG基线。实验结果验证了KG-RAG在复杂推理场景下的有效性,并展示了其提高问答系统透明度的潜力。

🎯 应用场景

KG-RAG具有广泛的应用前景,例如智能客服、医疗诊断、金融分析等领域。它可以帮助用户从海量知识库中获取准确、可信的信息,并提供可解释的推理过程。未来,KG-RAG有望成为构建可信赖AI系统的关键技术。

📄 摘要(原文)

Large Language Models (LLMs) and Knowledge Graphs (KGs) offer a promising approach to robust and explainable Question Answering (QA). While LLMs excel at natural language understanding, they suffer from knowledge gaps and hallucinations. KGs provide structured knowledge but lack natural language interaction. Ideally, an AI system should be both robust to missing facts as well as easy to communicate with. This paper proposes such a system that integrates LLMs and KGs without requiring training, ensuring adaptability across different KGs with minimal human effort. The resulting approach can be classified as a specific form of a Retrieval Augmented Generation (RAG) with a KG, thus, it is dubbed Knowledge Graph-extended Retrieval Augmented Generation (KG-RAG). It includes a question decomposition module to enhance multi-hop information retrieval and answer explainability. Using In-Context Learning (ICL) and Chain-of-Thought (CoT) prompting, it generates explicit reasoning chains processed separately to improve truthfulness. Experiments on the MetaQA benchmark show increased accuracy for multi-hop questions, though with a slight trade-off in single-hop performance compared to LLM with KG baselines. These findings demonstrate KG-RAG's potential to improve transparency in QA by bridging unstructured language understanding with structured knowledge retrieval.