A Relative Ignorability Framework for Decision-Relevant Observability in Control Theory and Reinforcement Learning

作者: MaryLena Bleile, Minh-Nhat Phung, Minh-Binh Tran

分类: cs.LG, stat.ME

发布日期: 2025-04-10 (更新: 2025-08-06)

💡 一句话要点

提出相对可忽略性框架,解决控制理论和强化学习中决策相关可观测性问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 部分可观测性 因果推断 可忽略性 Q-learning

📋 核心要点

- 传统强化学习依赖马尔可夫假设,但在部分观测环境中失效,限制了其应用。

- 论文提出“相对可忽略性”概念,作为一种新的因果准则,放宽了对完整数据的要求。

- 理论分析和实验结果表明,即使在非马尔可夫环境中,标准强化学习算法也能有效优化相对可忽略的过程。

📝 摘要(中文)

序贯决策系统通常在缺失或不完整的数据下运行。经典的强化学习理论,常用于解决序贯决策问题,假设马尔可夫可观测性,但在部分可观测情况下可能不成立。因果推断范式形式化了缺失的忽略性。本文表明,这些观点可以被统一和推广,以保证即使在马尔可夫性质失效时,Q-learning 也能收敛。为此,我们引入了相对可忽略性的概念。相对可忽略性是一个图形因果准则,它细化了基于不完整数据进行准确决策的要求。理论结果和仿真都表明,相对于因果估计量,其缺失是相对可忽略的非马尔可夫随机过程仍然可以使用标准的强化学习算法进行优化。这些结果扩展了安全、数据高效人工智能的理论基础,使其适用于无法获得完整信息的真实世界环境。

🔬 方法详解

问题定义:传统的强化学习方法,如Q-learning,依赖于马尔可夫性质,即当前状态包含了做出最优决策所需的所有信息。然而,在实际应用中,环境往往是部分可观测的,导致马尔可夫性质不成立。这使得传统的强化学习算法难以收敛,甚至无法应用。因此,如何设计在部分可观测环境下依然有效的强化学习算法是一个重要的挑战。

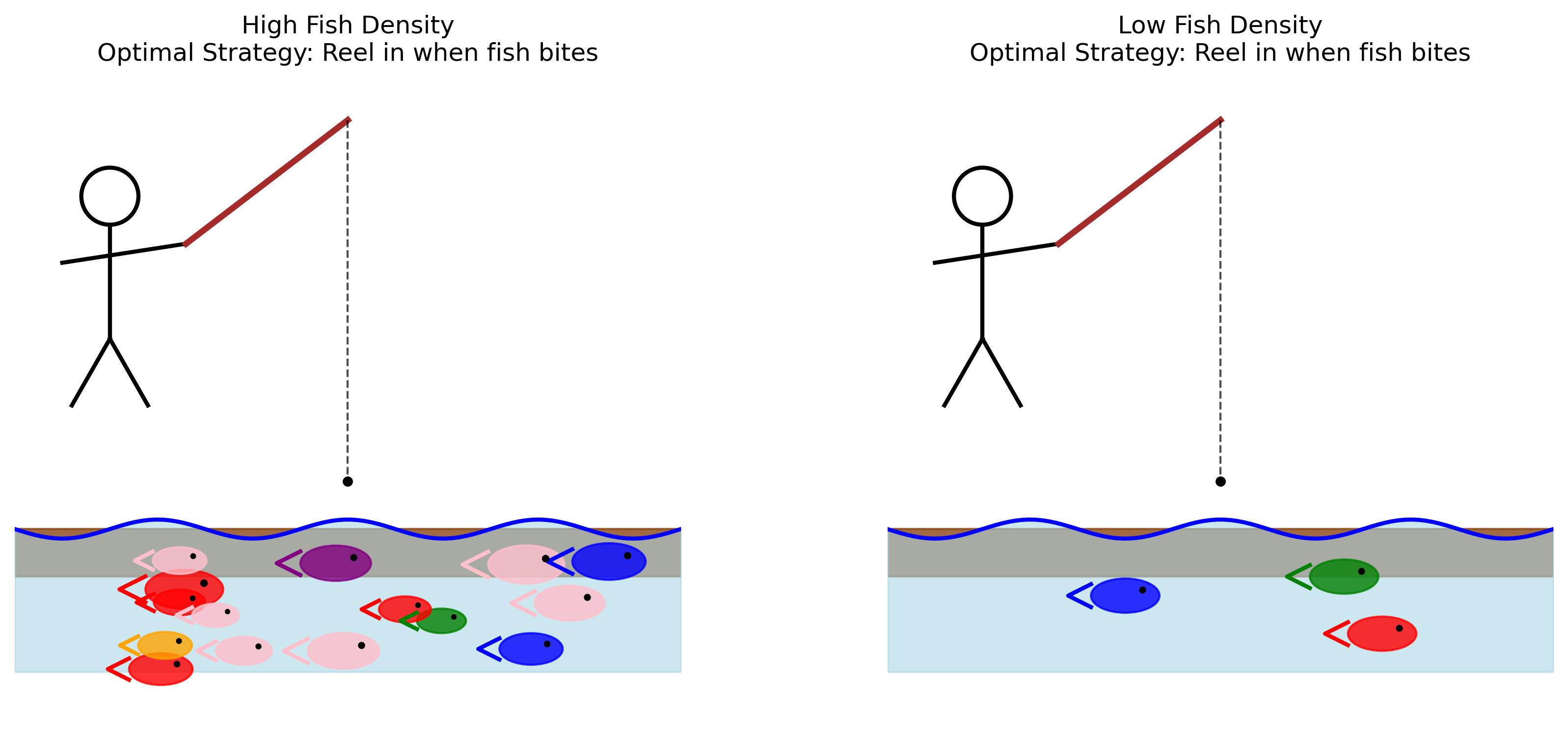

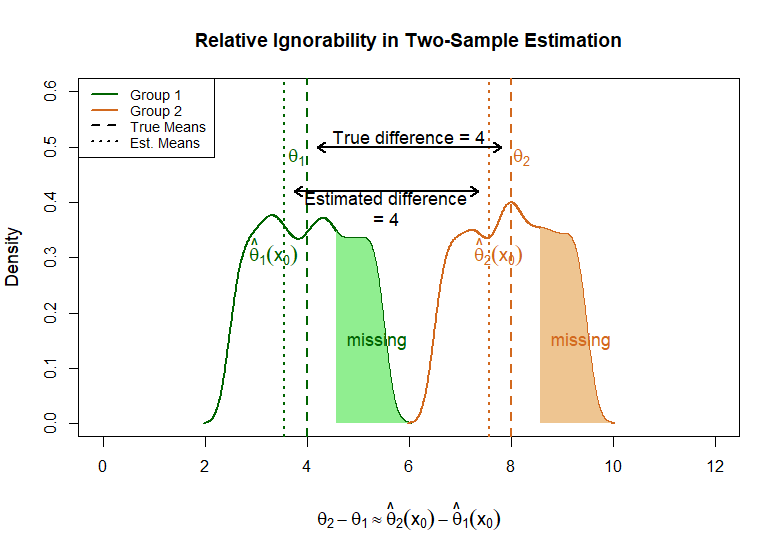

核心思路:论文的核心思路是引入“相对可忽略性”的概念,从因果推断的角度分析部分可观测环境下的决策问题。相对可忽略性是一种比传统的可忽略性更宽松的条件,它允许在某些情况下,即使存在缺失数据,仍然可以进行有效的决策。通过分析状态、动作和奖励之间的因果关系,论文提出了一个图形化的准则,用于判断一个环境是否满足相对可忽略性。

技术框架:论文的技术框架主要包括以下几个部分:1) 定义相对可忽略性的概念,并给出其数学形式化描述;2) 提出一个图形化的准则,用于判断一个环境是否满足相对可忽略性;3) 证明在相对可忽略性条件下,标准的Q-learning算法仍然可以收敛;4) 通过仿真实验验证理论结果的有效性。

关键创新:论文最重要的技术创新点在于提出了“相对可忽略性”的概念,并将其应用于强化学习领域。与传统的可忽略性相比,相对可忽略性更加灵活,可以适应更广泛的部分可观测环境。此外,论文还提出了一个图形化的准则,使得判断一个环境是否满足相对可忽略性变得更加容易。

关键设计:论文的关键设计包括:1) 相对可忽略性的数学定义,它基于因果图和条件独立性假设;2) 图形化准则的构建,它利用了d-separation的概念来判断变量之间的条件独立性;3) Q-learning算法的收敛性证明,它依赖于相对可忽略性假设和贝尔曼方程。

🖼️ 关键图片

📊 实验亮点

论文通过仿真实验验证了相对可忽略性框架的有效性。实验结果表明,在满足相对可忽略性条件的环境中,标准的Q-learning算法能够有效地学习到最优策略,并且其性能优于在不满足相对可忽略性条件的环境中训练的Q-learning算法。具体的性能提升幅度取决于环境的复杂度和缺失数据的程度,但总体而言,相对可忽略性框架能够显著提高强化学习算法在部分可观测环境中的性能。

🎯 应用场景

该研究成果可应用于机器人控制、自动驾驶、医疗诊断等领域。在这些领域中,传感器数据可能存在缺失或噪声,导致环境部分可观测。通过利用相对可忽略性框架,可以设计出更加鲁棒和高效的强化学习算法,从而提高系统的性能和安全性。此外,该研究还有助于推动数据高效和安全的人工智能发展。

📄 摘要(原文)

Sequential decision-making systems routinely operate with missing or incomplete data. Classical reinforcement learning theory, which is commonly used to solve sequential decision problems, assumes Markovian observability, which may not hold under partial observability. Causal inference paradigms formalise ignorability of missingness. We show these views can be unified and generalized in order to guarantee Q-learning convergence even when the Markov property fails. To do so, we introduce the concept of relative ignorability. Relative ignorability is a graphical-causal criterion which refines the requirements for accurate decision-making based on incomplete data. Theoretical results and simulations both reveal that non-Markovian stochastic processes whose missingness is relatively ignorable with respect to causal estimands can still be optimized using standard Reinforcement Learning algorithms. These results expand the theoretical foundations of safe, data-efficient AI to real-world environments where complete information is unattainable.