RLBayes: a Bayesian Network Structure Learning Algorithm via Reinforcement Learning-Based Search Strategy

作者: Mingcan Wang, Junchang Xin, Luxuan Qu, Qi Chen, Zhiqiong Wang

分类: cs.LG, cs.AI

发布日期: 2025-04-07

💡 一句话要点

提出RLBayes算法,利用强化学习搜索策略解决贝叶斯网络结构学习的NP难问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 贝叶斯网络 结构学习 强化学习 Q-learning 概率图模型

📋 核心要点

- 贝叶斯网络结构学习面临NP难问题,搜索空间随变量数超指数增长,传统启发式方法效果不佳。

- RLBayes算法借鉴Q-learning,通过动态维护Q表来记录和指导学习过程,在有限空间存储无限搜索空间。

- 理论证明RLBayes能收敛到全局最优BN结构,实验表明其性能优于其他启发式搜索算法。

📝 摘要(中文)

贝叶斯网络(BN)的基于评分的结构学习是学习BN模型的有效方法,BN模型被认为是表示和不确定性推理领域中最引人注目的概率图模型之一。然而,随着变量数量的增加,结构学习的搜索空间呈超指数增长,这使得BN结构学习成为一个NP难问题,也是一个组合优化问题(COP)。尽管许多启发式方法取得了成功,但BN结构学习的结果通常不令人满意。受Q-learning的启发,本文提出了一种基于强化学习(RL)搜索策略的贝叶斯网络结构学习算法,即RLBayes。该方法借鉴了RL的思想,倾向于通过动态维护的Q表来记录和指导学习过程。通过创建和维护动态Q表,RLBayes实现了在有限空间内存储无限搜索空间,从而通过Q-learning实现BN的结构学习。理论上证明了RLBayes可以收敛到全局最优的BN结构,实验也证明了RLBayes比几乎所有其他启发式搜索算法都有更好的效果。

🔬 方法详解

问题定义:贝叶斯网络结构学习旨在从数据中学习贝叶斯网络的结构,这是一个NP难的组合优化问题。现有的启发式方法虽然能在一定程度上解决该问题,但容易陷入局部最优,难以获得令人满意的结果。问题的核心在于搜索空间巨大,传统方法难以有效地探索和利用已搜索的信息。

核心思路:RLBayes的核心思路是将贝叶斯网络结构学习过程建模为一个强化学习任务。智能体通过与环境交互(即搜索不同的网络结构)来学习最优策略,目标是最大化奖励(即贝叶斯网络结构的评分)。通过Q-learning,算法能够学习到一个Q表,用于评估每个状态-动作对的价值,从而指导搜索过程。

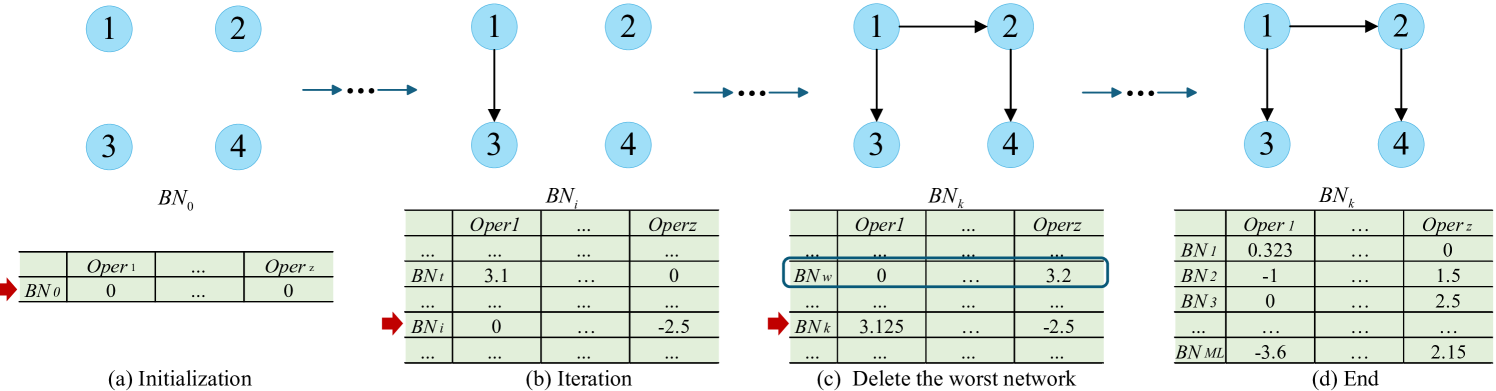

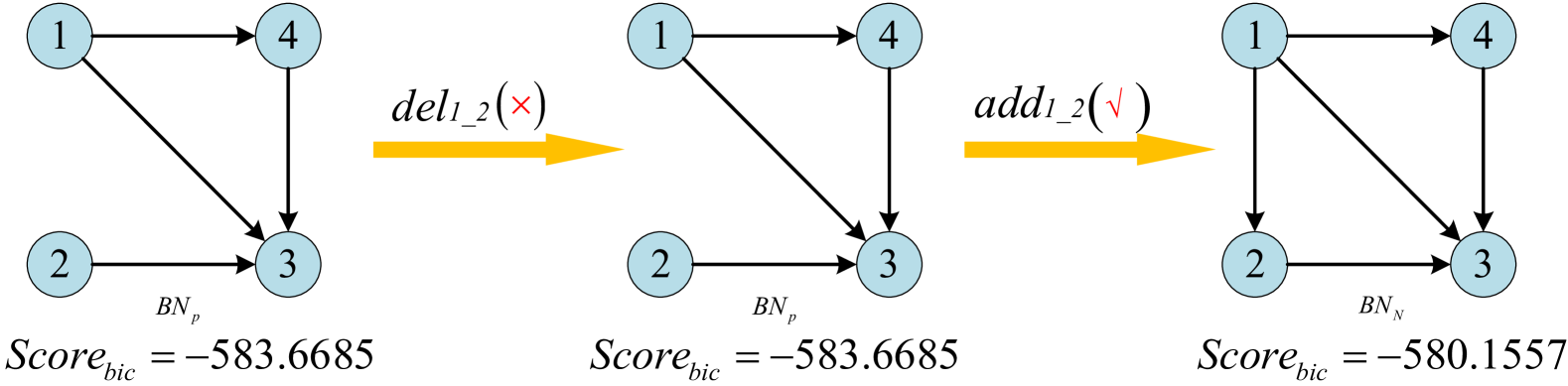

技术框架:RLBayes的整体框架包括以下几个主要模块:1) 状态表示:将贝叶斯网络结构编码为状态;2) 动作空间:定义允许的结构修改操作,例如添加、删除或反转边;3) 奖励函数:使用贝叶斯信息准则(BIC)或其它评分函数来评估网络结构的质量,作为奖励信号;4) Q-learning:使用Q-learning算法更新Q表,指导搜索过程。算法初始化一个空的Q表,然后迭代地选择动作、更新状态和Q值,直到收敛。

关键创新:RLBayes的关键创新在于将强化学习引入贝叶斯网络结构学习,并利用Q-learning来指导搜索过程。与传统的启发式方法相比,RLBayes能够更好地探索搜索空间,并利用已搜索的信息来指导未来的搜索方向。通过动态维护Q表,算法能够在有限的空间内存储无限的搜索空间信息,从而有效地解决NP难问题。

关键设计:RLBayes的关键设计包括:1) Q表初始化:Q表可以初始化为零或随机值。2) 探索-利用策略:使用ε-greedy策略平衡探索和利用。3) 奖励函数选择:选择合适的贝叶斯网络评分函数,如BIC或贝叶斯狄利克雷等价均匀(BDeu)评分。4) Q值更新:使用标准的Q-learning更新公式更新Q值。5) 收敛条件:当Q表中的Q值变化小于某个阈值或达到最大迭代次数时,算法停止。

🖼️ 关键图片

📊 实验亮点

实验结果表明,RLBayes在多个基准数据集上优于其他启发式搜索算法。例如,在某些数据集上,RLBayes能够找到具有更高贝叶斯评分的网络结构,并且在结构学习的准确性方面也有显著提升。与传统的爬山算法、模拟退火算法等相比,RLBayes能够更快地收敛到全局最优解。

🎯 应用场景

RLBayes可应用于多个领域,包括医疗诊断、金融风险评估、社交网络分析和生物信息学。通过学习准确的贝叶斯网络结构,可以进行更精确的预测和推理,从而辅助决策,提高效率。未来,该方法可以扩展到更大规模的数据集和更复杂的网络结构学习问题。

📄 摘要(原文)

The score-based structure learning of Bayesian network (BN) is an effective way to learn BN models, which are regarded as some of the most compelling probabilistic graphical models in the field of representation and reasoning under uncertainty. However, the search space of structure learning grows super-exponentially as the number of variables increases, which makes BN structure learning an NP-hard problem, as well as a combination optimization problem (COP). Despite the successes of many heuristic methods on it, the results of the structure learning of BN are usually unsatisfactory. Inspired by Q-learning, in this paper, a Bayesian network structure learning algorithm via reinforcement learning-based (RL-based) search strategy is proposed, namely RLBayes. The method borrows the idea of RL and tends to record and guide the learning process by a dynamically maintained Q-table. By creating and maintaining the dynamic Q-table, RLBayes achieve storing the unlimited search space within limited space, thereby achieving the structure learning of BN via Q-learning. Not only is it theoretically proved that RLBayes can converge to the global optimal BN structure, but also it is experimentally proved that RLBayes has a better effect than almost all other heuristic search algorithms.