A Unified Pairwise Framework for RLHF: Bridging Generative Reward Modeling and Policy Optimization

作者: Wenyuan Xu, Xiaochen Zuo, Chao Xin, Yu Yue, Lin Yan, Yonghui Wu

分类: cs.LG

发布日期: 2025-04-07

备注: 11oages,2 figures

💡 一句话要点

提出Pairwise-RL,通过统一的成对框架优化RLHF,提升奖励模型校准与策略优化。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人类反馈强化学习 奖励模型 策略优化 生成式建模 成对学习

📋 核心要点

- 现有RLHF方法依赖Bradley-Terry模型进行奖励建模,对奖励模型的校准能力提出了挑战,尤其是在不同上下文的prompt-response对中。

- Pairwise-RL通过结合生成式奖励建模和成对PPO算法,在统一的成对范式中进行奖励模型训练和强化学习,提升奖励模型性能。

- 实验结果表明,Pairwise-RL在内部评估和公共基准测试中均优于传统RLHF框架,有效提升了模型对齐和行为表现。

📝 摘要(中文)

本文提出Pairwise-RL,一种用于人类反馈强化学习(RLHF)的框架,旨在解决现有RLHF方法的两个局限性。首先,现有方法依赖Bradley-Terry模型进行奖励建模,对奖励模型提出了很高的校准要求。其次,奖励模型通常由生成式预训练模型初始化,与判别任务存在不匹配。Pairwise-RL通过结合生成式奖励建模和成对近端策略优化(PPO)算法来解决这些问题。该框架在一致的成对范式中统一了奖励模型训练及其在强化学习中的应用,利用生成式建模技术来增强奖励模型性能和分数校准。实验结果表明,Pairwise-RL在内部评估数据集和标准公共基准测试中均优于传统RLHF框架,证明了其在改进对齐和模型行为方面的有效性。

🔬 方法详解

问题定义:现有RLHF方法在奖励建模阶段存在两个主要问题。一是依赖Bradley-Terry模型进行奖励建模,需要奖励模型具备强大的校准能力,以应对不同上下文prompt-response对的差异。二是奖励模型通常由生成式预训练模型初始化,这与奖励模型的判别任务不匹配,导致性能瓶颈。

核心思路:Pairwise-RL的核心思路是将奖励模型训练和强化学习过程统一在一个成对的框架中。通过生成式奖励建模,增强奖励模型的性能和校准能力。同时,采用成对PPO算法,直接优化策略,使其生成的response更符合人类偏好。

技术框架:Pairwise-RL框架包含两个主要阶段:1) 生成式奖励模型训练:使用成对的prompt-response数据训练奖励模型,目标是学习生成符合人类偏好的response。2) 成对PPO策略优化:使用训练好的奖励模型作为环境反馈,采用PPO算法优化语言模型策略,使其生成的response获得更高的奖励。

关键创新:Pairwise-RL的关键创新在于将奖励模型训练和策略优化统一在一个成对的框架中。传统的RLHF方法通常将这两个阶段分开处理,导致信息损失和优化困难。Pairwise-RL通过生成式奖励建模和成对PPO算法,实现了端到端的优化,提高了模型的对齐效果。

关键设计:Pairwise-RL的关键设计包括:1) 生成式奖励模型:采用Transformer架构,以prompt作为输入,生成符合人类偏好的response。2) 成对PPO算法:使用KL散度作为正则化项,防止策略过度偏离原始模型。3) 损失函数:奖励模型使用交叉熵损失函数,PPO算法使用clip loss和value loss。

🖼️ 关键图片

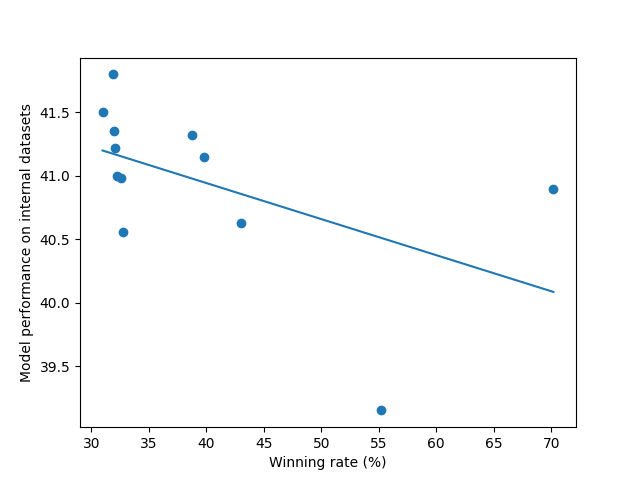

📊 实验亮点

实验结果表明,Pairwise-RL在内部评估数据集和标准公共基准测试中均优于传统RLHF框架。具体而言,Pairwise-RL在对齐指标上取得了显著提升,并且在生成文本的质量和多样性方面也表现更好。相较于传统RLHF方法,Pairwise-RL能够更有效地利用人类反馈,从而提升模型的整体性能。

🎯 应用场景

Pairwise-RL可应用于各种需要与人类偏好对齐的大语言模型应用场景,例如对话系统、文本生成、代码生成等。通过更有效地利用人类反馈,Pairwise-RL可以提升模型的安全性、可靠性和实用性,使其更好地服务于人类需求。

📄 摘要(原文)

Reinforcement Learning from Human Feedback (RLHF) has emerged as a important paradigm for aligning large language models (LLMs) with human preferences during post-training. This framework typically involves two stages: first, training a reward model on human preference data, followed by optimizing the language model using reinforcement learning algorithms. However, current RLHF approaches may constrained by two limitations. First, existing RLHF frameworks often rely on Bradley-Terry models to assign scalar rewards based on pairwise comparisons of individual responses. However, this approach imposes significant challenges on reward model (RM), as the inherent variability in prompt-response pairs across different contexts demands robust calibration capabilities from the RM. Second, reward models are typically initialized from generative foundation models, such as pre-trained or supervised fine-tuned models, despite the fact that reward models perform discriminative tasks, creating a mismatch. This paper introduces Pairwise-RL, a RLHF framework that addresses these challenges through a combination of generative reward modeling and a pairwise proximal policy optimization (PPO) algorithm. Pairwise-RL unifies reward model training and its application during reinforcement learning within a consistent pairwise paradigm, leveraging generative modeling techniques to enhance reward model performance and score calibration. Experimental evaluations demonstrate that Pairwise-RL outperforms traditional RLHF frameworks across both internal evaluation datasets and standard public benchmarks, underscoring its effectiveness in improving alignment and model behavior.