Practical Poisoning Attacks against Retrieval-Augmented Generation

作者: Baolei Zhang, Yuxi Chen, Zhuqing Liu, Lihai Nie, Tong Li, Zheli Liu, Minghong Fang

分类: cs.CR, cs.IR, cs.LG

发布日期: 2025-04-04 (更新: 2026-01-08)

备注: To appear in ACM SACMAT 2026

💡 一句话要点

提出CorruptRAG,一种针对检索增强生成(RAG)系统的实用投毒攻击方法。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强生成 RAG 投毒攻击 信息安全 大型语言模型

📋 核心要点

- 现有RAG投毒攻击通常假设攻击者可以注入大量恶意文本,这在实际场景中难以实现。

- CorruptRAG仅需注入单个恶意文本即可攻击RAG系统,提升了攻击的可行性和隐蔽性。

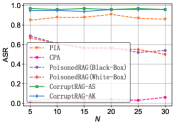

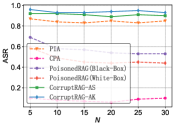

- 实验表明,CorruptRAG在多个数据集上实现了比现有基线更高的攻击成功率,验证了其有效性。

📝 摘要(中文)

大型语言模型(LLMs)在自然语言处理方面表现出令人印象深刻的能力,但也面临幻觉和知识过时等挑战。检索增强生成(RAG)已成为缓解这些问题的先进方法。虽然RAG增强了LLM的输出,但它仍然容易受到投毒攻击。最近的研究表明,将投毒文本注入知识库会损害RAG系统,但大多数现有攻击假设攻击者可以为每个查询插入足够数量的投毒文本,以超过检索中正确答案文本的数量,这一假设通常是不现实的。为了解决这个限制,我们提出CorruptRAG,一种针对RAG系统的实用投毒攻击,其中攻击者仅注入单个投毒文本,从而增强了可行性和隐蔽性。在多个大型数据集上进行的大量实验表明,CorruptRAG实现了比现有基线更高的攻击成功率。

🔬 方法详解

问题定义:论文旨在解决RAG系统在实际应用中面临的投毒攻击问题。现有投毒攻击方法通常需要注入大量的恶意文本才能成功,这使得攻击成本高昂且容易被检测到。因此,如何在攻击资源有限的情况下,有效地攻击RAG系统是一个重要的挑战。

核心思路:CorruptRAG的核心思路是通过精心设计的单个恶意文本,使其在检索阶段能够被RAG系统优先选择,从而影响LLM的生成结果。该方法旨在最大化单个恶意文本的影响力,降低攻击成本,并提高攻击的隐蔽性。

技术框架:CorruptRAG攻击RAG系统的流程如下:首先,攻击者构建一个精心设计的恶意文本。然后,将该恶意文本注入到RAG系统的知识库中。当用户发起查询时,RAG系统会从知识库中检索相关文本,包括注入的恶意文本。由于恶意文本的设计,它更有可能被检索到,并被LLM用于生成回复,从而导致LLM生成错误或有害的输出。

关键创新:CorruptRAG的关键创新在于其能够仅通过注入单个恶意文本就实现有效的投毒攻击。这与现有方法需要注入大量恶意文本形成了鲜明对比,大大降低了攻击成本,并提高了攻击的隐蔽性。

关键设计:论文中可能涉及的关键设计包括:恶意文本的生成策略,例如,如何选择关键词、如何构造句子结构等,以确保恶意文本在检索阶段能够被优先选择;以及如何评估恶意文本的有效性,例如,通过模拟检索过程来预测恶意文本被选择的概率。

🖼️ 关键图片

📊 实验亮点

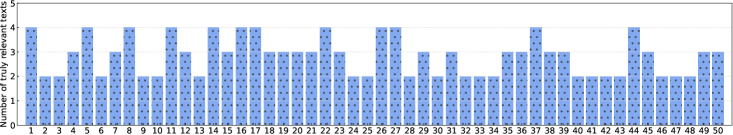

CorruptRAG在多个大型数据集上进行了实验,结果表明其攻击成功率显著高于现有的基线方法。具体性能数据未知,但论文强调了CorruptRAG在仅注入单个恶意文本的情况下,依然能够取得比需要注入大量恶意文本的基线方法更高的攻击成功率,证明了其有效性和实用性。

🎯 应用场景

该研究成果可应用于评估和增强RAG系统的安全性,尤其是在知识库内容由用户贡献或容易受到恶意篡改的场景下。例如,在线问答系统、文档检索系统等。通过了解和防御此类攻击,可以提高RAG系统在实际应用中的可靠性和安全性,防止恶意信息传播。

📄 摘要(原文)

Large language models (LLMs) have demonstrated impressive natural language processing abilities but face challenges such as hallucination and outdated knowledge. Retrieval-Augmented Generation (RAG) has emerged as a state-of-the-art approach to mitigate these issues. While RAG enhances LLM outputs, it remains vulnerable to poisoning attacks. Recent studies show that injecting poisoned text into the knowledge database can compromise RAG systems, but most existing attacks assume that the attacker can insert a sufficient number of poisoned texts per query to outnumber correct-answer texts in retrieval, an assumption that is often unrealistic. To address this limitation, we propose CorruptRAG, a practical poisoning attack against RAG systems in which the attacker injects only a single poisoned text, enhancing both feasibility and stealth. Extensive experiments conducted on multiple large-scale datasets demonstrate that CorruptRAG achieves higher attack success rates than existing baselines.