Autonomous state-space segmentation for Deep-RL sparse reward scenarios

作者: Gianluca Maselli, Vieri Giuliano Santucci

分类: cs.LG, cs.AI, cs.CV

发布日期: 2025-04-04

💡 一句话要点

提出基于自主状态空间分割的深度强化学习方法,解决稀疏奖励场景下的探索问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 深度强化学习 稀疏奖励 内在动机 自主探索 状态空间分割

📋 核心要点

- 稀疏奖励环境下的探索是强化学习的关键挑战,传统方法难以有效学习。

- 论文提出一种两级架构,通过内在动机驱动的探索和自主子目标生成,提升学习效率。

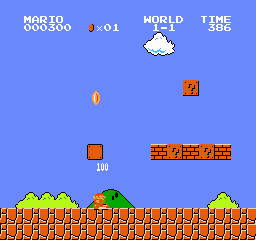

- 在SuperMarioBros环境中验证,结果表明该方法能有效生成通往最终目标的路径。

📝 摘要(中文)

本文针对自主开放式学习环境中稀疏奖励问题,提出了一种两级架构的深度强化学习方法。该方法交替进行“内驱”探索和自主子目标生成阶段,以及稀疏奖励下的目标导向策略学习阶段。利用新奇性或好奇心等内在奖励信号,改善探索过程,尤其是在外部奖励延迟或缺失时。该系统构建多个小型网络,每个网络专注于特定的子路径,并将它们用作未来探索的起点,避免从头开始探索先前学习的路径。在Gym SuperMarioBros环境中,对系统的两个版本进行了训练和测试,未考虑任何额外的外部奖励。结果表明了该方法的有效性,以及自主分割环境以生成通往最终目标的高效路径的重要性。

🔬 方法详解

问题定义:论文旨在解决深度强化学习在稀疏奖励环境中难以有效探索的问题。传统方法在奖励信号稀疏时,难以引导智能体进行有效的探索,导致学习效率低下,甚至无法学习到有效的策略。现有方法往往需要大量的环境交互才能获得有效的奖励信号,这在实际应用中是不可接受的。

核心思路:论文的核心思路是将环境分解为多个子任务或子目标,并分别学习每个子任务的策略。通过内在动机(如新奇性或好奇心)驱动智能体探索环境,自主生成子目标,然后利用稀疏的外部奖励来学习目标导向的策略。这种分而治之的方法可以有效地降低探索难度,提高学习效率。

技术框架:该方法采用两级架构。第一级是“内驱”探索和自主子目标生成阶段,利用内在奖励信号驱动智能体探索环境,并根据探索结果自主生成子目标。第二级是稀疏奖励下的目标导向策略学习阶段,利用外部奖励信号学习如何达到每个子目标。系统构建多个小型网络,每个网络专门负责一个子路径的学习。

关键创新:该方法最重要的创新在于自主状态空间分割和子目标生成。传统方法通常需要人工设计子目标或依赖于预定义的奖励函数,而该方法能够自主地将环境分割成多个有意义的子空间,并生成相应的子目标。这种自主性使得该方法能够适应更复杂的环境,并具有更强的泛化能力。

关键设计:论文中使用了内在奖励函数来驱动探索,例如基于预测误差的好奇心奖励。具体网络结构未知,但提到使用了多个小型网络,每个网络对应一个子路径。损失函数的设计可能包括内在奖励损失和外部奖励损失,具体细节未知。

🖼️ 关键图片

📊 实验亮点

论文在Gym SuperMarioBros环境中进行了实验,结果表明该方法能够有效地生成通往最终目标的路径,并且无需额外的外部奖励。虽然论文中没有提供具体的性能数据和对比基线,但结果表明了该方法在稀疏奖励环境下的有效性。自主分割环境并生成高效路径是该方法的重要优势。

🎯 应用场景

该研究成果可应用于机器人导航、游戏AI、自动驾驶等领域,尤其是在奖励信号稀疏或难以定义的复杂环境中。通过自主状态空间分割和子目标生成,可以提高智能体的学习效率和泛化能力,使其能够更好地适应真实世界的复杂环境。该方法有望推动深度强化学习在实际应用中的发展。

📄 摘要(原文)

Dealing with environments with sparse rewards has always been crucial for systems developed to operate in autonomous open-ended learning settings. Intrinsic Motivations could be an effective way to help Deep Reinforcement Learning algorithms learn in such scenarios. In fact, intrinsic reward signals, such as novelty or curiosity, are generally adopted to improve exploration when extrinsic rewards are delayed or absent. Building on previous works, we tackle the problem of learning policies in the presence of sparse rewards by proposing a two-level architecture that alternates an ''intrinsically driven'' phase of exploration and autonomous sub-goal generation, to a phase of sparse reward, goal-directed policy learning. The idea is to build several small networks, each one specialized on a particular sub-path, and use them as starting points for future exploration without the need to further explore from scratch previously learnt paths. Two versions of the system have been trained and tested in the Gym SuperMarioBros environment without considering any additional extrinsic reward. The results show the validity of our approach and the importance of autonomously segment the environment to generate an efficient path towards the final goal.