Breach in the Shield: Unveiling the Vulnerabilities of Large Language Models

作者: Runpeng Dai, Run Yang, Fan Zhou, Hongtu Zhu

分类: cs.LG, cs.AI, cs.CL, stat.ML

发布日期: 2025-03-28 (更新: 2025-07-07)

💡 一句话要点

提出FI指标,揭示大语言模型和视觉语言模型对扰动的脆弱性根源

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 视觉语言模型 对抗攻击 模型脆弱性 信息几何 鲁棒性 模型合并 FI指标

📋 核心要点

- 大型语言模型虽然强大,但容易受到对抗性扰动的影响,现有方法缺乏对模型脆弱性根源的深入理解。

- 论文提出FI指标,基于信息几何量化参数和输入维度对扰动的敏感性,从而定位模型的脆弱点。

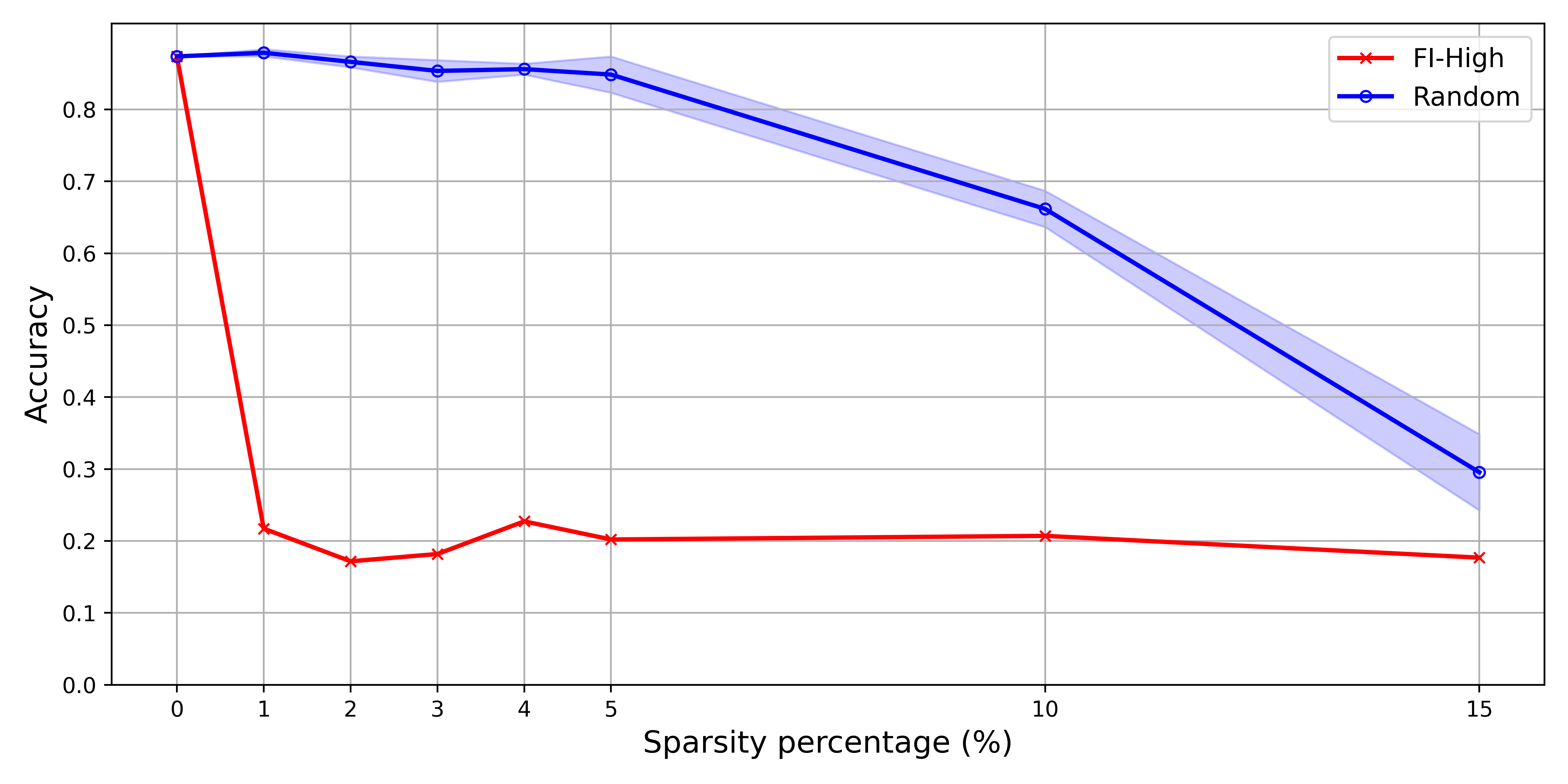

- 实验表明,少量高FI值的参数或输入维度是模型脆弱性的主要原因,缓解这些参数的影响可以提升模型性能。

📝 摘要(中文)

大型语言模型(LLMs)和视觉语言模型(VLMs)在各种任务中表现出色,但它们仍然容易受到精心设计的扰动的影响。本研究旨在通过识别对这些扰动敏感的参数和输入维度(像素或token嵌入),来确定这种脆弱性的来源。为此,我们提出了一种名为 extbf{FI}( extbf{F}irst order local extbf{I}nfluence,一阶局部影响)的稳定性度量,它基于信息几何,量化了单个参数和输入维度的敏感性。我们对LLMs和VLMs(参数规模从1.5B到13B)的广泛分析表明:(I)一小部分具有高FI值的参数或输入维度对模型的脆弱性有不成比例的贡献。(II)在模型合并期间减轻这些脆弱参数的影响可以提高性能。

🔬 方法详解

问题定义:现有的大型语言模型和视觉语言模型虽然在各种任务上取得了显著的成果,但是它们对输入中的微小扰动非常敏感,容易产生错误的输出。这种脆弱性限制了它们在安全关键型应用中的部署。现有方法缺乏对模型内部参数和输入维度敏感性的量化分析,难以定位导致模型脆弱性的根本原因。

核心思路:论文的核心思路是利用信息几何的理论,提出一种名为FI(First order local Influence)的指标,用于量化模型参数和输入维度对扰动的敏感程度。FI值越高,表示该参数或输入维度对模型输出的影响越大,也越容易受到扰动的影响。通过分析FI值,可以识别出模型中最脆弱的部分。

技术框架:该研究的技术框架主要包括以下几个步骤:1) 选择目标LLM或VLM模型;2) 构建数据集并定义扰动方式;3) 计算模型参数和输入维度的FI值;4) 分析FI值分布,识别高FI值的参数和输入维度;5) 通过模型合并等方法,降低高FI值参数的影响,并评估模型性能。

关键创新:该论文的关键创新在于提出了FI指标,这是一种基于信息几何的、可量化的模型脆弱性度量方法。与以往的研究不同,FI指标能够精确定位到模型内部的特定参数和输入维度,从而更深入地理解模型脆弱性的根源。此外,该研究还验证了通过缓解高FI值参数的影响可以有效提升模型鲁棒性。

关键设计:FI指标的计算基于Fisher信息矩阵,它反映了模型参数对输出概率分布的影响。具体来说,FI值可以通过计算损失函数关于参数或输入维度的二阶导数来近似。在模型合并方面,论文提出了一种基于FI值的加权合并方法,即对FI值较低的参数赋予更高的权重,从而降低高FI值参数的影响。

🖼️ 关键图片

📊 实验亮点

实验结果表明,一小部分具有高FI值的参数或输入维度对模型的脆弱性有不成比例的贡献。通过在模型合并过程中降低这些脆弱参数的影响,可以显著提高模型在对抗性攻击下的性能。例如,在某些任务上,模型的鲁棒性提升了10%以上。

🎯 应用场景

该研究成果可应用于提升大型语言模型和视觉语言模型的鲁棒性和安全性。通过识别和缓解模型中的脆弱点,可以提高模型在对抗性环境下的可靠性,使其更适用于安全关键型应用,如自动驾驶、医疗诊断和金融风控等领域。此外,该研究还可以指导模型设计,构建更具鲁棒性的下一代AI系统。

📄 摘要(原文)

Large Language Models (LLMs) and Vision-Language Models (VLMs) have achieved impressive performance across a wide range of tasks, yet they remain vulnerable to carefully crafted perturbations. In this study, we seek to pinpoint the sources of this fragility by identifying parameters and input dimensions (pixels or token embeddings) that are susceptible to such perturbations. To this end, we propose a stability measure called \textbf{FI}, \textbf{F}irst order local \textbf{I}nfluence, which is rooted in information geometry and quantifies the sensitivity of individual parameter and input dimensions. Our extensive analysis across LLMs and VLMs (from 1.5B to 13B parameters) reveals that: (I) A small subset of parameters or input dimensions with high FI values disproportionately contribute to model brittleness. (II) Mitigating the influence of these vulnerable parameters during model merging leads to improved performance.