Landscape of Thoughts: Visualizing the Reasoning Process of Large Language Models

作者: Zhanke Zhou, Zhaocheng Zhu, Xuan Li, Mikhail Galkin, Xiao Feng, Sanmi Koyejo, Jian Tang, Bo Han

分类: cs.LG

发布日期: 2025-03-28 (更新: 2025-10-31)

🔗 代码/项目: GITHUB

💡 一句话要点

提出Landscape of Thoughts,可视化LLM推理过程,诊断模型行为。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 推理过程 可视化 可解释性 模型诊断

📋 核心要点

- 大型语言模型推理过程复杂且难以理解,阻碍了模型改进和安全应用。

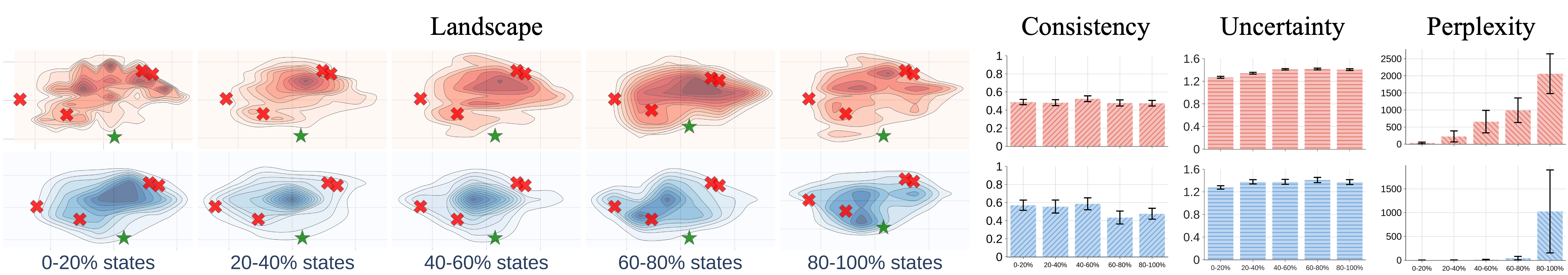

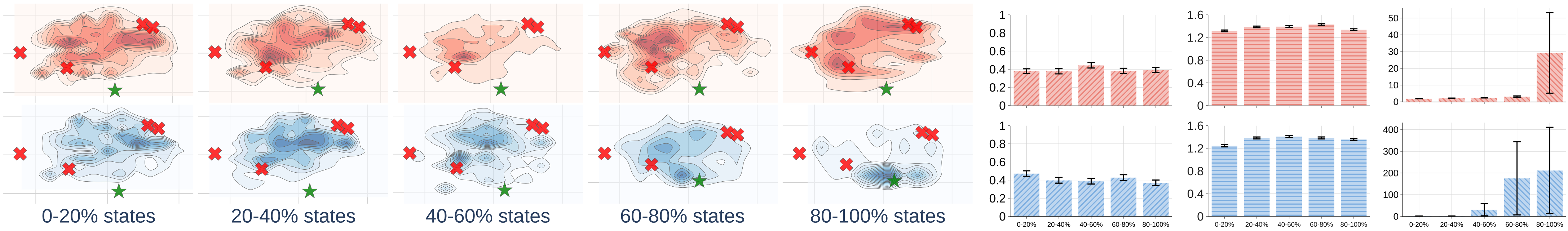

- Landscape of Thoughts将推理轨迹映射为二维景观图,揭示模型推理过程中的模式和问题。

- 实验表明,该方法能有效区分模型优劣、答案正误,并可用于构建轻量级推理验证器。

📝 摘要(中文)

大型语言模型(LLM)的许多应用依赖于其逐步推理能力。然而,我们对LLM的推理行为仍然知之甚少,这给研究、开发和安全性带来了挑战。为了解决这个问题,我们引入了Landscape of Thoughts(LoT),这是第一个景观可视化工具,用于检查任何多项选择数据集上使用特定推理方法的推理轨迹。我们将轨迹中的文本状态表示为数值特征,这些特征量化了状态与答案选项之间的距离。然后,使用t-SNE将这些特征可视化在二维图中。通过Landscape of Thoughts进行的定性和定量分析有效地区分了强模型和弱模型、正确答案和错误答案以及不同的推理任务。它还揭示了不良的推理模式,例如低一致性和高不确定性。此外,用户可以将LoT适配到预测他们观察到的属性的模型。我们通过将LoT适配到一个轻量级验证器来评估轨迹的正确性,从而展示了这一优势。经验表明,该验证器提高了推理准确性和测试时缩放效果。代码已公开发布在:https://github.com/tmlr-group/landscape-of-thoughts。

🔬 方法详解

问题定义:现有大型语言模型(LLM)的推理过程是一个黑盒,难以理解其内部的推理步骤和决策过程。这使得我们难以诊断模型的错误原因,也难以改进模型的推理能力。现有的方法缺乏有效的可视化工具来帮助我们理解LLM的推理过程。

核心思路:论文的核心思路是将LLM的推理轨迹转化为可视化的“思维景观”(Landscape of Thoughts)。通过将推理过程中的中间状态映射到二维空间,可以直观地观察模型的推理路径,并识别出潜在的问题,例如不一致性或不确定性。这种可视化方法能够帮助研究人员更好地理解LLM的推理行为。

技术框架:Landscape of Thoughts (LoT) 的整体框架包含以下几个主要步骤:1. 数据准备:选择多项选择题数据集和相应的LLM推理方法。2. 推理轨迹提取:运行LLM,记录其在解决问题时的每一步推理状态(文本)。3. 特征提取:将每个推理状态表示为数值特征,这些特征量化了状态与各个答案选项之间的距离。4. 降维与可视化:使用t-SNE等降维算法将高维特征映射到二维空间,生成思维景观图。5. 分析与诊断:分析景观图中的模式,例如轨迹的形状、密度和分布,以识别模型的推理问题。

关键创新:该论文的关键创新在于提出了将LLM推理过程可视化的方法。通过将抽象的文本推理过程转化为直观的二维景观图,使得研究人员能够更容易地理解和分析LLM的推理行为。此外,该方法还具有一定的通用性,可以应用于不同的LLM和推理方法。

关键设计:在特征提取方面,论文使用的方法是计算每个推理状态与各个答案选项之间的距离。具体的距离度量方法未知,但其目的是量化每个状态对不同答案的支持程度。在降维方面,论文使用了t-SNE算法,这是一种常用的非线性降维算法,能够较好地保留高维数据中的局部结构。此外,论文还展示了如何将LoT适配到一个轻量级验证器,以评估推理轨迹的正确性,并提高推理准确性。

🖼️ 关键图片

📊 实验亮点

Landscape of Thoughts通过可视化分析,成功区分了强弱模型、正确与错误答案,并揭示了低一致性和高不确定性等不良推理模式。通过适配轻量级验证器,该方法显著提高了推理准确性和测试时缩放效果,验证了其有效性。

🎯 应用场景

Landscape of Thoughts可应用于LLM的调试、优化和安全评估。研究人员可以利用该工具诊断模型推理过程中的问题,例如逻辑错误或偏见。开发者可以利用该工具改进模型的推理能力,提高其在各种任务中的性能。安全工程师可以利用该工具评估模型的安全性,防止其产生有害或不当的输出。此外,该方法还可以用于教育领域,帮助学生更好地理解LLM的工作原理。

📄 摘要(原文)

Numerous applications of large language models (LLMs) rely on their ability to perform step-by-step reasoning. However, the reasoning behavior of LLMs remains poorly understood, posing challenges to research, development, and safety. To address this gap, we introduce landscape of thoughts (LoT), the first landscape visualization tool to inspect the reasoning trajectories with certain reasoning methods on any multi-choice dataset. We represent the textual states in a trajectory as numerical features that quantify the states' distances to the answer choices. These features are then visualized in two-dimensional plots using t-SNE. Qualitative and quantitative analysis with the landscape of thoughts effectively distinguishes between strong and weak models, correct and incorrect answers, as well as different reasoning tasks. It also uncovers undesirable reasoning patterns, such as low consistency and high uncertainty. Additionally, users can adapt LoT to a model that predicts the property they observe. We showcase this advantage by adapting LoT to a lightweight verifier that evaluates the correctness of trajectories. Empirically, this verifier boosts the reasoning accuracy and the test-time scaling effect. The code is publicly available at: https://github.com/tmlr-group/landscape-of-thoughts.