DeepRV: Accelerating spatiotemporal inference with pre-trained neural priors

作者: Jhonathan Navott, Daniel Jenson, Seth Flaxman, Elizaveta Semenova

分类: stat.ML, cs.LG

发布日期: 2025-03-27 (更新: 2025-10-17)

备注: Code to reproduce all experiments is available in the ancillary file deep_rv_code, with instructions in the included README

💡 一句话要点

DeepRV:利用预训练神经先验加速时空推理

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 高斯过程 时空推理 神经网络 变分推理 概率编程 模型加速

📋 核心要点

- 高斯过程在时空建模中精度高但计算复杂度高,限制了其在大数据集上的应用。

- DeepRV利用神经网络学习高斯过程的先验分布,作为替代模型降低计算复杂度。

- 实验表明,DeepRV在保持高精度的同时,显著加速了时空推理过程。

📝 摘要(中文)

高斯过程(GPs)为时空现象建模提供了灵活且具有统计学原理的基础,但其$O(N^3)$的复杂度使其难以处理大型数据集。变分推理(VI)、诱导点(稀疏GPs)、低秩分解(RFFs)、局部分解和近似(INLA)等近似方法提高了可扩展性,但牺牲了准确性或灵活性。我们引入DeepRV,一种神经网络替代模型,它与完整GP的精度(包括超参数估计)紧密匹配,同时将计算复杂度降低到$O(N^2)$,从而提高了可扩展性和推理速度。DeepRV可以作为GP先验实现的直接替代品,例如在基于MCMC的概率编程流程中,从而保留了完整的模型灵活性。在模拟基准、不可分离的时空GPs以及伦敦教育剥夺的真实世界应用(n = 4,994个地点)中,DeepRV实现了对精确GPs的最高保真度,同时显著加速了推理。随附的ZIP存档中提供了代码,所有实验都在单个消费级GPU上运行,以确保从业人员的可访问性。

🔬 方法详解

问题定义:论文旨在解决高斯过程(GP)在处理大规模时空数据时计算复杂度过高的问题。传统GP方法的时间复杂度为O(N^3),这使得它们在实际应用中,特别是当数据量很大时,变得不可行。现有的近似方法,如变分推理和稀疏GP,虽然可以提高可扩展性,但通常会牺牲模型的准确性或灵活性。

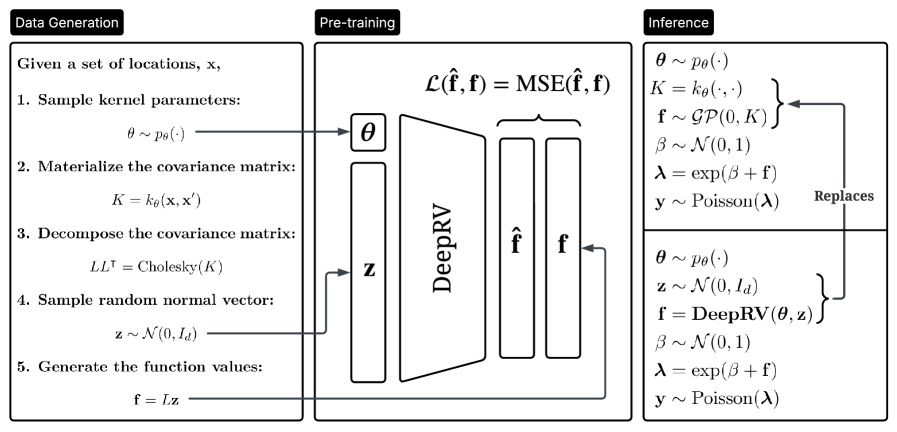

核心思路:DeepRV的核心思路是使用一个预训练的神经网络来学习GP的先验分布,并将其作为一个替代模型。这个神经网络可以快速生成GP的样本,从而避免了直接计算GP的复杂过程。通过这种方式,DeepRV能够在保持GP高精度的同时,显著降低计算复杂度。

技术框架:DeepRV的整体框架包括以下几个主要步骤:1) 使用GP生成训练数据;2) 训练一个神经网络来学习GP的先验分布;3) 在实际应用中,使用训练好的神经网络作为GP的替代模型,进行时空推理。该框架允许将DeepRV无缝集成到现有的概率编程流程中,例如基于MCMC的方法。

关键创新:DeepRV最重要的技术创新点在于使用神经网络来近似GP的先验分布。与传统的近似方法相比,DeepRV能够更好地保留GP的特性,从而实现更高的精度。此外,DeepRV的计算复杂度为O(N^2),远低于传统GP方法的O(N^3),这使得它能够处理更大规模的数据集。

关键设计:DeepRV的关键设计包括:1) 神经网络的结构选择,需要能够有效地学习GP的先验分布;2) 损失函数的设计,需要能够保证神经网络生成的样本与GP的样本尽可能相似;3) 训练数据的生成方式,需要能够覆盖GP的各种可能情况。论文中使用了消费级GPU进行实验,保证了算法的易用性。

🖼️ 关键图片

📊 实验亮点

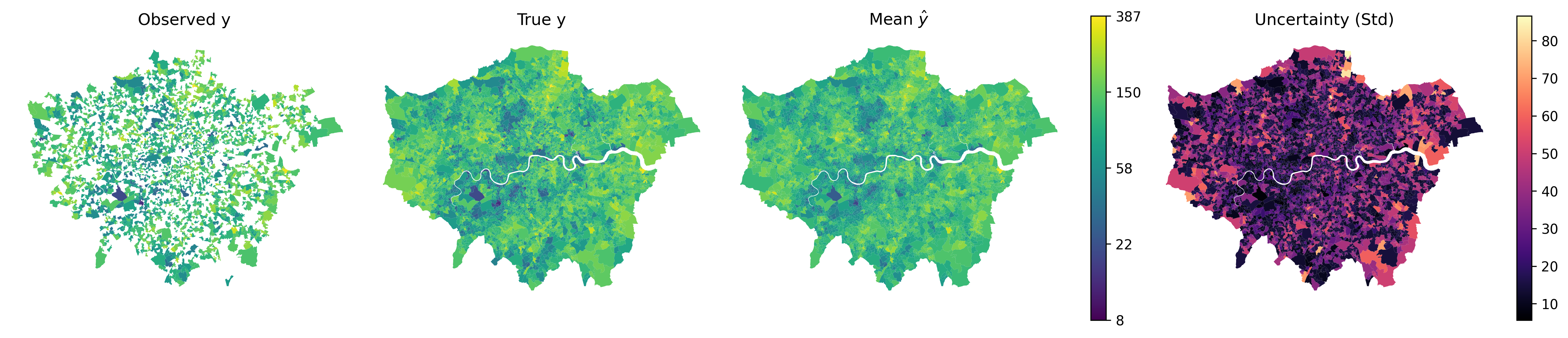

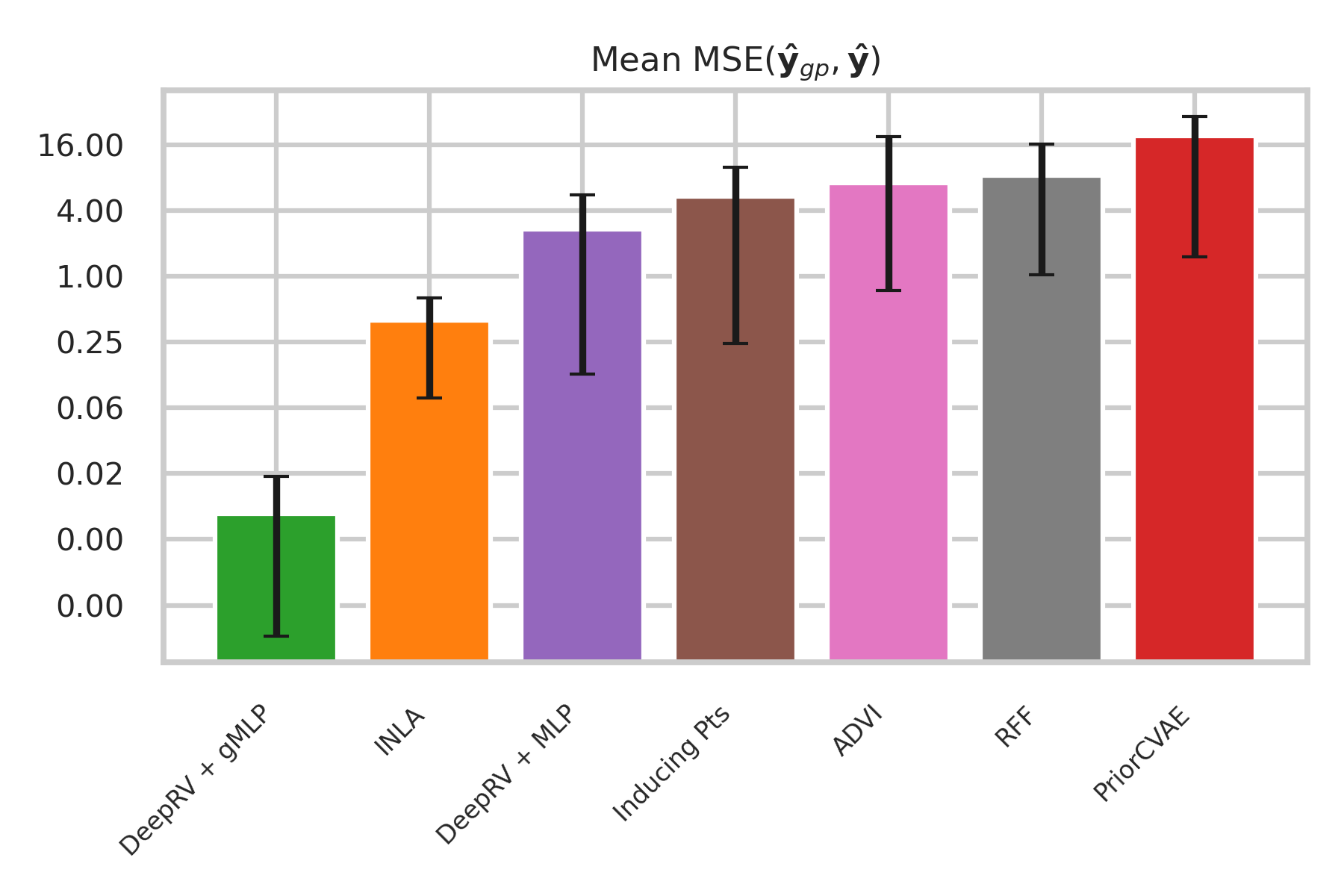

DeepRV在模拟基准测试、不可分离时空高斯过程以及伦敦教育剥夺的真实世界应用中,都表现出了优异的性能。实验结果表明,DeepRV在保持与精确高斯过程高度一致性的同时,显著加速了推理过程。具体而言,DeepRV在伦敦教育剥夺数据集(包含4994个地点)上的实验中,实现了最高的保真度,并显著提升了推理速度。

🎯 应用场景

DeepRV在时空建模领域具有广泛的应用前景,例如环境监测、疾病传播预测、城市规划等。通过加速时空推理过程,DeepRV可以帮助研究人员和决策者更快地分析和理解大规模时空数据,从而做出更明智的决策。此外,DeepRV还可以应用于其他需要使用GP作为先验模型的领域,例如贝叶斯优化和强化学习。

📄 摘要(原文)

Gaussian Processes (GPs) provide a flexible and statistically principled foundation for modelling spatiotemporal phenomena, but their $O(N^3)$ scaling makes them intractable for large datasets. Approximate methods such as variational inference (VI), inducing points (sparse GPs), low-rank factorizations (RFFs), local factorizations and approximations (INLA), improve scalability but trade off accuracy or flexibility. We introduce DeepRV, a neural-network surrogate that closely matches full GP accuracy including hyperparameter estimates, while reducing computational complexity to $O(N^2)$, increasing scalability and inference speed. DeepRV serves as a drop-in replacement for GP prior realisations in e.g. MCMC-based probabilistic programming pipelines, preserving full model flexibility. Across simulated benchmarks, non-separable spatiotemporal GPs, and a real-world application to education deprivation in London (n = 4,994 locations), DeepRV achieves the highest fidelity to exact GPs while substantially accelerating inference. Code is provided in the accompanying ZIP archive, with all experiments run on a single consumer-grade GPU to ensure accessibility for practitioners.