LogLLaMA: Transformer-based log anomaly detection with LLaMA

作者: Zhuoyi Yang, Ian G. Harris

分类: cs.LG, cs.CL

发布日期: 2025-03-19

备注: 8 pages, 5 figures

💡 一句话要点

LogLLaMA:利用LLaMA进行日志异常检测,显著优于现有方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 日志异常检测 大型语言模型 LLaMA2 强化学习 生成模型 Transformer 时间序列分析

📋 核心要点

- 现有日志异常检测方法难以有效理解复杂和长期的日志模式,导致检测精度受限。

- LogLLaMA利用LLaMA2的强大语言理解能力,通过微调和强化学习,学习正常日志模式并识别异常。

- 实验表明,LogLLaMA在三个大规模数据集上超越了现有最佳方法,证明了其有效性。

📝 摘要(中文)

日志异常检测旨在区分日志消息中的异常消息和正常消息。基于Transformer的大型语言模型(LLMs)因其理解复杂和长语言模式的卓越能力,在日志异常检测中越来越受欢迎。本文提出了LogLLaMA,这是一个利用LLaMA2的新框架。LogLLaMA首先在来自三个大规模数据集的正常日志消息上进行微调,以学习它们的模式。微调后,该模型能够根据先前的日志消息生成后续的日志消息。我们的生成模型进一步通过强化学习(RL)进行训练,以识别异常日志消息。实验结果表明,LogLLaMA在BGL、Thunderbird和HDFS数据集上的异常检测性能优于最先进的方法。

🔬 方法详解

问题定义:论文旨在解决日志异常检测问题,即区分正常日志消息和异常日志消息。现有方法,特别是基于传统机器学习的方法,在处理复杂和长序列的日志数据时表现不佳,无法有效捕捉日志之间的依赖关系和上下文信息。

核心思路:论文的核心思路是利用大型语言模型(LLMs)强大的语言理解和生成能力,学习正常日志的模式,并基于此判断新的日志是否异常。通过让LLM学习生成正常的日志序列,可以有效地捕捉日志之间的依赖关系,从而提高异常检测的准确性。

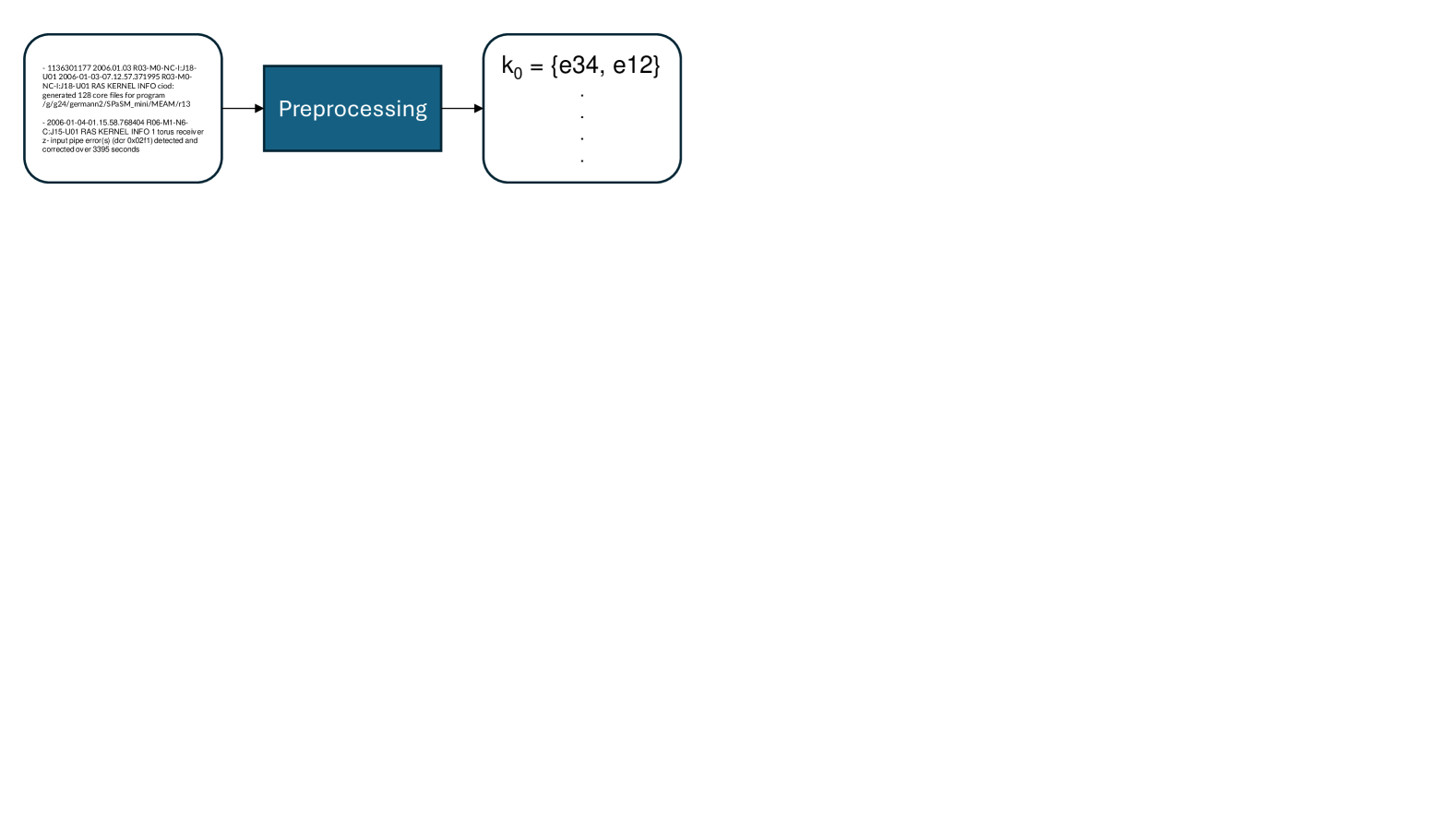

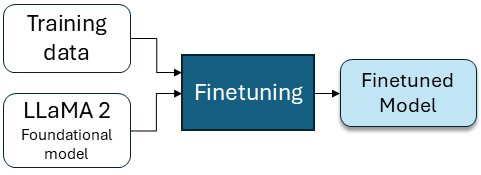

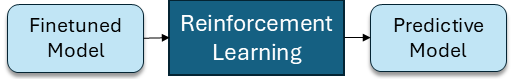

技术框架:LogLLaMA框架主要包含两个阶段:首先,使用正常日志数据对LLaMA2进行微调,使其学习正常日志的语言模式。然后,使用强化学习(RL)进一步训练微调后的模型,使其能够区分正常和异常日志。具体来说,RL的目标是最大化模型生成正常日志的概率,同时最小化生成异常日志的概率。

关键创新:LogLLaMA的关键创新在于将大型语言模型LLaMA2应用于日志异常检测,并结合强化学习进行优化。与传统的基于规则或统计的方法相比,LogLLaMA能够更好地理解日志的语义信息和上下文关系。与直接使用LLM进行分类的方法相比,LogLLaMA采用生成式模型,并通过强化学习进行微调,从而更好地适应日志异常检测的任务。

关键设计:LogLLaMA使用LLaMA2作为基础模型,并使用正常日志数据进行微调。强化学习阶段,使用策略梯度方法训练模型,奖励函数的设计至关重要,旨在鼓励模型生成正常的日志序列,并惩罚生成异常的日志序列。具体的参数设置和超参数的选择需要根据不同的数据集进行调整。

🖼️ 关键图片

📊 实验亮点

LogLLaMA在BGL、Thunderbird和HDFS三个大规模数据集上进行了评估,实验结果表明,LogLLaMA在异常检测性能方面显著优于现有的最先进方法。具体的性能提升幅度取决于数据集,但总体而言,LogLLaMA在准确率、召回率和F1值等指标上均取得了显著的提升。

🎯 应用场景

LogLLaMA可应用于各种IT系统的日志异常检测,例如服务器、网络设备和应用程序。通过自动检测异常日志,可以帮助运维人员及时发现和解决系统故障,提高系统的可靠性和可用性。该研究的成果还可以推广到其他类型的序列数据异常检测,例如金融交易数据和传感器数据。

📄 摘要(原文)

Log anomaly detection refers to the task that distinguishes the anomalous log messages from normal log messages. Transformer-based large language models (LLMs) are becoming popular for log anomaly detection because of their superb ability to understand complex and long language patterns. In this paper, we propose LogLLaMA, a novel framework that leverages LLaMA2. LogLLaMA is first finetuned on normal log messages from three large-scale datasets to learn their patterns. After finetuning, the model is capable of generating successive log messages given previous log messages. Our generative model is further trained to identify anomalous log messages using reinforcement learning (RL). The experimental results show that LogLLaMA outperforms the state-of-the-art approaches for anomaly detection on BGL, Thunderbird, and HDFS datasets.