Performance Analysis of Decentralized Federated Learning Deployments

作者: Chengyan Jiang, Jiamin Fan, Talal Halabi, Israat Haque

分类: cs.LG, cs.DC, cs.NI

发布日期: 2025-03-14

💡 一句话要点

分析去中心化联邦学习部署性能,揭示网络拓扑和数据分布的影响

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 去中心化联邦学习 网络拓扑 非独立同分布数据 收敛速度 模型泛化

📋 核心要点

- 中心化联邦学习依赖中央服务器,存在延迟高、鲁棒性差等问题,限制了其应用。

- 去中心化联邦学习通过设备间直接协作,无需中央服务器,提升了系统鲁棒性和效率。

- 论文分析了网络拓扑、数据分布等因素对DFL模型收敛性和泛化能力的影响,为实际部署提供指导。

📝 摘要(中文)

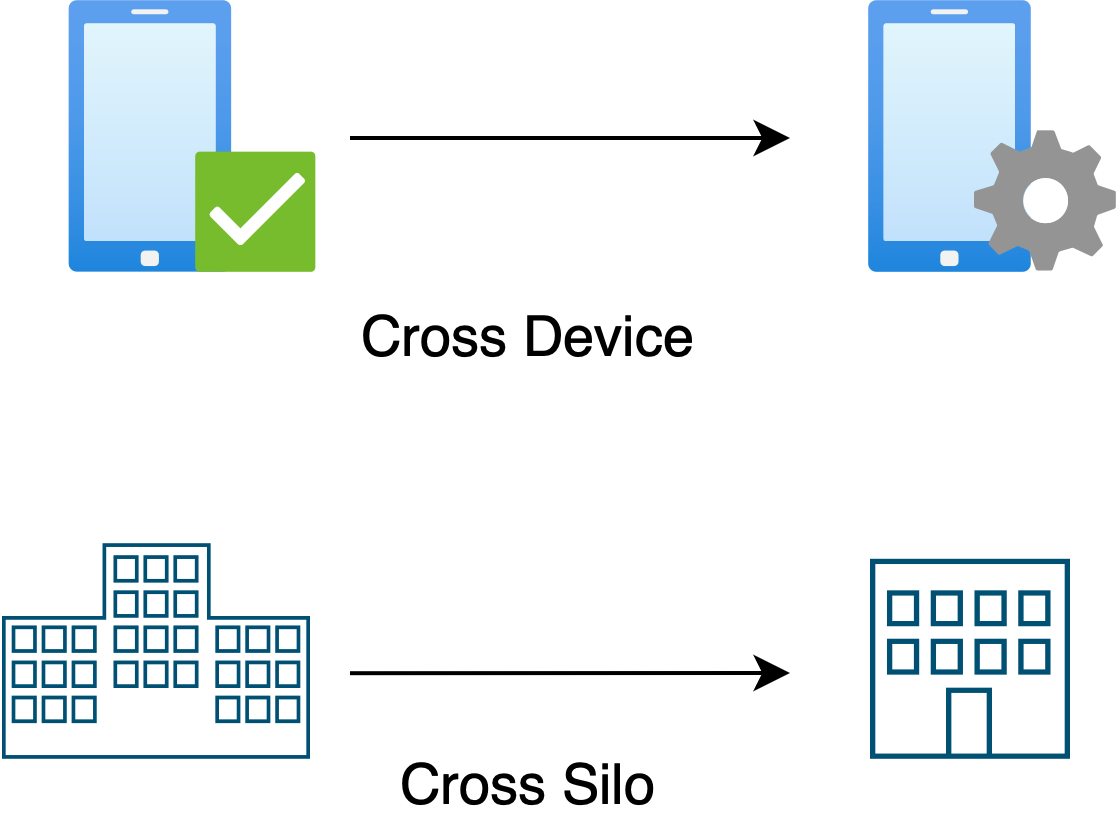

随着智能手机和可穿戴设备的普及,中心化联邦学习(CFL)被广泛应用于训练强大的机器学习模型,同时保护数据隐私。然而,CFL过度依赖中央服务器,这限制了其延迟和系统鲁棒性。去中心化联邦学习(DFL)旨在解决这些挑战,它促进参与设备之间的直接协作,无需依赖中央服务器。每个设备可以独立地与其他设备连接并共享模型参数。本文探讨了影响DFL模型收敛性和泛化能力的关键因素,重点关注网络拓扑、非独立同分布(non-IID)数据分布和训练策略。我们首先推导了不同DFL模型部署策略的收敛速度。然后,我们综合分析了各种网络拓扑(例如,线性、环形、星形和网格),以及不同程度的非IID数据,并在广泛使用的机器学习模型(例如,经典模型、深度神经网络和大语言模型)和真实世界数据集上评估它们。结果表明,对于IID数据,模型收敛到最优解。然而,收敛速度与非IID数据分布的程度成反比。我们的发现将为在实际应用中设计有效的DFL模型部署提供有价值的指导。

🔬 方法详解

问题定义:论文旨在解决去中心化联邦学习(DFL)在实际部署中面临的性能问题。现有方法在选择合适的网络拓扑结构和处理非独立同分布(non-IID)数据时缺乏理论指导,导致模型收敛速度慢、泛化能力差等问题。

核心思路:论文的核心思路是通过理论分析和实验验证,研究不同网络拓扑结构和数据分布对DFL模型性能的影响。通过推导收敛速度,并结合实际数据集和模型进行评估,为DFL的实际部署提供指导。

技术框架:论文的技术框架主要包括以下几个部分:1) 推导不同DFL部署策略的收敛速度;2) 分析不同网络拓扑结构(线性、环形、星形、网格等)的特性;3) 在不同程度的非IID数据下评估模型性能;4) 使用经典机器学习模型、深度神经网络和大语言模型等多种模型进行验证;5) 在真实世界数据集上进行实验。

关键创新:论文的关键创新在于对DFL的收敛速度进行了理论推导,并将其与网络拓扑结构和数据分布联系起来。这为理解DFL的性能瓶颈提供了理论基础,并为优化DFL部署提供了指导。

关键设计:论文的关键设计包括:1) 针对不同的网络拓扑结构,分析其通信效率和模型聚合方式;2) 通过调整数据集的划分方式,控制非IID数据的程度;3) 选择具有代表性的机器学习模型和数据集,以保证实验结果的泛化能力;4) 采用合适的评估指标,如收敛速度、模型精度等,对DFL模型的性能进行全面评估。

🖼️ 关键图片

📊 实验亮点

实验结果表明,对于IID数据,DFL模型能够收敛到最优解。然而,收敛速度与非IID数据分布的程度成反比。不同网络拓扑结构对模型性能的影响也不同,例如,网格拓扑通常比星形拓扑具有更好的鲁棒性。这些发现为实际部署DFL模型提供了重要的参考依据。

🎯 应用场景

该研究成果可应用于各种需要保护用户数据隐私的场景,例如智能医疗、金融风控、自动驾驶等。通过选择合适的网络拓扑结构和优化数据分布,可以提高DFL模型的训练效率和泛化能力,从而更好地服务于实际应用。未来的研究可以进一步探索更复杂的网络拓扑结构和更有效的非IID数据处理方法。

📄 摘要(原文)

The widespread adoption of smartphones and smart wearable devices has led to the widespread use of Centralized Federated Learning (CFL) for training powerful machine learning models while preserving data privacy. However, CFL faces limitations due to its overreliance on a central server, which impacts latency and system robustness. Decentralized Federated Learning (DFL) is introduced to address these challenges. It facilitates direct collaboration among participating devices without relying on a central server. Each device can independently connect with other devices and share model parameters. This work explores crucial factors influencing the convergence and generalization capacity of DFL models, emphasizing network topologies, non-IID data distribution, and training strategies. We first derive the convergence rate of different DFL model deployment strategies. Then, we comprehensively analyze various network topologies (e.g., linear, ring, star, and mesh) with different degrees of non-IID data and evaluate them over widely adopted machine learning models (e.g., classical, deep neural networks, and Large Language Models) and real-world datasets. The results reveal that models converge to the optimal one for IID data. However, the convergence rate is inversely proportional to the degree of non-IID data distribution. Our findings will serve as valuable guidelines for designing effective DFL model deployments in practical applications.