Technologies on Effectiveness and Efficiency: A Survey of State Spaces Models

作者: Xingtai Lv, Youbang Sun, Kaiyan Zhang, Shang Qu, Xuekai Zhu, Yuchen Fan, Yi Wu, Ermo Hua, Xinwei Long, Ning Ding, Bowen Zhou

分类: cs.LG, cs.AI, cs.CL

发布日期: 2025-03-14

💡 一句话要点

综述性论文:深入剖析状态空间模型(SSM)的有效性和效率技术

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 状态空间模型 序列建模 长程依赖 Transformer HiPPO矩阵 Mamba 深度学习 综述

📋 核心要点

- Transformer模型在处理长序列时面临效率瓶颈,状态空间模型(SSM)作为一种替代方案,在长序列建模中展现出潜力。

- 该综述深入研究了SSM的理论基础和关键技术,重点关注如何提升SSM的有效性和效率。

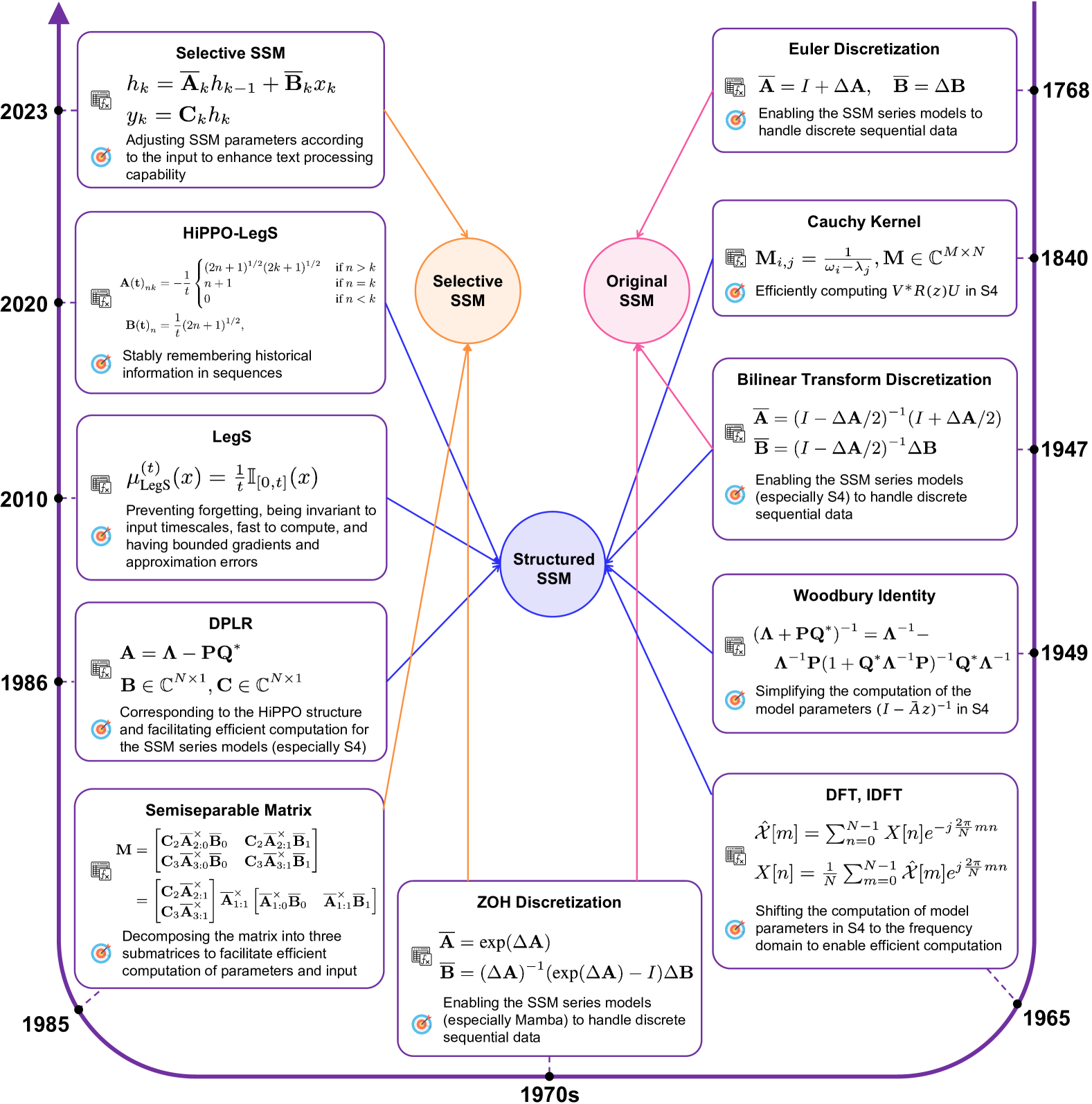

- 论文将SSM分为原始SSM、结构化SSM(如S4)和选择性SSM(如Mamba)三个主要类别,并进行了详细介绍。

📝 摘要(中文)

状态空间模型(SSM)作为一种有前景的替代方案,正日益受到关注,可以替代目前流行的基于Transformer的模型。与Transformer相比,SSM在处理序列数据或更长上下文的任务中表现出色,在效率显著提升的同时,性能也具有可比性。本综述对SSM进行了连贯和系统的概述,包括其理论动机、数学公式、与现有模型类的比较以及各种应用。我们将SSM系列分为三个主要部分,详细介绍了原始SSM、以S4为代表的结构化SSM以及以Mamba为代表的选择性SSM。我们强调技术性,并重点介绍了为解决SSM的有效性和效率而引入的各种关键技术。我们希望这份稿件能够作为研究人员探索SSM理论基础的入门。

🔬 方法详解

问题定义:现有Transformer模型在处理长序列数据时,计算复杂度高,效率较低。状态空间模型(SSM)旨在提供一种更高效的序列建模方法,尤其是在处理具有长程依赖关系的数据时。现有方法的痛点在于无法在效率和性能之间取得良好的平衡。

核心思路:SSM的核心思路是将序列数据建模为一个连续的状态转移过程,通过隐状态来捕捉序列中的依赖关系。通过精心设计的状态转移矩阵和观测矩阵,SSM能够有效地提取序列中的关键信息,并进行预测或分类。这种设计允许并行计算,从而提高效率。

技术框架:SSM通常包含以下几个主要模块:输入嵌入层、状态转移层、观测层和输出层。输入嵌入层将原始序列数据转换为向量表示。状态转移层根据当前状态和输入更新隐状态。观测层根据隐状态生成观测值。输出层根据观测值进行预测或分类。整个流程可以看作是一个循环神经网络的变体,但其关键在于状态转移矩阵的设计。

关键创新:SSM的关键创新在于其状态转移矩阵的设计,例如S4中的结构化状态空间模型,通过引入特定的结构(如HiPPO矩阵)来提高模型的表达能力和训练效率。Mamba则引入了选择机制,允许模型根据输入动态地调整状态转移矩阵,从而更好地捕捉序列中的关键信息。

关键设计:SSM的关键设计包括状态转移矩阵的初始化方法、状态转移函数的选择、以及损失函数的设计。例如,HiPPO矩阵是一种特殊的正交矩阵,可以有效地保持状态的梯度信息。选择机制通常通过门控机制实现,允许模型根据输入动态地选择需要关注的状态。

🖼️ 关键图片

📊 实验亮点

该综述重点介绍了SSM在有效性和效率方面的技术进展,并对原始SSM、结构化SSM(S4)和选择性SSM(Mamba)进行了详细的比较分析。论文强调了各种关键技术,例如HiPPO矩阵和选择机制,这些技术旨在提高SSM的性能和效率。虽然没有提供具体的实验数据,但综述强调了SSM在长序列建模方面的优势。

🎯 应用场景

状态空间模型在多个领域具有广泛的应用前景,包括自然语言处理(如语言建模、机器翻译)、语音识别、时间序列预测、图像处理和控制系统等。其高效的序列建模能力使其在处理长序列数据和实时任务中具有独特的优势。未来,SSM有望在更多领域得到应用,并推动相关技术的发展。

📄 摘要(原文)

State Space Models (SSMs) have emerged as a promising alternative to the popular transformer-based models and have been increasingly gaining attention. Compared to transformers, SSMs excel at tasks with sequential data or longer contexts, demonstrating comparable performances with significant efficiency gains. In this survey, we provide a coherent and systematic overview for SSMs, including their theoretical motivations, mathematical formulations, comparison with existing model classes, and various applications. We divide the SSM series into three main sections, providing a detailed introduction to the original SSM, the structured SSM represented by S4, and the selective SSM typified by Mamba. We put an emphasis on technicality, and highlight the various key techniques introduced to address the effectiveness and efficiency of SSMs. We hope this manuscript serves as an introduction for researchers to explore the theoretical foundations of SSMs.