Generative Modeling for Mathematical Discovery

作者: Jordan S. Ellenberg, Cristofero S. Fraser-Taliente, Thomas R. Harvey, Karan Srivastava, Andrew V. Sutherland

分类: cs.LG, math.CO

发布日期: 2025-03-14 (更新: 2025-03-17)

备注: 22 pages, 14 figures

💡 一句话要点

提出基于LLM驱动的遗传算法FunSearch,用于辅助数学家进行数学发现。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 数学发现 生成模型 大型语言模型 遗传算法 组合优化

📋 核心要点

- 现有数学发现方法依赖人工,效率低且需要大量专业知识,存在瓶颈。

- FunSearch利用LLM生成候选解,通过遗传算法迭代优化,寻找数学问题的新解。

- 实验表明,FunSearch在组合学和数论问题中有效,并能泛化到其他相关问题。

📝 摘要(中文)

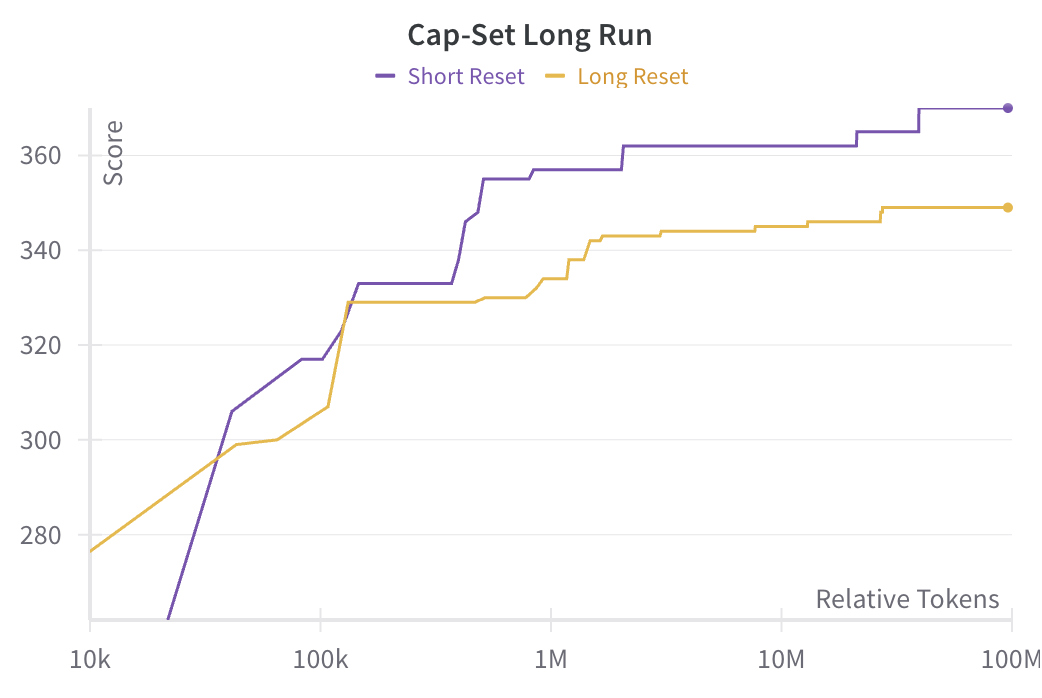

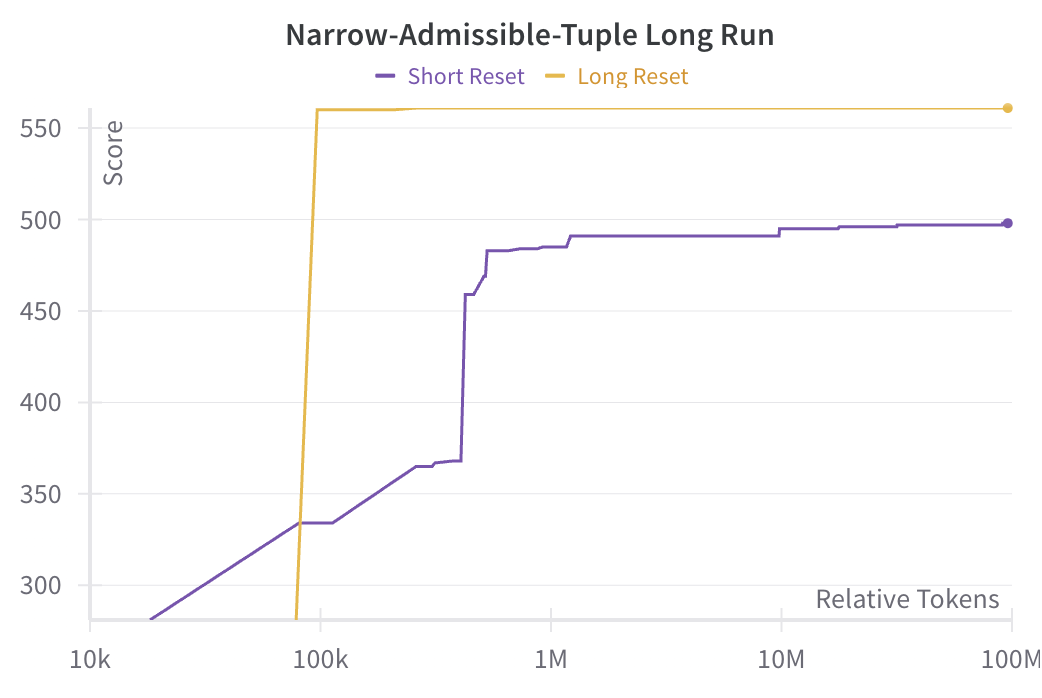

本文介绍了一种LLM驱动的遗传算法FunSearch的新实现,旨在生成数学家感兴趣的例子,该算法已在极值组合学问题中取得了一些成功。我们的实现旨在为实际工作的数学家提供便利;它不需要机器学习方面的专业知识或访问高性能计算资源。将FunSearch应用于新问题涉及修改一小段Python代码,并从众多第三方提供商中选择一个大型语言模型(LLM)。我们在三个不同的问题上对我们的实现进行了基准测试,获得了可以为FunSearch在新问题中的应用提供信息的指标。我们的结果表明,FunSearch在各种组合和数论环境中成功学习,并且在某些情况下学习到的原则可以推广到最初训练的问题之外。

🔬 方法详解

问题定义:论文旨在解决数学发现过程中人工成本高、效率低的问题。现有方法依赖于数学家的专业知识和直觉,难以发现新的数学规律和结构。特别是在组合学和数论等领域,寻找满足特定条件的例子或证明某些猜想非常困难。

核心思路:论文的核心思路是利用大型语言模型(LLM)的生成能力,自动生成候选的数学对象(例如,组合结构或数论序列),然后通过遗传算法对这些候选对象进行迭代优化。LLM作为“创意引擎”,负责生成多样化的候选解,而遗传算法则负责选择和组合优秀的候选解,从而逐步逼近问题的最优解。

技术框架:FunSearch的整体框架包含以下几个主要模块:1) LLM:负责生成候选解,可以根据问题的特点选择不同的LLM。2) 评估函数:用于评估候选解的质量,通常由数学家或领域专家设计。3) 遗传算法:负责选择、交叉和变异候选解,以生成新的候选解。4) 存储库:用于存储已评估的候选解,避免重复计算。整个流程是一个迭代过程,LLM生成候选解,评估函数评估其质量,遗传算法根据评估结果选择和组合候选解,生成新的候选解,直到找到满意的解或达到迭代次数上限。

关键创新:FunSearch的关键创新在于将LLM的生成能力与遗传算法的优化能力相结合,从而实现自动化的数学发现。与传统的基于规则或搜索的数学发现方法相比,FunSearch能够探索更广阔的解空间,并发现更复杂的数学结构。此外,FunSearch的设计目标是易于使用,即使没有机器学习背景的数学家也能轻松上手。

关键设计:FunSearch的关键设计包括:1) LLM的选择:根据问题的特点选择合适的LLM,例如,对于组合学问题,可以选择擅长生成序列的LLM。2) 评估函数的设计:评估函数需要能够准确地评估候选解的质量,并且计算效率要高。3) 遗传算法的参数设置:例如,种群大小、交叉概率和变异概率等参数需要根据问题的特点进行调整。4) Python代码的模块化:FunSearch的核心代码被设计成模块化的,方便用户修改和扩展。

🖼️ 关键图片

📊 实验亮点

论文在三个不同的问题上对FunSearch进行了基准测试,结果表明FunSearch在各种组合和数论环境中成功学习,并且在某些情况下学习到的原则可以推广到最初训练的问题之外。具体性能数据未知,但结果表明该方法具有良好的泛化能力。

🎯 应用场景

FunSearch可应用于各种数学领域,例如组合学、数论、图论等,辅助数学家发现新的数学规律、证明猜想、设计算法。它还可用于解决实际问题,例如优化算法、密码学等。未来,FunSearch有望成为数学研究的重要工具,加速数学发现的进程。

📄 摘要(原文)

We present a new implementation of the LLM-driven genetic algorithm {\it funsearch}, whose aim is to generate examples of interest to mathematicians and which has already had some success in problems in extremal combinatorics. Our implementation is designed to be useful in practice for working mathematicians; it does not require expertise in machine learning or access to high-performance computing resources. Applying {\it funsearch} to a new problem involves modifying a small segment of Python code and selecting a large language model (LLM) from one of many third-party providers. We benchmarked our implementation on three different problems, obtaining metrics that may inform applications of {\it funsearch} to new problems. Our results demonstrate that {\it funsearch} successfully learns in a variety of combinatorial and number-theoretic settings, and in some contexts learns principles that generalize beyond the problem originally trained on.