Adapting Large Language Models for Parameter-Efficient Log Anomaly Detection

作者: Ying Fu Lim, Jiawen Zhu, Guansong Pang

分类: cs.LG, cs.CL

发布日期: 2025-03-11

备注: 12 pages, 5 figures, accepted by PAKDD 2025 special session

🔗 代码/项目: GITHUB

💡 一句话要点

利用参数高效微调方法,将大型语言模型应用于日志异常检测

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 日志异常检测 大型语言模型 参数高效微调 低秩适应 表征微调

📋 核心要点

- 现有日志异常检测方法难以有效利用大型语言模型的强大能力,限制了检测性能的提升。

- 论文探索了使用参数高效微调技术(PEFT)来调整大型语言模型,以降低计算成本并提升日志异常检测的效率。

- 实验结果表明,基于PEFT的LLM方法在多个日志数据集上表现出良好的性能、稳定性和泛化能力。

📝 摘要(中文)

日志异常检测(LAD)旨在识别日志数据中的异常模式,这对于评估系统的安全性和状况至关重要。虽然大型语言模型(LLM)在各个领域都取得了巨大的成功,但LLM在日志异常检测中的应用在很大程度上尚未被探索。这项工作旨在填补这一空白。由于完全微调LLM的成本过高,我们探索了使用参数高效微调技术(PEFT)来调整LLM以适应LAD。为了深入探索LLM驱动的LAD的潜力,我们对利用两种最流行的PEFT——低秩适应(LoRA)和表征微调(ReFT)——进行了全面的研究,以利用三种不同规模的著名LLM,包括RoBERTa、GPT-2和Llama-3,进行参数高效的LAD。在四个公共日志数据集上进行了全面的实验,以揭示在几个关键视角下有效LLM驱动的LAD的重要见解,包括这些基于PEFT的LLM驱动的LAD方法的有效性、它们的稳定性、样本效率、关于不稳定日志的鲁棒性以及跨数据集泛化。

🔬 方法详解

问题定义:论文旨在解决日志异常检测问题,现有方法难以充分利用大型语言模型的潜力,并且完全微调LLM的成本过高,限制了其在日志异常检测中的应用。现有方法可能无法很好地处理日志数据中的噪声和不稳定性,导致检测性能下降。

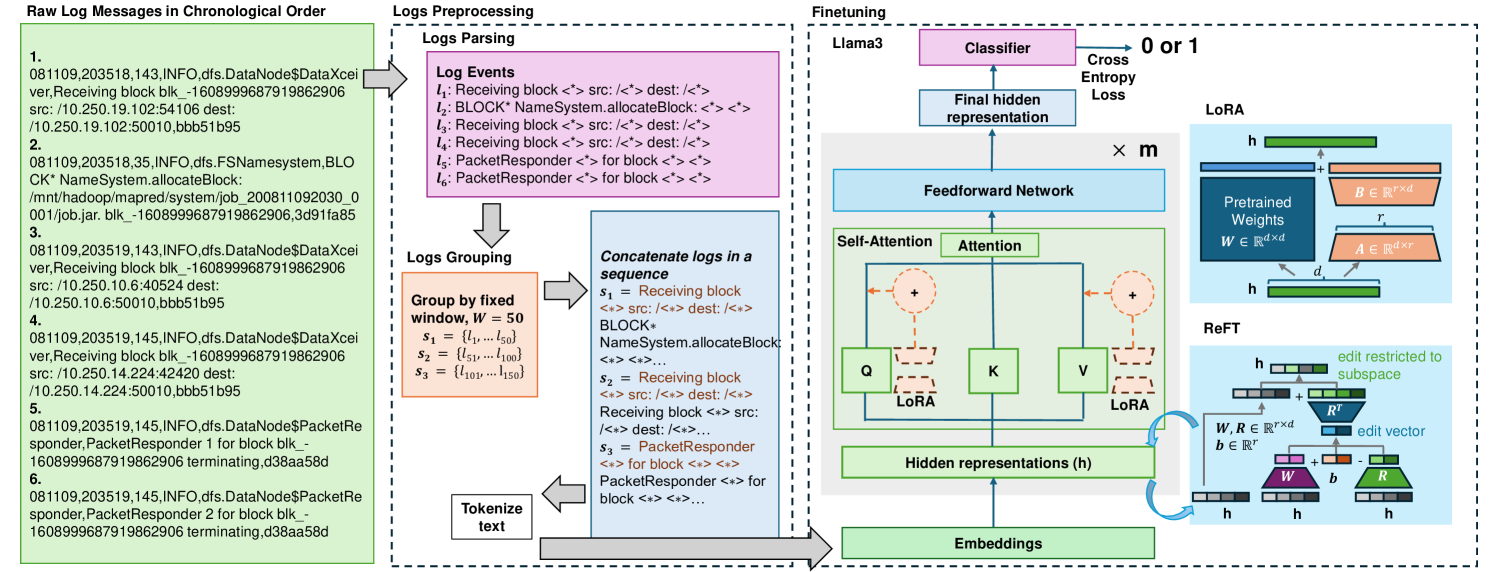

核心思路:论文的核心思路是利用参数高效微调(PEFT)技术,如LoRA和ReFT,将预训练的大型语言模型(LLM)适应于日志异常检测任务。通过只微调少量参数,降低了计算成本,同时保留了LLM的强大表示能力。

技术框架:整体框架包括以下步骤:1)选择预训练的LLM(如RoBERTa、GPT-2、Llama-3);2)使用LoRA或ReFT等PEFT方法对LLM进行微调,使其适应日志数据;3)使用微调后的LLM进行日志异常检测,例如,将日志数据输入LLM,并根据LLM的输出判断是否存在异常。

关键创新:论文的关键创新在于探索了参数高效微调技术在日志异常检测中的应用,并对不同的PEFT方法和LLM进行了全面的比较和分析。这为利用LLM进行日志异常检测提供了一种高效且实用的方法。

关键设计:论文的关键设计包括:1)选择合适的PEFT方法(LoRA或ReFT),并调整其参数,如LoRA的秩;2)设计合适的损失函数,以优化LLM的微调过程;3)对日志数据进行预处理,以提高LLM的输入质量;4)使用不同的评估指标,如准确率、召回率和F1值,来评估LLM的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于PEFT的LLM方法在四个公共日志数据集上均取得了良好的性能。例如,在某些数据集上,基于LoRA或ReFT的LLM方法相比传统方法,F1值提升了显著幅度。此外,实验还验证了该方法在样本效率、鲁棒性和跨数据集泛化能力方面的优势。

🎯 应用场景

该研究成果可应用于各种需要实时监控和异常检测的系统,例如网络安全、云计算平台、工业控制系统等。通过及时发现和预警异常事件,可以有效提升系统的安全性和可靠性,减少潜在的经济损失和安全风险。未来,该方法可以进一步扩展到其他类型的时序数据异常检测任务中。

📄 摘要(原文)

Log Anomaly Detection (LAD) seeks to identify atypical patterns in log data that are crucial to assessing the security and condition of systems. Although Large Language Models (LLMs) have shown tremendous success in various fields, the use of LLMs in enabling the detection of log anomalies is largely unexplored. This work aims to fill this gap. Due to the prohibitive costs involved in fully fine-tuning LLMs, we explore the use of parameter-efficient fine-tuning techniques (PEFTs) for adapting LLMs to LAD. To have an in-depth exploration of the potential of LLM-driven LAD, we present a comprehensive investigation of leveraging two of the most popular PEFTs -- Low-Rank Adaptation (LoRA) and Representation Fine-tuning (ReFT) -- to tap into three prominent LLMs of varying size, including RoBERTa, GPT-2, and Llama-3, for parameter-efficient LAD. Comprehensive experiments on four public log datasets are performed to reveal important insights into effective LLM-driven LAD in several key perspectives, including the efficacy of these PEFT-based LLM-driven LAD methods, their stability, sample efficiency, robustness w.r.t. unstable logs, and cross-dataset generalization. Code is available at https://github.com/mala-lab/LogADReft.