Revisiting Early Detection of Sexual Predators via Turn-level Optimization

作者: Jinmyeong An, Sangwon Ryu, Heejin Do, Yunsu Kim, Jungseul Ok, Gary Geunbae Lee

分类: cs.LG, cs.AI, cs.CL

发布日期: 2025-03-09

备注: Accepted as a main conference paper at NAACL 2025

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于Turn-level优化的SCoRL模型,用于及早发现网络性侵者

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 网络性侵检测 早期检测 强化学习 Turn-level优化 诱骗沟通理论

📋 核心要点

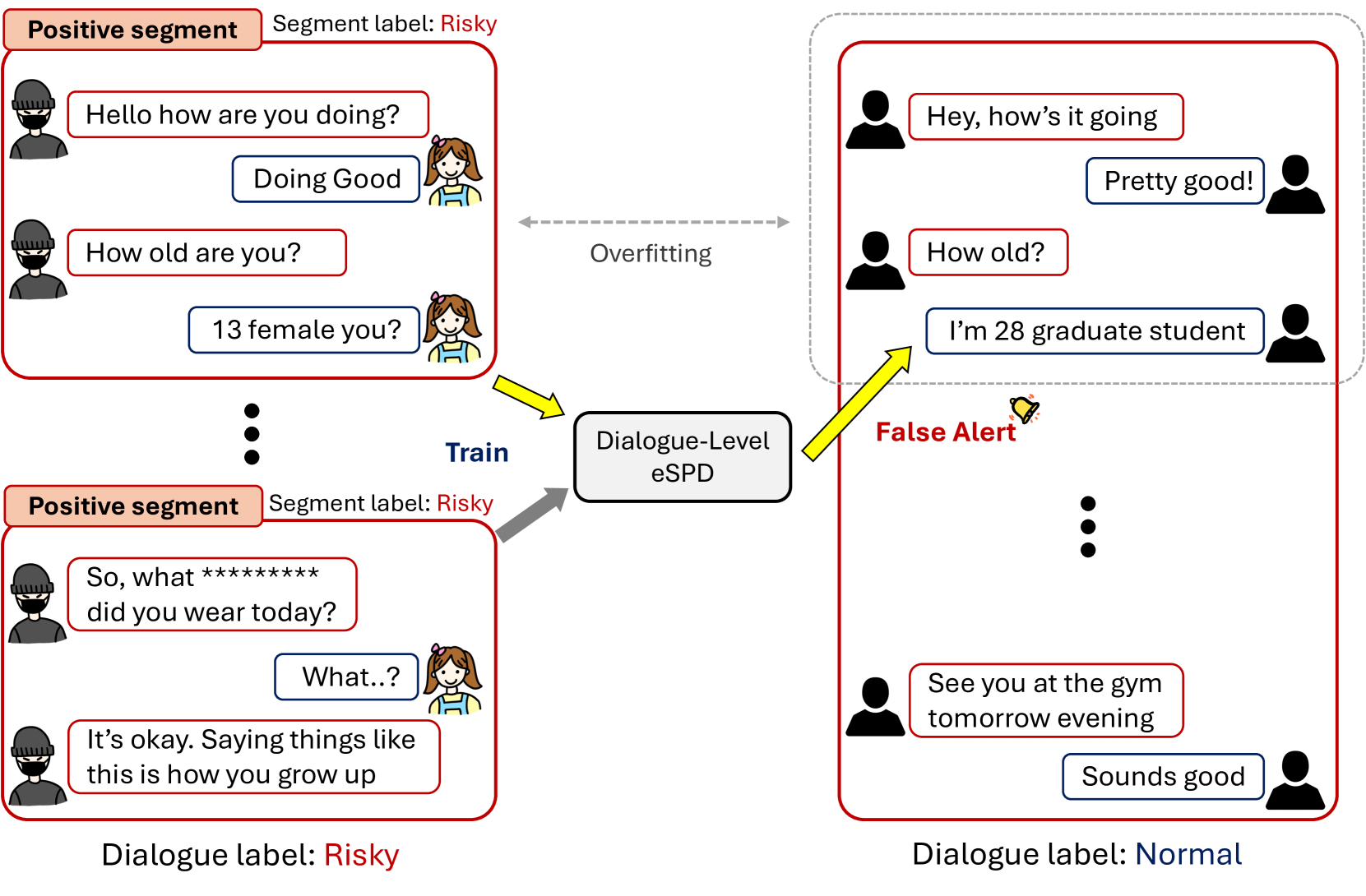

- 现有方法依赖聊天级别的风险标签,导致对危险言论的监督不足,难以确定最佳干预时机。

- 提出速度控制强化学习(SCoRL),结合诱骗沟通理论,利用turn-level风险标签优化干预时机。

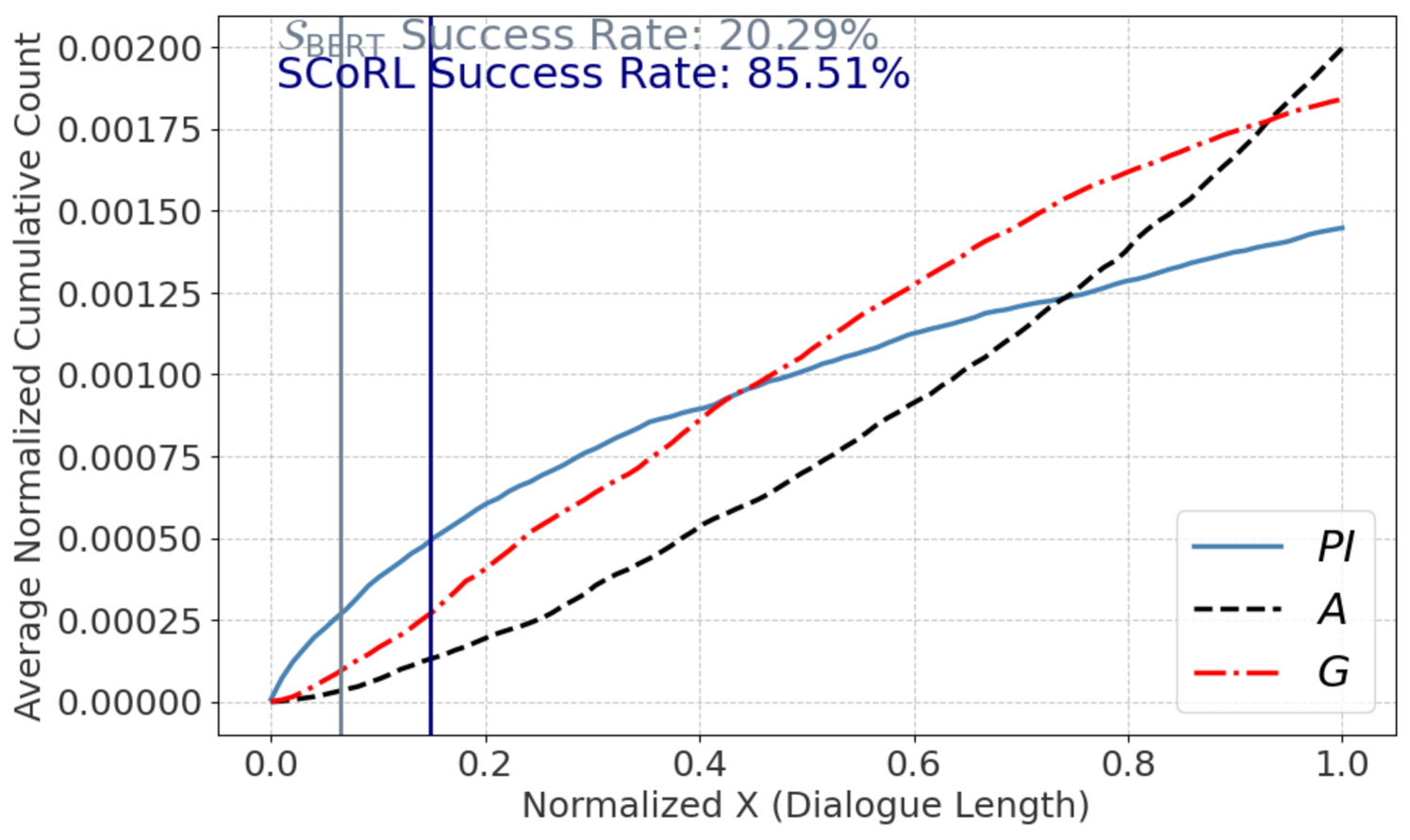

- 实验表明,SCoRL能更有效地阻止网络性侵,并在提高性能的同时,直观地识别最佳早期干预点。

📝 摘要(中文)

网络性侵(Online grooming)是一种严重的社会威胁,性侵者通过微妙和渐进的操纵逐步诱骗儿童受害者。因此,及时干预对于主动保护至关重要。然而,以往的方法依赖于聊天级别的风险标签,导致对危险话语的弱监督,无法确定最佳干预点(即,过早下结论)。为了及时检测,我们提出了一种速度控制强化学习(SCoRL)方法,该方法结合了源于诱骗沟通理论(LCT)的实用策略。为了捕捉性侵者turn-level的诱骗行为,我们使用基于LCT的turn-level风险标签。然后,我们设计了一种新颖的速度控制奖励函数,该函数平衡了基于turn-level风险标签的速度和准确性之间的权衡;因此,SCoRL可以识别最佳干预时刻。此外,我们引入了一种turn-level指标用于精确评估,识别了先前使用的聊天级别指标的局限性。实验结果表明,SCoRL有效地阻止了网络性侵,提供了一种更主动和及时的解决方案。进一步的分析表明,我们的方法在直观地识别最佳早期干预点的同时,提高了性能。

🔬 方法详解

问题定义:论文旨在解决网络性侵早期检测中,现有方法无法准确确定最佳干预时机的问题。现有方法通常依赖于聊天级别的风险标签,这导致对个体危险言论的监督不足,容易过早或过晚地进行干预,从而影响检测的准确性和及时性。

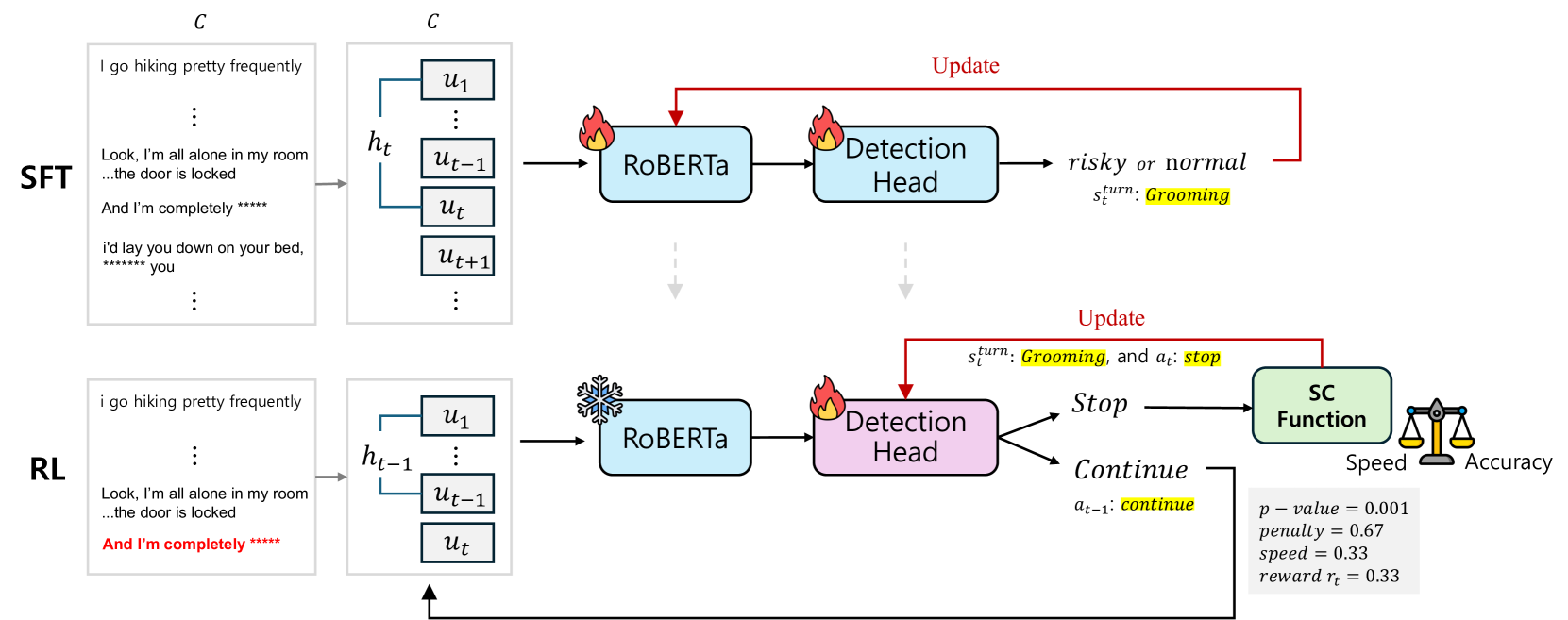

核心思路:论文的核心思路是利用强化学习,通过速度控制奖励函数来平衡检测的速度和准确性,从而找到最佳的干预时机。借鉴诱骗沟通理论(LCT),将性侵者的诱骗行为分解为turn-level的风险,并以此作为强化学习的依据。

技术框架:SCoRL模型的整体框架包括以下几个主要部分:1)Turn-level风险评估:基于LCT对每个对话turn进行风险评估,生成turn-level的风险标签。2)强化学习Agent:Agent根据当前对话状态选择是否进行干预。3)速度控制奖励函数:该函数根据Agent的干预速度和准确性给予奖励,引导Agent学习最佳的干预策略。4)环境:模拟网络性侵场景,提供对话数据和风险标签。

关键创新:论文的关键创新在于:1)引入了turn-level的风险标签,更精细地刻画了性侵者的诱骗行为。2)设计了速度控制奖励函数,平衡了检测的速度和准确性,从而找到最佳的干预时机。3)提出了turn-level的评估指标,更准确地评估了早期检测的效果。

关键设计:速度控制奖励函数是SCoRL的关键设计之一。该函数的设计目标是鼓励Agent在保证准确性的前提下,尽可能早地进行干预。具体而言,奖励函数包含两个部分:1)准确性奖励:如果Agent在风险turn进行干预,则获得正向奖励;否则,获得负向奖励。2)速度奖励:Agent越早进行干预,获得的奖励越高。通过调整这两个部分的权重,可以控制Agent的干预速度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SCoRL模型在网络性侵早期检测任务中取得了显著的性能提升。相较于传统的聊天级别检测方法,SCoRL能够更早、更准确地识别出性侵行为,并有效地阻止性侵的发生。通过速度控制奖励函数,SCoRL能够在保证准确性的前提下,显著提高检测的速度,为及时干预争取了宝贵的时间。

🎯 应用场景

该研究成果可应用于在线社交平台、儿童保护机构等,用于及早发现和阻止网络性侵行为。通过及早干预,可以有效保护儿童免受性侵者的侵害,维护网络安全和社会稳定。未来,该技术可以与其他安全技术相结合,构建更完善的网络安全防护体系。

📄 摘要(原文)

Online grooming is a severe social threat where sexual predators gradually entrap child victims with subtle and gradual manipulation. Therefore, timely intervention for online grooming is critical for proactive protection. However, previous methods fail to determine the optimal intervention points (i.e., jump to conclusions) as they rely on chat-level risk labels by causing weak supervision of risky utterances. For timely detection, we propose speed control reinforcement learning (SCoRL) (The code and supplementary materials are available at https://github.com/jinmyeongAN/SCoRL), incorporating a practical strategy derived from luring communication theory (LCT). To capture the predator's turn-level entrapment, we use a turn-level risk label based on the LCT. Then, we design a novel speed control reward function that balances the trade-off between speed and accuracy based on turn-level risk label; thus, SCoRL can identify the optimal intervention moment. In addition, we introduce a turn-level metric for precise evaluation, identifying limitations in previously used chat-level metrics. Experimental results show that SCoRL effectively preempted online grooming, offering a more proactive and timely solution. Further analysis reveals that our method enhances performance while intuitively identifying optimal early intervention points.