Riemann$^2$: Learning Riemannian Submanifolds from Riemannian Data

作者: Leonel Rozo, Miguel González-Duque, Noémie Jaquier, Søren Hauberg

分类: cs.LG, cs.RO

发布日期: 2025-03-07

备注: Accepted at AISTATS 2025

💡 一句话要点

提出Riemann$^2$,学习黎曼流形上的黎曼子流形表示

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 黎曼流形学习 潜在变量模型 高斯过程 几何约束 机器人运动合成

📋 核心要点

- 现有潜在变量模型在处理约束数据时,忽略了几何约束或无法提供有意义的潜在空间度量。

- 论文提出学习黎曼潜在表示,通过估计Wrapped高斯过程潜在变量模型的拉回度量来显式考虑数据几何。

- 该方法在机器人运动合成和大脑连接组分析等任务中表现良好,验证了几何感知距离和最短路径的有效性。

📝 摘要(中文)

本文提出了一种学习几何数据黎曼潜在表示的方法。针对单位范数向量或对称正定矩阵等约束数据,现有方法忽略了潜在的几何约束或无法在潜在空间中提供有意义的度量。为了解决这些局限性,我们估计了一个Wrapped高斯过程潜在变量模型所导出的拉回度量,该模型显式地考虑了数据几何。这使得我们能够在潜在空间中定义几何感知的距离和最短路径,同时确保我们的模型只将概率质量分配给数据流形。该方法推广了先前的工作,并允许我们处理各种领域的复杂任务,包括机器人运动合成和大脑连接组分析。

🔬 方法详解

问题定义:现有潜在变量模型在处理具有几何约束的数据(如单位范数向量、对称正定矩阵)时,要么忽略了数据本身的几何结构,要么在学习到的潜在空间中无法定义有意义的度量。这导致模型无法有效地捕捉数据的内在结构,限制了其在相关任务中的应用。

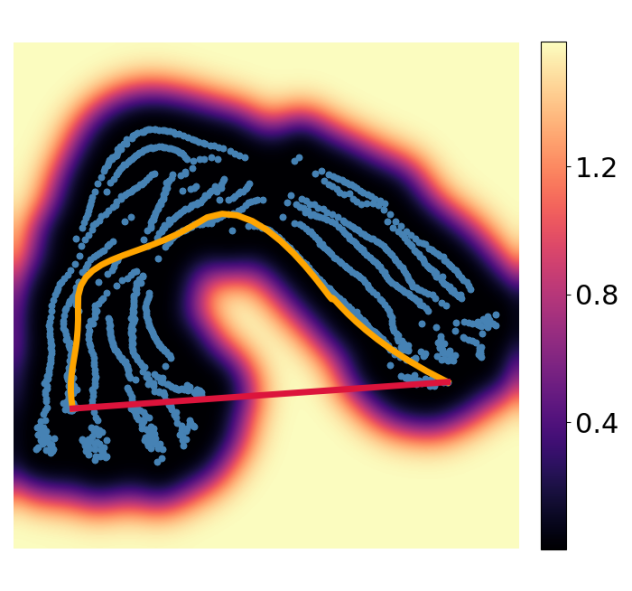

核心思路:论文的核心思路是学习数据的黎曼潜在表示。通过将数据映射到一个黎曼流形上,并利用黎曼几何的工具(如拉回度量),可以在潜在空间中定义几何感知的距离和最短路径。这样,模型就能更好地捕捉数据的几何结构,并进行有效的推理。

技术框架:该方法基于Wrapped高斯过程潜在变量模型(WGP-LVM)。首先,将高维数据映射到低维潜在空间。然后,利用WGP-LVM估计由映射诱导的拉回度量。该拉回度量定义了潜在空间中的黎曼结构,从而可以计算几何感知的距离和最短路径。模型训练的目标是最大化数据的似然函数,同时考虑数据流形的几何约束。

关键创新:该方法最重要的创新点在于显式地考虑了数据几何,并利用黎曼几何的工具来学习数据的潜在表示。与现有方法相比,该方法能够更好地捕捉数据的内在结构,并在潜在空间中定义有意义的度量。此外,该方法还推广了先前的工作,使其能够处理更广泛的几何数据。

关键设计:模型使用Wrapped高斯过程作为非线性映射函数,Wrapped高斯过程能够保证模型只将概率质量分配给数据流形。拉回度量的估计是关键步骤,它决定了潜在空间的几何结构。损失函数包括数据似然项和正则化项,用于防止过拟合。模型的参数通过最大化损失函数进行优化。

🖼️ 关键图片

📊 实验亮点

论文在机器人运动合成和大脑连接组分析等任务上进行了实验验证。结果表明,该方法能够有效地学习数据的黎曼潜在表示,并在潜在空间中定义有意义的度量。与现有方法相比,该方法在这些任务上取得了更好的性能,验证了几何感知距离和最短路径的有效性。具体性能数据未知。

🎯 应用场景

该研究成果可应用于机器人运动合成、大脑连接组分析等领域。在机器人运动合成中,可以学习机器人的运动轨迹的潜在表示,从而实现更自然、更高效的运动控制。在大脑连接组分析中,可以学习大脑连接模式的潜在表示,从而更好地理解大脑的功能和结构。该方法还可推广到其他具有几何约束的数据分析任务中,具有广泛的应用前景。

📄 摘要(原文)

Latent variable models are powerful tools for learning low-dimensional manifolds from high-dimensional data. However, when dealing with constrained data such as unit-norm vectors or symmetric positive-definite matrices, existing approaches ignore the underlying geometric constraints or fail to provide meaningful metrics in the latent space. To address these limitations, we propose to learn Riemannian latent representations of such geometric data. To do so, we estimate the pullback metric induced by a Wrapped Gaussian Process Latent Variable Model, which explicitly accounts for the data geometry. This enables us to define geometry-aware notions of distance and shortest paths in the latent space, while ensuring that our model only assigns probability mass to the data manifold. This generalizes previous work and allows us to handle complex tasks in various domains, including robot motion synthesis and analysis of brain connectomes.