Shifting Perspectives: Steering Vectors for Robust Bias Mitigation in LLMs

作者: Zara Siddique, Irtaza Khalid, Liam D. Turner, Luis Espinosa-Anke

分类: cs.LG, cs.AI, cs.CL

发布日期: 2025-03-07 (更新: 2025-08-13)

备注: Submitted to AACL 2025

💡 一句话要点

提出基于Steering Vectors的偏差缓解方法,提升LLM的公平性和安全性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 偏差缓解 Steering Vectors 公平性 AI安全

📋 核心要点

- 现有LLM存在社会偏见,影响公平性与安全性,传统缓解方法计算成本高或效果不佳。

- 利用steering vectors在模型前向传播中调整激活值,针对不同偏见轴进行定向干预。

- 实验表明,该方法在多个数据集上有效降低偏见,同时对模型性能影响较小。

📝 摘要(中文)

本文提出了一种新颖的偏差缓解方法,通过应用steering vectors来修改大型语言模型(LLM)前向传播中的激活值。在BBQ数据集的训练子集上,我们计算了8个steering vectors,每个对应于不同的社会偏见轴,例如年龄、性别或种族。我们将这些向量的有效性与4个数据集上的3种额外的偏差缓解方法进行了比较。在BBQ数据集上优化后,我们单独调整的steering vectors在BBQ上平均提高了12.8%,在CLEAR-Bias上提高了8.3%,在StereoSet上提高了1%。在所有情况下,都优于prompting和Self-Debias,在17个评估中,有12个优于微调。此外,在测试的四种偏差缓解方法中,steering vectors对MMLU分数的影响最小。这项工作首次系统地研究了steering vectors在偏差缓解中的应用,并证明它们是一种强大且计算高效的策略,可用于减少LLM中的偏差,对提高AI安全性具有更广泛的意义。

🔬 方法详解

问题定义:大型语言模型(LLM)在训练过程中容易学习并放大社会偏见,导致在下游任务中产生不公平或歧视性的结果。现有的偏差缓解方法,如微调和prompting,要么计算成本高昂,要么效果有限,难以在降低偏见的同时保持模型性能。

核心思路:本文的核心思路是通过steering vectors来干预LLM的内部激活,从而在不重新训练整个模型的情况下,有针对性地减少特定类型的社会偏见。steering vectors本质上是模型内部表示空间中的方向向量,通过在模型的激活中添加这些向量,可以引导模型的输出朝着更公平、更中立的方向发展。

技术框架:该方法主要包含以下几个步骤:1) 选择具有代表性的偏见数据集(如BBQ数据集)的子集,用于训练steering vectors。2) 针对不同的社会偏见轴(如年龄、性别、种族),分别计算对应的steering vector。3) 在模型前向传播过程中,将计算得到的steering vector添加到模型的激活中,从而影响模型的输出。4) 在多个数据集上评估该方法的效果,并与其他偏差缓解方法进行比较。

关键创新:该方法的主要创新在于首次系统性地研究了steering vectors在LLM偏差缓解中的应用。与传统的微调方法相比,steering vectors的计算成本更低,且对模型性能的影响更小。此外,该方法可以针对不同的偏见轴进行定向干预,从而实现更精细化的偏差缓解。

关键设计:steering vectors的计算方式为:首先,收集一组包含特定偏见轴的提示词(例如,关于年龄的提示词)。然后,使用这些提示词分别输入到原始模型和目标模型(例如,经过某种偏差缓解方法处理后的模型)中,得到对应的激活值。最后,将原始模型的激活值与目标模型的激活值之间的差异作为steering vector。在实际应用中,需要仔细选择用于训练steering vectors的数据集和提示词,以确保steering vectors能够有效地减少目标偏见。

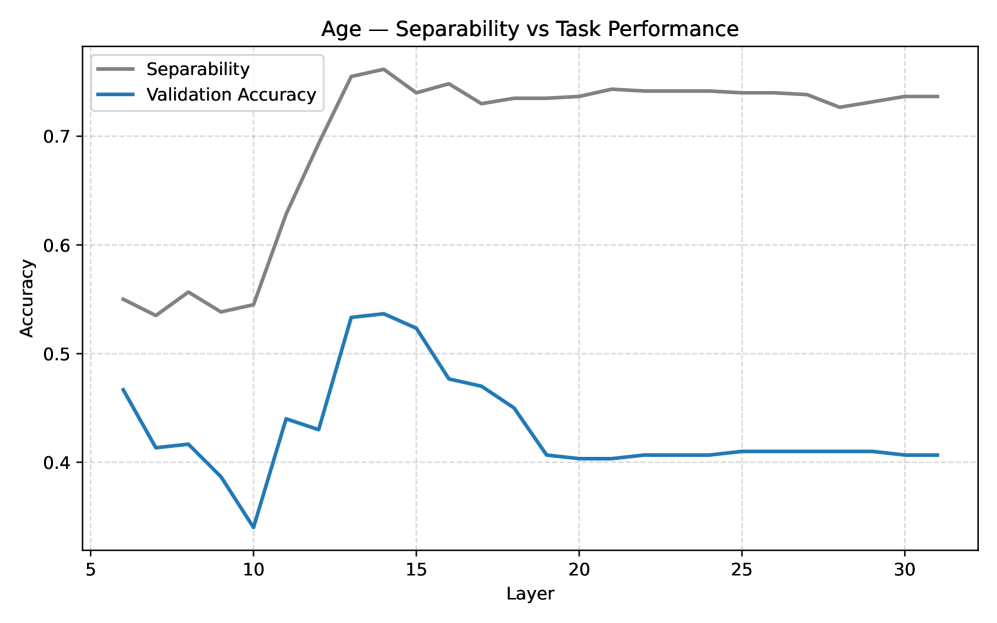

🖼️ 关键图片

📊 实验亮点

实验结果表明,在BBQ数据集上优化后,该方法在BBQ上平均提高了12.8%,在CLEAR-Bias上提高了8.3%,在StereoSet上提高了1%。与prompting和Self-Debias相比,该方法在所有情况下都表现更好,并且在17个评估中,有12个优于微调。此外,steering vectors对MMLU分数的影响最小,表明该方法在降低偏见的同时,能够较好地保持模型性能。

🎯 应用场景

该研究成果可应用于各种需要公平性和安全性的LLM应用场景,例如招聘、信贷评估、医疗诊断等。通过减少LLM中的偏见,可以避免歧视性结果,提高决策的公正性和透明度。未来,该方法可以进一步扩展到其他类型的偏见缓解,并与其他技术相结合,构建更安全、更可靠的AI系统。

📄 摘要(原文)

We present a novel approach to bias mitigation in large language models (LLMs) by applying steering vectors to modify model activations in forward passes. We compute 8 steering vectors, each corresponding to a different social bias axis, such as age, gender, or race, on a training subset of the BBQ dataset and compare the effectiveness of these to 3 additional bias mitigation methods across 4 datasets. When optimized on the BBQ dataset, our individually tuned steering vectors achieve average improvements of 12.8% on BBQ, 8.3% on CLEAR-Bias, and 1% on StereoSet, and show improvements over prompting and Self-Debias in all cases, and improvements over fine-tuning in 12 out of 17 evaluations. In addition, steering vectors showed the lowest impact on MMLU scores of the four bias mitigation methods tested. The work presents the first systematic investigation of steering vectors for bias mitigation, and we demonstrate that they are a powerful and computationally efficient strategy for reducing bias in LLMs, with broader implications for enhancing AI safety.