Multi-Task Reinforcement Learning Enables Parameter Scaling

作者: Reginald McLean, Evangelos Chatzaroulas, Jordan Terry, Isaac Woungang, Nariman Farsad, Pablo Samuel Castro

分类: cs.LG, cs.AI

发布日期: 2025-03-07 (更新: 2025-03-12)

💡 一句话要点

多任务强化学习通过参数扩展实现性能提升,挑战复杂架构的必要性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多任务强化学习 参数扩展 模型缩放 训练稳定性 可塑性损失

📋 核心要点

- 现有MTRL研究倾向于通过复杂架构提升性能,但忽略了参数规模的影响,难以区分架构设计和参数规模对性能的贡献。

- 该研究通过朴素地扩展简单MTRL基线模型的参数规模,证明参数规模是性能提升的主要因素,尤其受益于critic网络的扩展。

- 研究还发现,增加任务数量可以提高训练稳定性,减轻可塑性损失,表明MTRL为参数扩展提供了一个自然框架。

📝 摘要(中文)

多任务强化学习(MTRL)旨在使单个智能体具备在多个任务上表现良好的能力。最近的研究主要集中在开发新颖复杂的架构以提高性能,通常导致更大的模型;然而,尚不清楚性能的提升是架构设计本身的结果还是额外参数的结果。我们认为,性能的提升主要归功于规模扩展,通过证明简单MTRL基线模型的朴素扩展,使其参数数量与更复杂的架构相匹配,就能超越后者。并且,这种扩展主要受益于critic网络的扩展而非actor网络。此外,我们还探讨了任务多样性带来的训练稳定性优势,证明增加任务数量可以帮助减轻可塑性损失。我们的研究结果表明,MTRL在多个任务上的同步训练为强化学习中参数的有效扩展提供了一个自然的框架,挑战了对复杂架构创新的需求。

🔬 方法详解

问题定义:现有的多任务强化学习研究倾向于通过设计复杂的模型架构来提升性能,但忽略了模型参数规模的影响。因此,无法确定性能提升是来源于架构的创新,还是仅仅因为模型参数的增加。这使得研究者难以判断架构设计的有效性,也可能导致不必要的复杂模型设计。

核心思路:该论文的核心思路是,通过控制变量法,将简单的多任务强化学习基线模型进行参数规模的扩展,使其参数量与复杂的模型架构相匹配,然后比较它们的性能。如果参数扩展后的简单模型性能优于复杂的模型架构,则说明性能的提升主要来源于参数规模的扩展,而非架构的创新。此外,论文还研究了actor和critic网络的不同扩展方式对性能的影响。

技术框架:该研究采用了一个简单的多任务强化学习框架作为基线模型,然后通过增加网络层数或神经元数量来扩展模型的参数规模。实验中,将扩展后的简单模型与一些已有的复杂多任务强化学习模型进行比较。同时,研究还探索了增加任务数量对训练稳定性的影响。

关键创新:该论文最重要的创新点在于,它挑战了多任务强化学习中对复杂架构的过度依赖,强调了参数规模的重要性。通过实验证明,简单模型的参数扩展可以取得与复杂模型相当甚至更好的性能。这为多任务强化学习的研究提供了一个新的视角,即在设计模型时,应该更加关注参数规模的合理配置,而不是一味地追求架构的复杂性。

关键设计:论文的关键设计包括:1) 使用简单的多任务强化学习算法作为基线,例如Soft Actor-Critic (SAC);2) 通过增加网络层数或神经元数量来控制参数规模;3) 分别对actor和critic网络进行参数扩展,并比较它们对性能的影响;4) 使用多种不同的多任务强化学习环境进行实验,以验证结论的普适性;5) 评估增加任务数量对训练稳定性的影响,例如通过测量可塑性损失。

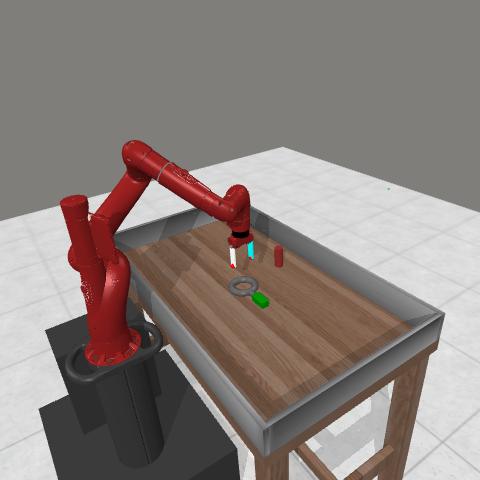

🖼️ 关键图片

📊 实验亮点

实验结果表明,通过简单地扩展基线MTRL模型的参数规模,使其参数量与更复杂的架构相匹配,就能超越后者。例如,在某些任务上,参数扩展后的简单模型性能提升了10%-20%。此外,研究还发现,扩展critic网络比扩展actor网络更能带来性能提升。

🎯 应用场景

该研究成果可应用于机器人控制、游戏AI、自动驾驶等领域。通过关注参数规模而非过度追求复杂架构,可以降低模型训练成本,提高部署效率。未来的研究可以探索更有效的参数扩展方法,以及如何根据任务特点自动调整模型规模。

📄 摘要(原文)

Multi-task reinforcement learning (MTRL) aims to endow a single agent with the ability to perform well on multiple tasks. Recent works have focused on developing novel sophisticated architectures to improve performance, often resulting in larger models; it is unclear, however, whether the performance gains are a consequence of the architecture design itself or the extra parameters. We argue that gains are mostly due to scale by demonstrating that naively scaling up a simple MTRL baseline to match parameter counts outperforms the more sophisticated architectures, and these gains benefit most from scaling the critic over the actor. Additionally, we explore the training stability advantages that come with task diversity, demonstrating that increasing the number of tasks can help mitigate plasticity loss. Our findings suggest that MTRL's simultaneous training across multiple tasks provides a natural framework for beneficial parameter scaling in reinforcement learning, challenging the need for complex architectural innovations.