TS-RAG: Retrieval-Augmented Generation based Time Series Foundation Models are Stronger Zero-Shot Forecaster

作者: Kanghui Ning, Zijie Pan, Yu Liu, Yushan Jiang, James Yiming Zhang, Kashif Rasul, Anderson Schneider, Lintao Ma, Yuriy Nevmyvaka, Dongjin Song

分类: cs.LG, cs.AI

发布日期: 2025-03-06 (更新: 2025-11-25)

🔗 代码/项目: GITHUB

💡 一句话要点

提出TS-RAG,一种基于检索增强生成的时间序列基础模型,显著提升零样本预测能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间序列预测 检索增强生成 零样本学习 时间序列基础模型 知识库 自适应检索混合器

📋 核心要点

- 现有时间序列基础模型在处理非平稳动态和分布偏移时面临挑战,缺乏有效的适应机制。

- TS-RAG通过检索知识库中语义相关的片段来增强TSFM的上下文表示,提升泛化能力。

- 实验表明,TS-RAG在零样本预测任务中优于现有TSFM,并在多个数据集上取得了显著的性能提升。

📝 摘要(中文)

本文提出了一种名为TS-RAG的检索增强生成框架,旨在提升时间序列基础模型(TSFM)的泛化性和可解释性,用于时间序列预测任务。TS-RAG利用预训练的时间序列编码器从专门的知识库中检索语义相关的片段,从而丰富输入查询的上下文表示。此外,本文还提出了一种自适应检索混合器(ARM)模块,该模块动态地将检索到的模式与TSFM的内部表示融合,从而提高预测精度,而无需特定于任务的微调。在七个公共基准数据集上的大量实证研究表明,TS-RAG实现了最先进的零样本预测性能,在不同领域优于现有的TSFM高达6.84%,同时提供了理想的可解释性。代码和数据可在https://github.com/UConn-DSIS/TS-RAG 获取。

🔬 方法详解

问题定义:现有时间序列基础模型(TSFM)在面对非平稳的时间序列数据和分布偏移时,泛化能力不足。微调虽然可以进行领域适配,但难以应对多样且未见过的数据集。因此,需要一种方法能够使TSFM在无需微调的情况下,适应新的时间序列模式。

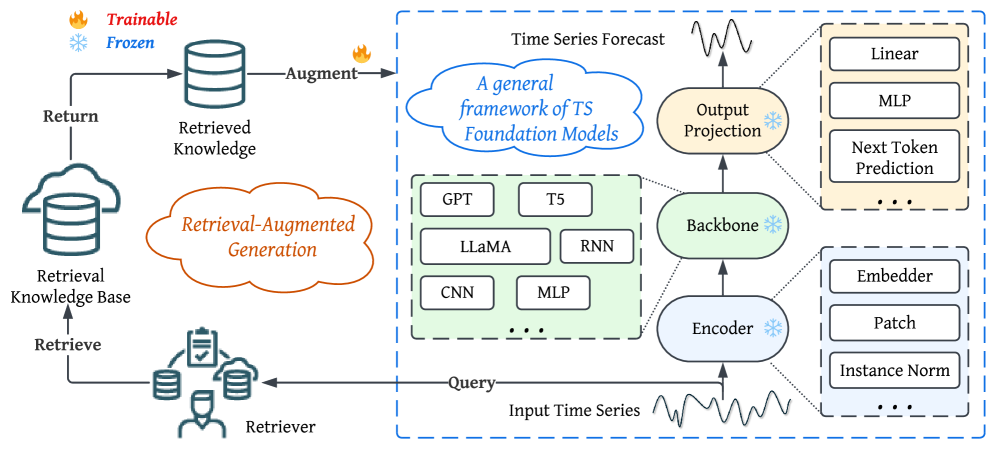

核心思路:TS-RAG的核心思路是利用检索增强生成(RAG)框架,通过从知识库中检索与输入时间序列相似的片段,来增强TSFM的上下文信息。这样,模型可以利用历史经验来更好地预测未来的时间序列,而无需针对特定任务进行微调。

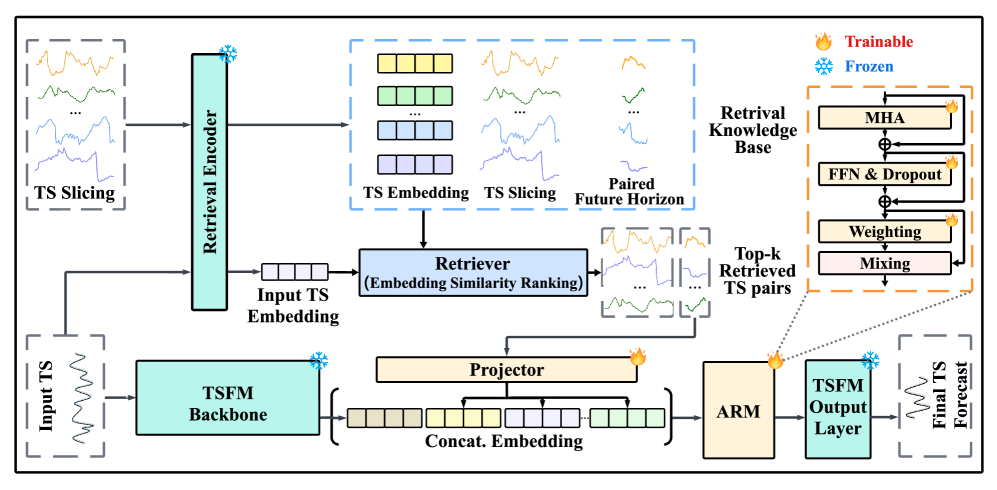

技术框架:TS-RAG的整体框架包括以下几个主要模块:1) 预训练的时间序列编码器:用于将输入时间序列和知识库中的时间序列片段编码成向量表示。2) 知识库:存储大量时间序列片段及其对应的编码向量。3) 检索模块:根据输入时间序列的编码向量,从知识库中检索最相似的片段。4) 自适应检索混合器(ARM):将检索到的片段与TSFM的内部表示进行融合,生成最终的预测结果。

关键创新:TS-RAG的关键创新在于自适应检索混合器(ARM)模块。ARM能够动态地调整检索到的片段对最终预测的影响,从而更好地适应不同的时间序列模式。此外,TS-RAG将RAG框架引入时间序列预测领域,为解决TSFM的泛化问题提供了一种新的思路。与传统方法相比,TS-RAG无需针对特定任务进行微调,即可实现良好的零样本预测性能。

关键设计:ARM模块的设计是关键。具体来说,ARM使用注意力机制来计算检索到的片段与TSFM内部表示之间的相关性,并根据相关性动态地调整片段的权重。损失函数采用标准的预测误差,例如均方误差(MSE)。知识库的构建也至关重要,需要选择具有代表性的时间序列片段,并采用合适的编码器进行向量化。

🖼️ 关键图片

📊 实验亮点

TS-RAG在七个公共基准数据集上进行了评估,实验结果表明,TS-RAG在零样本预测任务中取得了最先进的性能,优于现有的TSFM高达6.84%。此外,TS-RAG还提供了良好的可解释性,可以帮助用户理解模型的预测结果。

🎯 应用场景

TS-RAG可应用于各种时间序列预测场景,例如金融市场的股票价格预测、能源消耗预测、供应链管理中的需求预测以及物联网设备的状态预测等。该方法无需针对特定领域进行微调,降低了部署成本,并提高了预测的准确性和可靠性,具有广泛的应用前景。

📄 摘要(原文)

Large Language Models (LLMs) and Foundation Models (FMs) have recently become prevalent for time series forecasting tasks. While fine-tuning LLMs enables domain adaptation, they often struggle to generalize across diverse and unseen datasets. Moreover, existing Time Series Foundation Models (TSFMs) still face challenges in handling non-stationary dynamics and distribution shifts, largely due to the lack of effective mechanisms for adaptation. To this end, we present TS-RAG, a retrieval-augmented generation framework for time series forecasting that enhances the generalization and interpretability of TSFMs. Specifically, TS-RAG leverages pre-trained time series encoders to retrieve semantically relevant segments from a dedicated knowledge base, enriching the contextual representation of the input query. Furthermore, we propose an Adaptive Retrieval Mixer (ARM) module that dynamically fuses the retrieved patterns with the TSFM's internal representation, improving forecasting accuracy without requiring task-specific fine-tuning. Thorough empirical studies on seven public benchmark datasets demonstrate that TS-RAG achieves state-of-the-art zero-shot forecasting performance, outperforming the existing TSFMs by up to 6.84% across diverse domains while also providing desirable interpretability. Our code and data are available at: https://github.com/UConn-DSIS/TS-RAG