PokéChamp: an Expert-level Minimax Language Agent

作者: Seth Karten, Andy Luu Nguyen, Chi Jin

分类: cs.LG, cs.MA

发布日期: 2025-03-06

备注: 24 pages, 13 figures

💡 一句话要点

PokéChamp:基于LLM的专家级Minimax宝可梦对战智能体

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 宝可梦对战 大型语言模型 Minimax搜索 多智能体系统 博弈论 对手建模 价值函数估计

📋 核心要点

- 现有宝可梦对战AI在处理复杂策略和不完全信息方面存在局限,难以达到人类专家的水平。

- PokéChamp利用LLM的强大能力,通过Minimax搜索框架,在行动采样、对手建模和价值评估三个关键模块中替代传统方法。

- 实验表明,PokéChamp在胜率和Elo等级上显著优于现有LLM和规则型AI,证明了其在宝可梦对战中的卓越性能。

📝 摘要(中文)

本文介绍PokéChamp,一个基于大型语言模型(LLM)的Minimax宝可梦对战智能体。PokéChamp建立在通用的双人对抗游戏框架之上,利用LLM的通用能力来增强Minimax树搜索。具体来说,LLM取代了三个关键模块:(1)玩家行动采样,(2)对手建模,以及(3)价值函数估计,使智能体能够有效地利用游戏历史和人类知识来减少搜索空间并解决部分可观测性问题。值得注意的是,我们的框架不需要额外的LLM训练。我们在流行的Gen 9 OU格式中评估了PokéChamp。当使用GPT-4o时,它对现有最佳的基于LLM的机器人实现了76%的胜率,对最强的基于规则的机器人实现了84%的胜率,证明了其卓越的性能。即使使用开源的80亿参数Llama 3.1模型,PokéChamp也始终优于之前最好的基于LLM的机器人Pokéllmon(由GPT-4o驱动),胜率为64%。PokéChamp在Pokémon Showdown在线天梯上的预计Elo为1300-1500,使其跻身人类玩家的前30%-10%。此外,这项工作还编译了最大的真实玩家宝可梦对战数据集,包含超过300万场比赛,其中包括超过50万场高Elo比赛。基于此数据集,我们建立了一系列对战基准和谜题,以评估特定的对战技能。我们进一步提供了对本地游戏引擎的关键更新。我们希望这项工作能够促进进一步的研究,利用宝可梦对战作为基准,将LLM技术与博弈论算法相结合,以解决一般的多智能体问题。

🔬 方法详解

问题定义:论文旨在构建一个专家级的宝可梦对战AI,解决现有AI在策略深度、对手建模和价值评估方面的不足。现有方法通常依赖于规则或有限的搜索空间,难以应对复杂多变的对战环境。

核心思路:核心思路是利用大型语言模型(LLM)的强大泛化能力和知识储备,替代传统Minimax搜索中的关键模块,从而提升AI的决策质量和效率。通过LLM,AI可以更好地理解游戏状态、预测对手行为并评估局势。

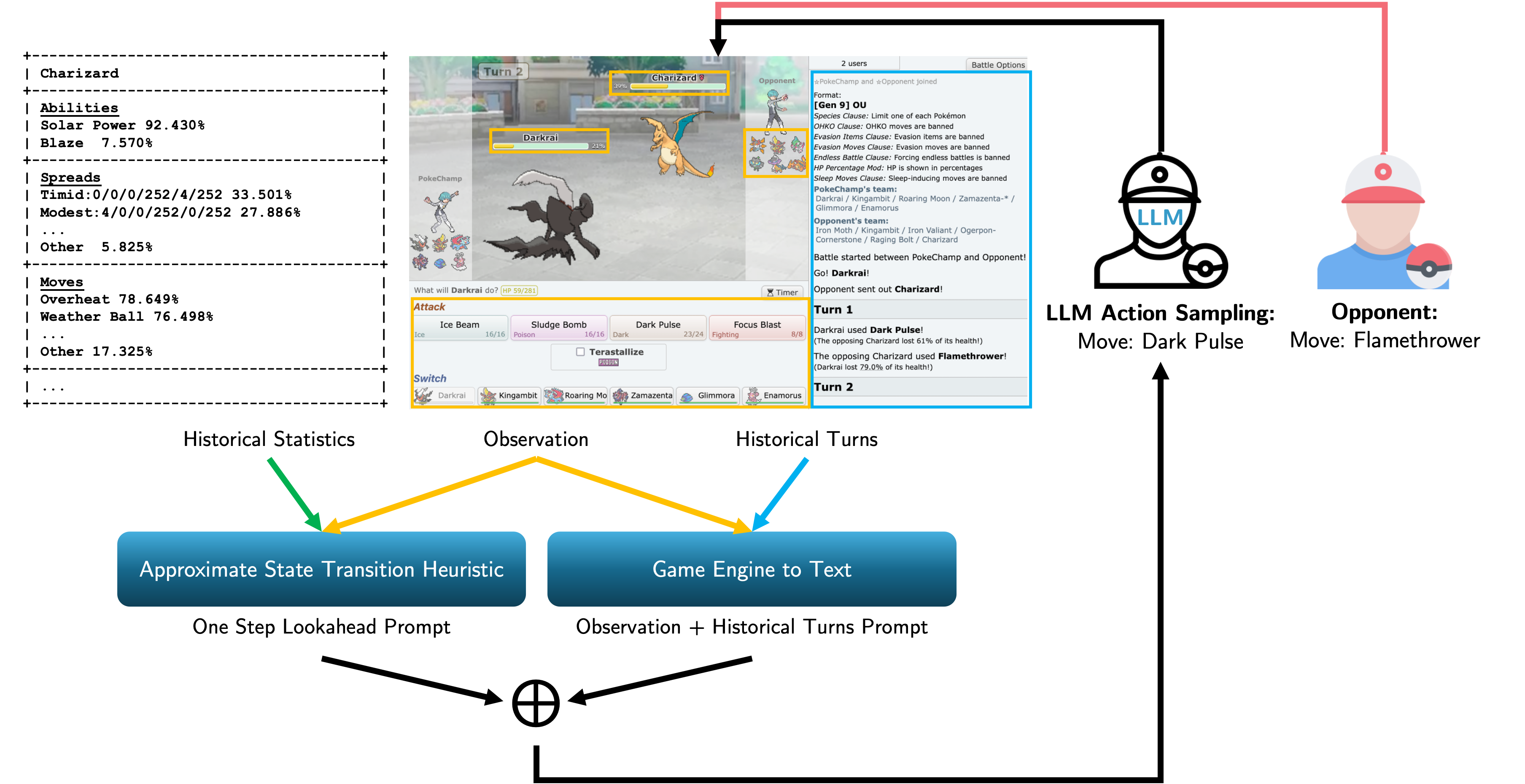

技术框架:PokéChamp的整体架构基于Minimax搜索框架,主要包含以下模块:1) 游戏状态表示:将宝可梦对战状态编码为LLM可理解的文本;2) 行动采样:使用LLM生成可能的行动序列,减少搜索空间;3) 对手建模:利用LLM预测对手的行动概率分布;4) 价值函数估计:使用LLM评估当前游戏状态的价值,指导搜索方向。整个流程无需额外的LLM训练。

关键创新:最重要的创新在于将LLM无缝集成到Minimax搜索框架中,替代了传统的行动采样、对手建模和价值评估模块。与现有方法相比,PokéChamp能够更好地利用游戏历史和人类知识,从而做出更明智的决策。此外,该框架无需额外的LLM训练,降低了开发成本。

关键设计:在行动采样方面,使用LLM生成top-k个最有可能的行动,而不是枚举所有可能的行动。在对手建模方面,使用LLM预测对手采取每个行动的概率。在价值函数估计方面,使用LLM直接评估当前游戏状态的胜率。具体参数设置和网络结构细节未在论文中详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

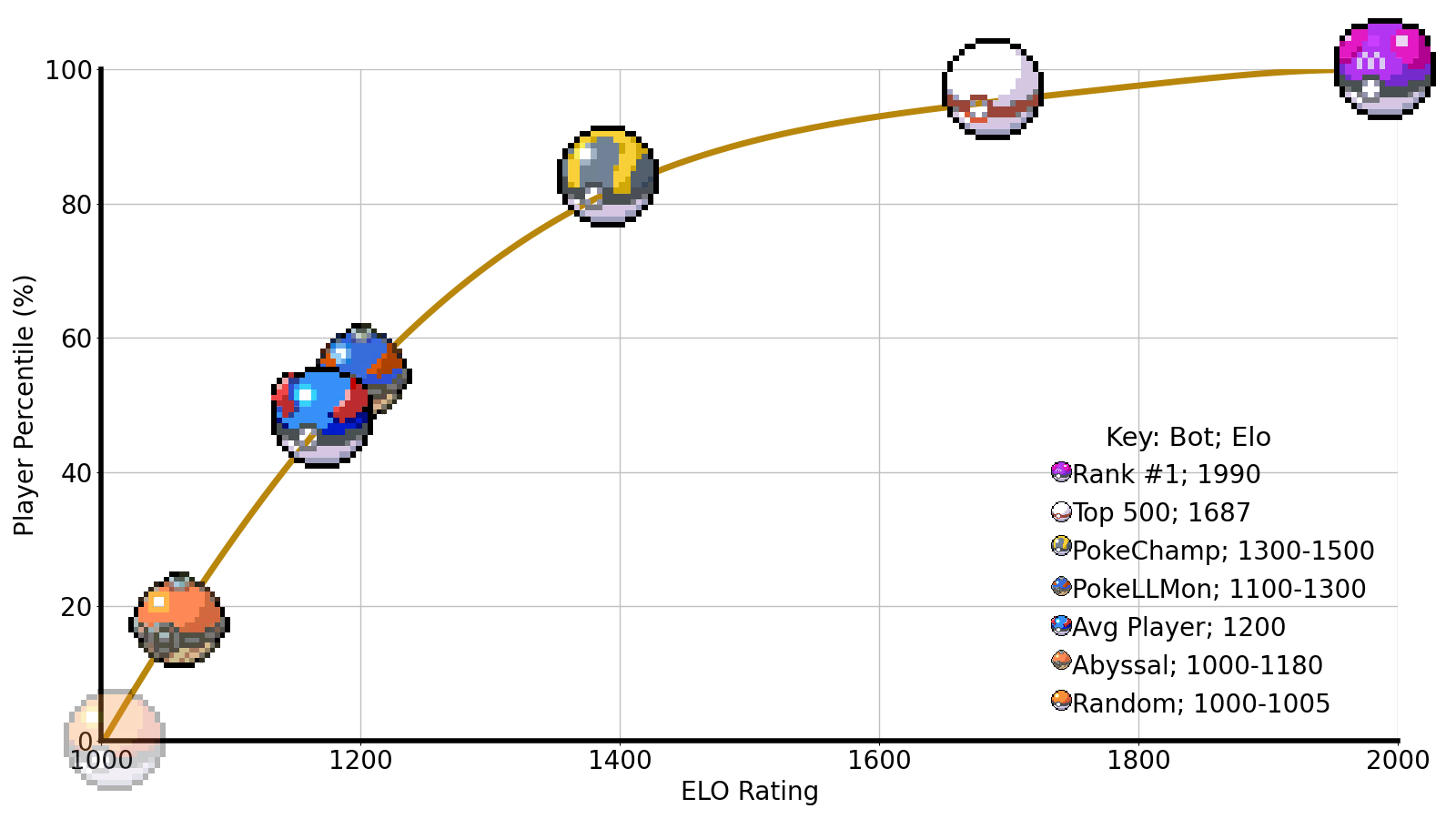

PokéChamp在Gen 9 OU格式中,使用GPT-4o时,对现有最佳LLM机器人胜率达到76%,对最强规则型机器人胜率达到84%。即使使用开源的80亿参数Llama 3.1模型,PokéChamp也以64%的胜率优于GPT-4o驱动的Pokéllmon。PokéChamp在Pokémon Showdown在线天梯上的预计Elo为1300-1500,跻身人类玩家的前30%-10%。

🎯 应用场景

PokéChamp的研究成果可应用于其他双人对抗游戏AI的开发,例如象棋、围棋等。该方法也为将LLM与博弈论算法相结合,解决更广泛的多智能体问题提供了新的思路。此外,所构建的大规模宝可梦对战数据集可用于训练和评估其他AI模型,促进相关领域的研究进展。

📄 摘要(原文)

We introduce PokéChamp, a minimax agent powered by Large Language Models (LLMs) for Pokémon battles. Built on a general framework for two-player competitive games, PokéChamp leverages the generalist capabilities of LLMs to enhance minimax tree search. Specifically, LLMs replace three key modules: (1) player action sampling, (2) opponent modeling, and (3) value function estimation, enabling the agent to effectively utilize gameplay history and human knowledge to reduce the search space and address partial observability. Notably, our framework requires no additional LLM training. We evaluate PokéChamp in the popular Gen 9 OU format. When powered by GPT-4o, it achieves a win rate of 76% against the best existing LLM-based bot and 84% against the strongest rule-based bot, demonstrating its superior performance. Even with an open-source 8-billion-parameter Llama 3.1 model, PokéChamp consistently outperforms the previous best LLM-based bot, Pokéllmon powered by GPT-4o, with a 64% win rate. PokéChamp attains a projected Elo of 1300-1500 on the Pokémon Showdown online ladder, placing it among the top 30%-10% of human players. In addition, this work compiles the largest real-player Pokémon battle dataset, featuring over 3 million games, including more than 500k high-Elo matches. Based on this dataset, we establish a series of battle benchmarks and puzzles to evaluate specific battling skills. We further provide key updates to the local game engine. We hope this work fosters further research that leverage Pokémon battle as benchmark to integrate LLM technologies with game-theoretic algorithms addressing general multiagent problems. Videos, code, and dataset available at https://sites.google.com/view/pokechamp-llm.