Exploring the Potential of Large Language Models as Predictors in Dynamic Text-Attributed Graphs

作者: Runlin Lei, Jiarui Ji, Haipeng Ding, Lu Yi, Zhewei Wei, Yongchao Liu, Chuntao Hong

分类: cs.LG, cs.AI

发布日期: 2025-03-05

💡 一句话要点

提出GraphAgent-Dynamic框架,利用协作LLM解决动态文本属性图预测难题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 动态图预测 大型语言模型 多智能体系统 图神经网络 知识反思

📋 核心要点

- 现有研究主要集中在静态图上,忽略了LLM在动态图预测中的潜力,缺乏对时序信息的有效利用。

- 提出GraphAgent-Dynamic框架,利用多智能体协作的LLM,通过全局和局部摘要智能体生成领域知识,提升泛化能力。

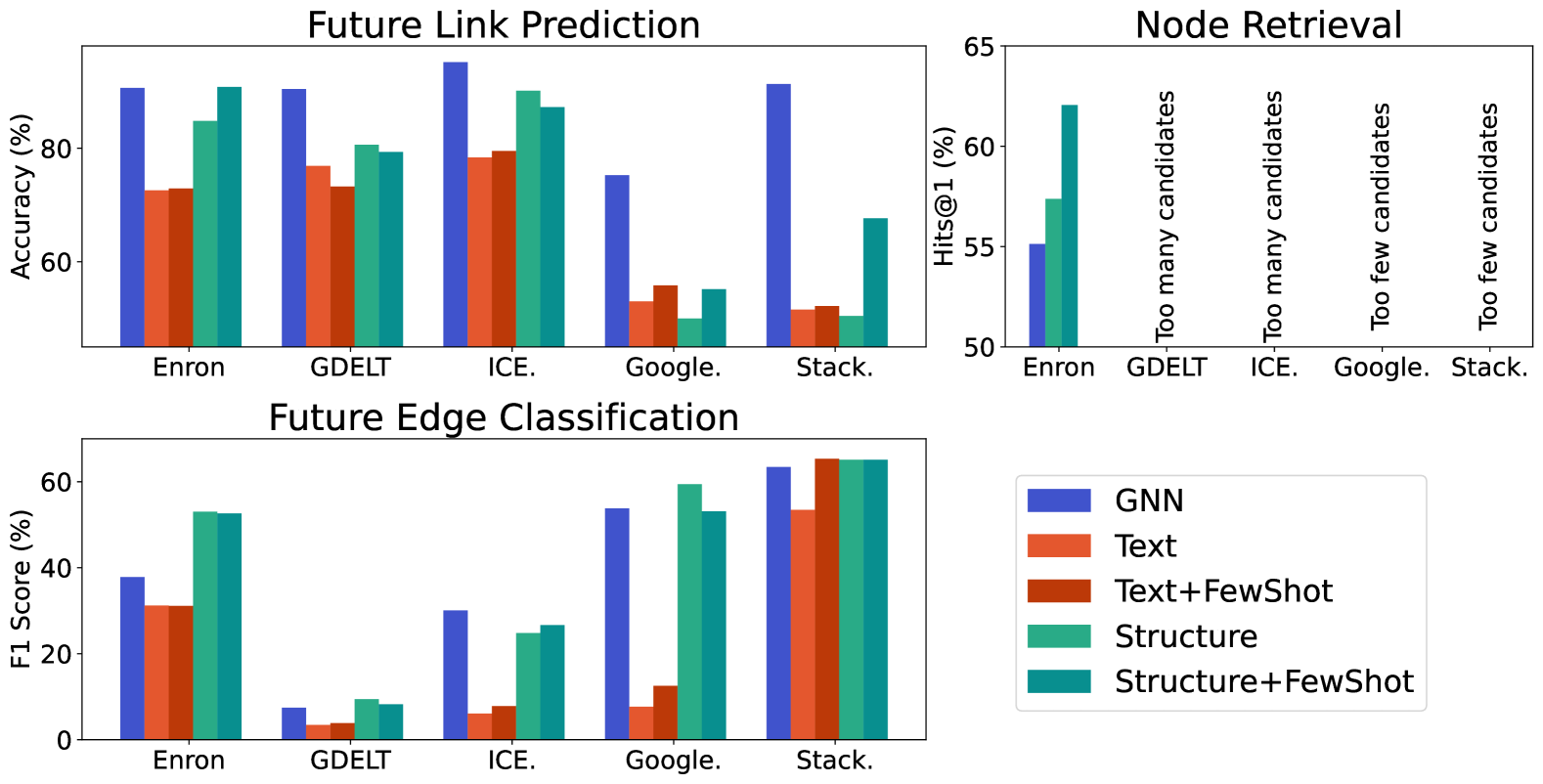

- 实验表明,GAD框架在动态图预测任务上,性能可与全监督图神经网络媲美甚至超越,无需特定数据集训练。

📝 摘要(中文)

随着大型语言模型(LLM)的兴起,基于图的任务对图基础模型(GFM)的兴趣日益浓厚。通过利用LLM作为预测器,GFM在各种任务和数据集上展示了令人印象深刻的泛化能力。然而,现有的关于LLM作为预测器的研究主要集中在静态图上,而它们在动态图预测中的潜力尚未被探索。在这项工作中,我们率先使用LLM进行动态图上的预测任务。我们确定了两个关键挑战:处理大规模历史数据时上下文长度的限制,以及领域特征的显著差异,这两者都使统一预测器的开发变得复杂。为了应对这些挑战,我们提出了GraphAgent-Dynamic(GAD)框架,这是一个利用协作LLM的多智能体系统。与使用单个LLM作为预测器不同,GAD结合了全局和局部摘要智能体来生成特定领域的知识,从而增强了其跨领域的迁移能力。此外,知识反思智能体能够自适应地更新GAD的知识,从而保持统一且自洽的架构。在实验中,GAD展示了与完全监督的图神经网络相当甚至超过其性能,而无需特定于数据集的训练。最后,为了提高基于LLM的预测器的任务特定性能,我们讨论了潜在的改进,例如针对LLM的数据集特定微调。通过为不同的任务开发量身定制的策略,我们为未来基于LLM的预测器的设计提供了新的见解。

🔬 方法详解

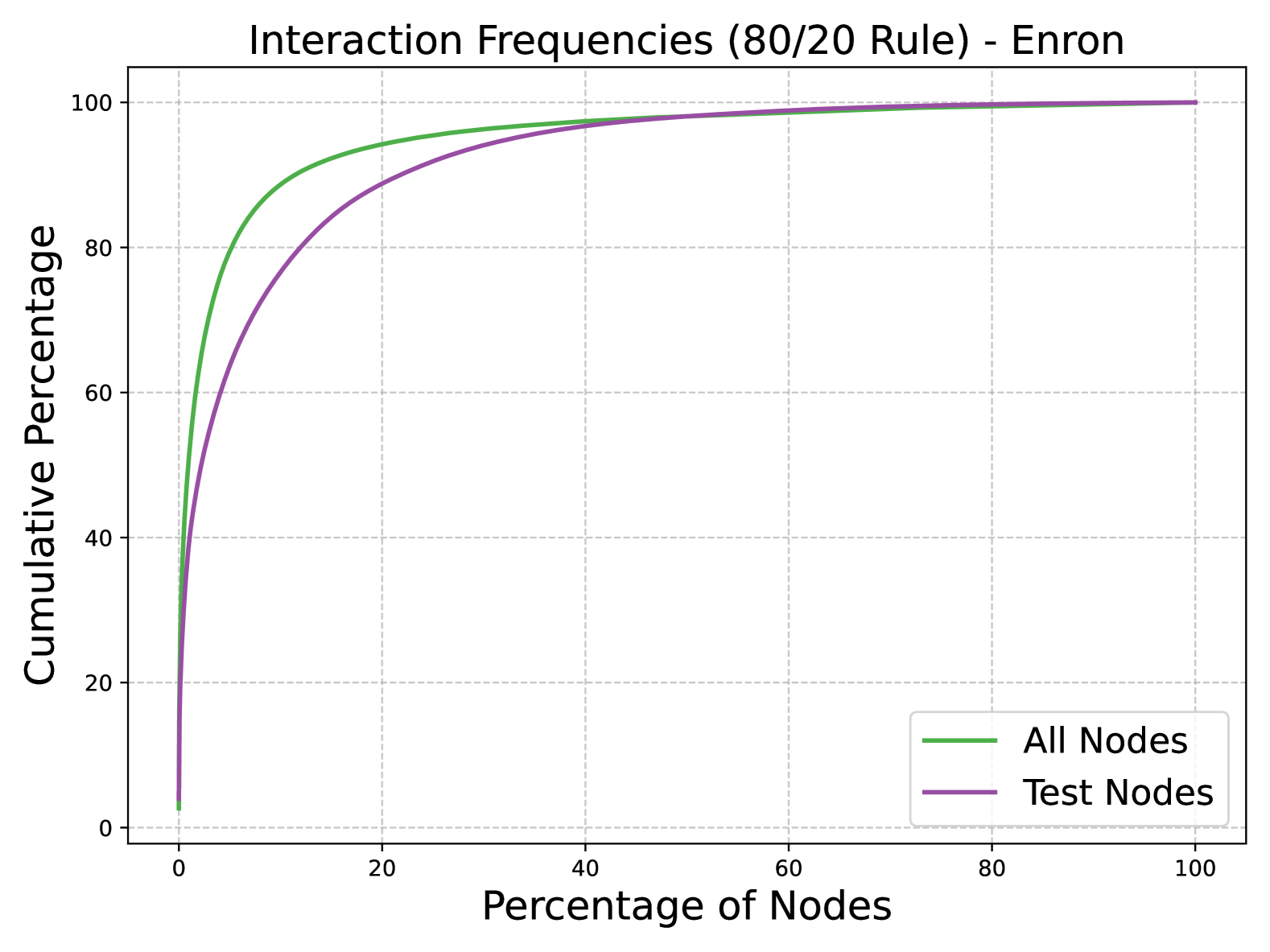

问题定义:论文旨在解决动态文本属性图上的预测问题。现有方法,特别是基于静态图的LLM预测器,无法有效处理动态图的时序信息和大规模历史数据带来的上下文长度限制。此外,不同领域图数据的特征差异大,难以构建一个通用的LLM预测器。

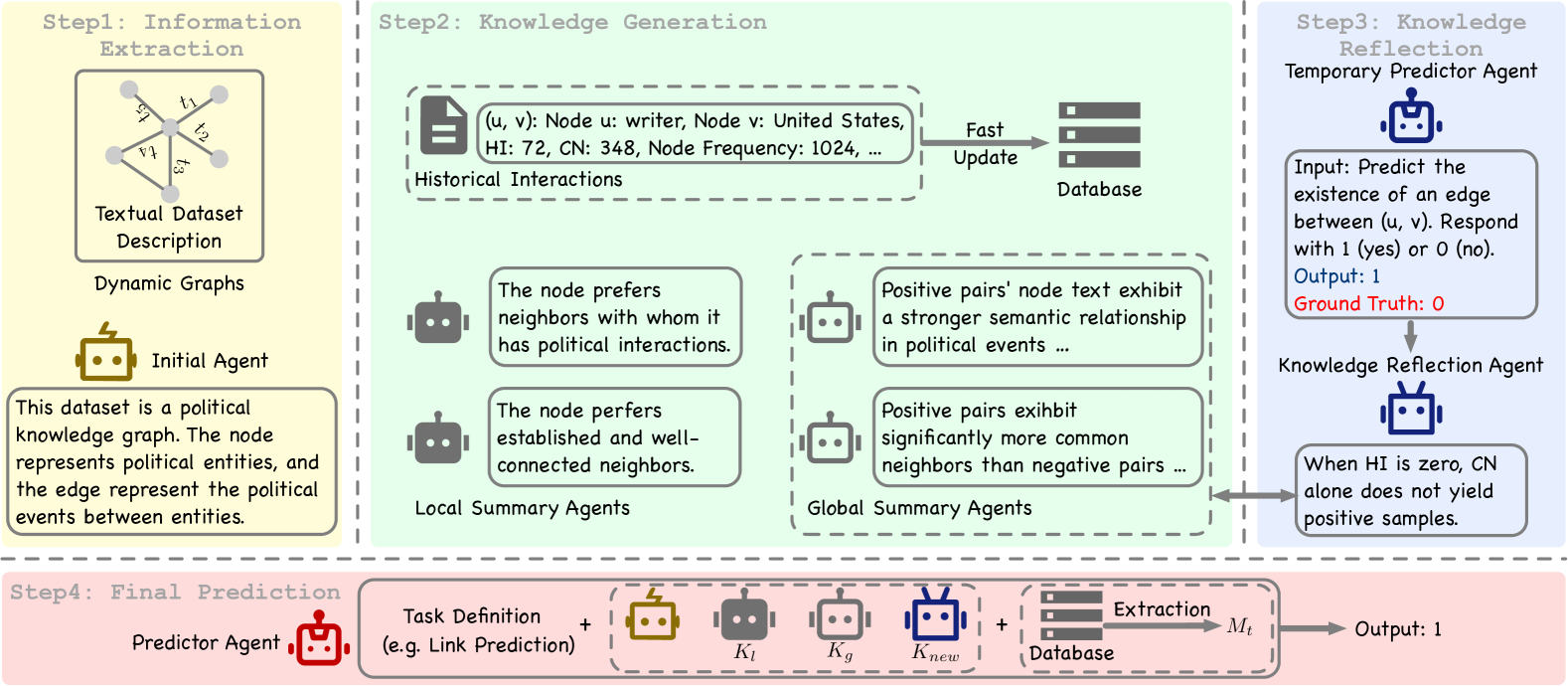

核心思路:论文的核心思路是利用多智能体系统,通过协作的LLM来处理动态图数据。每个智能体负责不同的任务,例如全局摘要、局部摘要和知识反思,从而实现领域知识的生成、迁移和自适应更新。这种多智能体协作的方式可以有效缓解上下文长度限制,并提高模型在不同领域图数据上的泛化能力。

技术框架:GraphAgent-Dynamic (GAD) 框架包含以下主要模块:1) 全局摘要智能体:负责对整个图的历史信息进行摘要,提取全局特征。2) 局部摘要智能体:负责对局部邻域信息进行摘要,提取局部特征。3) 知识反思智能体:负责根据全局和局部摘要信息,更新和维护GAD的知识库,实现知识的自适应更新。整个流程是,首先全局和局部摘要智能体分别提取特征,然后知识反思智能体更新知识库,最后利用更新后的知识进行预测。

关键创新:GAD框架的关键创新在于其多智能体协作的架构。与传统的单LLM预测器相比,GAD能够更好地处理大规模历史数据和领域特征差异,从而提高预测性能。此外,知识反思智能体的引入使得GAD能够自适应地更新知识,保持模型的统一性和自洽性。

关键设计:论文中没有明确给出关键参数设置、损失函数和网络结构的具体细节。但是,可以推断,全局和局部摘要智能体可能采用不同的LLM模型或微调策略,以适应不同尺度的信息提取。知识反思智能体可能采用某种形式的记忆网络或知识图谱来存储和更新知识。损失函数的设计可能需要考虑预测的准确性和知识库的一致性。

🖼️ 关键图片

📊 实验亮点

GAD框架在动态图预测任务上取得了显著的成果,性能可与全监督图神经网络媲美甚至超越,而无需特定数据集的训练。这表明GAD框架具有良好的泛化能力和迁移学习能力。此外,GAD框架的多智能体架构为未来LLM在图数据上的应用提供了新的思路。

🎯 应用场景

该研究成果可应用于社交网络分析、金融风险预测、交通流量预测等领域。通过利用LLM的强大能力,可以更准确地预测动态图中的节点和边的变化,从而为决策提供支持。未来,该方法有望扩展到其他类型的动态数据,例如时间序列数据和事件序列数据。

📄 摘要(原文)

With the rise of large language models (LLMs), there has been growing interest in Graph Foundation Models (GFMs) for graph-based tasks. By leveraging LLMs as predictors, GFMs have demonstrated impressive generalizability across various tasks and datasets. However, existing research on LLMs as predictors has predominantly focused on static graphs, leaving their potential in dynamic graph prediction unexplored. In this work, we pioneer using LLMs for predictive tasks on dynamic graphs. We identify two key challenges: the constraints imposed by context length when processing large-scale historical data and the significant variability in domain characteristics, both of which complicate the development of a unified predictor. To address these challenges, we propose the GraphAgent-Dynamic (GAD) Framework, a multi-agent system that leverages collaborative LLMs. In contrast to using a single LLM as the predictor, GAD incorporates global and local summary agents to generate domain-specific knowledge, enhancing its transferability across domains. Additionally, knowledge reflection agents enable adaptive updates to GAD's knowledge, maintaining a unified and self-consistent architecture. In experiments, GAD demonstrates performance comparable to or even exceeds that of full-supervised graph neural networks without dataset-specific training. Finally, to enhance the task-specific performance of LLM-based predictors, we discuss potential improvements, such as dataset-specific fine-tuning to LLMs. By developing tailored strategies for different tasks, we provide new insights for the future design of LLM-based predictors.