Improving the Efficiency of a Deep Reinforcement Learning-Based Power Management System for HPC Clusters Using Curriculum Learning

作者: Thomas Budiarjo, Santana Yuda Pradata, Kadek Gemilang Santiyuda, Muhammad Alfian Amrizal, Reza Pulungan, Hiroyuki Takizawa

分类: cs.DC, cs.LG

发布日期: 2025-02-27 (更新: 2025-03-14)

备注: 13 pages, 17 figures, accepted at Supercomputing Asia '25, published by ACM

期刊: SCA '25: Proceedings of the 2025 Supercomputing Asia Conference (SCA 2025), Singapore, Mar 10-13, 2025. Association for Computing Machinery, New York, NY, USA, pp. 1-13 (2025)

💡 一句话要点

利用课程学习提升基于深度强化学习的高性能计算集群电源管理系统效率

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 高性能计算 电源管理 深度强化学习 课程学习 能源效率 资源优化 作业调度

📋 核心要点

- HPC系统能耗高昂,传统电源管理策略难以兼顾节能与服务质量,存在优化空间。

- 提出基于课程学习的深度强化学习方法,通过由易到难的任务训练,提升智能体的学习效率和性能。

- 实验表明,该方法在节能、降低作业等待时间和提高资源利用率方面均优于基线方法。

📝 摘要(中文)

高性能计算(HPC)系统能耗巨大,即使在空闲状态下也消耗大量电力。关闭未使用的节点可以提高能源效率,但时机不当会降低服务质量。机器学习,特别是强化学习(RL),在确定节点开关机的最佳时机方面显示出潜力。本研究通过集成课程学习(CL)来增强HPC电源管理的深度强化学习(DRL)代理的性能,课程学习是一种引入难度逐渐增加的任务的训练方法。使用Batsim-py仿真框架,我们将提出的基于CL的代理与基线DRL方法(不使用CL)和传统的固定时间超时策略进行比较。实验结果表明,由易到难的课程在减少能源浪费方面优于其他训练顺序。最佳代理比基线DRL方法节能3.73%,比最佳超时配置(空闲15分钟后关闭)节能4.66%。此外,它还将平均作业等待时间减少了9.24%,并保持了更高的作业填充率,表明资源利用率更高。对各种开关机持续时间、功率水平和集群大小的敏感性测试进一步表明,该代理无需重新训练即可适应不断变化的系统参数。这些发现表明,课程学习可以显著改善HPC中基于DRL的电源管理,从而平衡节能、服务质量和对各种配置的鲁棒性。

🔬 方法详解

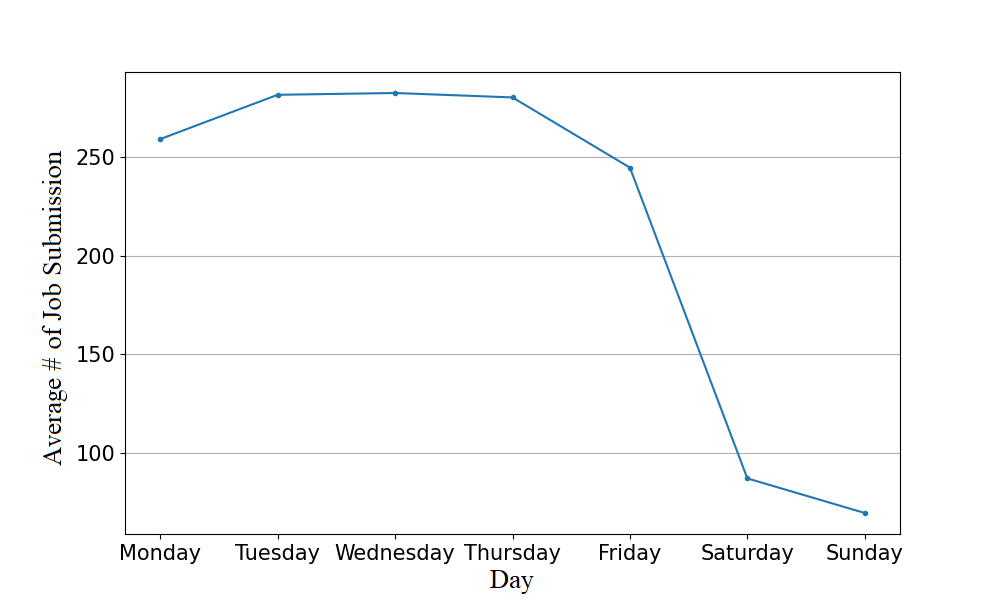

问题定义:论文旨在解决高性能计算(HPC)集群中能源消耗过高的问题。现有方法,如固定时间超时策略,无法根据实际负载动态调整节点开关状态,导致能源浪费或服务质量下降。传统的强化学习方法训练效率较低,难以适应HPC集群的复杂环境。

核心思路:论文的核心思路是利用课程学习(Curriculum Learning, CL)来提升深度强化学习(Deep Reinforcement Learning, DRL)代理的训练效率和性能。通过设计一系列难度递增的任务,引导智能体逐步学习复杂的电源管理策略。这种方法模仿了人类学习的过程,有助于智能体更快地收敛到最优策略。

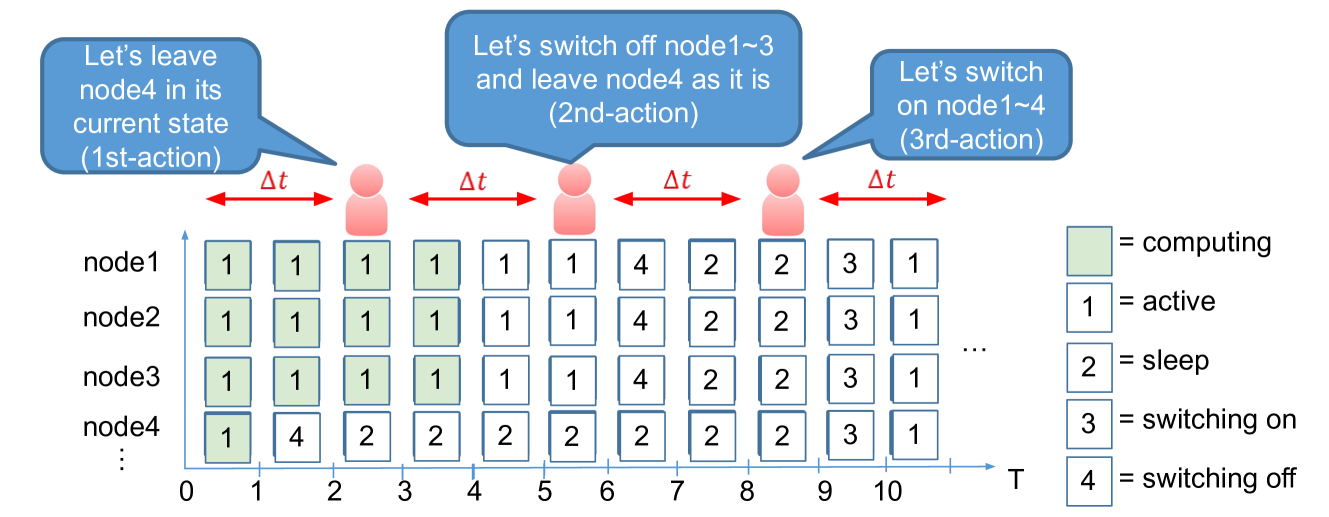

技术框架:整体框架包括三个主要部分:HPC集群仿真环境(Batsim-py)、DRL代理和课程学习模块。Batsim-py用于模拟HPC集群的作业调度和资源管理,DRL代理负责根据集群状态做出节点开关决策,课程学习模块则负责生成难度递增的训练任务序列。训练过程如下:首先,智能体在简单的任务上进行训练,然后逐步过渡到更复杂的任务,直到能够有效地管理整个HPC集群的电源。

关键创新:最重要的技术创新点是将课程学习引入到HPC电源管理的DRL训练中。与传统的DRL方法相比,课程学习能够显著提高训练效率和最终性能。此外,论文还设计了一种由易到难的课程,该课程能够有效地引导智能体学习复杂的电源管理策略。

关键设计:论文中,DRL代理采用深度Q网络(DQN)结构,状态空间包括集群的负载信息、作业队列长度等,动作空间包括节点开关决策。奖励函数的设计目标是平衡节能和服务质量,包括能源消耗、作业等待时间和资源利用率等指标。课程学习的设计关键在于任务难度的控制,论文通过调整集群规模、作业到达率等参数来控制任务难度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于课程学习的DRL代理在节能方面优于基线DRL方法和固定时间超时策略。具体而言,与基线DRL方法相比,节能效果提升了3.73%,与最佳超时配置相比,节能效果提升了4.66%。此外,平均作业等待时间减少了9.24%,作业填充率也得到了提高。敏感性测试表明,该代理具有良好的鲁棒性,能够适应不同的系统参数。

🎯 应用场景

该研究成果可应用于各种高性能计算中心和云计算平台,通过智能化的电源管理,降低能源消耗,减少运营成本,并提高资源利用率。此外,该方法也可推广到其他资源管理领域,例如数据中心的服务器管理、边缘计算设备的能耗优化等。

📄 摘要(原文)

High energy consumption remains a key challenge in high-performance computing (HPC) systems, which often feature hundreds or thousands of nodes drawing substantial power even in idle or standby modes. Although powering down unused nodes can improve energy efficiency, choosing the wrong time to do so can degrade quality of service by delaying job execution. Machine learning, in particular reinforcement learning (RL), has shown promise in determining optimal times to switch nodes on or off. In this study, we enhance the performance of a deep reinforcement learning (DRL) agent for HPC power management by integrating curriculum learning (CL), a training approach that introduces tasks with gradually increasing difficulty. Using the Batsim-py simulation framework, we compare the proposed CL-based agent to both a baseline DRL method (without CL) and the conventional fixed-time timeout strategy. Experimental results confirm that an easy-to-hard curriculum outperforms other training orders in terms of reducing wasted energy usage. The best agent achieves a 3.73% energy reduction over the baseline DRL method and a 4.66% improvement compared to the best timeout configuration (shutdown every 15 minutes of idle time). In addition, it reduces average job waiting time by 9.24% and maintains a higher job-filling rate, indicating more effective resource utilization. Sensitivity tests across various switch-on durations, power levels, and cluster sizes further reveal the agent's adaptability to changing system parameters without retraining. These findings demonstrate that curriculum learning can significantly improve DRL-based power management in HPC, balancing energy savings, quality of service, and robustness to diverse configurations.