Enhancing Gradient-based Discrete Sampling via Parallel Tempering

作者: Luxu Liang, Yuhang Jia, Feng Zhou

分类: stat.ML, cs.LG, stat.AP

发布日期: 2025-02-26 (更新: 2025-05-20)

备注: 25 pages, 5 figures. arXiv admin note: text overlap with arXiv:2402.17699 by other authors

💡 一句话要点

提出基于并行回火的离散 Langevin 采样方法,提升复杂分布采样效率

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 离散采样 并行回火 Langevin采样 副本交换 能量模型

📋 核心要点

- 梯度离散采样器易陷入局部极小值,在高维多峰分布中表现不佳,源于离散分布的不连续性。

- 论文提出并行回火增强的离散 Langevin 提议(PTDLP),通过多温度链和Metropolis准则实现高效采样。

- 实验证明,PTDLP在合成问题、受限玻尔兹曼机和深度能量模型等复杂分布采样中优于现有方法。

📝 摘要(中文)

梯度离散采样器在复杂分布采样中表现出色,但易陷入局部极小值,尤其是在高维、多峰离散分布中,这是由于这些分布固有的不连续性所致。为了解决这个问题,我们将并行回火(又称副本交换)与离散 Langevin 提议相结合,开发了并行回火增强的离散 Langevin 提议(PTDLP),该方法在一系列温度下进行模拟。显著的能量差异会促使样本交换,样本交换由专门为离散采样设计的 Metropolis 准则控制,以确保维持详细平衡。此外,我们引入了一种自动方案来确定最佳温度计划和链的数量,确保在各种任务中的适应性,并最大限度地减少调整。理论上,我们证明了我们的算法非渐近地收敛到目标能量,并且与单链相比表现出更快的混合。实验结果进一步强调了我们的方法在从复杂的、多峰离散分布(包括合成问题、受限玻尔兹曼机和深度能量模型)中采样的优越性。

🔬 方法详解

问题定义:论文旨在解决高维、多峰离散分布的采样问题。现有的基于梯度的离散采样方法容易陷入局部极小值,导致采样效率低下,无法有效探索整个概率空间。这是因为离散空间的不连续性使得梯度信息不足以引导采样器跳出局部最优。

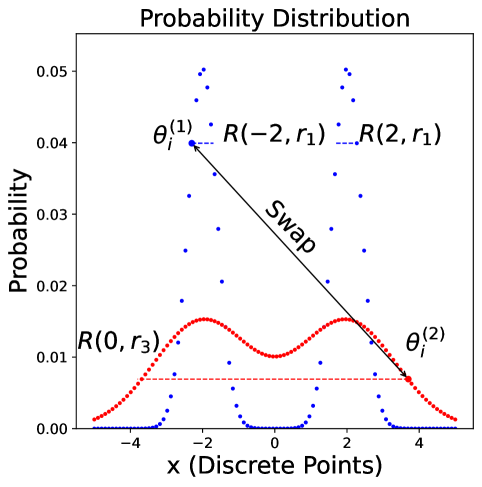

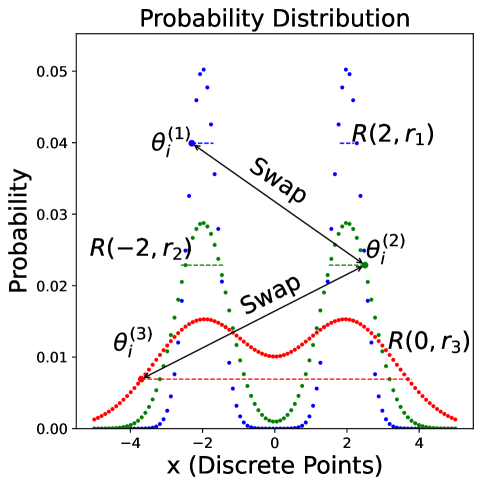

核心思路:论文的核心思路是将并行回火(Parallel Tempering)技术与离散 Langevin 提议相结合。并行回火通过引入多个不同温度的副本,使得高温副本更容易跳出局部极小值,然后通过副本之间的交换,将高温副本探索到的全局信息传递给低温副本,从而提高采样效率。离散 Langevin 提议则用于在每个温度下进行局部探索。

技术框架:PTDLP算法包含以下主要步骤: 1. 初始化:创建多个温度不同的副本(链),每个副本都运行一个离散 Langevin 采样器。 2. 并行采样:每个副本独立地进行离散 Langevin 采样,根据其自身的温度探索概率空间。 3. 副本交换:定期尝试交换相邻温度的副本。交换的接受概率由 Metropolis 准则决定,该准则确保详细平衡,从而保证算法的收敛性。 4. 温度调度:使用自动方案确定最佳温度计划和链的数量,以适应不同的任务。

关键创新:论文的关键创新在于将并行回火技术有效地应用于离散采样问题。具体来说,论文提出了: 1. 针对离散采样的 Metropolis 交换准则,确保详细平衡。 2. 自动温度调度方案,无需手动调整温度参数。 3. 将并行回火与离散 Langevin 提议相结合,充分利用了两种方法的优点。

关键设计: 1. Metropolis 交换准则:接受概率基于副本交换前后能量差的指数函数,并考虑了温度差异。 2. 自动温度调度:通过自适应地调整温度间隔和链的数量,以优化采样效率。 3. 离散 Langevin 提议:使用梯度信息引导采样,并采用离散化的更新规则。

🖼️ 关键图片

📊 实验亮点

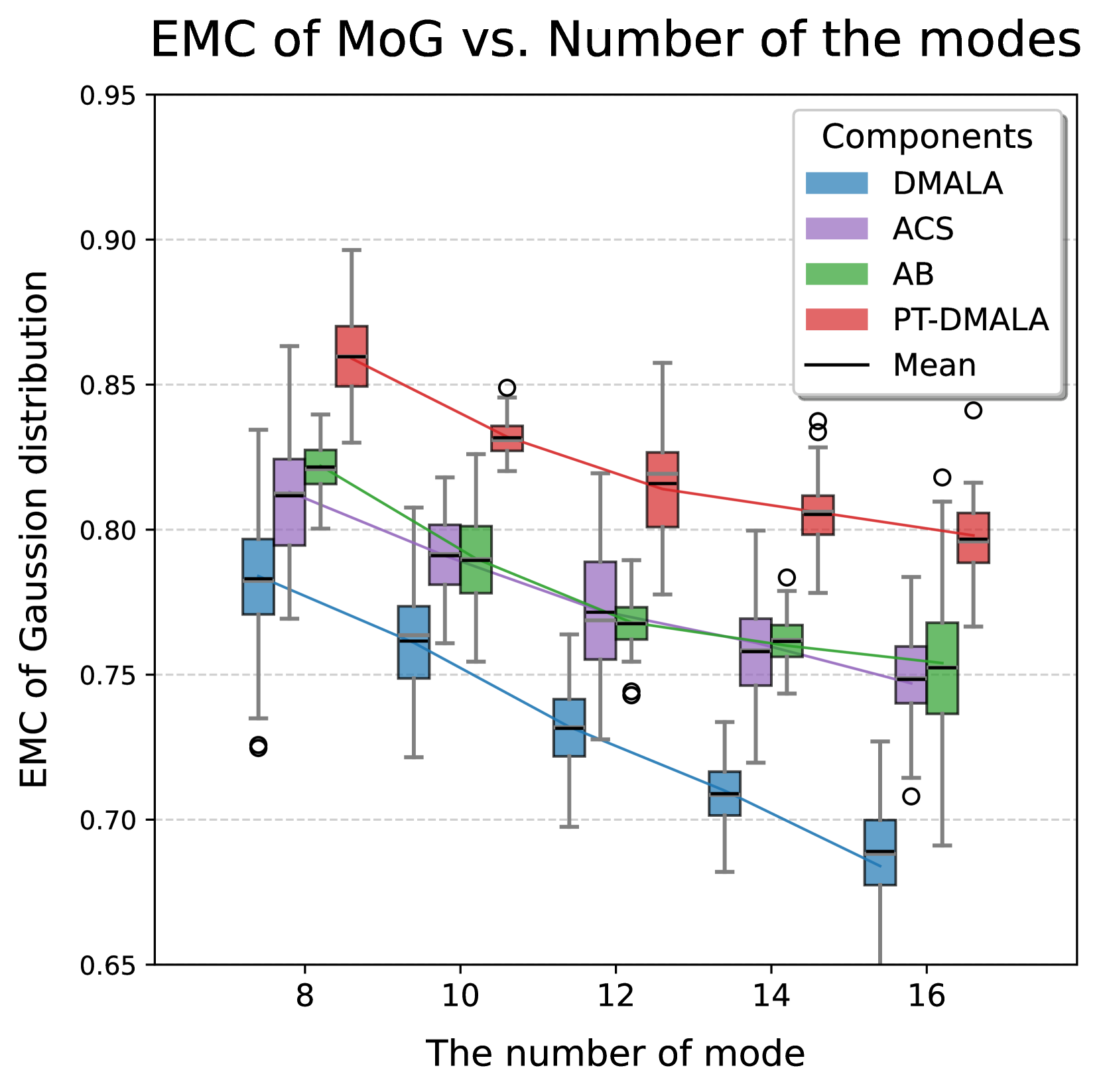

实验结果表明,PTDLP在合成问题、受限玻尔兹曼机和深度能量模型等复杂离散分布的采样任务中,显著优于传统的离散 Langevin 采样方法。论文通过实验验证了PTDLP算法的有效性和鲁棒性,并展示了其在处理高维、多峰离散分布时的优势。具体性能提升数据未知。

🎯 应用场景

该研究成果可应用于多种涉及离散变量的机器学习任务,例如受限玻尔兹曼机(RBM)的训练、深度能量模型的采样、组合优化问题求解等。通过提高离散分布的采样效率,可以提升相关模型的性能和泛化能力,并加速算法的收敛速度。该方法在AI模型,特别是生成式模型领域具有潜在的应用价值。

📄 摘要(原文)

While gradient-based discrete samplers are effective in sampling from complex distributions, they are susceptible to getting trapped in local minima, particularly in high-dimensional, multimodal discrete distributions, owing to the discontinuities inherent in these landscapes. To circumvent this issue, we combine parallel tempering, also known as replica exchange, with the discrete Langevin proposal and develop the Parallel Tempering enhanced Discrete Langevin Proposal (PTDLP), which are simulated at a series of temperatures. Significant energy differences prompt sample swaps, which are governed by a Metropolis criterion specifically designed for discrete sampling to ensure detailed balance is maintained. Additionally, we introduce an automatic scheme to determine the optimal temperature schedule and the number of chains, ensuring adaptability across diverse tasks with minimal tuning. Theoretically, we establish that our algorithm converges non-asymptotically to the target energy and exhibits faster mixing compared to a single chain. Empirical results further emphasize the superiority of our method in sampling from complex, multimodal discrete distributions, including synthetic problems, restricted Boltzmann machines, and deep energy-based models.