ARBoids: Adaptive Residual Reinforcement Learning With Boids Model for Cooperative Multi-USV Target Defense

作者: Jiyue Tao, Tongsheng Shen, Dexin Zhao, Feitian Zhang

分类: cs.LG, cs.CR, cs.RO

发布日期: 2025-02-25 (更新: 2025-11-25)

💡 一句话要点

提出ARBoids,结合Boids模型与自适应残差强化学习,解决多无人艇协同目标防御问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多无人艇协同 目标防御 强化学习 Boids模型 残差学习

📋 核心要点

- 现有方法在攻击者机动性更强时,难以有效拦截,目标防御问题面临挑战。

- ARBoids结合Boids模型与深度强化学习,Boids提供基线策略,DRL学习残差策略进行优化。

- Gazebo仿真结果表明,ARBoids优于传统方法和原始DRL,且对不同机动性的攻击者具有适应性。

📝 摘要(中文)

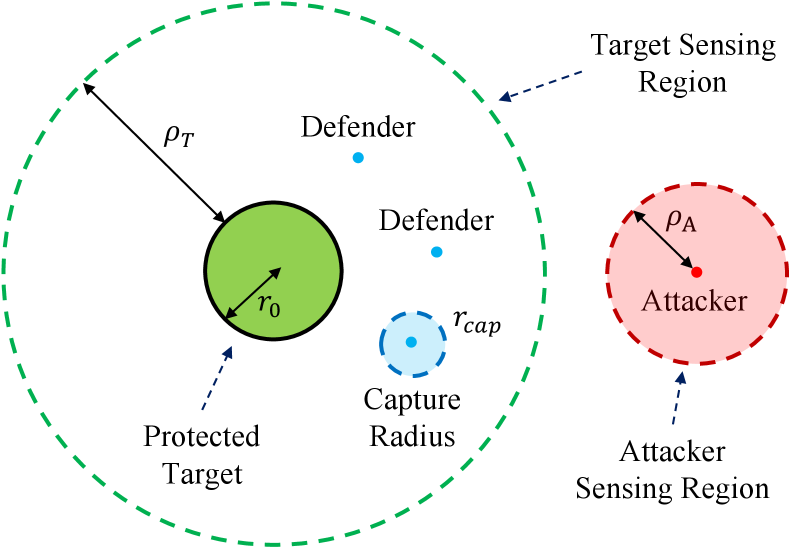

本文提出了一种名为ARBoids的自适应残差强化学习框架,用于解决无人艇(USV)的目标防御问题,即使用一个或多个防御USV拦截攻击USV,阻止其进入目标区域。特别是在攻击者具有更强机动性的情况下,拦截变得极具挑战性。ARBoids框架将深度强化学习(DRL)与受生物启发的、基于力的Boids模型相结合。Boids模型作为多智能体协调的计算高效基线策略,而DRL学习残差策略,自适应地优化防御者的行动。在高保真Gazebo仿真环境中验证了该方法的有效性,结果表明,与传统的拦截策略(包括纯粹的基于力的方法和原始DRL策略)相比,ARBoids表现出更优越的性能。此外,学习到的策略对具有不同机动性配置的攻击者表现出强大的适应性,突出了其鲁棒性和泛化能力。ARBoids的代码将在论文被接收后发布。

🔬 方法详解

问题定义:论文旨在解决多无人艇协同目标防御问题,即在攻击无人艇试图突破防御进入目标区域时,如何利用多个防御无人艇进行有效拦截。现有方法,如纯粹的基于力的方法或原始的深度强化学习方法,在面对机动性更强的攻击者时,往往难以取得理想的拦截效果,存在防御效率低、适应性差等痛点。

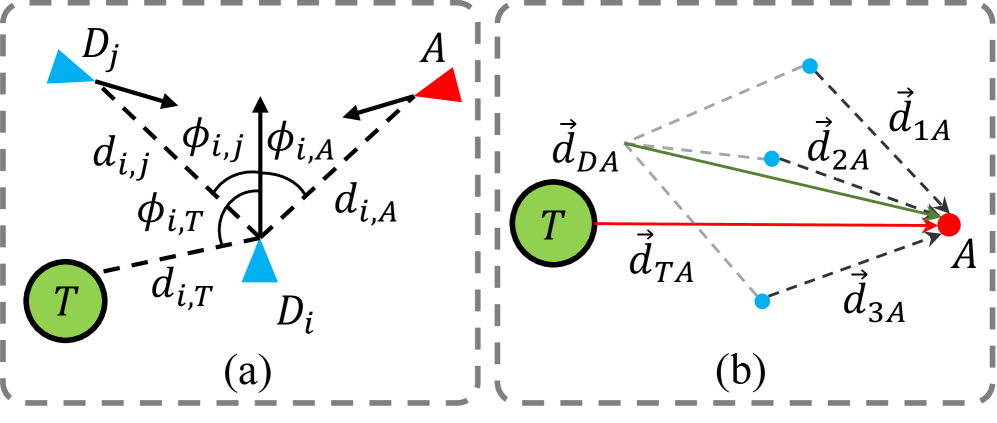

核心思路:论文的核心思路是将基于力的Boids模型与深度强化学习相结合,利用Boids模型提供一个计算高效的基线策略,实现多智能体间的初步协调。然后,通过深度强化学习学习一个残差策略,对Boids模型的输出进行自适应的调整和优化,从而提高防御策略的性能和鲁棒性。这种结合方式既能保证计算效率,又能充分发挥深度强化学习的优化能力。

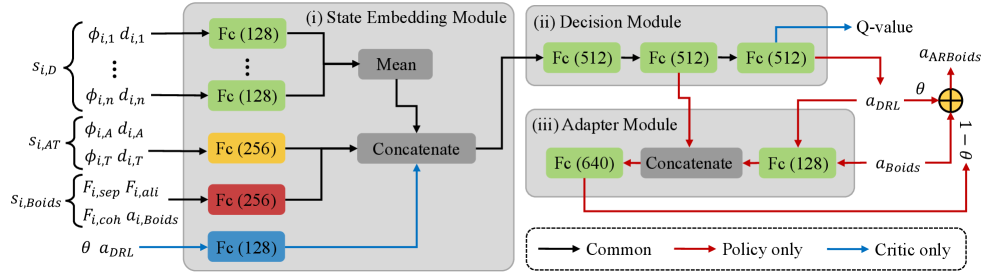

技术框架:ARBoids框架主要包含两个模块:Boids模型和残差强化学习模块。首先,Boids模型根据无人艇之间的相对位置和速度关系,计算出一个初步的行动方向。然后,残差强化学习模块以Boids模型的输出作为输入,通过深度神经网络学习一个残差动作,对Boids模型的输出进行修正。最终,防御无人艇执行修正后的动作。整个框架通过强化学习不断优化残差策略,从而提高整体的防御性能。

关键创新:该论文最重要的技术创新点在于提出了将Boids模型与残差强化学习相结合的框架。与传统的纯粹基于力的方法相比,该方法能够通过强化学习自适应地优化防御策略。与原始的深度强化学习方法相比,该方法利用Boids模型提供了一个良好的初始化策略,从而加速了学习过程,并提高了策略的鲁棒性。

关键设计:论文中,Boids模型的参数(如分离、对齐、凝聚的权重)需要根据具体场景进行调整。残差强化学习模块采用深度神经网络作为策略网络,网络的结构和参数需要根据问题的复杂程度进行设计。损失函数通常采用Actor-Critic框架中的策略梯度损失函数,并可以加入一些正则化项,以提高策略的泛化能力。具体实现细节未知,因为论文尚未公开全部代码。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ARBoids在拦截成功率和拦截时间等方面均优于传统的基于力的方法和原始的深度强化学习方法。具体性能提升数据未知,但摘要强调了其在不同攻击者机动性下的鲁棒性和泛化能力。该方法能够有效地适应不同的攻击策略,并实现高效的协同防御。

🎯 应用场景

该研究成果可应用于港口、重要水域等场景的防御任务,例如拦截非法入侵船只、保护海上设施等。此外,该方法也可推广到其他多智能体协同任务中,如无人机编队飞行、机器人协同搜索等,具有重要的实际应用价值和广阔的应用前景。

📄 摘要(原文)

The target defense problem (TDP) for unmanned surface vehicles (USVs) concerns intercepting an adversarial USV before it breaches a designated target region, using one or more defending USVs. A particularly challenging scenario arises when the attacker exhibits superior maneuverability compared to the defenders, significantly complicating effective interception. To tackle this challenge, this letter introduces ARBoids, a novel adaptive residual reinforcement learning framework that integrates deep reinforcement learning (DRL) with the biologically inspired, force-based Boids model. Within this framework, the Boids model serves as a computationally efficient baseline policy for multi-agent coordination, while DRL learns a residual policy to adaptively refine and optimize the defenders' actions. The proposed approach is validated in a high-fidelity Gazebo simulation environment, demonstrating superior performance over traditional interception strategies, including pure force-based approaches and vanilla DRL policies. Furthermore, the learned policy exhibits strong adaptability to attackers with diverse maneuverability profiles, highlighting its robustness and generalization capability. The code of ARBoids will be released upon acceptance of this letter.