Fast Adaptive Anti-Jamming Channel Access via Deep Q Learning and Coarse-Grained Spectrum Prediction

作者: Jianshu Zhang, Xiaofu Wu, Junquan Hu

分类: cs.LG, cs.AI

发布日期: 2025-02-07 (更新: 2025-12-25)

备注: This paper is accepted by IEEE Transactions on Vehicular Technology (TVT), 2025

💡 一句话要点

提出基于深度Q学习和粗粒度频谱预测的快速自适应抗干扰信道接入方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 抗干扰通信 深度强化学习 信道接入 频谱预测 动态干扰 深度Q网络 自适应算法

📋 核心要点

- 传统固定模式的抗干扰信道接入在动态干扰环境中失效,深度强化学习方法虽能应对,但训练成本高昂。

- 论文提出一种基于深度Q学习和粗粒度频谱预测的快速自适应抗干扰方法,旨在加速学习过程。

- 实验结果表明,该方法显著减少了训练所需的 episodes 数量,并提升了吞吐量。

📝 摘要(中文)

本文研究了复杂且未知的干扰环境下的抗干扰信道接入问题,其中干扰器可以动态调整其策略以针对不同的信道。传统的采用固定模式的信道跳频抗干扰方法在这种动态干扰攻击面前是无效的。虽然新兴的基于深度强化学习(DRL)的动态信道接入方法可以在快速变化的干扰攻击下实现纳什均衡(NE),但它需要大量的训练 episodes。为了解决这个问题,我们提出了一种快速自适应抗干扰信道接入方法,该方法遵循“比干扰器学习更快”的直觉,其中同步更新的粗粒度频谱预测作为基于深度Q网络(DQN)的抗干扰模型的辅助任务。这有助于模型识别优于标准DRL的Q函数,同时显著减少训练 episodes 的数量。数值结果表明,与标准DRL相比,所提出的方法显著加快了模型训练的收敛速度,减少了高达70%的所需训练 episodes。此外,由于有效地利用了粗粒度频谱预测,它还在吞吐量方面实现了比NE策略高10%的改进。

🔬 方法详解

问题定义:论文旨在解决复杂动态干扰环境下,传统抗干扰信道接入方法失效,以及基于深度强化学习的动态信道接入方法训练成本过高的问题。现有方法无法快速适应干扰器的策略变化,导致通信性能下降。

核心思路:论文的核心思路是“比干扰器学习更快”,通过引入粗粒度频谱预测作为辅助任务,引导深度Q网络更快地学习到有效的Q函数。这种方法旨在利用频谱预测信息,加速模型对环境的理解和适应。

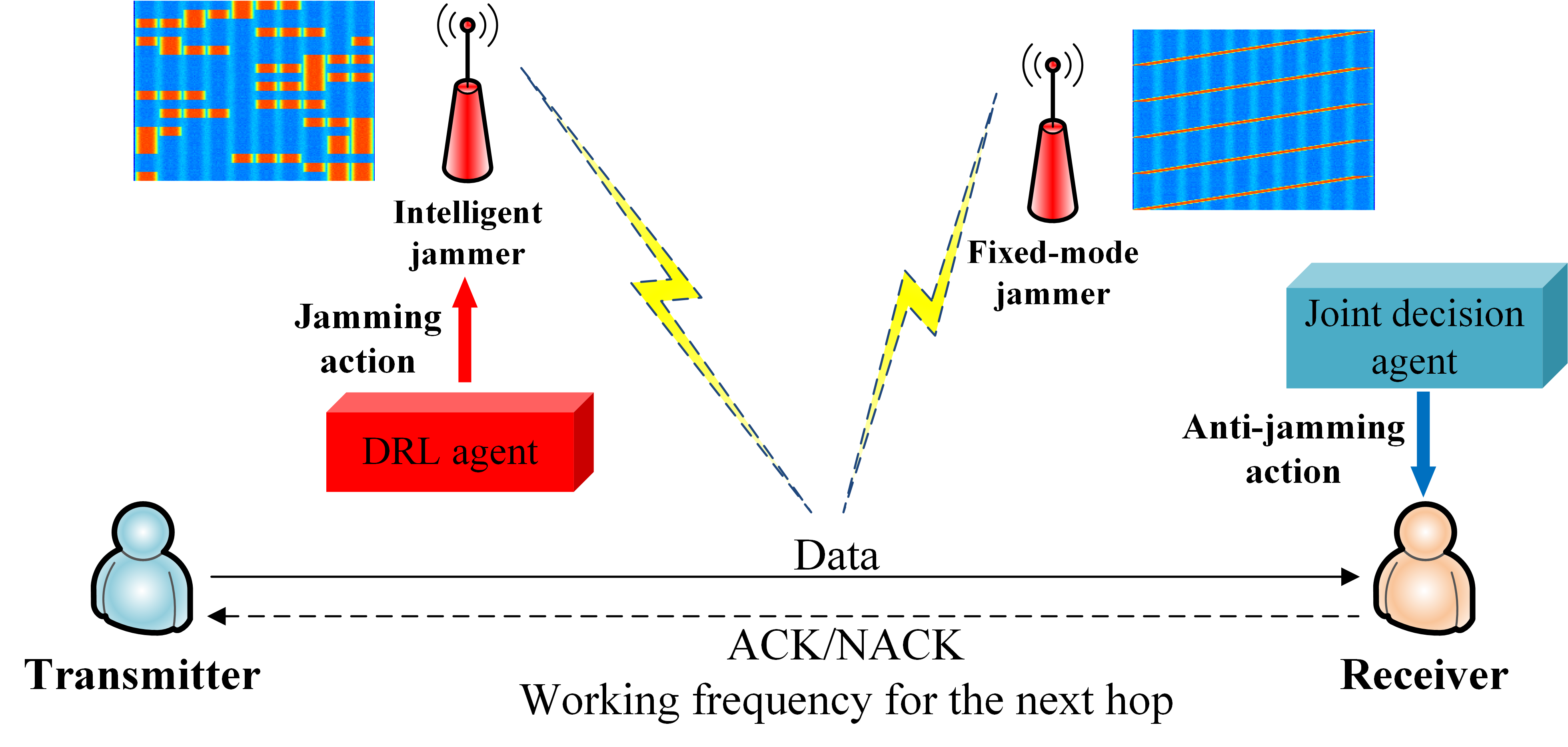

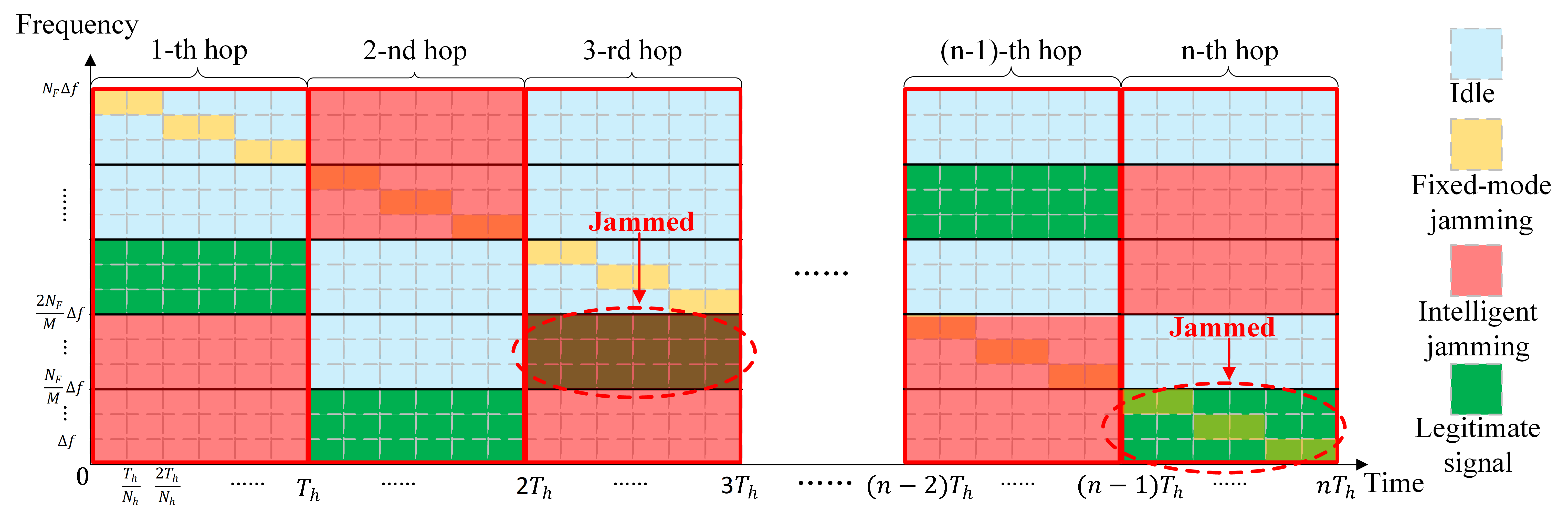

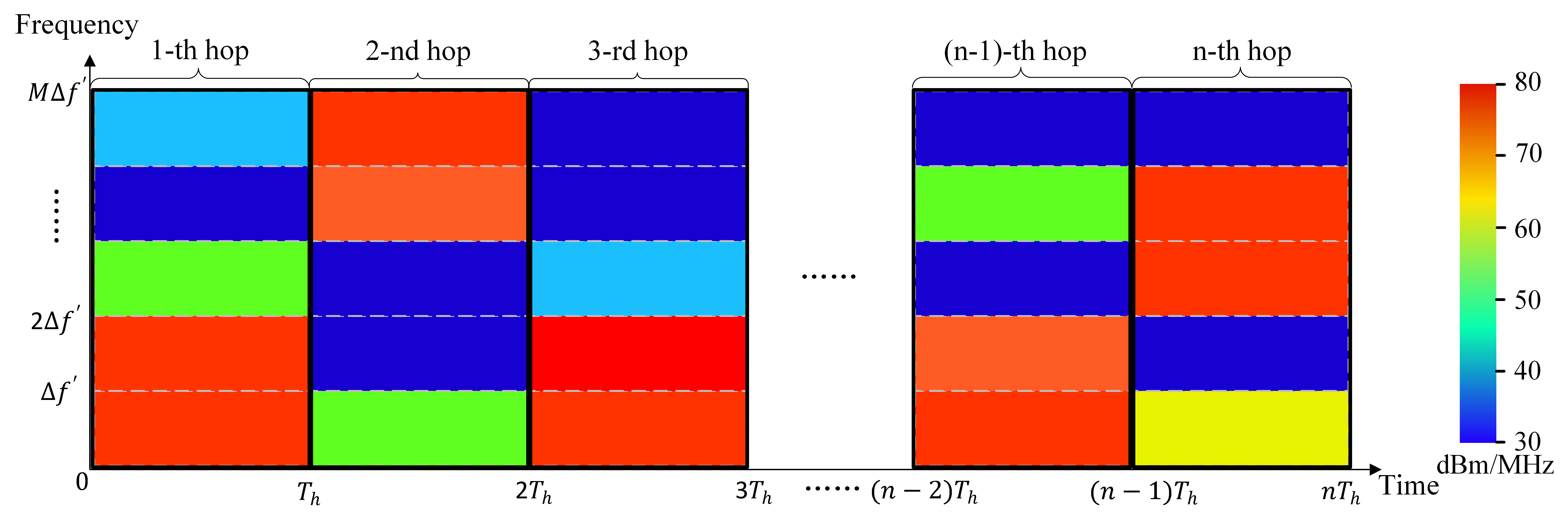

技术框架:整体框架包含两个主要部分:基于深度Q网络(DQN)的信道接入策略学习模块和粗粒度频谱预测模块。这两个模块同步更新,频谱预测模块为DQN提供辅助信息,帮助其更快地找到最优信道接入策略。具体流程为:智能体根据当前状态选择信道,接收环境反馈(奖励和下一个状态),同时利用频谱预测模块预测未来频谱占用情况,并将预测结果用于更新DQN。

关键创新:最重要的技术创新点在于将粗粒度频谱预测作为深度Q学习的辅助任务。与传统的深度强化学习方法相比,该方法能够利用频谱预测信息,加速模型的学习过程,减少训练所需的 episodes 数量。本质区别在于,传统方法仅依赖于环境的即时反馈进行学习,而该方法则利用了对未来环境的预测信息。

关键设计:粗粒度频谱预测模块的具体实现方式未知,但可以推测其可能采用某种时间序列预测模型。DQN的网络结构也未明确说明,但通常包括输入层(表示当前状态,如信道占用情况)、若干隐藏层和输出层(表示每个信道的Q值)。损失函数可能包括DQN的TD误差和频谱预测的预测误差。关键参数设置可能包括学习率、折扣因子、探索率等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,与标准深度强化学习方法相比,该方法能够显著加快模型训练的收敛速度,减少高达70%的训练 episodes。此外,由于有效地利用了粗粒度频谱预测,该方法还在吞吐量方面实现了比纳什均衡策略高10%的改进。这些数据表明,该方法在动态干扰环境下具有显著的性能优势。

🎯 应用场景

该研究成果可应用于无线通信、军事通信等领域,尤其是在存在恶意干扰的环境下。通过快速自适应的信道接入策略,可以提高通信系统的可靠性和吞吐量,保障信息传输的安全性。未来,该方法可以扩展到更复杂的通信场景,例如认知无线电网络和物联网设备。

📄 摘要(原文)

This paper investigates the anti-jamming channel access problem in complex and unknown jamming environments, where the jammer could dynamically adjust its strategies to target different channels. Traditional channel hopping anti-jamming approaches using fixed patterns are ineffective against such dynamic jamming attacks. Although the emerging deep reinforcement learning (DRL) based dynamic channel access approach could achieve the Nash equilibrium (NE) under fast-changing jamming attacks, it requires extensive training episodes. To address this issue, we propose a fast adaptive anti-jamming channel access approach guided by the intuition of ``learning faster than the jammer", where a synchronously updated coarse-grained spectrum prediction serves as an auxiliary task for the deep Q network (DQN) based anti-jamming model. This helps the model identify a superior Q-function compared to standard DRL while significantly reducing the number of training episodes. Numerical results indicate that the proposed approach significantly accelerates the rate of convergence in model training, reducing the required training episodes by up to 70\% compared to standard DRL. Additionally, it also achieves a 10\% improvement in throughput over NE strategies, owing to the effective use of coarse-grained spectrum prediction.