Transforming Multimodal Models into Action Models for Radiotherapy

作者: Matteo Ferrante, Alessandra Carosi, Rolando Maria D Angelillo, Nicola Toschi

分类: cs.LG, cs.AI

发布日期: 2025-02-06

💡 一句话要点

提出基于少样本强化学习的行动模型,将多模态模型应用于放疗计划。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 放射治疗计划 多模态模型 强化学习 少样本学习 行动模型 蒙特卡罗模拟 剂量优化

📋 核心要点

- 传统放疗计划制定耗时且依赖专家经验,存在变异性和效率问题。

- 利用多模态模型预训练知识,通过少量样本强化学习,构建放疗计划行动模型。

- 实验表明,该方法在剂量分布优化和效率上优于传统强化学习方法。

📝 摘要(中文)

放射疗法是癌症治疗的关键手段,需要精确的计划以平衡肿瘤清除和健康组织保护。传统治疗计划(TP)是迭代的、耗时的,并且依赖于人类专业知识,这可能导致变异性和低效率。我们提出了一种新颖的框架,使用少样本强化学习(RL)方法将大型多模态基础模型(MLM)转换为用于TP的行动模型。我们的方法利用MLM在物理、辐射和解剖学方面的广泛预训练知识,并通过少样本学习过程对其进行增强。这使得模型能够使用蒙特卡罗模拟器迭代地改进治疗计划。结果表明,该方法在质量和效率上均优于传统的基于RL的方法,在前列腺癌数据的模拟中实现了更高的奖励分数和更优化的剂量分布。这个概念验证表明,将先进的AI模型集成到临床工作流程中具有广阔前景,有可能提高放射治疗计划的速度、质量和标准化。

🔬 方法详解

问题定义:论文旨在解决放射治疗计划(TP)制定过程中耗时、低效以及对专家经验依赖过高的问题。现有的TP方法通常是迭代的,需要人工干预,并且不同专家制定的计划可能存在差异,导致治疗效果不稳定。因此,如何利用AI技术自动化并优化TP过程,提高效率和标准化程度,是本研究要解决的核心问题。

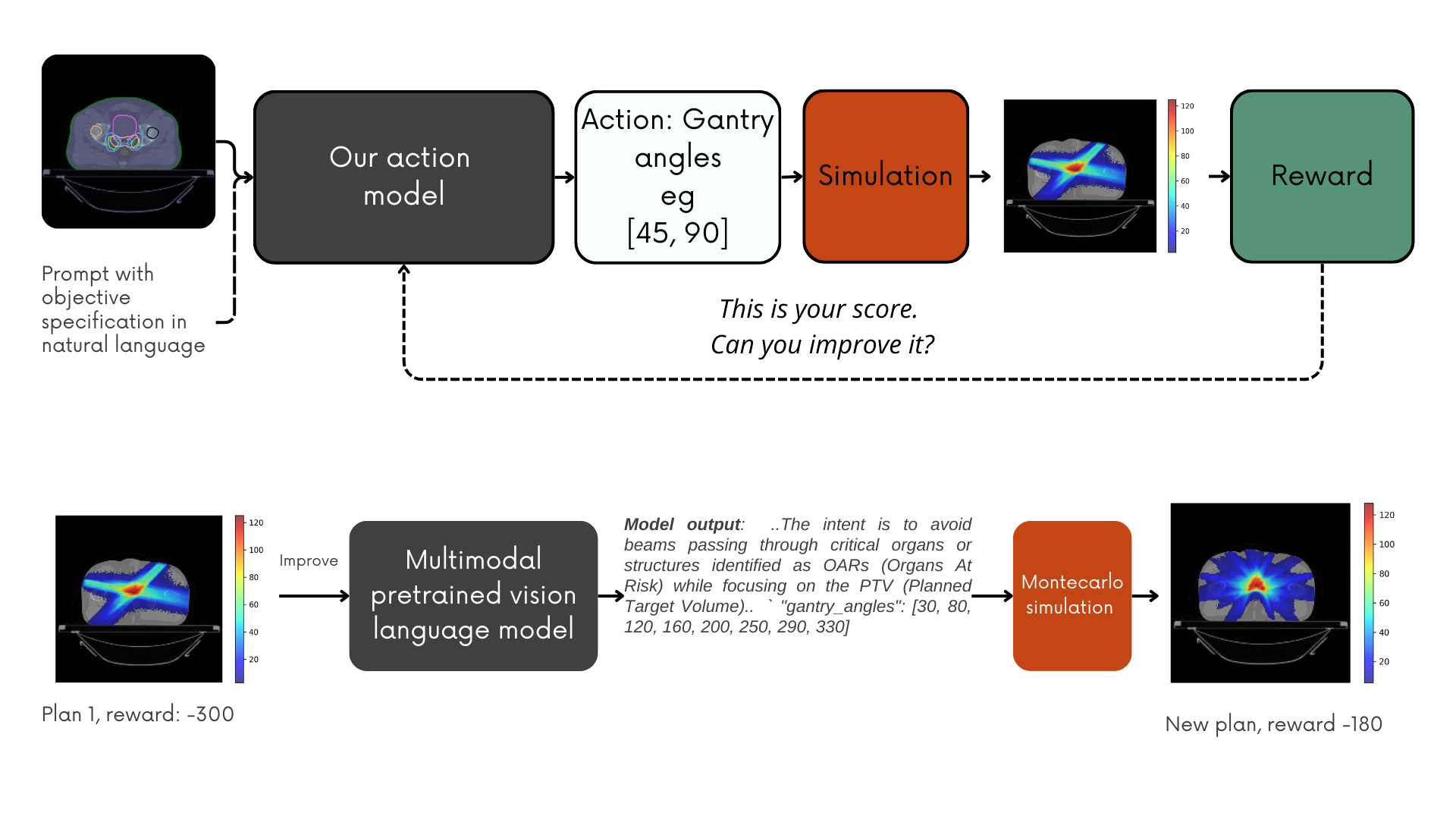

核心思路:论文的核心思路是将一个预训练的大型多模态模型(MLM)转化为一个行动模型,用于自动制定放射治疗计划。通过利用MLM在物理、辐射和解剖学方面的预训练知识,并结合少量样本强化学习(RL),使模型能够根据患者的具体情况,迭代地优化治疗计划,从而实现高效、高质量的TP。

技术框架:整体框架包含以下几个主要模块:1) 多模态基础模型(MLM):利用预训练的MLM作为知识库,提供关于物理、辐射和解剖学的基础知识。2) 少样本强化学习(RL):使用少量患者数据,通过RL算法训练模型,使其能够根据当前状态(例如,肿瘤位置、健康组织分布)选择合适的治疗动作(例如,调整射线角度、剂量)。3) 蒙特卡罗模拟器:使用蒙特卡罗模拟器评估治疗计划的质量,并生成奖励信号,用于指导RL模型的训练。4) 行动模型:经过训练的RL模型,能够根据患者数据自动生成放射治疗计划。

关键创新:最重要的技术创新点在于将大型多模态模型与少样本强化学习相结合,用于放射治疗计划制定。与传统的基于RL的方法相比,该方法利用了MLM的预训练知识,从而减少了对大量训练数据的需求,提高了学习效率和泛化能力。此外,该方法还能够更好地平衡肿瘤清除和健康组织保护,实现更优化的剂量分布。

关键设计:论文中关键的设计包括:1) 奖励函数设计:奖励函数用于评估治疗计划的质量,需要综合考虑肿瘤清除率、健康组织受损程度以及剂量分布的均匀性。2) 状态空间和动作空间定义:状态空间需要包含患者的解剖结构、肿瘤位置等信息,动作空间需要包含可调整的治疗参数,例如射线角度、剂量等。3) RL算法选择:选择合适的RL算法(例如,Q-learning、Policy Gradient)对模型的训练效果至关重要。4) 少样本学习策略:设计有效的少样本学习策略,使模型能够快速适应新的患者数据。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在模拟前列腺癌数据上优于传统的基于RL的方法,实现了更高的奖励分数和更优化的剂量分布。具体而言,该方法在剂量分布的均匀性和对健康组织的保护方面表现出显著优势,表明其能够更好地平衡肿瘤清除和健康组织保护。此外,该方法还具有更高的学习效率,能够在少量样本的情况下快速收敛。

🎯 应用场景

该研究成果可应用于临床放射治疗计划的自动化和优化,提高治疗效率和标准化程度,减少人为误差。通过集成先进的AI模型,有望加速治疗计划的制定过程,使医生能够更专注于患者的个性化需求,并最终改善癌症患者的治疗效果。未来,该方法还可以扩展到其他类型的癌症治疗计划制定中。

📄 摘要(原文)

Radiotherapy is a crucial cancer treatment that demands precise planning to balance tumor eradication and preservation of healthy tissue. Traditional treatment planning (TP) is iterative, time-consuming, and reliant on human expertise, which can potentially introduce variability and inefficiency. We propose a novel framework to transform a large multimodal foundation model (MLM) into an action model for TP using a few-shot reinforcement learning (RL) approach. Our method leverages the MLM's extensive pre-existing knowledge of physics, radiation, and anatomy, enhancing it through a few-shot learning process. This allows the model to iteratively improve treatment plans using a Monte Carlo simulator. Our results demonstrate that this method outperforms conventional RL-based approaches in both quality and efficiency, achieving higher reward scores and more optimal dose distributions in simulations on prostate cancer data. This proof-of-concept suggests a promising direction for integrating advanced AI models into clinical workflows, potentially enhancing the speed, quality, and standardization of radiotherapy treatment planning.